L’IA rend de plus en plus difficile la distinction entre ce qui est réel et ce qui ne l’est pas. Et les prédateurs sexuels d’enfants en prennent note

L’ère de l’intelligence artificielle fait que tout se passe très vite, très vite. Des entreprises comme Mercadona, Google ou Anthropic soulignent déjà que la grande majorité de leur code est écrite par une IA, Mozilla donne des fleurs à Mythos et Jensen Huang est enthousiasmé par les bénéfices de l’IA et tout ce qu’elle nous permet de créer. Parmi ces créations, il y a de tout, comme une énorme quantité de matériel pédosexuel.

Les chercheurs demandent de l’aide, et je peux vous dire qu’il y a des choses qui ne sont pas faciles à assimiler.

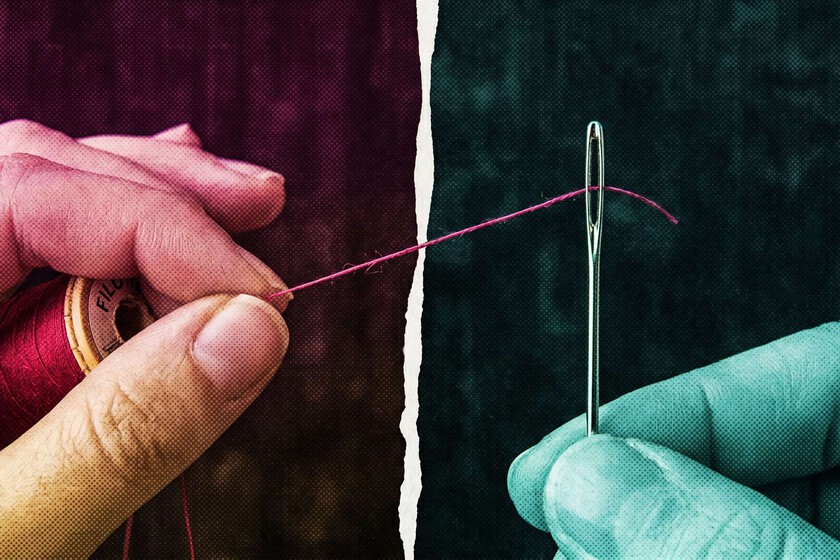

En bref. Ce mercredi, Bloomberg a publié un rapport qui condense six mois d’enquête au cours desquels ils se sont concentrés sur la prolifération rapide de matériel d’abus sexuels sur des enfants généré par l’intelligence artificielle. Ce n’est pas quelque chose d’étonnant si l’on prend en compte l’énorme quantité de fausses informations auxquelles nous devons déjà faire face chaque jour, tant sous forme de texte que d’images de plus en plus réalistes et même en vidéo, mais il y a une nuance importante.

Alors que dans ce cas, c’est la presse et les gens qui doivent l’aborder avec bon sens pour ne pas avaler le canular, perdant ainsi du temps, dans le cas de ce contenu généré par l’IA, c’est la police et les enquêteurs qui doivent perdre leur temps pour exclure qu’il s’agisse d’informations vraies. Et pendant ce temps, ils cessent d’enquêter sur les cas d’abus sexuels sur enfants, d’autres types d’abus ou de disparitions qui sont réels.

Les chiffres. Ils font peur, bien sûr. Le rapport souligne que le Centre national pour les enfants disparus et exploités a reçu plus de 1,5 million de rapports en 2025 comportant une composante générale d’intelligence générative. Parmi eux, plus de 7 000 signalements d’utilisateurs générant ou possédant du matériel d’abus sexuel sur des enfants généré avec l’IA et plus de 30 000 cas de personnes générant ce type de contenu. C’est stupide.

D’autre part, l’IWF (Internet Watch Foundation) a évalué plus de 8 000 images et vidéos générées par l’IA qui représentaient de manière très réaliste des actes d’abus sexuels sur des enfants. Il y a eu 3.443 vidéos par rapport aux 13 enregistrées en 2024. Au total, soit une augmentation de 26.385%. La croissance est importante et l’IWF elle-même a souligné dans le rapport que 65 % de ce contenu vidéo généré par l’IA montre des événements classés dans la « Catégorie A », la plus grave de ce type de matériel.

Cas. Ne pensez pas qu’il s’agit de cas de dark web, puisque des chatbots IA ont été découverts sur le web ouvert qui hébergent ces images et encouragent leur création. De quel type de contenu parle-t-on ? Voici la partie délicate. Bloomberg souligne quelques exemples qui font partie de ces milliers de cas plus complexes qui sont actuellement traités par les autorités et où il y a… de tout.

Un homme qui a utilisé les visages d’enfants de son quartier pour générer du contenu les montrant avoir des relations sexuelles avec leur mère ou leur grand-mère, un autre qui a produit des images sadiques de petits enfants et de bébés, un autre homme accusé d’avoir modifié l’image d’une fille prépubère pour agrandir sa poitrine et de publier les images sur Onlyfans, un prêtre qui a passé des années à collecter du matériel et a ensuite créé encore plus grâce à l’IA ou un soldat de l’armée qui a sexualisé des images d’enfants qu’il a connus avec l’IA.

![]()

D’où viennent les images d’enfants ? Facebook et Instagram. C’est la réponse simple. Selon Joe O’Barr, l’un des chercheurs qui ont prêté sa voix à l’enquête Bloomberg, « les gens volent des images sur Facebook et Instagram, des choses que les parents publient librement, et les publient sur des plateformes d’intelligence artificielle ».

Une tendance qui a été découverte est que beaucoup créent des images impliquant des enfants qu’ils connaissent dans le monde réel, réalisant ainsi leurs fantasmes. Par exemple, le cas d’un homme qui a pris des photos de la fille de six ans de sa partenaire, les a manipulées avec l’IA, puis les a publiées à côté de ses propres images nues sur Onlyfans.

« Le fait que l’agresseur connaissait la victime m’a fait dresser les cheveux sur la tête. Cela signifiait que la jeune fille pouvait être en danger réel et imminent » – Joe O’Barr

Ce que font les plateformes. Ces mêmes plateformes sur lesquelles les images sont hébergées ne restent pas les bras croisés. Les chercheurs espèrent que ces mêmes entreprises tireront la sonnette d’alarme lorsqu’elles trouveront quelque chose, mais il y a un problème : Google, xAI, Meta ou OnlyFans délèguent la tâche de surveillance à l’IA. De nombreux cas ont été rapportés où des humains ne supportent pas de marquer ce type de contenu et c’est pourquoi ils embauchent dans des pays comme le Kenya ou délèguent directement à AI.

Le problème est le nombre de faux positifs que l’IA trouve et qui finissent par surcharger la « boîte aux lettres » des chercheurs. Un enquêteur de Caroline du Nord note qu’il a constaté une multiplication par 11 du nombre de « pourboires » que son bureau reçoit, et que l’année dernière seulement, le volume a doublé pour atteindre 52 000 rapports. Il souligne que n’importe quel humain dirait « cela ne se contente pas d’enquêter », mais comme l’IA ne le sait pas, elle envoie tout : des choses sérieuses sur lesquelles enquêter jusqu’aux simples insultes.

Insupportable. «Plus nous devons enquêter sur des cas, plus il est difficile de traiter chaque cas individuellement», explique l’un des chercheurs. Meta elle-même a reconnu que son système n’est pas parfait et ajoute « un peu de bruit » au réseau des chercheurs. Comme nous l’avons dit précédemment, c’est une énorme quantité de matériel qui empêche les enquêteurs de faire leur travail sur des cas réels de mineurs maltraités ou portés disparus.

« Nous accomplissons ce travail colossal avec les mêmes ressources dont nous disposions il y a dix ans. Nous n’en pouvons plus et nous ne voulons pas rater un véritable enfant qui est abusé sexuellement », a déclaré un agent à Bloomberg.

Législateurs, ressaisissez-vous. Le travail de ces enquêteurs dépend du ministère de la Justice et d’un financement d’environ 30 millions de dollars destiné à 61 groupes de travail d’État. Ils soulignent qu’il s’agit d’un très petit chiffre et, pour mettre les choses en contexte, c’est ce que le FBI dépense en une journée. Ils affirment que, malgré l’avalanche de rapports faisant état d’abus sexuels sur des enfants, le financement est resté inchangé.

Il existe d’autres problèmes, comme le fait que le rythme de la législation est en retard par rapport à la technologie ou que les criminels s’enhardissent, précisément parce qu’ils savent que la quantité d’informations vraies et fausses enterre les enquêteurs. Car si auparavant un prédateur d’enfants pouvait atteindre deux ou trois enfants, avec l’IA, il pourrait atteindre 40 ou 50 enfants. «C’est un peu comme pêcher à la dynamite», explique un chercheur à la retraite qui a passé 30 ans dans une brigade luttant pour la sécurité des enfants.

Le rapport de Bloomberg est très dur, mais il représente finalement l’envers d’une technologie extrêmement jeune et qui n’a pas mis longtemps à se démocratiser. Pour le meilleur et, comme on le voit, pour le pire. Nous avons déjà vu cela sous une forme naissante, comme ce que les actrices violées elles-mêmes ont décrit comme « une cause perdue ».

À Simseo | Parfois, les IA érotiques sont des IA. Et parfois, c’est un Kenyan qui facture deux dollars de l’heure.