L'IA agentique, parce que l'avenir est dans les outils plutôt que dans les modèles

Une complexité croissante règne dans le monde de l’intelligence artificielle agentique. Les cadres, outils et modèles se multiplient rapidement, ce qui rend de plus en plus difficile pour les développeurs et les entreprises de comprendre quelles solutions adopter pour créer des systèmes efficaces. Le résultat est souvent une paralysie décisionnelle : trop d’options, trop de compromis à évaluer.

Une nouvelle étude menée par des chercheurs de différentes institutions tente de clarifier, en proposant un cadre structuré pour classer les stratégies d'adaptation de l'IA agentique. L'objectif est de fournir des conseils pratiques pour naviguer dans différentes approches, en aidant les équipes à choisir des outils et des architectures en fonction du coût, de la flexibilité et du risque.

Pour les entreprises, le message est clair : l’IA agentique n’est pas seulement un problème de sélection du meilleur modèle, mais une décision architecturale plus large. Il s’agit de déterminer où investir le budget de formation, quel degré de modularité préserver et quels compromis accepter entre performances, coûts de fonctionnement et capacité à évoluer dans le temps.

Deux façons d’adapter l’IA : agents et outils

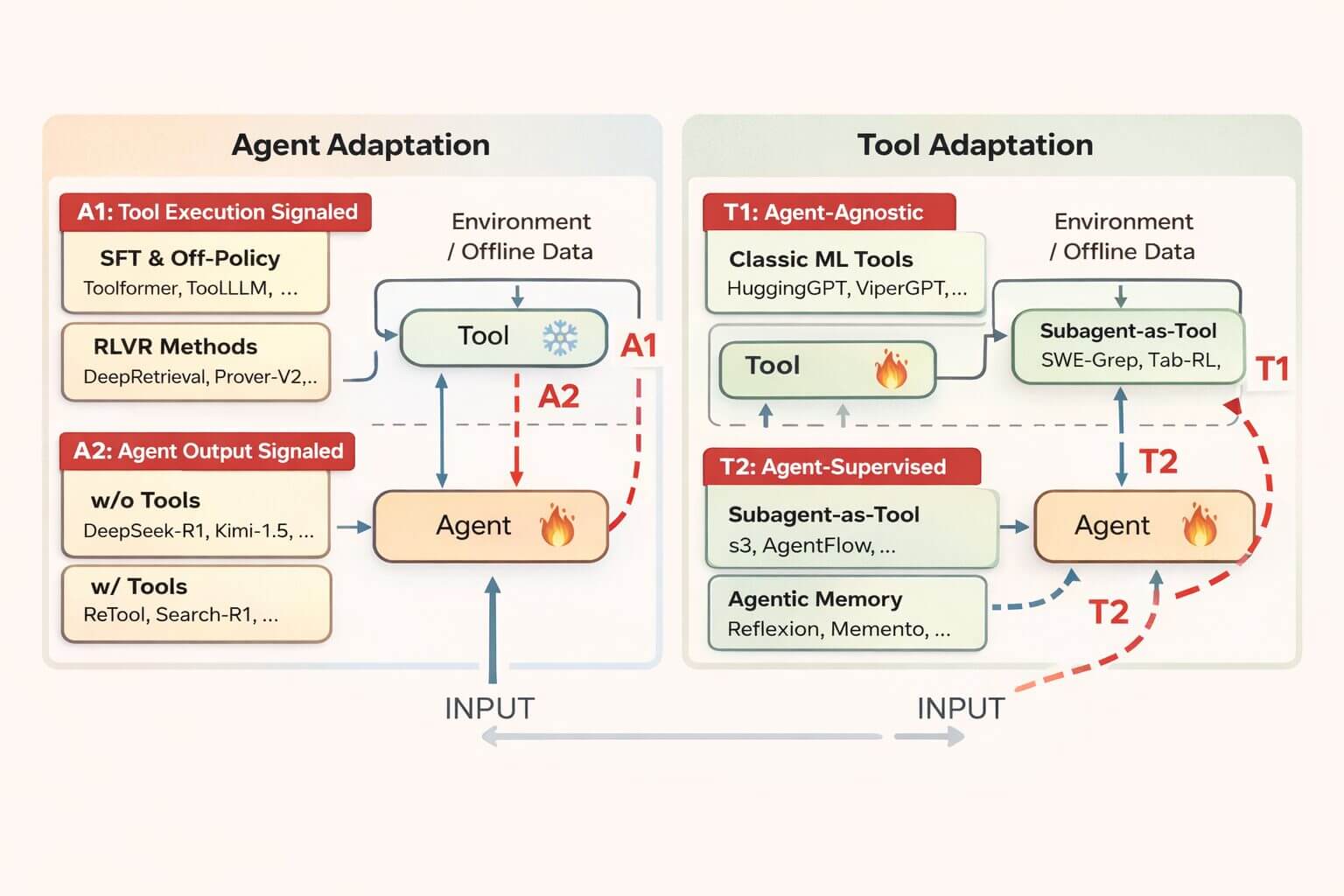

L'étude identifie deux grandes dimensions qui définissent l'adaptation des systèmes agentiques : l'adaptation des agents et l'adaptation des outils.

Dans le premier cas, l'intervention s'effectue directement sur le modèle de base qui guide l'agent. Grâce à des techniques telles que le réglage fin ou l'apprentissage par renforcement, les paramètres internes sont modifiés pour spécialiser le comportement de l'agent sur des tâches spécifiques. Il s’agit d’une approche puissante, mais coûteuse, car elle nécessite de grandes quantités de données et de ressources informatiques.

L’adaptation des outils déplace cependant l’attention vers l’environnement dans lequel s’inscrit l’agent. Le modèle principal reste « figé », tandis que les composants externes tels que les moteurs de recherche, les modules de mémoire ou les sous-agents spécialisés sont optimisés. De cette façon, le système peut évoluer sans avoir à recycler un modèle de base, ce qui réduit considérablement les coûts.

Quatre stratégies pour les systèmes agentiques

Quatre stratégies principales découlent de ces deux dimensions.

Les deux premiers concernent l'adaptation de l'agent. Dans la stratégie A1, l'agent apprend directement en exécutant les outils : le feedback est objectif et vérifiable, comme dans le cas d'un code qui se compile ou échoue. Cette approche est idéale pour les domaines techniques stables, tels que la programmation ou les requêtes SQL.

La stratégie A2 évalue plutôt uniquement le résultat final. L’agent est récompensé s’il fournit la bonne réponse, quelles que soient les étapes intermédiaires. Il s'agit d'une méthode efficace pour apprendre à l'agent à orchestrer plusieurs outils et à gérer des flux complexes, mais elle nécessite de grands ensembles de données de formation.

Les deux autres stratégies portent sur l'adaptation des outils. T1 implique l'utilisation d'outils génériques, entraînés sur des données volumineuses puis connectés à un agent figé, comme cela se produit dans les systèmes de récupération classiques utilisés dans RAG. T2, plus sophistiqué, consiste en des outils de formation spécifiquement conçus pour accompagner un agent fixe, utilisant le feedback du même agent comme signal d'apprentissage.

En pratique, les systèmes plus avancés combinent plusieurs approches : agents spécialisés pour le raisonnement, outils génériques de récupération de données et modules adaptatifs pour combler des lacunes spécifiques.

Coûts cachés et compromis stratégiques

Pour les décideurs commerciaux, le choix entre ces stratégies s’articule autour de trois facteurs clés : le coût, la généralisabilité et la modularité.

L'adaptation des agents offre une grande flexibilité, mais implique des coûts élevés et des risques d'hyper-spécialisation. Un agent formé de manière intensive sur une tâche peut perdre ses compétences générales, un phénomène appelé surapprentissage ou « oubli catastrophique ».

L’adaptation des outils est plus efficace et modulaire. Il vous permet de mettre à niveau des composants individuels sans toucher au moteur central, favorisant ce que l'on appelle échange à chaud. Cependant, cette approche dépend fortement des capacités du modèle sous-jacent : si l’agent gelé n’est pas adéquat, même les meilleurs outils deviennent inutiles.

Une feuille de route pour l’adoption par les entreprises

L'étude propose une sorte de parcours progressif pour les entreprises. Nous commençons par des solutions simples et à faible risque, telles que l'utilisation d'outils indépendants des agents prêts à l'emploi, idéaux pour le prototypage. Si des limites apparaissent, il est préférable de passer à la formation de petits sous-agents spécialisés, en gardant le modèle principal inchangé.

Ce n'est que dans des cas extrêmes, lorsque vous devez internaliser des stratégies complexes ou des capacités avancées d'autocorrection, qu'il est judicieux d'investir dans la formation de bout en bout d'un agent monolithique. Une option puissante, mais à considérer en dernier recours.

De l'agent parfait à l'écosystème intelligent

Le message sous-jacent est que l’avenir de l’IA agentique ne passe pas par la construction d’un modèle unique « omniscient », mais par la création d’écosystèmes intelligents, composés d’un noyau stable et d’outils spécialisés qui l’enrichissent.

Pour la plupart des entreprises, la solution la plus efficace n’est pas de doter l’IA d’un plus gros cerveau, mais de la doter de meilleurs outils.

Je procède en ajoutant la dernière section à l'article déjà édité, en traduisant et en intégrant le texte fourni de manière cohérente, journalistique et SEO, sans altérer le système d'information.

Ci-dessous se trouve juste le texte à ajouter, prêt à coller en bas de l'article.

Conclusions : de l’IA statique aux écosystèmes agents adaptatifs

La transition des modèles de base statiques vers des systèmes d’IA agentiques autonomes marque un changement structurel dans l’intelligence artificielle. Il ne s’agit plus de générer des réponses passives, mais d’aborder des problèmes complexes grâce à un raisonnement en plusieurs étapes, à l’utilisation dynamique d’outils et à une interaction continue avec l’environnement.

Ces systèmes étant utilisés dans des contextes de plus en plus ouverts et imprévisibles, la capacité d’adaptation devient le principal facteur de fiabilité et de performance. Savoir affiner ses comportements, maîtriser de nouveaux outils et s’aligner sur des tâches précises, voilà ce qui distingue un agent efficace d’un agent fragile.

Le cadre proposé par l'étude offre une carte unifiée de ce paysage, organisant les stratégies d'adaptation en quatre paradigmes distincts en fonction du lieu où l'optimisation se produit et du signal de supervision utilisé.

L’analyse montre comment l’espace de conception de l’IA agentique est dominé par la tension entre évolution monolithique et approche modulaire. Les paradigmes centrés sur les agents, A1 et A2, offrent une grande flexibilité paramétrique, permettant aux modèles d'internaliser la mécanique des outils et des stratégies de raisonnement complexes via une rétroaction directe ou des évaluations globales des résultats.

Ces avantages ont cependant un prix : des coûts de calcul élevés et le risque de phénomènes tels que des oublis catastrophiques, qui peuvent compromettre des compétences précédemment acquises.

Les paradigmes centrés sur les outils, T1 et T2, transfèrent plutôt le fardeau de l’adaptation sur l’écosystème entourant l’agent. En traitant les outils et les sous-agents comme des composants modulaires optimisables, ils permettent une plus grande flexibilité du système et une efficacité notable dans l'utilisation des données, rendant l'approche plus durable dans l'entreprise.

Un élément clé qui ressort de l’analyse est le renversement conceptuel introduit par le paradigme T2. Au lieu d’optimiser le modèle de base, cette approche l’utilise comme source stable de supervision, formant des sous-agents légers – tels que des chercheurs, des planificateurs ou des modules de mémoire – pour servir un noyau figé.

Ce changement architectural sépare l'acquisition de nouvelles compétences du raisonnement général et ouvre la voie à des systèmes d'agents fédérés, capables d'évoluer continuellement sans déstabiliser le modèle central.

À l’avenir, le développement de l’IA agentique dépendra de moins en moins du choix d’un paradigme unique et de plus en plus de leur intégration stratégique. Les systèmes les plus robustes combineront la profondeur du raisonnement des approches centrées sur les agents avec l’efficacité modulaire des approches centrées sur les outils, permettant ainsi une plus grande évolutivité et résilience.

Pour réaliser ce potentiel, des défis cruciaux demeurent : l’adaptation continue dans des environnements dynamiques, la sécurité pour éviter les comportements indésirables tels que le piratage de récompense et l’efficacité nécessaire pour opérer dans des contextes aux ressources limitées.

En fin de compte, la prochaine génération de systèmes intelligents ne sera pas définie par un seul modèle omnipotent, mais par l’orchestration consciente de noyaux de raisonnement stables soutenus par des outils spécialisés et adaptatifs.