Le responsable de la sécurité d'Anthropic quitte l'entreprise pour écrire de la poésie

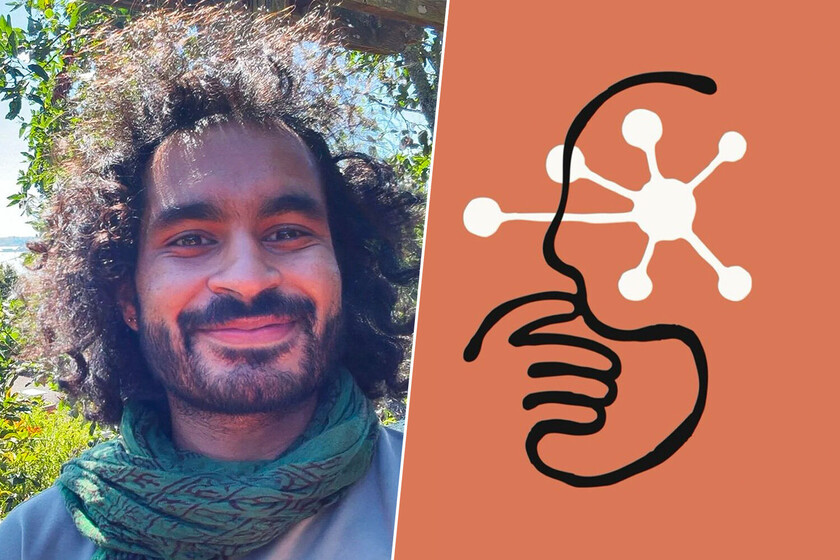

Dans un geste plus typique du « pingouin nihiliste » que du responsable de la sécurité de l'un des principaux protagonistes du développement de l'IA, Mrinank Sharma, responsable de la sécurité de l'intelligence artificielle chez Anthropic, a annoncé sa démission avec une lettre publique sur son profil X et consacrera sa vie à écrire de la poésie.

Dans sa déclaration, Sharma a non seulement expliqué pourquoi il quitte l'entreprise qui développe les modèles de Claude, mais a également décrit l'état actuel du développement de l'IA, avec un langage mêlant inquiétude et réflexion personnelle. « Le monde est en danger », a déclaré l'ancien directeur d'Anthropic.

Le contexte : qui il est et ce qu'il a fait chez Anthropic. Mrinank Sharma a dirigé l'équipe de recherche sur les garanties d'Anthropic, un groupe de recherche axé sur l'étude des risques associés aux systèmes d'IA.

Au sein d'Anthropic, le travail de Sharma comprenait le développement de défenses contre des risques tels que le bioterrorisme assisté par l'IA et l'étude de phénomènes tels que la flagornerie (la tendance des modèles d'IA à flatter l'utilisateur), ainsi que la recherche sur la manière dont l'IA peut influencer la perception humaine et modifier les comportements culturels.

Il part, mais laisse un message. La lettre presque énigmatique publiée par Sharma sur X est rapidement devenue virale en raison des messages qu'elle contenait. Il y exprime ses inquiétudes sur un ton qui transcende le technique. L’une des citations qui a le plus retenu l’attention : « Le monde est en danger. Et pas seulement à cause de l’IA ou des armes biologiques, mais à cause d’une série de crises interconnectées qui se développent en ce moment même. »

Au-delà du littéralisme presque apocalyptique, Sharma a averti que l'humanité approchait d'un point critique où le développement de l'IA était confronté à des dilemmes éthiques pour ceux qui la développent : « notre sagesse doit croître au même rythme que notre capacité à influencer le monde, sinon nous en subirons les conséquences. »

Travaillez pour ne pas travailler. Sharma n’est pas la seule à être confrontée à ce dilemme éthique. Selon des sources, d'autres employés d'Anthropic ont exprimé leur inquiétude face à l'énorme saut évolutif des derniers modèles d'IA. « J'ai l'impression que je viens au travail tous les jours pour être au chômage », a reconnu l'un des salariés auprès des médias britanniques.

D'une certaine manière, c'est vrai, puisque ces employés travaillent au développement d'une technologie qui, selon toute vraisemblance, changera la nature de leur travail, et celui de millions de personnes, dans quelques années.

Est-ce bon ou mauvais ? Une première lecture de la lettre laisse le sentiment que ces travailleurs développent l'arme qui détruira l'humanité. Cependant, une lecture entre les lignes laisse Anthropic dans une situation pionnière par rapport à ses rivaux d'OpenAI, Microsoft ou xAI : ils parviennent à avancer à un rythme qui dépasse même leurs développeurs. Une sensation qui ne semble pas se retrouver dans les modèles d’autres entreprises. Se pourrait-il que leurs modèles n’en soient pas à ce point d’évolution ?

« Tout au long de mon séjour ici, j'ai vu à plusieurs reprises combien il est difficile de laisser nos valeurs guider nos actions. Nous sommes constamment soumis à des pressions pour abandonner ce qui compte le plus », a écrit Sharma.

Le tournant poétique. En plus de réfléchir aux risques globaux qu'il perçoit, Sharma a annoncé que sa prochaine étape professionnelle sera très différente de celle qu'il a eue jusqu'à présent. Dans sa lettre, il mentionne son intention de consacrer du temps à ce qu'il appelle « la pratique du discours courageux » à travers la poésie. Ce passage de l’IA à la poésie a été interprété comme un signe d’insatisfaction face au rythme et à l’orientation dominants de l’industrie de la technologie de l’IA.

Comme Sharma, ces dernières semaines, d'autres personnalités clés du développement de l'IA d'Anthropic ont annoncé leur démission. Harsh Mehta et Behnam Neyshabur ont également annoncé il y a quelques jours qu'ils quittaient l'entreprise. Cependant, dans ces cas-là, l’annonce de la sortie a été faite et, immédiatement après, un nouveau projet d’IA a été annoncé. C’est-à-dire que, loin des postulats éthiques proposés par Sharma, son intention était plutôt de creuser sa propre mine d’or et non celle des autres.

À Simseo | Daniela Amodei, co-fondatrice d'Anthropic : « étudier les sciences humaines sera plus important que jamais »

Images | mrinank sharma, anthropique