Le physicien théorique des particules s'attaque à la boîte noire de l'apprentissage

Des voitures autonomes à la reconnaissance faciale, la vie moderne se développe davantage de l'apprentissage automatique, un type d'intelligence artificielle (IA) qui apprend des ensembles de données sans programmation explicite.

Malgré son omniprésence dans la société, nous commençons à peine à comprendre les mécanismes qui stimulent la technologie. Dans une étude récente, Zhengkang (Kevin) Zhang, professeur adjoint au Département de physique et d'astronomie de l'Université de l'Utah, a démontré comment les physiciens peuvent jouer un rôle important dans la démêlage de ses mystères.

« Les gens disaient que l'apprentissage automatique est une boîte noire – vous saisissez beaucoup de données et à un moment donné, il raisonne et parle et prend des décisions comme les humains. C'est comme de la magie parce que nous ne savons pas vraiment comment cela fonctionne », a déclaré Zhang. « Maintenant que nous utilisons l'IA dans de nombreux secteurs critiques de la société, nous devons comprendre ce que font nos modèles d'apprentissage automatique – pourquoi quelque chose fonctionne ou pourquoi quelque chose ne fonctionne pas. »

En tant que physicien théorique des particules, Zhang explique le monde qui l'entoure en comprenant comment les composantes les plus petites et les plus fondamentales de la matière se comportent dans un monde infinitésimal. Au cours des dernières années, il a appliqué les outils de son domaine pour mieux comprendre les modèles massivement complexes de l'apprentissage automatique.

Augmenter la réduction des coûts

La façon traditionnelle de programmer un ordinateur est avec des instructions détaillées pour accomplir une tâche. Dites que vous vouliez des logiciels qui peuvent repérer les irrégularités sur une tomodensitométrie. Un programmeur devrait écrire des protocoles étape par étape pour d'innombrables scénarios potentiels.

Au lieu de cela, un modèle d'apprentissage automatique se forme. Un programmeur humain fournit des données pertinentes – texte, chiffres, photos, transactions, images médicales – et permet au modèle de trouver des modèles ou de faire des prédictions par elle-même.

Tout au long du processus, un humain peut modifier les paramètres pour obtenir des résultats plus précis sans savoir comment le modèle utilise l'entrée de données pour fournir la sortie.

L'apprentissage automatique est à forte intensité d'énergie et très cher. Pour maximiser les bénéfices, l'industrie forme des modèles sur des ensembles de données plus petits avant de les étendre à des scénarios du monde réel avec des volumes de données beaucoup plus importants.

« Nous voulons être en mesure de prédire à quel point le modèle sera meilleur à grande échelle. Si vous doublez la taille du modèle ou le double de la taille de l'ensemble de données, le modèle devient-il deux fois mieux? Quatre fois mieux? » dit Zhang.

La boîte à outils d'un physicien

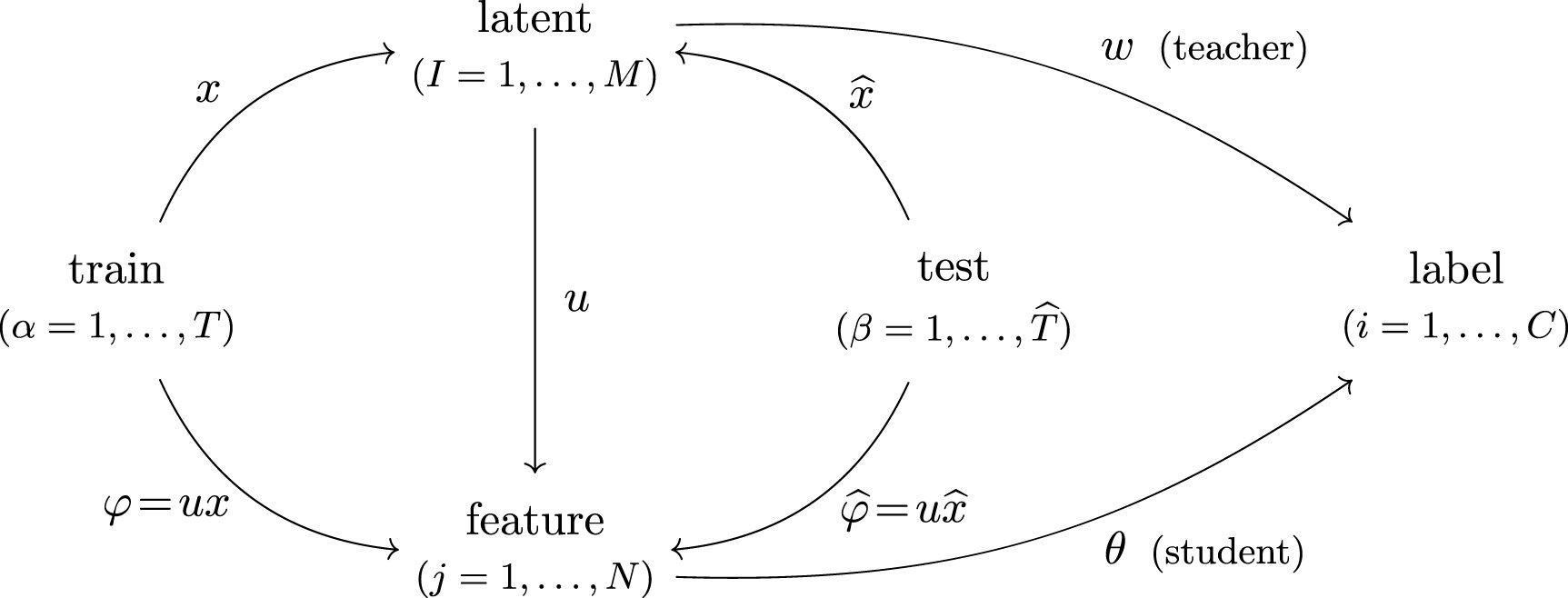

Un modèle d'apprentissage automatique semble simple: données d'entrée -> Boîte noire de calcul—> sortie qui est fonction de l'entrée.

La boîte noire contient un réseau neuronal, qui est une suite d'opérations simples connectées dans un Web pour approximer des fonctions compliquées. Pour optimiser les performances du réseau, les programmeurs ont conventionnellement compté sur des essais et des erreurs, affiner et reconstituer le réseau et accumuler les coûts.

« En tant que physicien, je voudrais mieux comprendre ce qui se passe vraiment pour éviter de compter sur des essais et des erreurs », a déclaré Zhang. « Quelles sont les propriétés d'un modèle d'apprentissage automatique qui lui donne la capacité d'apprendre à faire des choses que nous voulions qu'elle fasse? »

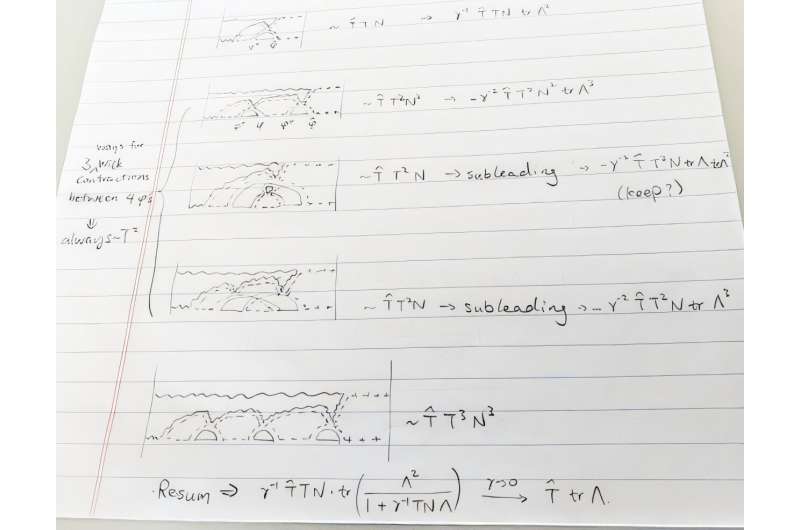

Dans un nouvel article publié dans la revue Apprentissage automatique: science et technologieZhang a résolu les lois de mise à l'échelle d'un modèle proposé, qui décrivent comment le système fonctionnera à des échelles de plus en plus grandes. Ce n'est pas facile – les calculs nécessitent de s'ajouter à un nombre infini de termes.

Zhang a appliqué une méthode que les physiciens utilisent pour suivre des centaines de milliers de termes, appelés diagrammes Feynman. Richard Feynman a inventé la technique dans les années 40 pour faire face à des calculs désespérément compliqués des particules élémentaires dans le domaine quantique. Au lieu d'écrire des équations algébriques, Feynman a dessiné des diagrammes simples – chaque ligne et sommet dans le diagramme représente une valeur.

« Il est tellement plus facile pour notre cerveau de saisir, et aussi plus facile de garder une trace du type de termes entre dans votre calcul », a déclaré Zhang.

Zhang a utilisé des diagrammes Feynman pour résoudre un modèle posé dans des recherches publiées à partir de 2022. Dans cet article, les physiciens ont étudié leur modèle dans une limite particulière. Zhang a pu résoudre le modèle au-delà de cette limite, obtenant des lois de mise à l'échelle nouvelles et plus précises qui régissent son comportement.

Alors que la société se met en tête la première dans l'IA, de nombreux chercheurs travaillent pour s'assurer que les outils sont utilisés en toute sécurité. Zhang estime que les physiciens peuvent rejoindre les ingénieurs, les informaticiens et d'autres qui travaillent à utiliser l'IA de manière responsable.

« Nous, les humains, construisons des machines qui nous contrôlent déjà – des algorithmes Youtube qui recommandent des vidéos qui sucent chaque personne dans leurs propres coins et influencent notre comportement », a déclaré Zhang. « C'est le danger de la façon dont l'IA va changer l'humanité – il ne s'agit pas de robots colonisant et asservissant les humains. C'est que nous, les humains, construisons des machines que nous avons du mal à comprendre, et nos vies sont déjà profondément influencées par ces machines. »