Adoption aux agents: ce qui est vraiment nécessaire

«2023 était l'année de l'expérimentation, mais en 2025, nous sommes entrés ce que j'appelle L'ère de l'écart de l'AI», Il a fait ses débuts comme celui-ci Marinela ProfiGlobal to the and Generative Market Strategy Market, dans son intervention « LLMS seul ne résout pas les problèmes commerciaux » au cours de la semaine 2025 de l'IA.

Profi décrit ainsi la phase historique actuelle dans laquelle nous vivons, réitérant qu'il est nécessaire de réfléchir à l'état réel de l'adoption de l'IA et des agents dans les entreprises: « D'une part, les gens adoptent le génératif avec l'enthousiasme croissant; d'autre part, les entreprises sont bloquées entre les promesses et la réalité difficile de l'adoption ».

L'utilisation individuelle est en pleine expansion: à partir des activités quotidiennes sur la façon d'écrire un texte ou de faire des recherches, nous sommes allés à des utilisations les plus profondes, telles que le soutien psychologique et la définition des objectifs personnels. Cependant, « le saut vers une adoption efficace de l'IA générative dans les entreprises est beaucoup plus complexe », prévient.

Parce que LLM seul ne suffit pas et il est nécessaire de se concentrer sur l'adoption des agents de l'IA

Un nœud crucial dansadoption des agents est le malentendu du rôle de Modèles de grande langue. « Nous ne pouvons pas nous attendre à un LLM pour résoudre un problème commercial seul », a déclaré Profi. Un LLM peut écrire un e-mail, mais il ne peut pas savoir lors de l'envoi s'il n'a pas accès à votre calendrier. C'est à partir d'ici que l'IA Agentica est née, qui fournit des assistants actifs qui commencent à utiliser des outils d'application pour prendre des décisions et agir, apprendre de l'environnement et s'adapter « .

LE'À l'agent Ce n'est pas un LLM avec une interface plus avancée, mais un système complexe qui intègre différents composants: modèles déterministes, règles d'entreprise, outils de supervision, couche de mémoire et interaction humaine.

Selon les estimations, plus de 70 milliards de dollars seront investis d'ici 2030 dans le développement et l'adoption de l'agent d'IA, confirmant un intérêt croissant au niveau mondial. Cependant, l'enthousiasme actuel risque de se concentrer sur les cas d'utilisation liés à la productivité individuelle – comme la génération automatique de contenu – négligeant les priorités réelles de l'entreprise. Les entreprises n'ont pas besoin d'agents qui écrivent des textes, mais de systèmes intelligents capables de soutenir des processus critiques tels que l'analyse des demandes d'assurance, la détection de fraude ou d'aide aux équipes de science des données.

Trois leçons fondamentales pour l'adoption à l'agent dans l'entreprise

Pendant l'intervention, Profi a distillé Trois leçons fondamentales a émergé des années d'expérience sur le terrain en SAS:

1. Décisions expliquées au-delà de LLM

L'utilisation de LLM dans des scénarios d'entreprise complexes présente des risques liés aux « hallucinations » du modèle. « Il n'est pas acceptable qu'un agent prenne une décision sur un diagnostic clinique ou une autorisation pour un prêt sans explicabilité ni validation – il a réitéré. Dans ces cas, en examinant les agents d'intelligence artificielle, la nécessité d'aller à LLM émerge: un mélange de modèles linguistiques et déterministes est nécessaire, avec des systèmes de contrôle et d'audit ».

Et le gestionnaire de SAS l'a souligné en apportant quelques exemples: la réflexion par exemple des applications critiques, telles que le traitement des demandes de rémunération et de la détection de fraude, la marge d'erreur ne peut pas être acceptée. C'est pourquoi il est approprié de se rappeler qu'avec des agents d'intelligence artificielle et de grands modèles linguistiques, nous introduisons pour la première fois un composant probabiliste dans un processus qui a été entièrement déterminé à ce jour. En pratique, les grands modèles linguistiques ne parviennent toujours pas à soutenir le plein soutien aux décisions de l'entreprise pour lesquelles aucun niveau d'erreur ne peut être accepté

2. L'autonomie ne suffit pas

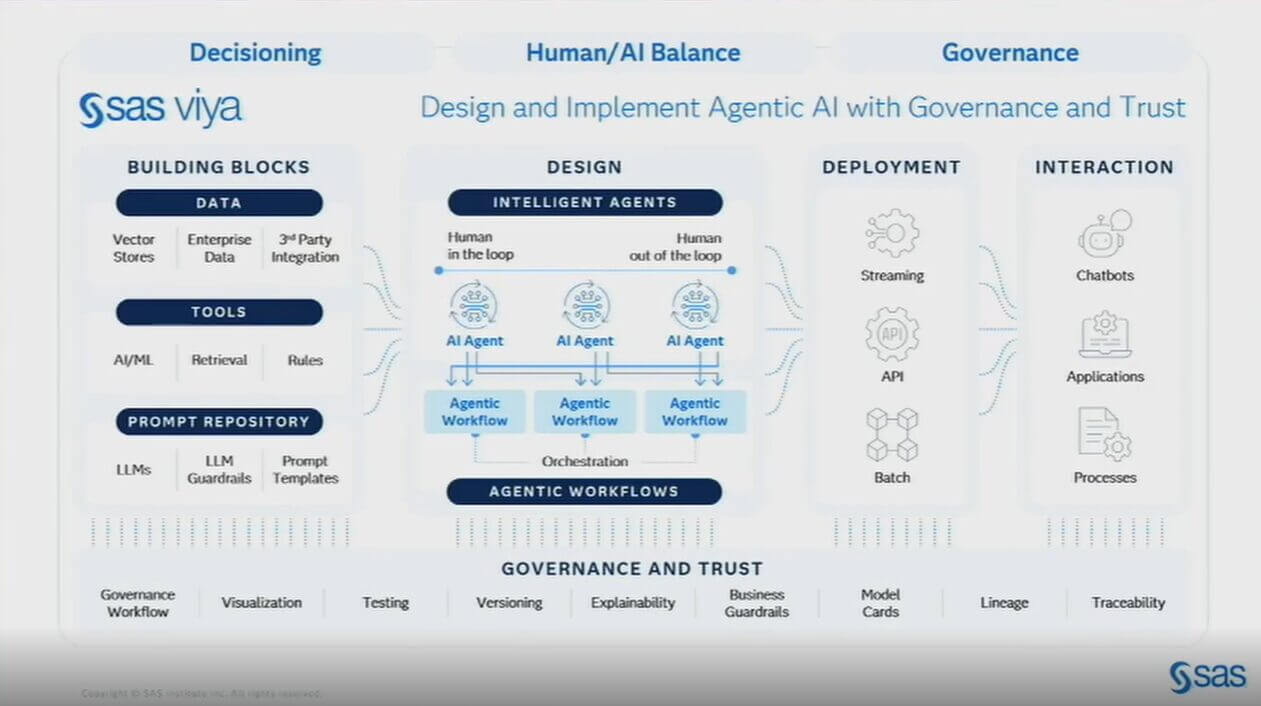

Profi a mis en garde contre une vision naïve des agents en tant qu'entités autonomes et magiques. «Dans les entreprises, l'autonomie doit être accompagnée de gouvernance, vérification De pourquoi une chose a été faite d'une certaine manière e supervision humaine. Des éléments tels que l'atténuation des risques et le contrôle sont nécessaires pour s'assurer que l'agent opère conformément aux réglementations et aux responsabilités éthiques. Il s'agit d'une combinaison de trois éléments: la capacité de prendre des décisions précises, l'équilibre entre l'homme et l'IA et la gouvernance, en fait ».

À l'appui de son analyse, il a ensuite partagé un cas concret développé par SAS pour une importante institution bancaire américaine. L'agent pour le réalisé pour l'évaluation du Notation du crédit Il intègre toutes les composantes fondamentales d'un système de qualité d'entreprise: grands modèles linguistiques, règles commerciales personnalisées, rambarde entreprise, mécanismes de escalade Vers les opérateurs humains et les outils d'explication des décisions.

Parmi ceux-ci, une forme de Explicabilité Visual, conçu pour retracer tout passage du processus de prise de décision et identifier toutes les erreurs ou biais. À l'appui de la gouvernance, on est utilisé Carte modèle qui permet la surveillance continue des performances du modèle utilisé par l'agent.

« Lorsque nous parlons des agents AI pour les entreprises – Profi a souligné – nous ne pouvons pas nous limiter à la pensée en termes de tâche, d'un objectif, d'un LLM et d'une action. Nous avons besoin d'une structure articulée et contrôlable, capable de s'adapter au contexte de l'entreprise et à garantir la fiabilité et la transparence ».

3. La qualité des données est le fondement des agents

«La vérité est que tous les problèmes que nous avons eu avec les données il y a 10 ans, nous les avons encore aujourd'hui – et maintenant ils sont amplifiés – a-t-il expliqué. Avec l'adoption des agents de l'IA, la qualité des données textuelles est devenue un défi stratégique ». Profi a présenté un cas d'utilisation d'une agence gouvernementale américaine: en optimisant les données textuelles de l'ALM, ils sont passés de 6 000 à 600 heures de travail sur un projet: « Voici l'importance d'appliquer et de donner la priorité à la qualité des données en ce qui concerne les grands modèles linguistiques ».