Une nouvelle méthode réduit considérablement la consommation d’énergie de l’IA

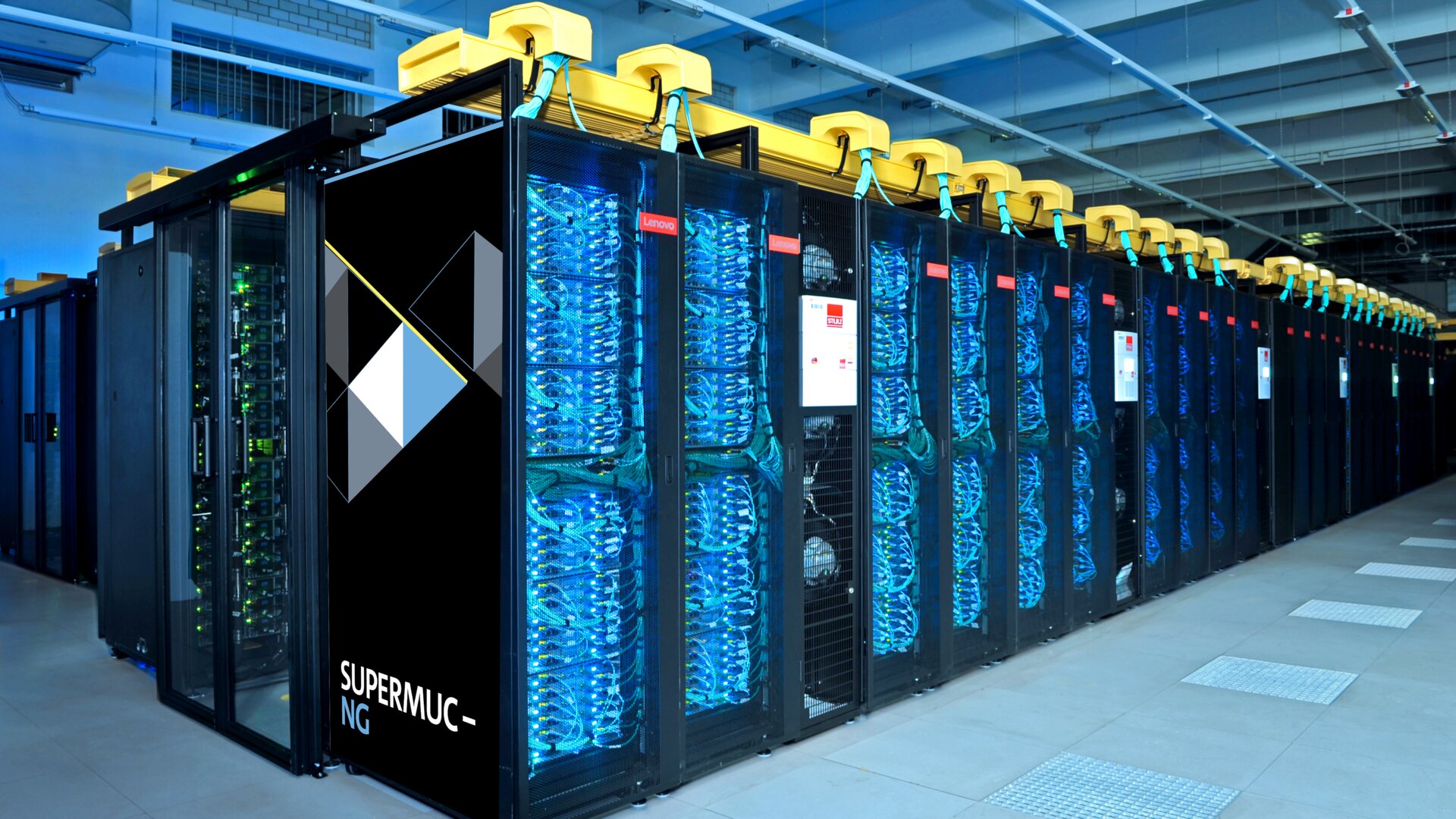

Les applications d’IA telles que les modèles de grandes langues (LLM) sont devenues une partie intégrante de notre vie quotidienne. Les capacités de calcul, de stockage et de transmission requises sont fournies par des centres de données qui consomment de grandes quantités d’énergie. Rien qu’en Allemagne, cela s’élevait à environ 16 milliards de kWh en 2020, soit environ 1% de la consommation totale d’énergie du pays. Pour 2025, ce chiffre devrait passer à 22 milliards de kWh.

L’arrivée des applications d’IA plus complexes dans les années à venir augmentera considérablement les demandes de capacité du centre de données. Ces applications utiliseront d’énormes quantités d’énergie pour la formation des réseaux de neurones. Pour contrer cette tendance, les chercheurs de l’Université technique de Munich (TUM) ont développé une méthode de formation qui est 100 fois plus rapide tout en atteignant une précision comparable aux procédures existantes. Cela réduira considérablement la consommation d’énergie pour la formation.

Ils ont présenté leurs recherches lors de la conférence des systèmes de traitement des informations neurales (UNIPS 2024), tenue à Vancouver du 10 au 15 décembre.

Le fonctionnement des réseaux de neurones, qui sont utilisés dans l’IA pour des tâches telles que la reconnaissance d’image ou le traitement du langage, s’inspire du fonctionnement du cerveau humain. Ces réseaux sont constitués de nœuds interconnectés appelés neurones artificiels. Les signaux d’entrée sont pondérés avec certains paramètres, puis résument. Si un seuil défini est dépassé, le signal est transmis au nœud suivant.

Pour former le réseau, la sélection initiale des valeurs de paramètres est généralement randomisée, par exemple, en utilisant une distribution normale. Les valeurs sont ensuite ajustées progressivement pour améliorer progressivement les prévisions de réseau. En raison des nombreuses itérations requises, cette formation est extrêmement exigeante et consomme beaucoup d’électricité.

Paramètres sélectionnés selon les probabilités

Felix Dietrich, professeur d’apprentissage automatique amélioré en physique, et son équipe ont développé une nouvelle méthode. Au lieu de déterminer itérativement les paramètres entre les nœuds, leur approche utilise des probabilités. Leur méthode probabiliste est basée sur l’utilisation ciblée des valeurs à des emplacements critiques dans les données d’entraînement où des changements importants et rapides des valeurs ont lieu.

L’objectif de la présente étude est d’utiliser cette approche pour acquérir des systèmes dynamiques de conservation de l’énergie à partir des données. Ces systèmes changent au fil du temps conformément à certaines règles et se trouvent dans les modèles climatiques et sur les marchés financiers, par exemple.

« Notre méthode permet de déterminer les paramètres requis avec une puissance de calcul minimale. Cela peut rendre la formation des réseaux de neurones beaucoup plus rapidement et, par conséquent, plus économe en énergie », explique Dietrich. « De plus, nous avons vu que la précision de la nouvelle méthode est comparable à celle des réseaux formés de manière itérative. »