Simulation des attaques de Wolf Pack pour renforcer la collaboration et la résilience de l'IA

Dans les domaines qui avancent rapidement des essaims de drones et de la robotique coopérative, les agents de l'IA intégrés dans des drones et des robots individuels doivent collaborer de manière transparente – tels que les drones volant en formation pour encercler un ennemi ou plusieurs robots travaillant ensemble dans des usines intelligentes. Cependant, ces systèmes multi-agents sont vulnérables aux perturbations causées par des conditions défavorables ou des attaques malveillantes, ce qui peut compromettre leur coopération et leur intégrité opérationnelle.

Relèvement de ce défi, une équipe de recherche dirigée par le professeur Seungyul Han de la Ftegure d'Unit de l'intelligence artificielle a développé un nouveau cadre d'attaque contradictoire inspiré par les stratégies de chasse des packs de loups, ainsi qu'une méthode de formation de défense correspondante.

Ces innovations visent à évaluer et à renforcer la robustesse des systèmes d'apprentissage par renforcement multi-agents (MARL) contre les perturbations coordonnées. Ils ont présenté leurs recherches le 15 juillet lors de la Conférence internationale sur l'apprentissage automatique (ICML 2025), qui s'est tenue à Vancouver. Le papier est disponible sur le arxiv serveur de préimprimée.

L'apprentissage par renforcement permet aux agents de l'IA d'apprendre des comportements optimaux par des essais et des erreurs dans divers scénarios. Dans des contextes multi-agents, la collaboration entre les agents garantit généralement la résilience du système; Si un agent rencontre des problèmes, d'autres compensent pour maintenir les performances globales.

Cependant, les stratégies d'attaque existantes qui ciblent les agents individuels ne sont souvent pas en mesure de dénoncer les vulnérabilités au sein de ces structures coopératives, en particulier dans des conditions réalistes telles que les défaillances des capteurs, les troubles météorologiques ou les cyberattaques.

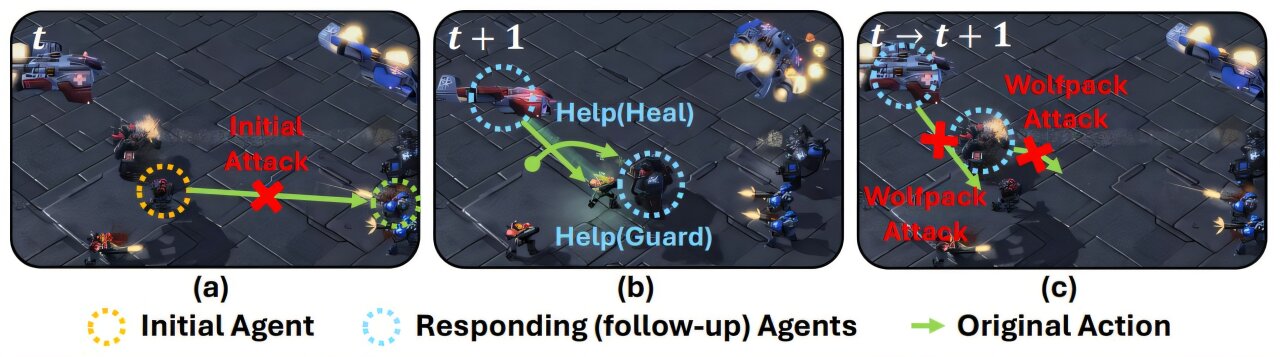

L'attaque de Wolf Pack proposée simule une assaut stratégique où un agent initial est délibérément compromis, déclenchant une défaillance en cascade parmi les agents d'assistance – mirroctant un pack de loups isolant et des proies accablantes. Cette attaque tire parti des modèles prédictifs avancés pour déterminer le moment optimal pour initier la perturbation et pour compromettre séquentiellement les agents sensibles aux indices coopératifs.

Complétant cela, les chercheurs ont développé le cadre du mur (Wolfpack-Adversarial Learning), qui intègre ces scénarios contradictoires dans le processus de formation. En exposant les systèmes d'IA aux attaques de packs de loups simulées, Wall améliore leur capacité à résister aux perturbations réelles, assurant un comportement coopératif plus stable et fiable.

Les résultats expérimentaux démontrent que les agents de l'IA formés avec la paroi présentent une résilience remarquable, le maintien de la coordination et des performances des tâches, même dans des conditions difficiles telles que les retards de communication et les inexactitudes des capteurs. Cette progression fournit non seulement un outil puissant pour évaluer la robustesse des systèmes multi-agents, mais ouvre également la voie à déployer des drones autonomes plus résilients, des essaims robotiques et des solutions d'automatisation industrielle.

Le professeur Han a déclaré: « Notre approche offre une nouvelle perspective sur l'évaluation et la fortification des capacités coopératives des agents de l'IA.