Sam Altman déclare que la consommation d'eau et d'énergie de Chatgpt est minuscule. Le problème est qu'il n'en témoigne pas

Un e-mail de 100 mots généré par GPT-4 consomme 519 millilitres d'eau. C'était la conclusion à laquelle les chercheurs de l'Université de Californie sont arrivés il y a quelques mois après avoir analysé ce modèle OpenAI. Sam Altman, PDG de la société, vient de donner sa propre estimation sur la consommation d'eau et d'énergie de chaque consultation de Chatgpt. Et c'est très différent.

1 000 fois moins que ce qui a été dit. Selon Altman, une consultation moyenne dans Chatgpt consomme beaucoup moins que ce qui avait été indiqué dans les études précédentes. Leurs données sont frappantes et les comprendre fait des analogies intéressantes:

«Comme la production automatisée dans les centres de données automatise, le coût de l'intelligence devrait aborder l'électricité. (Les gens sont généralement curieux de savoir combien d'énergie consomme une consultation Chatgpt; la consultation moyenne (0,32 ml);

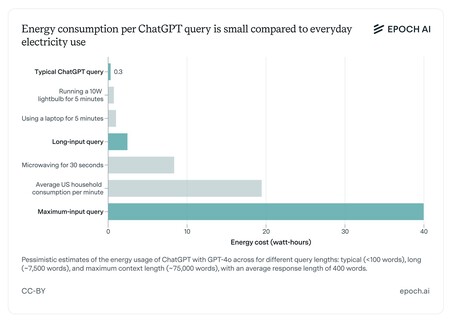

Une étude précédente de l'époque AI corrobore les données que Sam Altman a maintenant exercées. Source: Epoch Ai.

Et les tests? Les chiffres mentionnés par le PDG d'OpenAI ont un problème: ils n'ont aucun soutien visible. Il les jette sans citer des sources ni expliquer où il les a retirés, quelque chose qui rend difficile la croire. Un dirigeant de Meta a répondu à la question de savoir combien l'inférence consomme de l'IA des années et demie pour répondre à ce que « seuls deux réacteurs nucléaires seraient nécessaires pour le couvrir ».

Mais les études précédentes coïncident avec Altman. Bien qu'il ne mentionne aucune preuve, en février, les chercheurs de l'époque AI ont été précisément publiés une étude essayant d'estimer la consommation d'énergie de Chatgpt. Dans leurs conclusions, ils ont indiqué qu'en moyenne, une consultation de chatppt avec GPT-4O ne consomme que 0,3 Watts-Hora, « dix fois moins que l'ancienne estimation », qui provient d'un rapport précédent du chercheur Alex de Vries. Depuis lors, bien sûr, beaucoup de choses se sont produites.

Trop pessimiste. Et comme ils ont commenté l'étude de l'époque AI, la différence vient du fait que les modèles sont aujourd'hui beaucoup plus efficaces qu'en 2023, lorsque VRIES a mené leur étude. Il en va de même du matériel dans lequel ces modèles sont exécutés, et cette estimation a également été utilisée une approche « particulièrement pessimiste ». Dans l'étude d'Openai, ils ont également lancé une estimation particulièrement pessimiste et ont souligné que « la plupart des demandes (un chatppt) sont beaucoup moins chères (énergiquement) ».

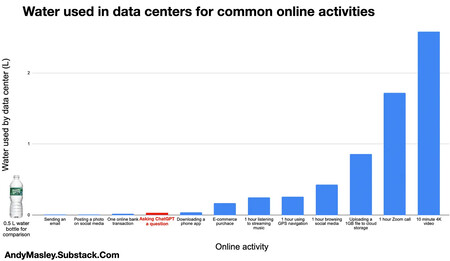

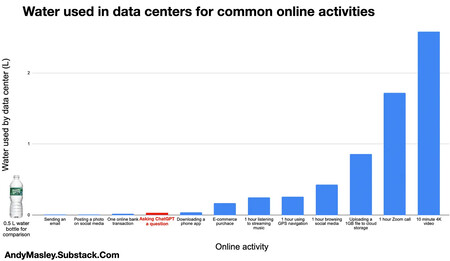

Plus d'études. Une autre étude indépendante publiée par Andy Masey en janvier 2025 est parvenue à une conclusion similaire et a affirmé que « l'utilisation de Chatgpt n'est pas mauvaise pour l'environnement ». Il était basé sur des données de l'EPRI de mai 2024 qui ont également estimé une consommation élevée de 2,9 wh par la consultation de Chatgpt. La consommation d'eau estimée dans les centres de données, à partir d'une étude Sunbird, était également très modeste par rapport à d'autres activités en ligne.

Consommation d'eau dans les centres de données pour diverses activités en ligne. Source: Andy Masley.

Quinze. Précisément, les données de la consommation d'eau ont été une autre frappe dans cette estimation de Sam Altman. Selon lui, une consultation de Chatgpt a à peine consommé 0,32 ml d'eau, « une partie quincaleva d'une cuillère à café ». Le chiffre suggère que l'eau nécessaire pour réfrigérer les centres de données qui traitent ces demandes sont beaucoup moins que ce qui était pensé il y a seulement un an.

Et la formation, quoi? Ces estimations se concentrent sur la section d'inférence de l'IA, c'est-à-dire notre utilisation de Chatgpt qui reçoit une consultation et traite qu'il déduisait (générant) un résultat de texte. Bien qu'Altman ne le clarifie pas, il ne semble pas inclure ici le coût de l'énergie et de l'eau de la formation des modèles d'IA, ce qui est très élevé et fait fonctionner des milliers de GPU à pleine puissance pendant des mois, avec la dépense en eau qui en résulte dans les centres de données pour réfrigérer tous ces composants qui dissipent les quantités de chaleur élevées. Comme l'a souligné le chercheur Ethan Mollick, GPT-4 a probablement utilisé plus de 50 GW pour être formé, suffisamment pour donner de l'énergie à 5 500 maisons en un an.

Nous continuons sans données définitives. Les affirmations d'Altman sont comme toujours frappantes, mais le manque de preuves claires rend difficile de croire ces données. D'autres études récentes sont plus utiles lorsqu'il s'agit de refléter ce coût de plus en plus inférieur à l'énergie et à l'eau de l'utilisation de l'IA, mais il n'y a pas de normes acceptées ou de consensus sur le véritable impact de l'énergie et de la consommation d'eau lors de l'utilisation de ChatGpt ou d'autres modèles d'IA.

Image | Lukáš Lehotský | Village Global

Dans Simseo | Le prix d'éclairage est à nouveau négatif: c'est un signe que le système a besoin d'une refonte