Principes de conception pour des artistes IA plus fiables et dignes de confiance

Lorsque les utilisateurs demandent à ChatGPT de générer une image dans un style Ghibli, l'image réelle est créée par DALL-E, un outil alimenté par des modèles de diffusion. Bien que ces modèles produisent des images époustouflantes, comme la transformation de photos en styles artistiques, la création de personnages personnalisés ou le rendu de paysages réalistes, ils sont également confrontés à certaines limites. Il s'agit notamment d'erreurs occasionnelles, comme des mains à trois doigts ou des visages déformés, et de difficultés liées à l'exécution sur des appareils dotés de ressources informatiques limitées, comme les smartphones, en raison de leur grand nombre de paramètres.

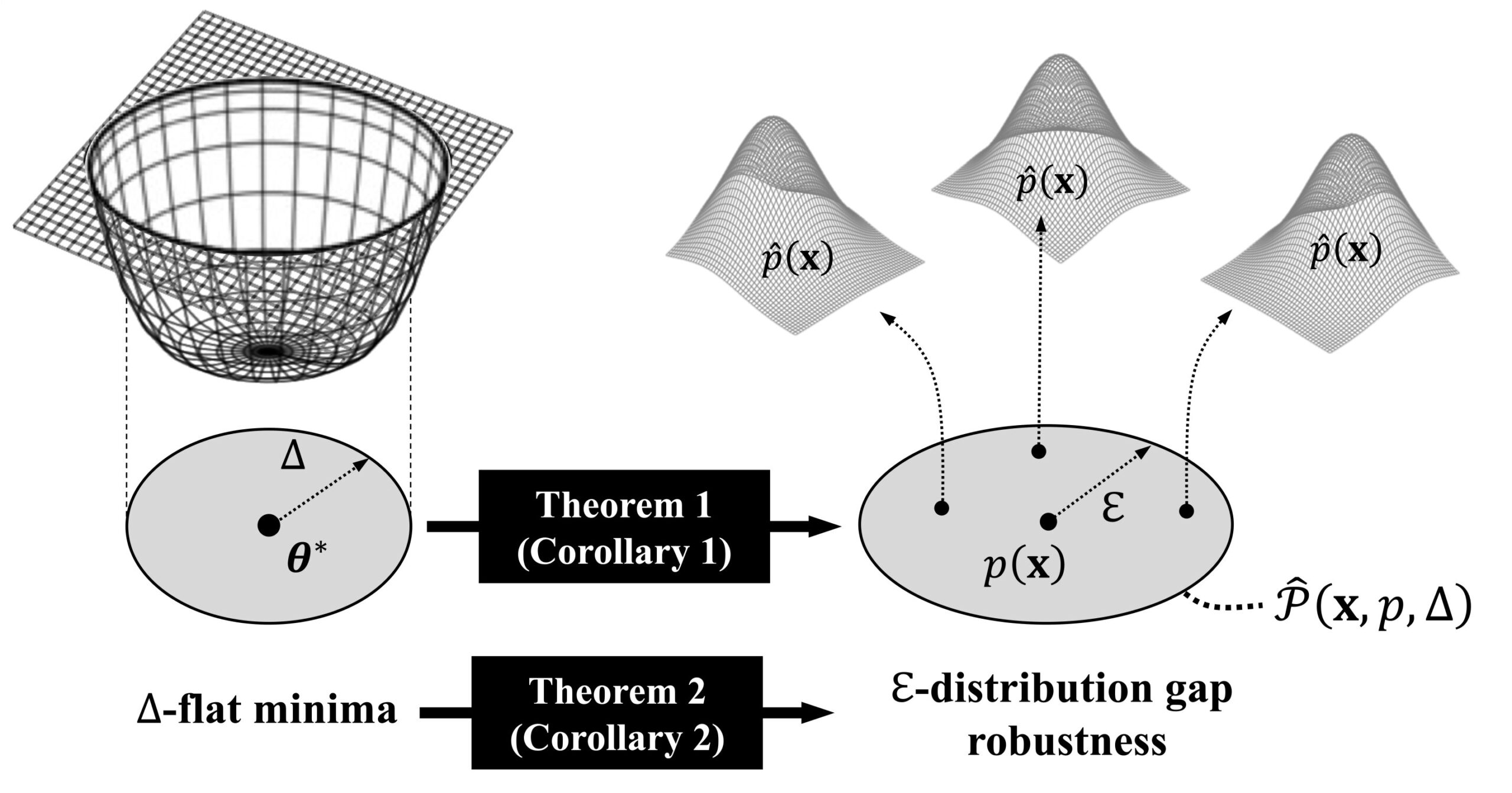

Une équipe de recherche, dirigée conjointement par les professeurs Jaejun Yoo et Sung Whan Yoon de l'École supérieure d'intelligence artificielle de l'UNIST, a proposé un nouveau principe de conception pour l'IA générative qui répond à ces problèmes. Ils ont montré, grâce à une analyse théorique et à des expériences approfondies, que la formation de modèles de diffusion pour atteindre des « minima plats » – un type spécifique de point optimal sur la surface de perte – peut simultanément améliorer à la fois la robustesse et la capacité de généralisation de ces modèles.

Leur étude a été présentée à la Conférence internationale sur la vision par ordinateur (ICCV 2025) et les résultats sont publiés sur le arXiv serveur de préimpression.

Les modèles de diffusion sont largement utilisés dans les applications d'IA populaires, notamment des outils tels que DALL-E et Stable Diffusion, permettant une gamme de tâches allant du transfert de style et de la création de dessins animés au rendu de scène réaliste. Cependant, le déploiement de ces modèles entraîne souvent des défis, tels que l'accumulation d'erreurs au cours de cycles de génération courts, la dégradation des performances après des techniques de compression de modèle telles que la quantification et la vulnérabilité aux attaques contradictoires (petites perturbations d'entrée malveillantes conçues pour tromper les modèles).

L'équipe de recherche a identifié que ces problèmes proviennent de limitations fondamentales dans la capacité des modèles à généraliser, c'est-à-dire leur capacité à fonctionner de manière fiable sur des données nouvelles et invisibles ou dans des environnements inconnus.

Pour résoudre ce problème, l'équipe de recherche a proposé d'orienter le processus de formation vers des « minima plats » : des régions du paysage des pertes du modèle caractérisées par des surfaces larges et douces. De tels minimums aident le modèle à maintenir des performances stables et fiables malgré de petites perturbations ou bruits. À l’inverse, les « minima abrupts » (vallées étroites et abruptes) ont tendance à entraîner une détérioration des performances face à des variations ou à des attaques.

Parmi les différents algorithmes conçus pour trouver des minima plats, l’équipe a identifié la minimisation sensible à la netteté (SAM) comme étant la plus efficace. Les modèles entraînés avec SAM ont démontré une accumulation réduite d'erreurs lors des tâches de génération rapide, ont maintenu des résultats de meilleure qualité après compression et ont présenté une résistance sept fois supérieure aux attaques adverses, renforçant considérablement leur robustesse.

Alors que des recherches antérieures abordaient séparément des problèmes tels que l’accumulation d’erreurs, les erreurs de quantification et les vulnérabilités contradictoires, cette étude montre que se concentrer sur les minimums plats offre une solution unifiée et fondamentale à tous ces défis.

Les chercheurs soulignent que leurs résultats vont au-delà de la simple amélioration de la qualité des images. Ils fournissent un cadre fondamental pour concevoir des systèmes d’IA générative fiables et polyvalents qui peuvent être appliqués efficacement dans diverses industries et scénarios du monde réel. De plus, cette approche pourrait ouvrir la voie à une formation plus efficace de modèles à grande échelle tels que ChatGPT, même avec des données limitées.