OpenAI leur a promis très heureux en tant que nouvelle IA de l'armée. Jusqu'à ce que des milliers d'utilisateurs commencent à désinstaller ChatGPT

Samedi dernier, il y a eu 295 % de désinstallations supplémentaires de l'application mobile ChatGPT aux États-Unis. De nombreux utilisateurs se sont sentis très mal qu'OpenAI ait conclu un accord théoriquement contraire à l'éthique avec le Département américain de la Défense pour remplacer Anthropic, et ils l'ont puni avec un mouvement « Cancel ChatGPT » sur les réseaux sociaux qui a également eu un impact sur ces désinstallations.

Que s'est-il passé ? Le cabinet de conseil Sensor Tower, qui surveille l'état des magasins d'applications mobiles, a indiqué que le taux de désinstallation de ChatGPT a augmenté de 295% samedi 28 février par rapport à la veille. Normalement, le taux de désinstallation est d'environ 9% d'un jour à l'autre, mais ce jour-là, il était clair que de nombreux utilisateurs ont décidé de se débarrasser de l'application en même temps. La raison est évidente.

Le Pentagone contre Anthropic. Le Pentagone travaillait depuis des mois avec Claude, l'IA d'Anthropic, déjà utilisée dans des documents classifiés. Anthropic avait posé comme condition de ne pas utiliser son IA à des fins d'espionnage de masse et de développement d'armes autonomes, mais le ministère de la Défense (DoD, que beaucoup appellent désormais le « Département de la guerre ») voulait qu'Anthropic supprime ces limitations. Anthropic a refusé, et c'est là qu'intervient OpenAI.

Et opportuniste. Sam Altman a d'abord salué la position d'Anthropic. Quelques heures plus tard, il a annoncé avoir conclu un accord avec le DoD pour remplacer Claude par ChatGPT. Cela a été largement critiqué pour le manque d'éthique et l'attitude opportuniste d'OpenAI, et a conduit à un mouvement « d'annulation de ChatGPT » qui a eu un impact immédiat sur les téléchargements et les désinstallations de ce chatbot.

Altman veut remettre les pendules à l’heure. L'annonce d'OpenAI n'était pas claire quant à savoir si OpenAI imposait réellement les mêmes limites qu'Anthropic, mais Altman a rapidement annoncé qu'il avait ajouté des amendements à l'accord pour éviter toute confusion. Des protections ont apparemment été ajoutées à la surveillance de masse, mais il n’y a aucune mention du développement d’armes létales autonomes.

Punition pour OpenAI. Non seulement elle a été sensiblement désinstallée, mais selon les avis de l'application ChatGPT, de nombreux utilisateurs ont attribué une seule étoile sur cinq dans une proportion très élevée : ces mauvais avis ont augmenté de 775 % samedi puis de 100 % dimanche selon Sensor Tower. Les avis cinq étoiles ont chuté de 50 %.

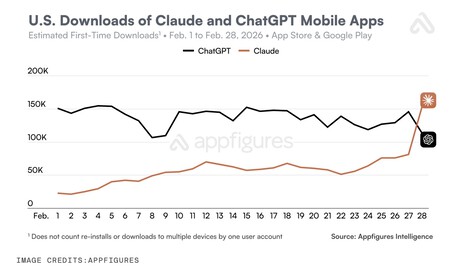

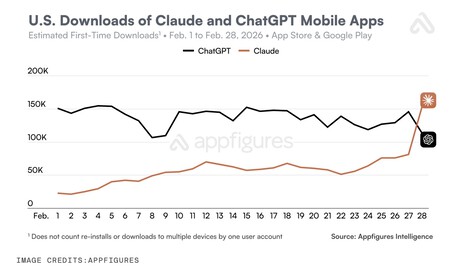

Claude a dépassé ChatGPT en termes de téléchargements suite aux derniers événements avec le Pentagone. Source : Appfigures.

Et Claude le surpasse déjà en téléchargements. Un autre cabinet de conseil qui surveille le marché du téléchargement, Appfigures, a indiqué que samedi, les téléchargements de Claude ont dépassé pour la première fois ceux de ChatGPT aux États-Unis. En fait, Claude est devenue l'application la plus téléchargée dans au moins six pays en dehors des États-Unis : Belgique, Canada, Allemagne, Luxembourg, Norvège et Suisse.

Effet Streisand. Nous sommes confrontés à un autre cas d’effet Streisand : tenter de censurer certaines informations ou certaines entreprises finit par s’avérer contre-productif. Le Pentagone a tenté de faire d'Anthropic le méchant, mais ce qui s'est passé, c'est que l'entreprise est désormais considérée comme le grand défenseur de l'éthique et de « l'alignement sur l'IA ». Cela a amené les gens à le percevoir comme une option moralement plus respectable que ChatGPT.

Mais Anthropic a des problèmes. Selon Reuters, divers départements et agences du gouvernement américain sont passés à OpenAI et ont commencé à cesser d'utiliser les modèles Anthropic pour leur travail. C'est déjà un problème pour Anthropic, mais le fait que son récent cycle d'investissement, au cours duquel ils ont levé 60 milliards de dollars, pourrait être en danger est encore plus problématique. Si le DoD décide de qualifier Anthropic de « risque de chaîne d'approvisionnement », ses contrats et accords avec des dizaines d'entreprises seraient menacés, ainsi que son propre avenir en tant qu'entreprise. Il s’agirait d’une mesure extraordinaire et il semble peu probable que les États-Unis en arrivent à ce point, mais rien n’est sûr aujourd’hui.

Images | Village Mondial

À Simseo | La guerre entre Anthropic et le Pentagone laisse présager quelque chose de terrifiant : un nouveau « Moment Oppenheimer »