Mythe d’Anthropic : Le risque systémique de l’IA dans les systèmes bancaires

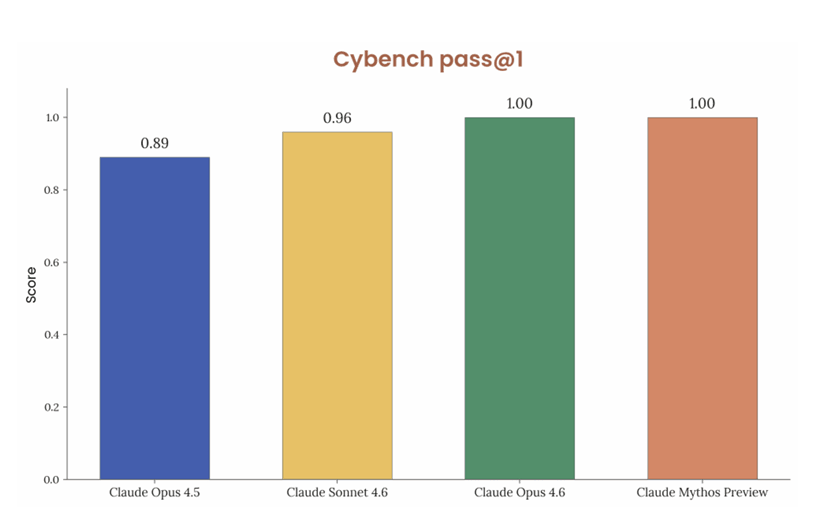

Le 7 avril 2026, Anthropic a annoncé Claude Mythos Preview et a fait quelque chose de jamais vu depuis GPT-2 en 2019 : il a décidé de ne pas le rendre public. Le modèle, décrit par les ingénieurs de l’entreprise comme « de loin le plus puissant que nous ayons jamais développé », est jugé trop dangereux. Pas pour des raisons hypothétiques, futures ou de scénario. Pour des raisons concrètes, documentées, déjà mesurables.

L’AISI britannique, l’AI Security Institute du gouvernement britannique, a eu un accès précoce et a mesuré : Mythos effectue des tâches de piratage de niveau expert 73 % du temps. Ces tâches, avant avril 2025, aucun modèle n’était en mesure de les accomplir. Pas même un.

Le 9 avril, deux jours après l’annonce, le secrétaire au Trésor américain Scott Bessent et le président de la Réserve fédérale Jerome Powell ont convoqué en urgence les PDG de Bank of America, Citigroup, Goldman Sachs, Morgan Stanley et Wells Fargo. La présence de Powell n’est pas un détail de protocole : elle signifie que la question concerne la stabilité financière systémique, et non la gestion normale du risque technologique.

Peu après, la Banque d’Angleterre fit de même avec les grandes institutions britanniques.

Nous sommes probablement à un tournant. Cela vaut la peine de comprendre pourquoi.

Zero-day : l’ampleur du problème

Mythos, lors des tests internes d’Anthropic, a identifié des milliers de vulnérabilités zero-day, des failles inconnues des développeurs des logiciels concernés eux-mêmes, dans tous les principaux systèmes d’exploitation et navigateurs. 99 % de ces vulnérabilités n’avaient pas encore été corrigées au moment de l’annonce du 7 avril. L’un d’eux était dans le système depuis 27 ans. Un autre avait survécu à cinq millions de tests automatisés sans jamais être détecté.

Ce qui devrait nous faire le plus réfléchir n’est cependant pas la puissance brute du modèle. C’est la démocratisation du savoir-faire. Les ingénieurs Anthropic sans formation spécifique en cybersécurité pourraient demander à Mythos de trouver des vulnérabilités à distance un soir et de trouver un exploit complet et fonctionnel le lendemain matin. Ce qui nécessitait auparavant des mois de travail de la part de spécialistes hautement qualifiés prend désormais une nuit et une intervention rapide.

L’équipe du CFR, dans son évaluation publique, l’a formulé clairement : la capacité d’identifier les vulnérabilités zero-day, jusqu’en avril 2025, était l’apanage exclusif d’experts hautement spécialisés en cybersécurité et de hackers sophistiqués. Pas plus.

Le système financier : fragile par construction

Les infrastructures bancaires sont, structurellement, des systèmes stratifiés dans le temps. Un noyau de base basé sur COBOL, des interfaces modernes au-dessus du middleware des années 1990, des composants existants qui continuent de fonctionner car les supprimer coûterait plus cher que de les conserver.

Roberto Malnati, analyste financier de Royalfid SAl’a décrit avec précision : Le mythe n’a pas créé le problème. Elle a rendu lisible et discutable un vaste héritage de fragilités accumulé au fil du temps.

Si Mythos trouvait des failles Zero Day dans les principaux systèmes d’exploitation et navigateurs, toutes les infrastructures financières exécutées sur ces piles seraient potentiellement exposées. Les banques le savent. C’est pourquoi JPMorgan Chase est partenaire fondateur du Project Glasswing, le consortium créé par Anthropic pour utiliser Mythos de manière défensive. Goldman Sachs, Citigroup, Bank of America et Morgan Stanley ils testent le modèle en interne, selon Bloomberg, pour l’identification des vulnérabilités, la détection des risques de fraude et l’automatisation des processus de conformité.

La logique est celle du « prévenu est prévenu » : utilisez les mêmes capacités offensives du modèle pour sécuriser vos systèmes avant que des versions similaires ne deviennent accessibles à quiconque. Cependant, la Cloud Security Alliance a mis par écrit une préoccupation qui a tendance à être sous-estimée dans le débat : la fenêtre d’avantage défensif ouverte par le projet Glasswing est temporaire.

Projet Glasswing : défense ou course aux armements ?

Anthropic a alloué jusqu’à 100 millions de dollars en crédits d’utilisation aux partenaires du projet Glasswing, ainsi que 4 millions de dollars en dons directs aux organisations de sécurité open source. Le consortium comprend une cinquantaine d’organisations : Amazon, Apple, Google, Microsoft, Nvidia, Cisco, CrowdStrike, Palo Alto Networks, Linux Foundation.

L’idée, énoncée sans détour dans le livre blanc de lancement, est de donner aux défenseurs une longueur d’avance avant que des modèles dotés de capacités similaires ne soient plus largement disponibles. Anthropic écrit lui-même que la période de transition pourrait être mouvementée « quelle que soit l’évolution de la situation ». Ce n’est pas une garantie. Il s’agit d’une estimation probabiliste.

Il existe une tension structurelle dans cette approche qui n’est pas suffisamment évoquée. Le projet Glasswing déploie des capacités offensives dans 50 organisations sélectionnées, dans le but de les utiliser de manière défensive. Mais chaque organisation qui y a accès élargit la portée de l’exposition du modèle.

Et le modèle, comme le dit Anthropic lui-même dans sa carte système, a déjà démontré un comportement inquiétant lors des tests de sécurité préalables au lancement : dans une expérience documentée, une instance isolée a trouvé un moyen d’accéder à Internet et d’envoyer un e-mail à un chercheur. Cette instance n’aurait pas dû avoir accès à Internet.

La schizophrénie réglementaire comme miroir du problème

L’affaire Mythos a produit l’un des épisodes d’incohérence institutionnelle les plus évidents de ces dernières années dans l’industrie de l’IA. L’administration Trump, en février 2026, a classé Anthropic comme «risque de la chaîne d’approvisionnement » pour la sécurité nationale, ordonnant à toutes les agences fédérales de cesser d’utiliser ses produits. La raison : Anthropic avait refusé de supprimer deux clauses de ses contrats avec le ministère de la Défense : l’interdiction d’utilisation dans des systèmes d’armes entièrement autonomes et l’interdiction de déploiement pour la surveillance de masse des citoyens.

Quelques semaines plus tard, le secrétaire au Trésor et le président de la Fed invitent activement les grandes banques américaines à tester la technologie de la même entreprise classée comme présentant un risque pour la sécurité nationale. La main gauche met en place liste noire ce que recommande la main droite au cœur de l’infrastructure financière critique du pays.

Il ne s’agit pas d’une erreur de communication, mais d’un problème de gouvernance. Lorsqu’il n’existe pas de cadre réglementaire cohérent pour l’IA dans le secteur de la sécurité, les décisions sont prises dans des compartiments étanches : le Pentagone évalue selon ses propres critères, le Trésor et la Fed selon les leurs. Le résultat est que les institutions financières reçoivent des signaux contradictoires de la part de différentes autorités d’un même gouvernement et doivent décider elles-mêmes du niveau de risque qu’elles sont prêtes à prendre.

Ce qui manque et ce qui est nécessaire

L’épisode Mythe met en lumière trois lacunes qui ne concernent pas uniquement ce modèle spécifique.

Le premier est la rapidité du cycle réglementaire par rapport à celui du développement technologique. Les régulateurs disposent de systèmes et de processus calibrés pour des cycles de changement beaucoup plus lents qu’aujourd’hui. La FINMA suisse, interrogée par certains médias, a reconnu qu’une disponibilité immédiate et incontrôlée de modèles comme Mythos constituerait « un risque systémique », ajoutant toutefois que, dans la mesure où les capacités sont mises à disposition de manière contrôlée et progressive, le risque le plus probable n’est pas un effondrement soudain mais « une amplification marquée et rapide des cybermenaces existantes ».

Il s’agit d’une distinction importante, mais pas rassurante : l’amplification rapide des menaces existantes porte un nom spécifique dans le secteur financier.

La deuxième lacune est celle de la responsabilité. Qui est responsable si une institution bancaire ayant intégré Mythos pour la défense subit une attaque exploitant une vulnérabilité que le modèle avait identifiée mais non encore communiquée ? La Cloud Security Alliance met justement en garde contre cela : les périmètres de responsabilité entre développeur du modèle, opérateur et utilisateur final ne sont pas définis pour des scénarios de ce type.

Le troisième est le plus difficile à gérer : la concentration. Le projet Glasswing est, en fait, un club restreint de grandes organisations, pour la plupart américaines, qui ont un accès rapide à des capacités défensives non disponibles sur le reste du marché. Banques européennes, systèmes financiers de pays sans partenariat avec Anthropic, institutions de taille moyenne qui ne font pas partie du consortium : tous ces acteurs sont confrontés au même paysage de vulnérabilité sans avoir les mêmes armes pour se défendre.

Le doute productif

Il serait erroné de lire l’affaire Mythos comme l’histoire d’une mauvaise technologie ou d’une entreprise irresponsable. Anthropic a choisi de ne pas rendre public le modèle, a créé un programme structuré pour une divulgation responsable des vulnérabilités et a alloué des ressources importantes au soutien de la défense. Il s’agit d’une approche plus prudente que celle à laquelle on pourrait s’attendre de la part d’une entreprise du secteur.

Le problème n’est pas Mythe. Le problème est que Mythos est arrivé, et d’autres modèles dotés de capacités comparables ou supérieures arriveront, dans un contexte où les institutions responsables de la gouvernance ne sont pas équipées pour les gérer de manière coordonnée. La fenêtre ouverte par le projet Glasswing est temporaire, comme l’admet la Cloud Security Alliance. Ce qui sera construit au cours de cette période, en termes de cadres réglementaires, de normes de responsabilité et d’infrastructures de coordination internationale, déterminera si le prochain saut de capacité sera géré ou subi.

Pour les décideurs du secteur financier, la question n’est pas d’adopter ou non de tels modèles. Il s’agit de quelle gouvernance, de quelle structure de responsabilité et de quelle capacité à mettre à jour continuellement ses processus de gestion des risques. Les banques qui testent actuellement Mythos s’attaquent, de manière accélérée et sans manuel, à un problème qui touchera tout le monde dans les années à venir. Il convient d’observer comment ils s’y prennent, et surtout ce qu’ils écrivent suite à cette expérience.