L'IA et les humains voient les objets différemment: le sens contre les caractéristiques visuelles

Alors que les humains se concentrent sur la signification des objets, l'intelligence artificielle se concentre sur les caractéristiques visuelles.

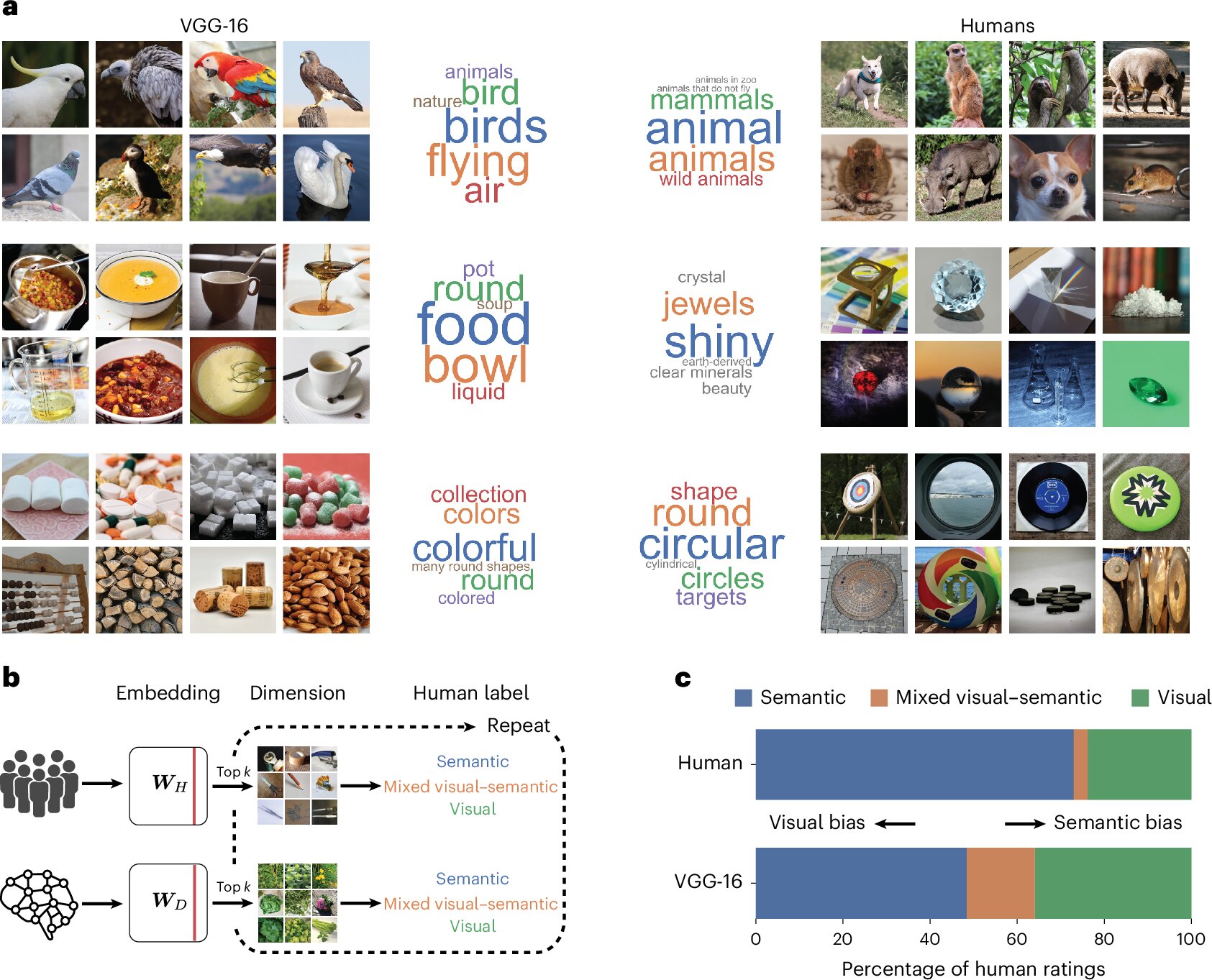

« Ces dimensions représentent diverses propriétés d'objets, allant d'aspects purement visuels, comme des propriétés« rondes »ou« blanches »à des dimensions plus sémantiques, comme des éléments« liés à l'animal »ou du feu», avec de nombreuses dimensions contenant à la fois des éléments visuels et sémantiques », explique Florian Mahner du Max Planck Institute pour les sciences cognitives et cérébrales humaines.

« Nos résultats ont révélé une différence importante: alors que les humains se concentrent principalement sur les dimensions liées au sens – ce qu'est un objet et ce que nous en savons – les modèles AI s'appuient davantage sur les dimensions capturant les propriétés visuelles, telles que la forme ou la couleur de l'objet. Nous appelons ce phénomène » biais visuel « en IA.

« Même lorsque l'IA semble reconnaître les objets comme le font les humains, il utilise souvent des stratégies fondamentalement différentes. Cette différence est importante car cela signifie que les systèmes d'IA, malgré le fait de se comporter de la même manière que les humains, pourraient penser et prendre des décisions de manière entièrement différentes, affectant à quel point nous pouvons leur faire confiance. »

Jugements pour les images

Pour le comportement humain, les scientifiques ont utilisé environ 5 millions de jugements d'objet Over-One disponibles au public de plus de 1 854 images d'objets différentes. Par exemple, un participant serait montré une image d'une guitare, d'un éléphant et d'une chaise et serait invité à quel objet ne correspond pas. Les scientifiques ont ensuite traité plusieurs réseaux de neurones profonds qui peuvent reconnaître des images analogues aux participants humains et collecté des jugements de similitude pour les images des mêmes objets utilisés pour l'homme.

Ensuite, ils ont appliqué le même algorithme pour identifier les caractéristiques clés de ces images – les «dimensions» ont été terminées par les scientifiques – qui sous-tendent les décisions impaises. En traitant le réseau neuronal analogue aux humains, cela a assuré la comparabilité directe entre les deux.

« Lorsque nous avons examiné les dimensions que nous avons découvertes dans les réseaux de neurones profonds, nous avons pensé qu'ils ressemblaient vraiment à ceux trouvés chez l'homme », explique Martin Hebart, dernier auteur du journal. « Mais lorsque nous avons commencé à regarder de plus près et à les comparer aux humains, nous avons remarqué des différences importantes. »

En plus du biais visuel identifié par les scientifiques, ils ont utilisé des techniques d'interprétation communes dans l'analyse des réseaux de neurones pour juger si les dimensions qu'ils ont trouvées avaient en fait un sens. Par exemple, une dimension peut comporter beaucoup d'animaux et peut être appelée «liée à l'animal».

Pour voir si la dimension a vraiment répondu aux animaux, les scientifiques ont effectué plusieurs tests: ils ont regardé quelles parties des images ont été utilisées par le réseau neuronal, ils ont généré de nouvelles images qui correspondaient le mieux aux dimensions individuelles, et ils ont même manipulé les images pour éliminer certaines dimensions. « Tous ces tests stricts ont indiqué des dimensions très interprétables », ajoute Mahner.

« Mais lorsque nous avons directement comparé les dimensions correspondantes entre les humains et les réseaux de neurones profonds, nous avons constaté que le réseau ne faisait que se rapprocher de ces dimensions.

Les scientifiques espèrent que les recherches futures utiliseront des approches similaires qui comparent directement les humains à l'IA pour mieux comprendre comment l'IA a un sens du monde. « Nos recherches fournissent une méthode claire et interprétable pour étudier ces différences, ce qui nous aide à mieux comprendre comment l'IA traite les informations par rapport aux humains », explique Hebart. « Ces connaissances peuvent non seulement nous aider à améliorer la technologie de l'IA, mais aussi fournir des informations précieuses sur la cognition humaine. »