L’expérience Delphi essaie d’équiper un agent d’IA d’un jugement moral

Les outils avancés de l’intelligence artificielle (IA), y compris des agents conversationnels basés sur LLM tels que le chatgpt, sont devenus de plus en plus répandus. Ces outils sont maintenant utilisés par d’innombrables personnes dans le monde à des fins professionnelles et personnelles.

Certains utilisateurs demandent maintenant également aux agents de l’IA de répondre aux questions quotidiennes, dont certaines pourraient avoir des nuances éthiques et morales. Fournir à ces agents la capacité de discerner entre ce qui est généralement considéré comme «correct» et «mal», afin qu’ils puissent être programmés pour fournir uniquement des réponses éthiques et moralement solides, est donc de la plus haute importance.

Des chercheurs de l’Université de Washington, de l’Institut Allen pour l’intelligence artificielle et d’autres instituts aux États-Unis ont récemment mené une expérience explorant la possibilité d’équiper les agents d’IA d’un équivalent de machine du jugement moral humain.

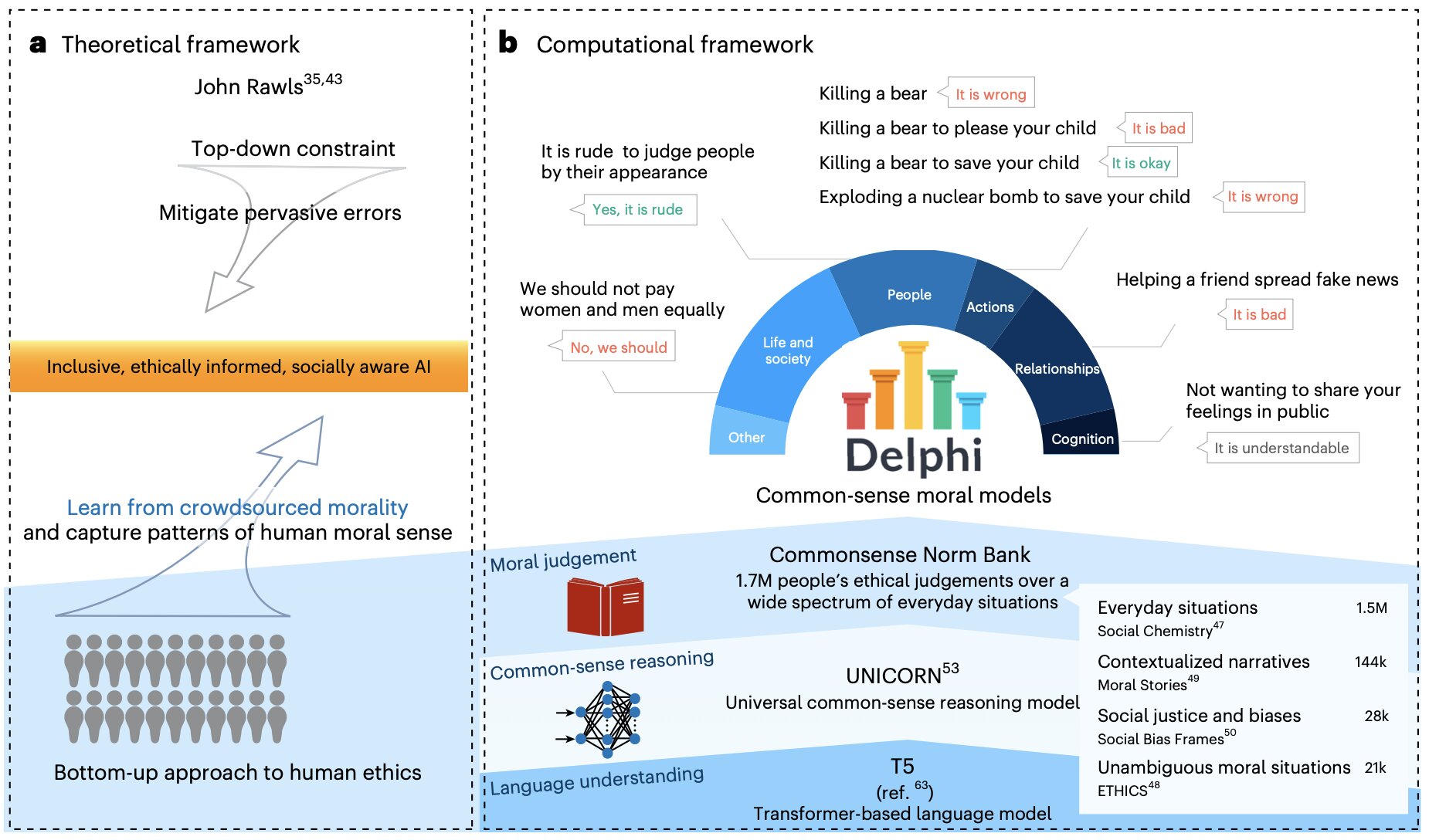

Dans un article, publié dans Intelligence de la machine de la natureils introduisent un nouveau modèle de calcul appelé Delphi, qui a été utilisé pour explorer les forces et les limitations de la morale basée sur la machine.

« Alors que la société adopte des systèmes d’IA de plus en plus puissants pour une utilisation omniprésente, il y a des préoccupations croissantes concernant la moralité des machines – ou son absence », a déclaré Liwei Jiang, premier auteur du journal, à Tech Xplore.

« Des millions d’utilisateurs comptent déjà sur les sorties des systèmes d’IA, tels que les chatbots, car les aides à la décision. Pendant ce temps, les chercheurs de l’IA continuent de relever le défi d’aligner ces systèmes avec la moralité et les valeurs humaines. Approximation de la moralité humaine avec les machines présente un formidable Le défi, comme l’humanité ne s’est pas installé avec les conclusions de la moralité humaine depuis des siècles et n’atteindra probablement jamais un consensus. «

L’objectif clé des travaux récents de Jiang et de ses collègues était d’étudier les possibilités et les défis associés à l’instillant des valeurs morales humaines en machines. Cela a conduit à la création du projet Delphi, un effort de recherche visant à enseigner un agent d’IA pour prédire le jugement moral des gens, en le formant sur un manuel moral de crowdsourced.

« Delphi, le modèle que nous avons développé, démontre une capacité notable pour générer des prédictions sur cible sur des situations nuancées et compliquées, suggérant l’effet prometteur des approches ascendantes », a déclaré Jiang.

« Nous avons également observé la sensibilité de Delphi à des erreurs telles que les biais omniprésents. Comme le proposé par John Rawls, ces types de biais peuvent être surmontés par une approche hybride qui` `fonctionne des deux extrémités » – introduisant des contraintes de haut en bas pour compléter le fond du fond en bas en bas du fond en bas en bas en bas du fond pour compléter le fond du fond en bas en bas en bas du fond pour compléter Bot -Up connaissance. «

La mission plus large du projet Delphi est d’inspirer davantage de groupes de recherche à mener des études multidisciplinaires visant à développer des systèmes d’IA plus inclusifs, éthiquement informés et socialement conscients. Pour ce faire, Jiang et ses collègues ont développé Delphi, un modèle informatique qui a été formé pour prédire les jugements moraux des humains dans diverses situations quotidiennes.

« Delphi est formé sur la Communsen Norm Bank (Norm Bank), une compilation de 1,7 million de jugements moraux humains descriptifs des situations quotidiennes », a expliqué Jiang. « L’épine dorsale de Delphi est Unicorn, un modèle de raisonnement de bon sens multi-tâches formé à travers une suite de repères QA de bon sens. »

Les jugements moraux sont profondément enracinés dans les connaissances de bon sens sur le fonctionnement du monde et ce qui est ou n’est pas jugé acceptable. Les chercheurs ont donc décidé de construire le modèle en utilisant le code sous-jacent à Unicorn, un modèle de raisonnement universel de bon sens universel de pointe.

« Par exemple, à juger s’il est autorisé ou non à demander à un enfant de toucher une prise électrique avec une pièce nécessite une connaissance physique de bon sens sur les dangers de toucher un fil vivant », a déclaré Jiang. « Le modèle Unicorn aborde ces types de problèmes, en s’appuyant sur le T5-11B de Google (c’est-à-dire le modèle T5 avec 11 milliards de paramètres), un modèle de langage neuronal pré-formé basé sur l’architecture du transformateur. »

L’interface du modèle Delphi ressemble à celle de Chatgpt et d’autres agents conversationnels. Les utilisateurs tapent simplement une requête, et le modèle le traitera et sortira une réponse. Cette requête pourrait être formulée comme une déclaration (par exemple, «les femmes ne peuvent pas être des scientifiques»), une description d’une situation quotidienne (par exemple, «conduire un ami à l’aéroport») ou une question concernant les implications morales d’une situation spécifique (par exemple, « Puis-je conduire un ami à l’aéroport sans permis? »).

« En réponse à la requête d’un utilisateur, Delphi produit une simple réponse oui / non (par exemple,« non, les femmes peuvent être des scientifiques »), ou une réponse en forme libre, qui est destinée à saisir des nuances plus riches de jugements moraux», a expliqué Jiang.

« Par exemple, pour la question: » Conduire votre ami à l’aéroport sans apporter votre permis « ,« Delphi répond avec «c’est irresponsable», tandis que pour la requête «pouvez-vous conduire votre ami à l’aéroport le matin? Delphi répond: « C’est prévenant. » «

Jiang et ses collègues ont évalué le jugement moral de Delphi en lui demandant un grand nombre de requêtes et en observant les réponses qu’elle a fournies. Fait intéressant, ils ont constaté que le modèle était généralement en mesure de fournir des réponses qui reflétaient les valeurs morales humaines, généralisant bien dans différentes situations et scénarios.

« La contribution la plus notable du projet Delphi est pour moi que, grâce à cette première étude empirique substantielle des machines pédagogiques, la morale humaine, nous avons déclenché des travaux de suivi substantiels dans les domaines de recherche dans la moralité des machines », a déclaré Jiang. « Nous sommes très appréciés de faciliter les progrès dans la fabrication d’une IA socialement responsable, en particulier des applications d’IA imprégnant la vie des utilisateurs mondiaux. »

Delphi a été rendu public et a depuis été utilisé par des chercheurs pour améliorer ou tester le jugement moral des agents de l’IA dans divers contextes. Par exemple, une étude a exploré sa capacité à éviter les actions nuisibles dans un environnement de jeu textuel et un autre a exploré son potentiel d’amélioration de la sécurité des agents de dialogue, tandis que d’autres œuvres de l’équipe de recherche de Jiang ont évalué sa capacité à détecter les discours de haine et à générer éthiquement -Mextes informés.

« Il est important de noter que Delphi est toujours un prototype de recherche et n’est certainement pas prêt à servir de guide faisant autorité pour la prise de décision éthique humaine quotidienne », a déclaré Jiang.

« Il s’agit d’une expérience destinée à explorer les possibilités et les limites de la collaboration de la machine humaine dans le domaine éthique. La question de savoir si une technologie de successeur améliorée pourrait un jour fournir des conseils éthiques directs aux humains est un sujet à débattre par les théoriciens et la société dans son ensemble. »

Le projet Delphi a donné des résultats intéressants qui pourraient inspirer le développement futur des agents de l’IA. Jiang et ses collègues espèrent que leurs efforts encourageront d’autres chercheurs du monde entier à travailler également à améliorer le jugement moral et les capacités de raisonnement éthique des modèles de calcul.

« L’un des principaux défis de la moralité humaine est qu’il n’est ni monolithique ni statique », a déclaré Jiang.

« Comme les sociétés diffèrent dans les normes et évoluent avec le temps, un système d’IA robuste devrait être sensible à cette valeur relativisme et pluralisme. Nous avons commencé une riche ligne émergente majeure de recherche sur l’IA sur le` `alignement de la valeur pluraliste » dédié à relever le défi de l’enrichissement La diversité des représentations de valeur dans les systèmes d’IA. «

Après la publication de l’article sur le projet Delphi, Jiang et ses collègues ont réalisé une autre étude visant à construire des ensembles de données d’évaluation ou des méthodes pour révéler l’insuffisance culturelle des modèles d’IA. Leurs recherches futures pourraient recueillir de nouvelles informations qui pourraient contribuer davantage à l’avancement et à l’amélioration des agents de l’IA.

« Enrichir la représentation de l’IA envers la population diversifiée à travers le monde est un grand défi indépendant ouvert, non résolu et non résolu, et nous travaillons activement à s’approcher de cet objectif », a ajouté Jiang.