L’espace de solution du modèle de perceptron sphérique négatif est en forme d’étoile, découvrent les chercheurs

Des études numériques récentes portant sur les réseaux neuronaux ont révélé que les solutions généralement trouvées par les algorithmes modernes d’apprentissage automatique se trouvent dans des régions étendues et complexes du paysage des pertes. Dans ces régions, des chemins sans énergie entre des paires de solutions distantes peuvent être établis.

Des chercheurs de l’Université Bocconi, du Politecnico di Torino et de l’Institut Bocconi pour la science et l’analyse des données ont récemment mené une étude visant à explorer ces régions à l’aide de l’un des modèles de réseau neuronal non convexe les plus simples, connu sous le nom de perceptron sphérique négatif. Leur article, publié dans Lettres d’examen physiqueont découvert que les solutions de ce modèle de réseau neuronal sont disposées selon une géométrie en forme d’étoile.

« Des recherches récentes sur le paysage des réseaux neuronaux ont montré que les trajectoires indépendantes de descente de gradient stochastique (SGD) atterrissent souvent dans le même bassin à faibles pertes, et souvent aucune barrière n’est trouvée le long de l’interpolation linéaire entre elles », Luca Saglietti, co-auteur du journal, a déclaré à Tech Xplore. « Nous avons commencé à réfléchir si nous pouvions reproduire analytiquement cette phénoménologie dans un modèle simple de réseau neuronal. »

Dans leur article, Saglietti et ses collègues ont présenté une méthode analytique qui peut être utilisée pour calculer les barrières énergétiques lors de l’interpolation linéaire entre des paires de solutions. Dans le cadre de leur étude récente, ils ont appliqué cette méthode au perceptron négatif sphérique, qui est essentiellement un modèle de jouet paradigmatique d’un réseau neuronal.

« Ce modèle est particulièrement intéressant car il est à la fois continu et non convexe », a déclaré Clarissa Lauditi, co-auteur de l’article. « Cela implique un ensemble de paramètres (appelés poids) qui doivent être réglés de manière à satisfaire un ensemble d’entraînement d’associations entrée-sortie. Dans le perceptron négatif, les contraintes peuvent être relâchées, et dans ce régime surparamétré, la géométrie du l’espace de solutions devient étonnamment riche.

Les chercheurs ont étudié ce modèle et le riche paysage de solutions qui lui est associé en caractérisant les barrières énergétiques sur l’interpolation linéaire entre des paires de solutions à l’aide de la méthode dite des répliques. Il s’agit d’une technique bien connue et établie qui est couramment appliquée dans les études de physique statistique.

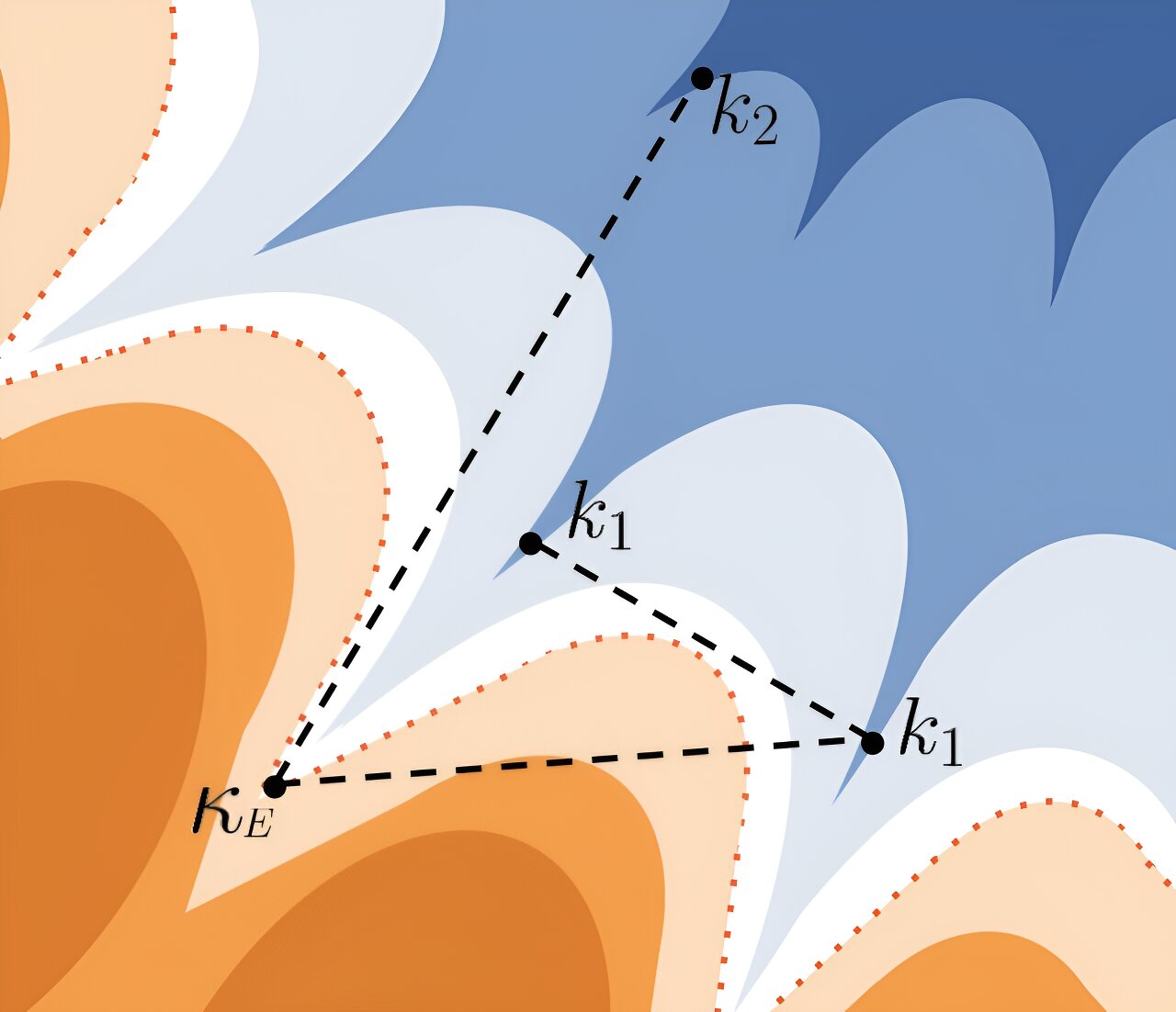

« De manière inattendue, nous avons dévoilé que les solutions sont disposées selon une géométrie en forme d’étoile », a déclaré Enrico Malatesta, co-auteur de l’article.

« La plupart d’entre elles sont situées à la pointe de l’étoile, mais il existe un sous-ensemble de solutions (situées au cœur de l’étoile) qui sont reliées par une ligne droite à presque toutes les autres solutions. Nous avons constaté que cette forme était en réalité impacte le comportement des algorithmes d’entraînement : les algorithmes courants utilisés dans l’apprentissage profond ont un biais en faveur des solutions situées au cœur de l’étoile. Ces solutions ont des propriétés souhaitables, par exemple une meilleure robustesse et des capacités de généralisation. »

Les travaux récents de cette équipe de recherche offrent de nouvelles informations intéressantes sur la forme géométrique des solutions associées au perceptron sphérique négatif. L’équipe a découvert que la façon dont les solutions sont disposées affecte les performances des algorithmes, ces derniers sélectionnant souvent de préférence les solutions situées au centre de la géométrie en forme d’étoile, qui présentent souvent des caractéristiques avantageuses.

« Nos futures recherches visent à comprendre dans quelle mesure la géométrie en forme d’étoile peut être une propriété universelle des réseaux de neurones surparamétrés et des problèmes d’optimisation faiblement contraints », a ajouté Gabriele Perugini, co-auteur de l’article. « La possibilité que des problèmes d’optimisation non convexes complètement différents puissent développer des propriétés de connectivité simples lorsqu’ils sont surparamétrés est certainement intrigante. »