L’équipe développe un nouveau détecteur de deepfake conçu pour être moins biaisé

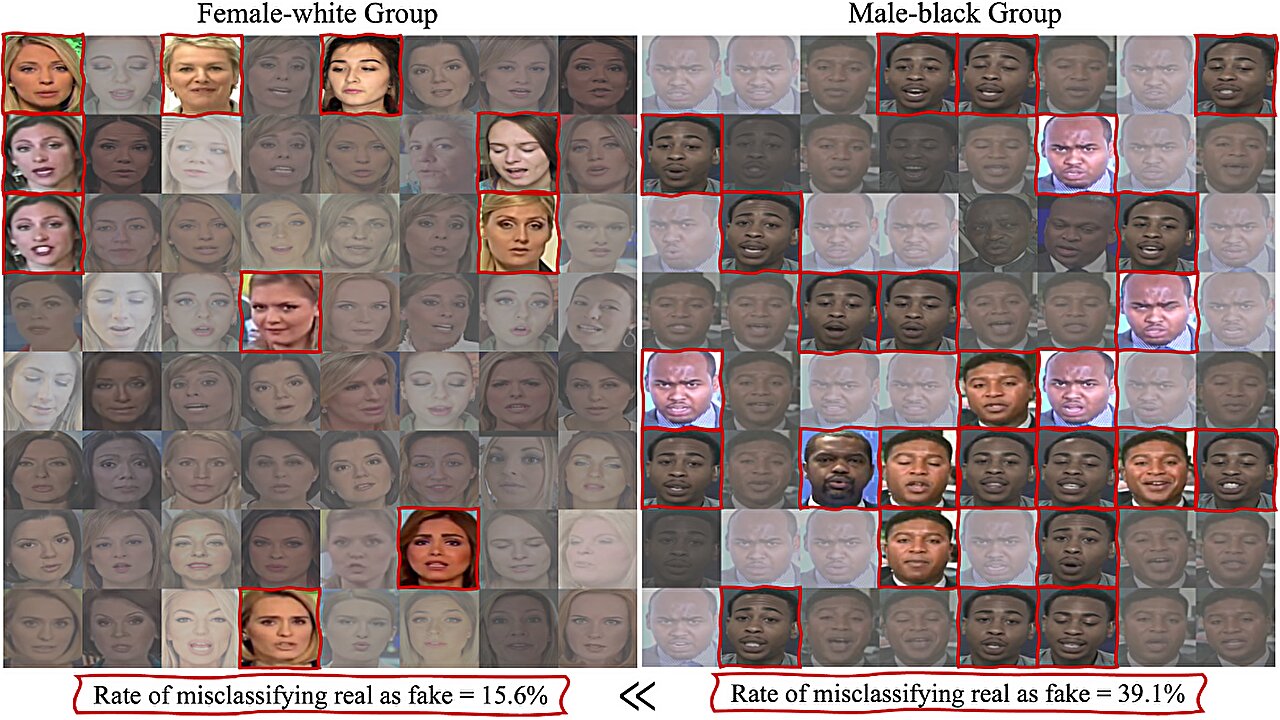

L’image parlait d’elle-même. Siwei Lyu, informaticien et expert en deepfake à l’Université de Buffalo, a créé un collage de photos à partir des centaines de visages que ses algorithmes de détection avaient incorrectement classés comme faux – et la nouvelle composition avait clairement un teint majoritairement plus foncé.

« La précision d’un algorithme de détection devrait être statistiquement indépendante de facteurs tels que la race », explique Lyu, « mais il est évident que de nombreux algorithmes existants, y compris le nôtre, héritent d’un biais. »

Lyu, Ph.D., codirecteur du Centre pour l’intégrité de l’information de l’UB, et son équipe ont développé ce qu’ils pensent être les tout premiers algorithmes de détection de deepfake spécifiquement conçus pour être moins biaisés.

Leurs deux méthodes d’apprentissage automatique – l’une qui rend les algorithmes conscients des données démographiques et l’autre qui les laisse aveugles à ces données – ont réduit les disparités de précision entre les races et les sexes, tout en améliorant dans certains cas la précision globale.

La recherche, publiée sur le arXiv serveur de préimpression, a été présenté lors de la Conférence d’hiver sur les applications de la vision par ordinateur (WACV), qui s’est tenue du 4 au 8 janvier.

Lyu, l’auteur principal de l’étude, a collaboré avec son ancien étudiant, Shu Hu, Ph.D., aujourd’hui professeur adjoint d’informatique et de technologie de l’information à l’Université d’Indiana-Purdue University d’Indianapolis, ainsi qu’avec George Chen, Ph.D., assistant professeur de systèmes d’information à l’Université Carnegie Mellon. Parmi les autres contributeurs figurent Yan Ju, titulaire d’un doctorat. étudiant au Media Forensic Lab de Lyu à l’UB et chercheur postdoctoral Shan Jia.

Ju, le premier auteur de l’étude, affirme que les outils de détection sont souvent moins scrutés que les outils d’intelligence artificielle qu’ils contrôlent, mais cela ne signifie pas qu’ils ne doivent pas non plus être tenus pour responsables.

« Les deepfakes ont tellement perturbé la société que la communauté des chercheurs était pressée de trouver une solution », dit-elle, « mais même si ces algorithmes ont été créés pour une bonne cause, nous devons toujours être conscients de leurs conséquences collatérales. »

Conscience démographique ou agnostique démographique

Des études récentes ont révélé de grandes disparités dans les taux d’erreur des algorithmes de détection des deepfakes (jusqu’à 10,7 % de différence dans une étude) entre les différentes races. En particulier, il a été démontré que certains parviennent mieux à deviner l’authenticité des sujets à la peau claire que ceux à la peau plus foncée.

Cela peut avoir pour conséquence que certains groupes risquent davantage de voir leur image réelle considérée comme fausse, ou peut-être encore plus préjudiciable, une image falsifiée d’eux-mêmes considérée comme réelle.

Le problème ne vient pas nécessairement des algorithmes eux-mêmes, mais des données sur lesquelles ils ont été formés. Les hommes blancs d’âge moyen sont souvent surreprésentés dans ces ensembles de données photo et vidéo, de sorte que les algorithmes sont meilleurs pour les analyser que les groupes sous-représentés, explique Lyu, professeur SUNY Empire au département d’informatique et d’ingénierie de l’UB, au sein de l’École de Ingénierie et sciences appliquées.

« Disons qu’un groupe démographique a 10 000 échantillons dans l’ensemble de données et que l’autre n’en a que 100. L’algorithme sacrifiera la précision sur le plus petit groupe afin de minimiser les erreurs sur le plus grand groupe », ajoute-t-il. « Cela réduit donc les erreurs globales, mais au détriment du plus petit groupe. »

Alors que d’autres études ont tenté de rendre les bases de données plus équilibrées démographiquement – un processus qui prend du temps – Lyu affirme que l’étude de son équipe est la première tentative visant à améliorer réellement l’équité des algorithmes eux-mêmes.

Pour expliquer leur méthode, Lyu utilise une analogie avec un enseignant évalué par les résultats des tests des élèves.

« Si un enseignant a 80 élèves qui réussissent bien et 20 élèves qui réussissent mal, ils obtiendront quand même une assez bonne moyenne », dit-il. « Au lieu de cela, nous voulons donner une moyenne pondérée aux étudiants situés au milieu, les obligeant à se concentrer davantage sur tout le monde plutôt que sur le groupe dominant. »

Premièrement, leur méthode démographique a fourni aux algorithmes des ensembles de données étiquetant le sexe des sujets (homme ou femme) et leur race (blanche, noire, asiatique ou autre) et leur a demandé de minimiser les erreurs sur les groupes les moins représentés.

« Nous disons essentiellement aux algorithmes que nous nous soucions de la performance globale, mais nous voulons également garantir que la performance de chaque groupe atteint certains seuils, ou du moins est très inférieure à la performance globale », explique Lyu.

Cependant, les ensembles de données ne sont généralement pas étiquetés en fonction de la race et du sexe. Ainsi, la méthode démographique et indépendante de l’équipe classe les vidéos deepfake non pas en fonction des données démographiques des sujets, mais en fonction de caractéristiques de la vidéo qui ne sont pas immédiatement visibles à l’œil humain.

« Peut-être qu’un groupe de vidéos dans l’ensemble de données correspond à un groupe démographique particulier ou peut-être à une autre caractéristique de la vidéo, mais nous n’avons pas besoin d’informations démographiques pour les identifier », explique Lyu. « De cette façon, nous n’avons pas besoin de sélectionner les groupes sur lesquels il convient de mettre l’accent. Tout est automatisé en fonction des groupes qui constituent cette tranche intermédiaire de données. »

Améliorer l’équité et l’exactitude

L’équipe a testé ses méthodes à l’aide de l’ensemble de données populaire FaceForensic++ et de l’algorithme de détection de pointe Xception. Cela a amélioré toutes les mesures d’équité de l’algorithme, telles que le taux égal de faux positifs entre les races, la méthode tenant compte de la démographie étant la plus performante.

Plus important encore, dit Lyu, leurs méthodes ont en fait augmenté la précision globale de détection de l’algorithme, de 91,49 % à 94,17 %.

Cependant, lors de l’utilisation de l’algorithme Xception avec différents ensembles de données et de l’ensemble de données FF+ avec différents algorithmes, les méthodes, tout en améliorant la plupart des mesures d’équité, ont légèrement réduit la précision globale de la détection.

« Il peut y avoir un petit compromis entre performances et équité, mais nous pouvons garantir que la dégradation des performances est limitée », déclare Lyu. « Bien sûr, la solution fondamentale au problème de biais consiste à améliorer la qualité des ensembles de données, mais pour l’instant, nous devons intégrer l’équité dans les algorithmes eux-mêmes. »