Les sceptiques de l'IA ont averti que nous étions beaucoup excitants et que nous ne les croyions pas: l'IA est Tontal

GPT-5 est quelque chose de mieux que GPT-4. Le problème de cette phrase est dans le mot «quelque chose». Le nouveau modèle « unifié » d'Openai ne semble pas représenter le saut qualitatif que beaucoup attendaient, et cela a fait remonter les alarmes. On pourrait lui demander si l'IA ne devient plus beaucoup mieux qu'il ne l'est maintenant? Mais peut-être que cela se produit déjà et la question en est une autre: que faisons-nous alors?

La montée fonctionne, mais moins. En 2020, une équipe de chercheurs OpenAI a publié une étude intitulée « Calacado Laws for Neuronal Language Models ». Ils y ont élevé une sorte de loi de Moore de l'IA: plus vous consacrez de données et de calcul aux modèles de formation, mieux ils seraient. Cette observation a été clairement démontrée lorsqu'ils ont lancé GPT-3, qui était 10 fois plus grand que GPT-2, mais c'était beaucoup, bien meilleur que ce modèle.

Ralentissement. Gary Marcus, professeur de psychologie et de sciences neuronales de l'Université de New York, a expliqué en 2022 que cette étude n'avait pas beaucoup de sens: « Les lois des avocats, appelés, ne sont pas des lois universelles telles que la gravité, mais simplement de simples observations qui ne pouvaient pas être maintenues pour toujours. » Même Satya Nadella était d'accord avec cette déclaration il y a quelques mois lors de l'événement Ignite 2024. Et comme nous le voyons, ses doutes se sont réalisés. La montée fonctionne et les modèles sont un peu meilleurs que ses prédécesseurs, mais la décélération semble être là.

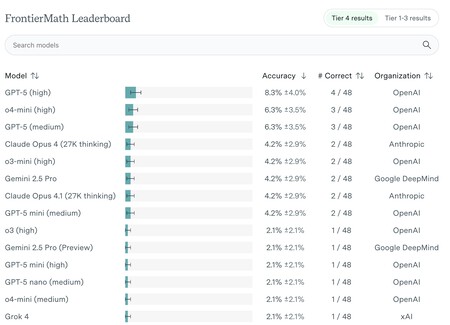

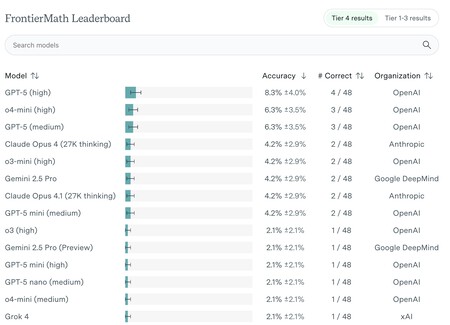

Mais GPT-5 n'est pas si mal. La vérité est que le GPT-5 s'est amélioré dans les mesures pertinentes. Les responsables de l'époque AI ont évalué leur comportement dans Frontitiermath, par exemple. Les résultats étaient un peu meilleurs que leur prédécesseur O4-Mini, mais il n'y avait pas de gros sauts de rendement. Même ainsi, ils ont souligné comment GPT-5 a été le premier modèle à résoudre un problème spécifique comme si « avait pleinement compris le problème ».

Dans le domaine des mathématiques, GPT-5 se comporte quelque chose de mieux que ses prédécesseurs, mais la différence n'est pas radicale. Les problèmes les plus difficiles (niveau 4) sont encore presque impossibles pour les modèles d'IA. Source: Epoch Ai.

Et réfléchissez mieux. Une autre analyse indépendante de l'analyste ZVI Mowshowitz a indiqué que bien que le modèle de base GPT-5 soit correct sans plus de NO, ses variantes avancées (GPT-5 Pro et GPT-5) étaient une amélioration substantielle par rapport à O3-Pro et O3 respectivement, en particulier lorsque les hallucinations atténuantes. Selon vos données, « GPT-5 Auto » (la version de base) semble être un mauvais produit à moins que vous n'utilisiez le plan de chatppt gratuit « .

La même chose dont nous avons besoin est un symbolique. Le symbolique (« classique ») représente les connaissances en utilisant des symboles et des règles, et est basé sur la logique et le raisonnement formel pour résoudre les problèmes et prendre des décisions. Ce type de dominé l'IA Panorama jusqu'à 90 ans, mais le manque d'avancées notables a fait stagner et a vécu un hiver de l'IA. « Nous partons » avec le connexionniste, les réseaux de neurones qui représentent les connaissances à travers les connexions et les poids des nœuds d'un réseau de neurones artificiels. Cette discipline a été celle qui a donné naissance à l'IA génératrice et au succès écrasant de Chatgpt et de ses rivaux. Son bon comportement surprenant a déclenché la fièvre actuelle de l'IA, mais les progrès de la performance ralentissent.

Les sceptiques de l'IA redoublent leur discours. Des analystes tels que Ed Zitron – plus extrême – ou Gary Marcus – l'IA symbolique – ont toujours mis en garde contre les attentes exagérées générées par l'IA générative. Même ceux qui ont joué un rôle déterminant dans la création de Chatgpt, comme l'ingénieur Ilya Sutskever, ont mis en garde contre les limitations de mise à l'échelle. Les modèles de raisonnement ont adouci les critiques et sont une excellente alternative pour cette stagnation apparente des modèles standard, mais même avec eux, le sentiment est que l'IA n'ira pas beaucoup plus loin.

Nous n'atteindrons donc jamais un AGI. Thomas Wolf, co-fondateur et directeur des sciences de Hugging Face, a réfléchi au problème il y a quelques mois et est arrivé à la conclusion que les IAS sont devenues « un pays d'hommes qui disent oui à tout sur les serveurs ». Pour lui, les choses ont commencé à déranger:

« Pour créer un Einstein dans un centre de données, nous n'avons pas besoin d'un système qui a toutes les réponses, mais plutôt celui qui est capable de se demander des choses que personne n'avait pensé ou personne n'avait osé demander. »

Comme cet expert l'a souligné, l'IA actuelle ne génère pas (généralement) de nouvelles connaissances et « remplit simplement les trous de ce que les humains savaient déjà ». L'IA actuelle est comme un étudiant fantastique et très appliqué, mais cet étudiant ne conteste pas ce qui a été enseigné. Il ne le remet pas en question et ne propose pas d'idées qui vont à l'encontre des données avec lesquelles il a été formé. Yann LeCun, l'un des pionniers de l'IA, s'est déjà conclu sur l'IA générative actuelle: c'est idiot.

Réduire les attentes. Le panorama s'inquiète pour ceux qui investissent des milliards de dollars dans des centres de données ou dans la formation de nouveaux modèles fondamentaux, en particulier parce que cet impact peut ne pas être aussi gigantesque qu'ils l'avaient prévu et promis. Ed Zitron a indiqué dans le New Yorker qu ' »il s'agit d'un marché de 50 000 millions de dollars, pas d'un milliard de dollars ». Marcus a accepté. « 50 000 millions, oui. Peut-être 100 000. »

Que se passe-t-il si l'IA a stagné. Si c'est efficacement, ce que nous pouvons nous attendre, c'est que l'IA devient un outil utile pour gagner du temps et améliorer le résultat de certaines tâches – c'est le faire – mais pas pour provoquer cet impact sismique sur la société et l'emploi que des personnalités telles que Altman, Musk, Amodei ou Zuckerberg défendent avec leurs investissements. Si cela se produit, nous aurons sans aucun doute un outil puissant pour faire les choses mieux et plus rapidement. C'est exactement ce qui nous a permis d'autres perturbations fantastiques telles que le PC ou Internet.

Mais beaucoup attendaient probablement plus. Beaucoup plus. Et il y a le problème. Dans les attentes.

Image | Photographie de Levart

Dans Simseo | Il y a trop de modèles d'IA. Cela augmente une véritable condamnation à mort pour anthropique et Claude