Les robots peuvent désormais apprendre à utiliser des outils, juste en nous regardant

Malgré des décennies de progrès, la plupart des robots sont encore programmés pour des tâches spécifiques et répétitives. Ils ont du mal avec l'inattendu et ne peuvent pas s'adapter à de nouvelles situations sans reprogrammation minutieuse. Mais que se passe-t-il s'ils pouvaient apprendre à utiliser des outils aussi naturellement qu'un enfant en regardant des vidéos?

Je me souviens encore de la première fois que j'ai vu l'un des robots de nos laboratoires retourner un œuf dans une poêle. Il n'a pas été préprogrammé. Personne ne le contrôlait avec un joystick. Le robot avait simplement regardé une vidéo d'un humain le faisant, puis l'avait fait lui-même. Pour quelqu'un qui a passé des années à réfléchir à la façon de rendre les robots plus adaptables, ce moment était passionnant.

Notre équipe de l'Université de l'Illinois Urbana-Champaign, ainsi que des collaborateurs de l'Université Columbia et UT Austin, a exploré cette question. Les robots pourraient-ils regarder quelqu'un marteler un clou ou ramasser une boucle de viande, puis trouver comment le faire lui-même, sans capteurs coûteux, costumes de capture de mouvement ou heures de téléopération éloignés?

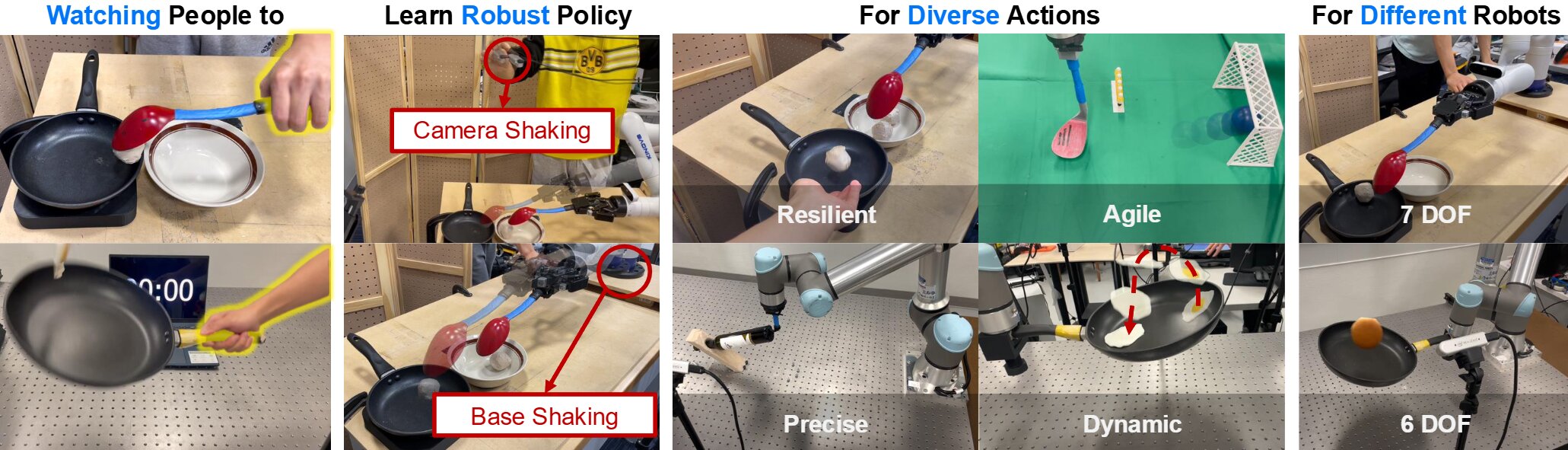

Cette idée nous a conduit à créer un nouveau framework que nous appelons « l'outil comme interface », actuellement disponible sur le arxiv serveur de préimprimée. L'objectif est simple: enseigner aux robots complexes, des compétences d'utilisation des outils dynamiques en utilisant rien de plus que des vidéos ordinaires de personnes effectuant des tâches quotidiennes. Tout ce qu'il faut, c'est deux vues de caméra sur l'action, ce que vous pourriez capturer avec quelques smartphones.

Voici comment cela fonctionne. Le processus commence par ces deux cadres vidéo, qu'un modèle de vision appelé MAST3R utilise pour reconstruire un modèle tridimensionnel de la scène. Ensuite, en utilisant une méthode de rendu connue sous le nom de Splatting gaussien 3D – pensez à celle de peindre numériquement une image 3D de la scène – nous générons des points de vue supplémentaires afin que le robot puisse « voir » la tâche sous plusieurs angles.

Mais la vraie magie se produit lorsque nous supprimons numériquement l'humain de la scène. À l'aide de «SAM ancré», notre système isole uniquement l'outil et son interaction avec l'environnement. C'est comme dire au robot, « ignorer l'humain et ne faire attention qu'à ce que fait l'outil. »

Cette perspective « centrée sur l'outil » est l'ingrédient secret. Cela signifie que le robot n'essaie pas de copier des mouvements de la main humaine, mais apprend plutôt la trajectoire exacte et l'orientation de l'outil lui-même. Cela permet à la compétence de transférer entre différents robots, quelle que soit la façon dont leurs bras ou caméras sont configurés.

Nous avons testé cela sur cinq tâches: marteler un clou, ramasser une boucle de viande, renverser une poêle, équilibrer une bouteille de vin et même donner un coup de pied à un ballon de football dans un but. Ce ne sont pas de simples emplois de pick-and-place; Ils nécessitent de la vitesse, de la précision et de l'adaptabilité. Par rapport aux méthodes de téléopération traditionnelles, les outils en tant qu'interface ont atteint 71% de taux de réussite plus élevés et recueilli des données de formation 77% plus rapidement.

L'un de mes tests préférés a impliqué un robot couvrant des boulettes de viande tandis qu'un humain a jeté plus de tâche au milieu. Le robot n'a pas hésité, il s'est simplement adapté. Dans un autre, il a retourné un œuf en vrac dans une casserole, un mouvement notoirement délicat pour les robots téléopérés.

« Notre approche a été inspirée par la façon dont les enfants apprennent, c'est-à-dire en regardant les adultes », a déclaré mon collègue et auteur principal Haonan Chen. « Ils n'ont pas besoin d'exploiter le même outil que la personne qu'ils regardent; ils peuvent pratiquer avec quelque chose de similaire. Nous voulions savoir si nous pouvions imiter cette capacité dans les robots. »

Ces résultats indiquent quelque chose de plus grand que de meilleures démos de laboratoire. En supprimant le besoin d'opérateurs experts ou de matériel spécialisé, nous pouvons imaginer que les robots apprennent des vidéos de smartphone, des clips YouTube ou même des images de crowdsourced.

« Malgré beaucoup de battage médiatique autour des robots, ils sont toujours limités où ils peuvent opérer de manière fiable et sont généralement bien pires que les humains dans la plupart des tâches », a déclaré le professeur Katie Driggs-Campbell, qui dirige notre laboratoire.

« Nous sommes intéressés à concevoir des cadres et des algorithmes qui permettront aux robots d'apprendre facilement des personnes ayant un minimum d'effort d'ingénierie. »

Bien sûr, il y a encore des défis. À l'heure actuelle, le système suppose que l'outil est rigidement fixé à la pince du robot, ce qui n'est pas toujours vrai dans la vraie vie. Il lutte également parfois avec des erreurs d'estimation de la pose 6D, et les vues de caméra synthétisées peuvent perdre du réalisme si le décalage d'angle est trop extrême.

À l'avenir, nous voulons rendre le système de perception plus robuste, afin qu'un robot puisse, par exemple, regarder quelqu'un utiliser un type de stylo, puis appliquer cette compétence à des stylos de différentes formes et tailles.

Même avec ces limites, je pense que nous constatons un changement profond dans la façon dont les robots peuvent apprendre, loin de la programmation minutieuse et vers l'observation naturelle. Des milliards de caméras enregistrent déjà comment les humains utilisent des outils. Avec les bons algorithmes, ces vidéos pourraient devenir du matériel de formation pour la prochaine génération de robots adaptables et utiles.

Cette recherche, qui a été honorée du prix du meilleur article de l'atelier ICRA 2025 sur les modèles de fondation et l'IA symbolique neuronal (NESY) pour la robotique, est une étape critique vers la déverrouillage de ce potentiel, transformant le vaste océan de vidéo enregistrée humaine en une bibliothèque de formation globale pour les robots qui peuvent apprendre et s'adapter aussi naturellement à un enfant.

Cette histoire fait partie de Science X Dialog, où les chercheurs peuvent signaler les résultats de leurs articles de recherche publiés. Visitez cette page pour plus d'informations sur la boîte de dialogue Science X et comment participer.