Les progrès de l’IA et les puces améliorent la reconnaissance vocale

Puce IA analogique de 14 nm posée dans la main du chercheur. Crédit : Ryan Lavine pour IBM

Des développements distincts en matière de technologie de reconnaissance vocale réalisés par IBM et les universités californiennes de San Francisco et de Berkeley offrent des nouvelles prometteuses pour les patients souffrant de paralysie vocale et de perte de la parole.

IBM a annoncé la création d’une puce informatique plus rapide et plus économe en énergie, capable de suralimenter la sortie du modèle de reconnaissance vocale.

Avec la croissance explosive des grands modèles de langage pour les projets d’IA, les limites des performances matérielles entraînant des périodes de formation plus longues et une consommation d’énergie croissante sont apparues.

En termes de dépenses énergétiques, le MIT Technology Review a récemment rapporté que la formation d’un seul modèle d’IA génère plus de 626 000 livres de dioxyde de carbone, soit près de cinq fois la quantité qu’une voiture américaine moyenne émet au cours de sa vie.

Un facteur clé à l’origine de l’énorme consommation d’énergie des opérations d’IA est l’échange de données entre la mémoire et les processeurs.

Les chercheurs d’IBM à la recherche d’une solution affirment que leur prototype intègre des dispositifs de mémoire à changement de phase dans la puce, optimisant ainsi les processus fondamentaux d’IA connus sous le nom d’opérations de multiplication-accumulation (MAC) qui accélèrent considérablement l’activité de la puce. Cela contourne la routine standard, consommatrice de temps et d’énergie, de transport des données entre la mémoire et le processeur.

« Il s’agit, à notre connaissance, des premières démonstrations de niveaux de précision commercialement pertinents sur un modèle commercialement pertinent », a déclaré Stefano Ambrogia d’IBM dans une étude publiée le 23 août dans la revue en ligne. Nature journal.

Puce AI analogique 14 nm sur la carte de test. Crédit : Ryan Lavine pour IBM

« Nos travaux indiquent que, lorsqu’ils sont combinés à une mise en œuvre efficace en termes de temps, de surface et d’énergie du calcul auxiliaire sur puce, l’efficacité énergétique élevée et le débit délivrés… peuvent être étendus à l’ensemble d’un système d’IA analogique », a-t-il déclaré.

Dans les opérations de reconnaissance vocale gourmandes en ressources processeur, le prototype d’IBM a réalisé 12 400 milliards d’opérations par seconde et par watt, un niveau d’efficacité jusqu’à des centaines de fois supérieur à celui des processeurs et GPU les plus puissants actuellement utilisés.

Pendant ce temps, des chercheurs de l’UC San Francisco et de l’UC Berkeley affirment avoir conçu une interface cerveau-ordinateur pour les personnes ayant perdu la capacité de parler, qui génère des mots à partir des pensées et des efforts de vocalisation de l’utilisateur.

Edward Chang, président de la chirurgie neurologique à l’UC San Francisco, a déclaré : « Notre objectif est de restaurer une manière de communiquer complète et incarnée, qui est la manière la plus naturelle pour nous de parler avec les autres. »

Chang et son équipe ont implanté deux minuscules capteurs à la surface du cerveau d’une femme atteinte de sclérose latérale amyotrophique, une maladie neurogénérative qui prive progressivement ses victimes de mobilité et de parole.

Même si le sujet pouvait encore émettre des sons, la SLA limitait l’utilisation de ses lèvres, de sa langue et de son larynx pour articuler des mots cohérents.

Les capteurs étaient connectés via une interface cerveau-ordinateur à des banques d’ordinateurs hébergeant un logiciel de décodage du langage.

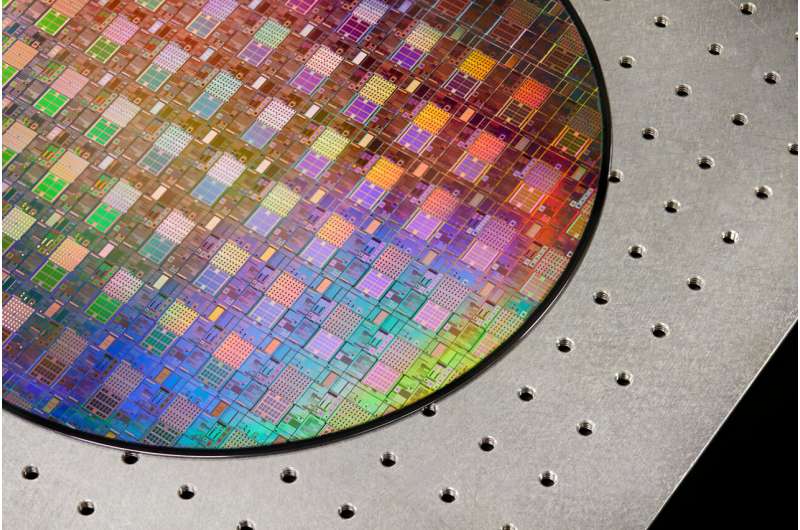

Plaquette de 300 mm utilisée pour fabriquer des puces IA analogiques. Crédit : Ryan Lavine pour IBM

La femme a suivi 25 séances de formation d’une durée de quatre heures chacune au cours desquelles elle a lu des séries de 260 à 480 phrases. Son activité cérébrale pendant les lectures était traduite par le décodeur, qui détectait les phonèmes et les assemblait en mots.

Les chercheurs ont ensuite synthétisé son discours, sur la base d’un enregistrement de son discours lors d’un mariage des années plus tôt, et ont conçu un avatar qui reflétait les mouvements de son visage.

Les résultats étaient prometteurs.

Après quatre mois de formation, le modèle a pu suivre les tentatives de vocalisation du sujet et les convertir en mots intelligibles.

Sur la base d’un vocabulaire de formation de 125 000 mots, couvrant pratiquement tout ce que le sujet voudrait dire, le taux d’exactitude était de 76 %.

Lorsque le vocabulaire était limité à 50 mots, le système de traduction faisait bien mieux, identifiant correctement son discours dans 90 % des cas.

De plus, le système était capable de traduire le discours du sujet à une vitesse de 62 mots par minute. Bien que le taux de reconnaissance des mots soit trois fois supérieur à celui d’expériences similaires antérieures, les chercheurs réalisent que des améliorations seront nécessaires pour atteindre le taux de parole naturelle de 160 mots par minute.

« Il s’agit d’une preuve de concept scientifique, et non d’un véritable appareil que les gens peuvent utiliser dans la vie quotidienne », a déclaré Frank Willett, co-auteur de l’étude publiée le 23 août dans Nature. « Mais c’est un grand progrès vers le rétablissement d’une communication rapide pour les personnes paralysées qui ne peuvent pas parler. »