Les annotateurs de données tiers ne parviennent souvent pas à lire avec précision les émotions des autres, selon l'étude

Les algorithmes d'apprentissage automatique et les grands modèles de langage (LLM), tels que le modèle qui sous-tend le fonctionnement du chat de plate-forme, se sont révélés efficaces pour s'attaquer à un large éventail de tâches. Ces modèles sont formés sur différents types de données (par exemple, textes, images, vidéos et / ou enregistrements audio), qui sont généralement annotés par les humains, qui qualifient de fonctionnalités importantes, y compris les émotions exprimées dans les données.

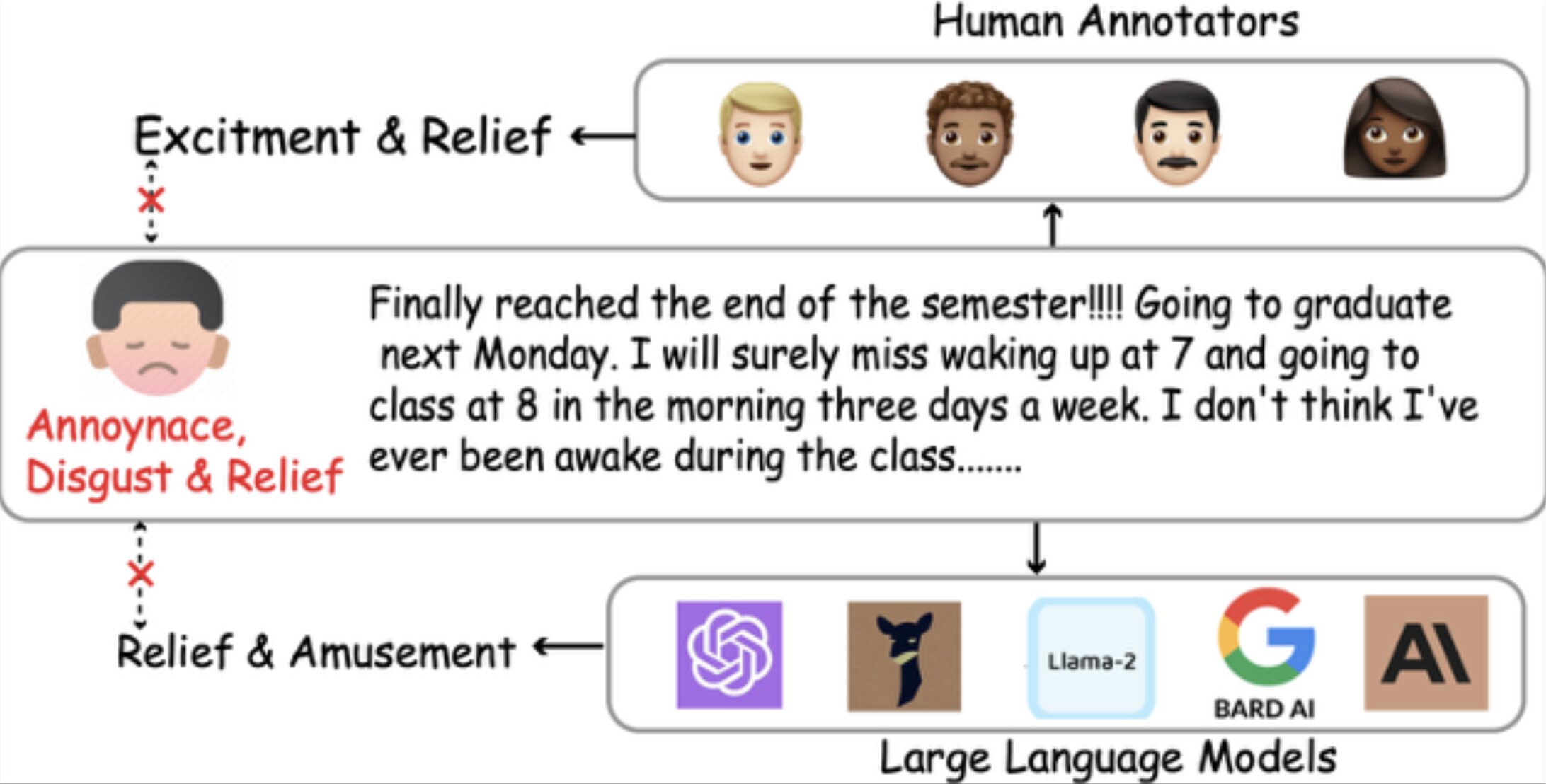

Des chercheurs de la Pennsylvania State University ont récemment réalisé une étude visant à mieux comprendre la mesure dans laquelle les annotateurs tiers, humains et modèles de langage grand (LLM), peuvent identifier les émotions exprimées par d'autres dans leurs textes écrits. Leurs résultats, décrits dans un article publié sur le arxiv Le serveur préalable et défini pour être présenté lors de la conférence ACL 2025 à Vienne, suggèrent que les gens ne parviennent souvent pas à ramasser les émotions exprimées par d'autres dans les textes.

« De nombreuses tâches de la PNL modèles des États privés des auteurs (comme les émotions) utilisant des annotations tierces, en supposant que ces étiquettes s'alignent sur l'expérience réelle de l'auteur », a déclaré Sarah Rajtmajer, auteur principal du journal, à Tech Xplore. «Cependant, cette hypothèse critique est rarement examinée.

« Le désalignement entre l'état privé d'un auteur et son interprétation tiers n'est pas simplement une erreur d'étiquetage – il peut se propager à travers des modèles appris et saper la fiabilité des applications en aval, conduisant à des conséquences socialement nuisibles. »

La récente étude menée par Ph.D. L'étudiant Jiayi Li axé sur la reconnaissance des émotions basée sur le texte, car de nombreuses plateformes d'IA utilisées par les individus dans le monde sont accessibles via le chat et sont conçues pour traiter les textes écrits. La question clé à laquelle l'équipe espérait répondre est: à quel point les annotations tierces sont-elles fiables lorsqu'il s'agit de reconnaître les émotions exprimées par les humains?

« Cette question nous a poussés à étudier systématiquement l'alignement entre les émotions autodéclarées (premiers) et les interprétations des annotateurs tiers, y compris les humains et les LLM », a déclaré Li. « Nous avons également exploré les moyens d'améliorer cet alignement en incorporant des facteurs, en examinant spécifiquement l'impact des données démographiques partagées pour les annotateurs humains et en fournissant des données démographiques d'auteur aux LLM. »

Pour sonder la capacité des annotateurs tiers à déduire les émotions des autres à partir de textes, les chercheurs ont mené une expérience impliquant des utilisateurs de médias sociaux recrutés via la plate-forme de crowdsourcing Connect. Les participants à l'étude ont d'abord été invités à partager leurs propres publications sur les réseaux sociaux et à étiqueter les émotions qu'ils ont estimées qu'ils exprimaient dans ces publications.

« Nous avons ensuite demandé à différents groupes d'annotateurs humains, compte tenu de leur démographie par rapport aux auteurs, pour étiqueter les mêmes messages », a expliqué Li. « Nous avions également plusieurs modèles de langage grand (LLMS) effectuant la même tâche d'étiquetage. En comparant ces annotations tierces (des humains et des LLM) aux émotions autodéclarées de l'auteur en utilisant des mesures d'évaluation comme le score F1 et les tests statistiques, nous avons examiné l'alignement entre les annotations de première et de troisième par partie. »

Dans leurs analyses, Li, Rajtmajer et leurs collègues ont également examiné les similitudes démographiques entre les utilisateurs écrivant des publications et les annotateurs tiers. Cela leur a permis d'explorer la possibilité que les personnes ayant des données démographiques similaires (par exemple, un âge ou un fond ethnique similaire) soient mieux pour ramasser les émotions de l'autre.

« La conclusion la plus notable de notre étude est le désalignement clair entre les annotations tierces et les émotions autodéclarées par des tiers », a déclaré Rajtmajer. « Cette constatation remet en question une hypothèse commune dans la recherche de reconnaissance des émotions que les annotateurs tiers peuvent déduire de manière fiable l'expression émotionnelle de quelqu'un d'autre basé uniquement sur le texte.

« Notamment, nous avons constaté que les annotateurs humains qui partageaient les traits démographiques avec l'auteur du Post étaient plus alignés sur les étiquettes des premiers parties, et l'incitation aux LLM avec un contexte démographique a conduit à des améliorations petites mais statistiquement significatives. »

Dans l'ensemble, les résultats de ces travaux récents suggèrent que les annotateurs humains pourraient ne pas être aussi efficaces pour ramasser des émotions exprimées dans les textes que les études antérieures l'ont suggéré, mais ils pourraient mieux détecter les émotions des personnes qui partagent des caractéristiques similaires avec eux.

Cette idée pourrait guider l'annotation des futurs ensembles de données de texte pour la formation des modèles de traitement du langage naturel (NLP), y compris les LLM, ce qui pourrait aider à renforcer la capacité de ces modèles à générer des réponses alignées sur les émotions exprimées par les utilisateurs.

« Notre étude met en évidence la nécessité pour les chercheurs et les développeurs d'être précis sur la perspective émotionnelle qu'ils capturent – l'auteur ou celle d'un observateur », a ajouté Rajtmajer. «Cette distinction est particulièrement critique dans les applications en aval comme le soutien de la santé mentale et les systèmes de dialogue empathique, où la compréhension de l'état émotionnel de l'auteur est souvent l'objectif.

« À l'avenir, nous sommes intéressés par des modèles d'émotion plus nuancés et centrés sur l'utilisateur qui vont au-delà des catégories d'émotions de base dérivées de réponses biologiques et de taxonomies construites tierces rigides. »