Le système d'IA peut visualiser un monde entier à partir d'une seule image

Les informaticiens de Johns Hopkins ont créé un système d'intelligence artificielle capable d'« imaginer » son environnement sans avoir à l'explorer physiquement, rapprochant ainsi l'IA du raisonnement humain.

Le nouveau système, appelé Generative World Explorer, ou GenEx, n'a besoin que d'une seule image fixe pour évoquer un monde entier, ce qui lui confère un avantage significatif par rapport aux systèmes précédents qui nécessitaient qu'un robot ou un agent se déplace physiquement à travers une scène pour cartographier l'environnement. ce qui peut être coûteux, dangereux et prendre beaucoup de temps. Les résultats de l'équipe sont affichés sur le arXiv serveur de préimpression.

« Disons que vous vous trouvez dans une région où vous n'êtes jamais allé auparavant : en tant qu'humain, vous utilisez des signaux environnementaux, des expériences passées et votre connaissance du monde pour imaginer ce qui pourrait se passer au coin de la rue », explique l'auteur principal Alan Yuille, Professeur émérite Bloomberg de sciences cognitives computationnelles à Johns Hopkins.

« GenEx 'imagine' et raisonne sur son environnement comme le font les humains, en prenant des décisions éclairées sur les prochaines étapes à suivre sans avoir à vérifier physiquement son environnement au préalable. »

GenEx utilise une connaissance sophistiquée du monde pour générer de multiples possibilités de ce qui pourrait exister au-delà de l'image visible, attribuant différentes probabilités à chaque scénario plutôt que de faire une seule supposition définitive. Cette capacité à cartographier mentalement les environs à partir de données visuelles limitées est cruciale pour de nombreuses applications du monde réel, notamment dans des scénarios tels que les interventions en cas de catastrophe. Par exemple, les équipes de secours pourraient utiliser une seule image de surveillance pour explorer à distance des sites dangereux sans risque pour les humains ou les équipements précieux.

« Cette technologie peut également améliorer les applications de navigation, aider à la formation de robots autonomes et proposer des expériences de jeu et de réalité virtuelle immersives », déclare l'auteur principal Jieneng Chen, titulaire d'un doctorat. étudiant en informatique.

À partir d'une seule image, GenEx génère un monde virtuel réaliste et synthétique dans lequel les agents d'IA peuvent naviguer et prendre des décisions grâce au raisonnement et à la planification. L'agent n'a besoin que d'une vue de sa scène actuelle, d'une direction de déplacement et de la distance à parcourir. Comme le démontre l’animation ci-dessous, l’agent peut avancer, changer de direction et explorer son environnement avec une flexibilité illimitée.

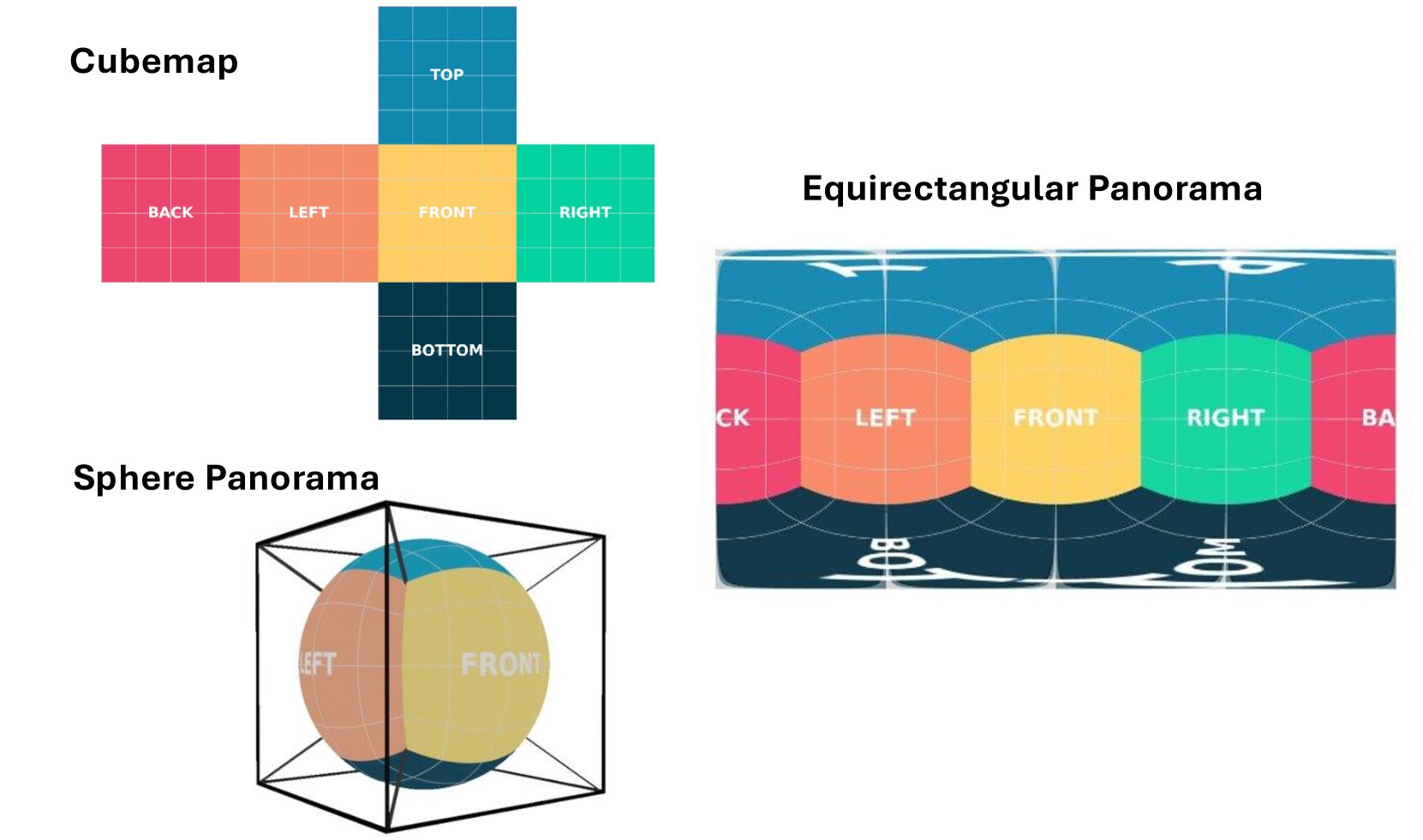

Et contrairement aux applications oniriques d'exploration du monde de l'IA qui gagnent en popularité, comme Oasis, un simulateur Minecraft généré par l'IA, les environnements de GenEx sont cohérents. En effet, le modèle a été formé sur des données à grande échelle avec une technique appelée « apprentissage par cohérence sphérique », qui garantit que ses prédictions de nouveaux environnements s'inscrivent dans une sphère panoramique.

« Nous mesurons cela en demandant à GenEx de parcourir un chemin fermé échantillonné de manière aléatoire, revenant à l'origine dans une boucle fixe », explique Chen. « Notre objectif était de rendre les vues de début et de fin identiques, garantissant ainsi la cohérence de la modélisation mondiale de GenEx. »

Bien que cette cohérence ne soit pas unique à GenEx, l'équipe de recherche affirme qu'il s'agit du premier et du seul explorateur du monde génératif à permettre aux agents d'IA de prendre des décisions logiques basées sur de nouvelles observations sur le monde qu'ils explorent dans le cadre d'un processus que les informaticiens appellent » politique augmentée par l'imagination.

Par exemple, disons que vous conduisez et que le feu devant vous est vert, mais que vous remarquez que le taxi devant vous s'est arrêté brusquement et de manière inattendue. Sortir de votre voiture pour enquêter serait dangereux, mais en imaginant la scène du point de vue du chauffeur de taxi, vous pouvez trouver une raison possible de son arrêt soudain : peut-être qu'un véhicule d'urgence approche – et vous devriez également céder le passage.

« Alors que les humains peuvent utiliser d'autres signaux comme les sirènes pour identifier ce type de situation, les modèles d'IA actuels développés pour la conduite autonome et d'autres tâches similaires n'ont accès qu'à des entrées d'images et de langage, ce qui rend une exploration imaginative nécessaire en l'absence d'autres informations multimodales », a déclaré Chen. dit.

L'équipe Hopkins a évalué la cohérence et la qualité de la sortie de GenEx par rapport aux références standards de génération vidéo. Les chercheurs ont également mené des expériences avec des utilisateurs humains pour déterminer si et comment GenEx pouvait augmenter leurs capacités de logique et de planification et ont constaté que les utilisateurs prenaient des décisions plus précises et plus éclairées lorsqu'ils avaient accès aux capacités d'exploration du modèle.

« Nos résultats expérimentaux démontrent que GenEx peut générer des observations cohérentes et de haute qualité lors d'une exploration prolongée d'un vaste monde physique virtuel », explique Chen. « De plus, les croyances mises à jour avec les observations générées peuvent éclairer un modèle de prise de décision existant, tel qu'un grand agent de modèle de langage, et même les utilisateurs humains pour élaborer de meilleurs plans. »

Rejoints par Tianmin Shu et Daniel Khashabi, tous deux professeurs adjoints d'informatique, et par TaiMing Lu, étudiant de premier cycle, Yuille et Chen intégreront des données de capteurs du monde réel et des scènes dynamiques pour des scénarios de planification plus réalistes et immersifs.

Rama Chellappa, professeur émérite de vision par ordinateur et d'intelligence artificielle chez Bloomberg, et Cheng Peng, professeur de recherche adjoint au Mathematical Institute for Data Science, aideront à conserver les données des capteurs du monde réel.

Le projet interdisciplinaire, qui implique la vision par ordinateur, le traitement du langage naturel et les sciences cognitives, marque une avancée significative vers l'obtention d'une intelligence humaine dans l'IA incarnée, explique Yuille.