Le problème d'AMD n'est pas qu'il ne fasse pas de bons GPU pour IA. Est qu'il n'est même pas proche de Nvidia

AMD fait bien les choses, mais même les fait toujours incapables de rivaliser avec Nvidia. L'entreprise vient de soulever sa feuille de route renouvelée avec des modèles prometteurs, mais ce n'est pas une garantie de quoi que ce soit pour un nvidia qui ne permettra pas à sa position de leadership absolu s'échapper.

Le problème pour AMD n'est pas de l'être, mais obligez les autres à en prendre note. Les données de conseil IDC indiquent que NVIDIA domine le marché des puces AI avec 85,2% des tâches du marché, pour 14,3% AMD. D'autres analystes tels que Jon Peddie Research vont plus loin et selon leurs données, les frais de Nvidia dans ce segment sont de 92%.

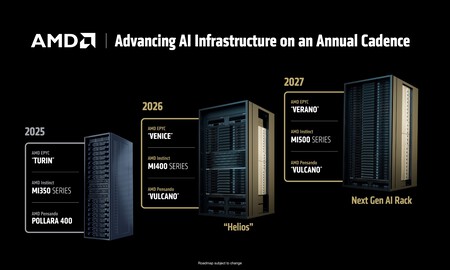

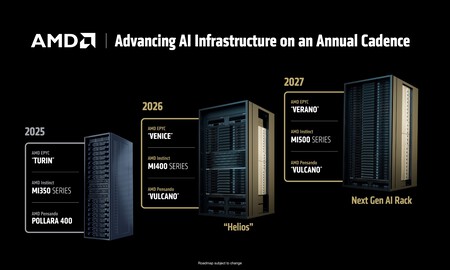

AMD Instinct Mi350 n'est que le début. Les GPU pour IA, que AMD appelle des « accélérateurs », suivent son évolution. Au cours de l'événement, ils ont présenté leur série familiale ou instinct MI350 avec deux variantes, MI350X et MI355X. Selon le fabricant, ces puces sont quatre fois plus élevées en performances générales par rapport à la génération précédente, mais sont jusqu'à 35 fois plus puissantes dans le domaine de l'IA d'inférence (c'est-à-dire dans l'utilisation pratique de modèles tels que ChatGpt, qui « infère » « leurs réponses de nos invites). 9.2 Pflops en précision FP8.

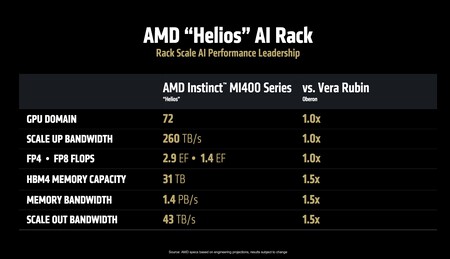

Instinct Mi400 en 2026. L'année prochaine, la nouvelle famille des accélérateurs d'AMD arrivera. Ce sont l'instinct MI400 futur, qui arrivera avec jusqu'à 432 Go de mémoire HBM4, 19,6 To / s de bande passante de cette mémoire, et une performance de 40 pflops en précision FP4 et 20 pflops dans la précision FP8. Ces monstres seront vendus dans de futurs racks avec une infrastructure « Helios », qui peut abriter jusqu'à 72 MI400 avec jusqu'à 260 To / s de bande passante totale grâce à sa technologie d'interconnexion, Ultra Accelerator Link.

Epyc Venise. AMD a non seulement parlé des GPU: il a également ses futurs processeurs pour les serveurs dans les centres de données en plein développement. L'EPYC Venise arrivera en 2026 et sera basé sur l'architecture Zen 6. Parmi les variantes, un particulièrement spectaculaire avec 256 cœurs qui offrira jusqu'à 70% de performances supplémentaires par rapport à la génération précédente. Ces processeurs seront construits avec un futur instinct du MI400. Ils devraient être fabriqués avec le nœud N2P (2 nm) de TSMC.

Helios contre Oberon. Le rack Helios susmentionné concurrencera le serveur NVIDIA IA actuel, le GB200 NVL72 qui connecte 36 CPU Grace et 72 GPU Blackwell. Il est destiné à rivaliser avec son successeur, qui a le nom de code d'Oberon et utilisera les GPU IA B300 avec Vera Rubin Architecture. Les rendements et les avantages de ces futurs racks sont absolument étourdis, et par exemple leur puissance de précision FP8 est de 1,4 exaflops.

La même chose dans certaines choses, mieux dans d'autres. AMD promet de faire correspondre NVIDIA en plusieurs sections, mais garantit également qu'il le dépassera remarquablement (50% de plus) en quantité et en largeur de mémoire, quelque chose de crucial pour la formation et l'inférence AI. Soyez prudent, car à la fin de 2027, Nvidia prépare la Rubin Ultra Architecture, qui promet des racks avec jusqu'à 5 exaflops en précision FP8, trois fois plus qu'Helios ou Oberon.

En 2027, nous aurons un autre « été ». La feuille de route AMD va plus loin et ils ont déjà préparé le développement de leur nouvelle génération de puces pour les serveurs EPYC d'été, qui remplaceront l'Epyc Venise. Ces processeurs seront associés à l'instinct MI500X futur, et il est prévu – bien qu'il ne soit pas sûr – que les deux types de puces profitent du nœud déjà annoncé A16 de TSMC (1,6 nm), qui commencera à être utilisé à la fin de 2026. Il n'y a pas de spécifications pour ces développements, parce qu'ils dépendront du nœud de fabrication que la DAMA finit par les utiliser.

Race frénétique. Toutes ces publicités montrent que AMD ne veut pas être laissée dans cette course pour placer leurs solutions dans les centres de données dans le monde. La Crusoe Company, dédiée à la construction de grands centres de données d'IA, a annoncé il y a quelques jours qu'il dépenserait 400 millions de dollars sur les puces d'AMD, et même Sam Altman, PDG d'Openai, a fait une apparition surprise lors de la conférence d'ouverture de la Lisa Su, PDG de l'AMD Event. Altman a déclaré qu'ils utiliseraient également des puces AMD dans les centres de données qu'ils utilisent et ont souligné que les nouveaux GPU d'AMD « vont être incroyables ».

AMD suppose être plus efficace (et bon marché). Le message d'AMD était clair pendant l'événement: son MI355 offre beaucoup plus d'efficacité et est moins cher que NVIDIA B200 et GB200 avec des rendements comparables. Les prix de vente de ces GPU ne sont pas connus, mais nous savons qu'au début de 2024, l'AMD MI300X a coûté un maximum de 15 000 $ pour plus de 40 000 $ qui coûtent au NVIDIA H100.

Le plus grand défi est toujours Cuda. Les avantages des puces AMD AI ne sont en fait pas le problème de cette entreprise. Des études détaillées ont révélé il y a des mois que le MI300X est clairement plus élevé que NVIDIA H100 et H200 sur les performances et la puissance. Cependant, Nvidia a un CUDA, la norme de facto dans l'industrie pour les services et les applications de l'IA. L'utilisation du logiciel natif d'AMD est possible, oui, mais l'expérience logicielle, ils ont assuré en semianalyse, « le logiciel est plein d'erreurs qui font la formation (modèles d'IA) avec AMD avec AMD est impossible. »

L'espoir d'AMD est Rocm. À cet événement AMD, a également présenté ROCM 7, la dernière version de sa propre plate-forme de programmation open source pour ses GPU. Dans AMD, ils ont indiqué que cette version est 3,5 fois plus puissante que ROCM 6, et affirment même qu'elle est 30% plus puissante que CUDA dans le B200 lors du service du modèle Deepseek R1. Même ainsi, ils indiquent dans un autre rapport semi-santé, il est toujours plus bas dans certaines sections. Obtenir ce composant permet aux développeurs de profiter de tout le potentiel des puces d'AMD est précisément la clé de l'avenir de ces efforts. Encore plus que le matériel, AMD doit désormais presser le logiciel.

Image | DMLA

Dans Simseo | Le directeur général d'AMD est en Chine dans un seul but: arracher le marché de l'IA à Nvidia