l'a fait avec des modèles d'IA de poche prometteurs

Les derniers modèles d'OpenAI, d'Anthropic ou de Google sont fantastiques, sans aucun doute, mais ils ont un problème : ils sont gigantesques, donc la seule façon de les utiliser est d'utiliser les chatbots de ces entreprises. Mais alors que ces entreprises se concentrent sur cette approche, Alibaba vient de nous surprendre avec quelque chose de fascinant.

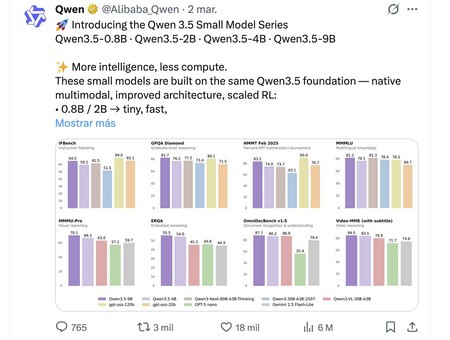

L’attrait des petits modèles d’IA. Ce géant chinois de la technologie vient de lancer la famille des « Qwen 3.5 Small Models », composée de quatre variantes de modèles ouverts aux très petites tailles. Ainsi, nous avons un modèle « nain » à 800 millions de paramètres (0,8B), un autre à 2 milliards (2B), un troisième à 4 milliards (4B) et le dernier à 9 milliards (9B). Il n'existe pas de chiffres officiels sur le nombre de paramètres pour GPT 5.3, Opus 4.6 ou Gemini 3.1, mais il est très probable qu'ils se situent tous autour de 500 milliards ou bien plus.

Petit mais dur. Les deux premiers modèles sont conçus pour le prototypage et le déploiement dans des appareils très modestes et dans lesquels l'autonomie des batteries est une priorité, car leur consommation est également très serrée. Pendant ce temps, Qwen3.5-4B est un modèle multimodal pour les agents d'IA légers qui prend en charge une fenêtre contextuelle allant jusqu'à 262 144 jetons. Ce dernier, par exemple, a une taille inférieure à 3 Go dans sa version quantifiée 4 bits, ce qui le rend utilisable même sur les téléphones mobiles. L' »aîné » de la famille est encore plus intéressant.

Les meilleures essences… Le dernier de ces modèles, le Qwen3.5-9B, est vraiment prometteur. C'est un modèle de raisonnement qui, selon ses créateurs, ne surpasse rien de moins que gpt-oss-120B, le modèle ouvert OpenAI qui est 13,5 fois plus grand et qui était jusqu'à présent une grande référence dans ce domaine. Tous ces modèles sont des poids ouverts et peuvent être trouvés à la fois sur Hugging Face et ModelScope dans leurs différentes variantes.

Une nouvelle approche. Dans ces modèles, Alibaba a apporté quelques modifications et utilise ce qu'ils appellent une architecture hybride efficace dans laquelle ils combinent un nouveau type d'algorithmes d'attention (Gated Delta Networks) avec le mélange d'experts (MoE) déjà connu. Cette approche permet d'éviter le problème du « mur de mémoire » qui affecte les petits modèles.

Des retours prometteurs. Les résultats des benchmarks publiés par Alibaba sont vraiment frappants. Qwen3.5-4B et Qwen3.5-9B font tous deux un bond notable en termes d'efficacité, en particulier dans les tests multimodaux (ces modèles sont capables d'utiliser des images en entrée) et dans les tâches de raisonnement. Ainsi, dans le test de raisonnement visuel MMMU-Pro, Qwen3.5-9B a laissé Gemini 2.5 Flash lite derrière lui, et dans le test de raisonnement GPQA, le modèle Alibaba 9B a même réussi à laisser gpt-oss-120b derrière lui.

Alibaba se surpasse. Paul Couvert, vulgarisateur de l'IA, a montré son enthousiasme dans

Des modèles pour votre ordinateur portable et votre mobile. Ces modèles sont particulièrement frappants car ils offrent la possibilité à pratiquement tout le monde de les utiliser sur leur ordinateur portable ou leur téléphone portable (ou intégrés dans un navigateur !). Dans tous les cas, les avantages sont clairs : vous ne dépendez pas du cloud, vous pouvez donc les utiliser hors ligne, et nos conversations ne passent par aucun serveur, donc « tout reste à la maison » et lorsque vous utilisez ces modèles, les chats sont privés.

Seul Google semble emboîter le pas. Parmi les majors occidentales de l’IA, seul Google semble s’intéresser aux petits modèles. Gemma 3 270M était une version étonnante sortie en août 2025. Microsoft a également son Phi-4 de décembre 2024, mais au-delà de cela, il existe peu d'exemples. OpenAI a publié gpt-oss-20B et gpt-oss-120B en août 2025 et a montré un certain intérêt pour ce type de scénarios, mais il n'y a eu aucune nouvelle depuis. Il existe des startups comme Liquid qui ont un LFM2.5 frappant avec une variante de seulement 1,2 milliard, mais ici Alibaba semble imparable avec son engagement envers les petites entreprises. Du moins, pour l'instant.

À Simseo | Si la question est de savoir laquelle des grandes entreprises technologiques remporte la course à l’IA, la réponse est : aucune.