Des chercheurs dévoilent la toute première défense contre les attaques cryptanalytiques contre l’IA

Les chercheurs en sécurité ont développé le premier mécanisme de défense fonctionnel capable de protéger contre les attaques « cryptanalytiques » utilisées pour « voler » les paramètres du modèle qui définissent le fonctionnement d'un système d'IA.

« Les systèmes d'IA constituent une propriété intellectuelle précieuse, et les attaques par extraction de paramètres cryptanalytiques constituent le moyen le plus efficace, le plus efficace et le plus précis de « voler » cette propriété intellectuelle. Jusqu'à présent, il n'existait aucun moyen de se défendre contre ces attaques. Notre technique protège efficacement contre ces attaques », déclare Ashley Kurian, titulaire d'un doctorat. étudiant à l'Université d'État de Caroline du Nord et premier auteur d'un article sur les travaux actuellement disponibles sur le arXiv serveur de préimpression.

« Les attaques cryptanalytiques se produisent déjà, et elles deviennent de plus en plus fréquentes et plus efficaces », déclare Aydin Aysu, auteur correspondant de l'article et professeur agrégé de génie électrique et informatique à NC State. « Nous devons mettre en œuvre des mécanismes de défense maintenant, car il est trop tard après l'extraction des paramètres d'un modèle d'IA. »

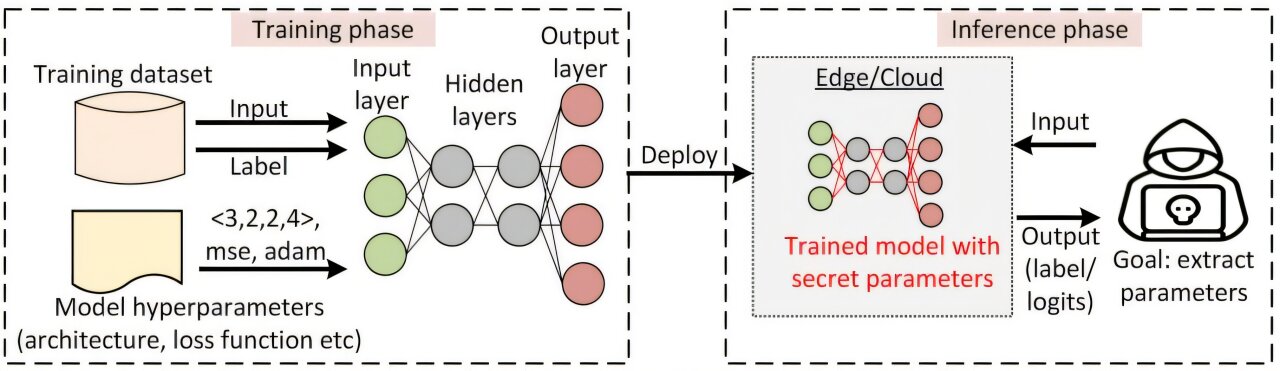

Le problème concerne les attaques d’extraction de paramètres cryptanalytiques. Les paramètres sont les informations essentielles utilisées pour décrire un modèle d’IA. Essentiellement, les paramètres correspondent à la manière dont les systèmes d’IA effectuent des tâches. Les attaques d'extraction de paramètres cryptanalytiques sont un moyen purement mathématique de déterminer quels sont les paramètres d'un modèle d'IA donné, permettant à un tiers de recréer le système d'IA.

« Dans une attaque cryptanalytique, quelqu'un soumet des entrées et examine les sorties », explique Aysu. « Ils utilisent ensuite une fonction mathématique pour déterminer quels sont les paramètres. Jusqu'à présent, ces attaques n'ont fonctionné que contre un type de modèle d'IA appelé réseau neuronal. Cependant, de nombreux systèmes d'IA commerciaux, sinon la plupart, sont des réseaux de neurones, y compris de grands modèles de langage tels que ChatGPT. »

Alors, comment se défendre contre une attaque mathématique ?

Le nouveau mécanisme de défense repose sur une connaissance clé des chercheurs concernant les attaques d’extraction de paramètres cryptanalytiques. En analysant ces attaques, les chercheurs ont identifié un principe fondamental sur lequel s’appuie chaque attaque. Pour comprendre ce qu’ils ont appris, vous devez comprendre l’architecture de base d’un réseau neuronal.

L’élément fondamental d’un modèle de réseau neuronal est appelé « neurone ». Les neurones sont disposés en couches et sont utilisés en séquence pour évaluer et répondre aux données d'entrée. Une fois les données traitées par les neurones de la première couche, les sorties de cette couche sont transmises à une deuxième couche. Ce processus se poursuit jusqu'à ce que les données aient été traitées par l'ensemble du système, moment auquel le système détermine comment répondre aux données d'entrée.

« Ce que nous avons observé, c'est que les attaques cryptanalytiques se concentrent sur les différences entre les neurones », explique Kurian. « Et plus les neurones sont différents, plus l'attaque est efficace. Notre mécanisme de défense repose sur la formation d'un modèle de réseau neuronal de manière à rendre les neurones de la même couche du modèle similaires les uns aux autres. Vous pouvez le faire uniquement dans la première couche, ou sur plusieurs couches. Et vous pouvez le faire avec tous les neurones d'une couche, ou seulement sur un sous-ensemble de neurones. «

« Cette approche crée une 'barrière de similarité' qui rend difficile la poursuite des attaques », explique Aysu. « L'attaque n'a essentiellement aucune voie à suivre. Cependant, le modèle fonctionne toujours normalement en termes de capacité à accomplir les tâches qui lui sont assignées. »

Lors des tests de validation de principe, les chercheurs ont découvert que les modèles d'IA intégrant le mécanisme de défense présentaient un changement de précision inférieur à 1 %.

« Parfois, un modèle recyclé pour incorporer le mécanisme de défense était légèrement plus précis, parfois légèrement moins précis, mais le changement global était minime », explique Kurian.

« Nous avons également testé le fonctionnement du mécanisme de défense », explique Kurian. « Nous nous sommes concentrés sur les modèles dont les paramètres étaient extraits en moins de quatre heures à l'aide de techniques cryptanalytiques. Après un recyclage pour intégrer le mécanisme de défense, nous n'avons pas pu extraire les paramètres avec des attaques cryptanalytiques qui ont duré plusieurs jours. »

Dans le cadre de ces travaux, les chercheurs ont également développé un cadre théorique pouvant être utilisé pour quantifier la probabilité de réussite des attaques cryptanalytiques.

« Ce cadre est utile car il nous permet d'estimer la robustesse d'un modèle d'IA donné face à ces attaques sans exécuter de telles attaques pendant des jours », explique Aysu. « Il est utile de savoir dans quelle mesure votre système est sécurisé ou non. »

« Nous savons que ce mécanisme fonctionne et nous sommes optimistes que les gens l'utiliseront pour protéger les systèmes d'IA contre ces attaques », déclare Kurian. « Et nous sommes ouverts à travailler avec des partenaires industriels intéressés par la mise en œuvre du mécanisme. »

« Nous savons également que les personnes qui tentent de contourner les mesures de sécurité finiront par trouver un moyen de les contourner : le piratage et la sécurité sont engagés dans un va-et-vient constant », explique Aysu. Nous espérons qu’il y aura des sources de financement qui permettront à ceux d’entre nous qui travaillent sur de nouveaux efforts de sécurité de suivre le rythme. »

L'article, intitulé « Train to Defend: First Defense Against Cryptanalytic Neural Network Parameter Extraction Attacks », sera présenté lors de la trente-neuvième conférence annuelle sur les systèmes de traitement de l'information neuronale (NeurIPS) qui se tiendra du 2 au 7 décembre à San Diego, en Californie.