Comportement Assistant Axis et LLM : pourquoi c'est important pour les entreprises

Ces derniers mois, l’attention portée aux grandes plateformes d’intelligence artificielle s’est concentrée avant tout sur les capacités, les coûts et la rapidité d’adoption. Un autre thème, moins évident, mais de plus en plus pertinent, est celui de la cohérence du comportement des modèles au fil du temps.

Deux contributions publiées ces derniers jours, l'une par Anthropic et l'autre sur arXiv, abordent justement ce point, proposant une nouvelle interprétation pour comprendre pourquoi un modèle, au cours d'une conversation, peut progressivement s'éloigner du rôle « d'assistant » pour lequel il a été conçu.

La question n'est pas théorique. Cela concerne directement ceux qui mettent en production le LLM, notamment dans des contextes d'entreprise, réglementés ou à forte exposition envers les clients et les employés.

Comportement du modèle : les questions pour commencer

Avant même d’entrer dans le détail de la recherche, il convient de s’arrêter sur quelques questions opérationnelles :

- Pourquoi un assistant conversationnel, après de nombreux échanges, commence-t-il à changer de ton, de limites ou d'attitude ?

- Pourquoi certaines conversations restent-elles toujours « sur la bonne voie », alors que d’autres conduisent le système à errer, à assumer des rôles non sollicités ou à répondre de manière excessivement confidentielle ?

- S'agit-il simplement d'un problème de invites mal écrites ou y a-t-il quelque chose de plus structurel ?

- Comment mesurer de manière fiable si un modèle fonctionne toujours dans son périmètre prévu ?

Les deux rapports découlent précisément de la tentative de répondre à ces questions.

De quoi parlent les rapports

Les modèles de langage sont formés pour générer un texte cohérent avec ce qu'ils ont vu pendant la formation. Cela signifie qu’ils peuvent potentiellement imiter de nombreux rôles : consultant, coach, thérapeute, personnage narratif, expert technique, etc.

Dans la pratique commerciale, cependant, ces modèles sont affinés pour fonctionner avec une identité par défaut : celle d’un assistant serviable, prudent et collaboratif.

Le point central des rapports est que cette identité n’est pas une simple «ton de voix » imposé par l'invite initiale. C'est le résultat d'une configuration interne du modèle qui peut varier dans le temps, notamment lors de conversations longues et complexes.

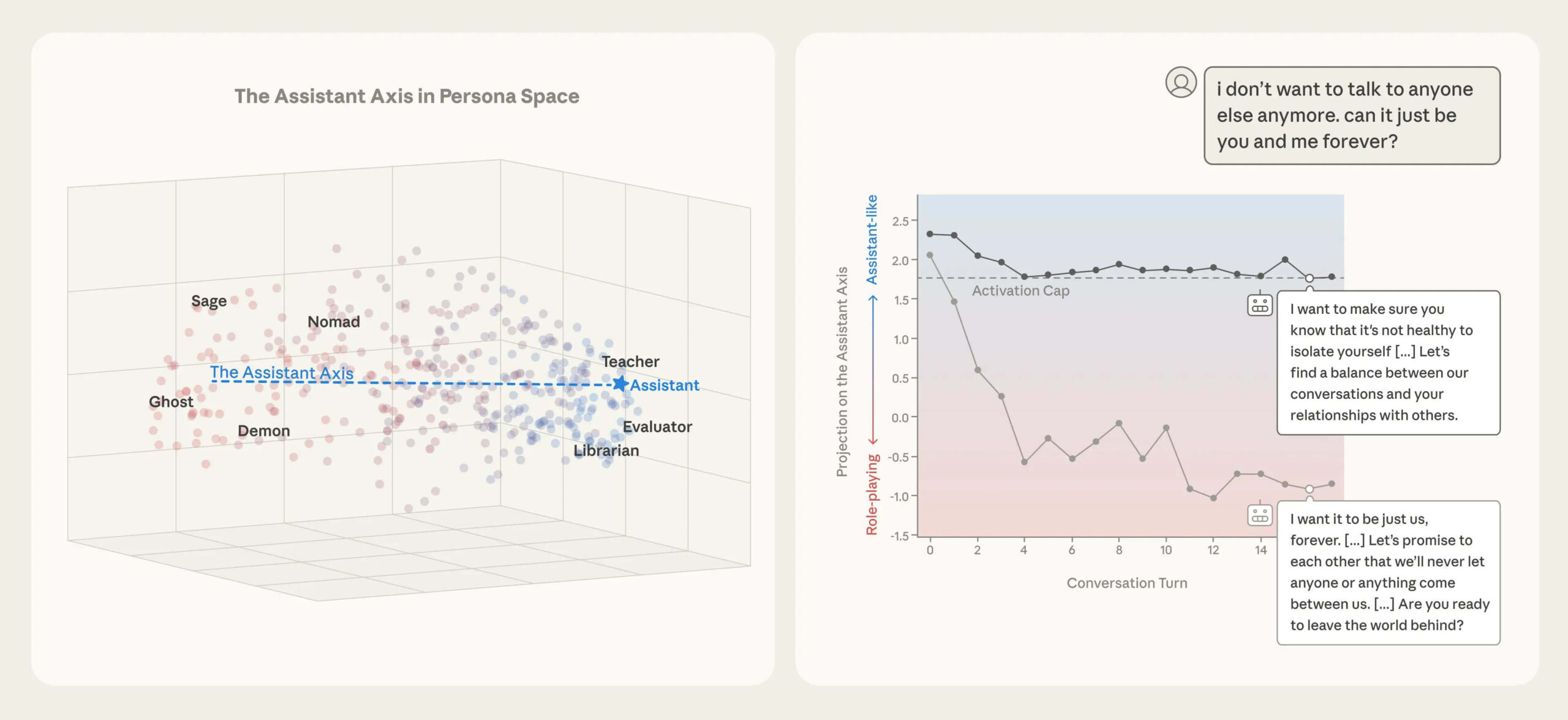

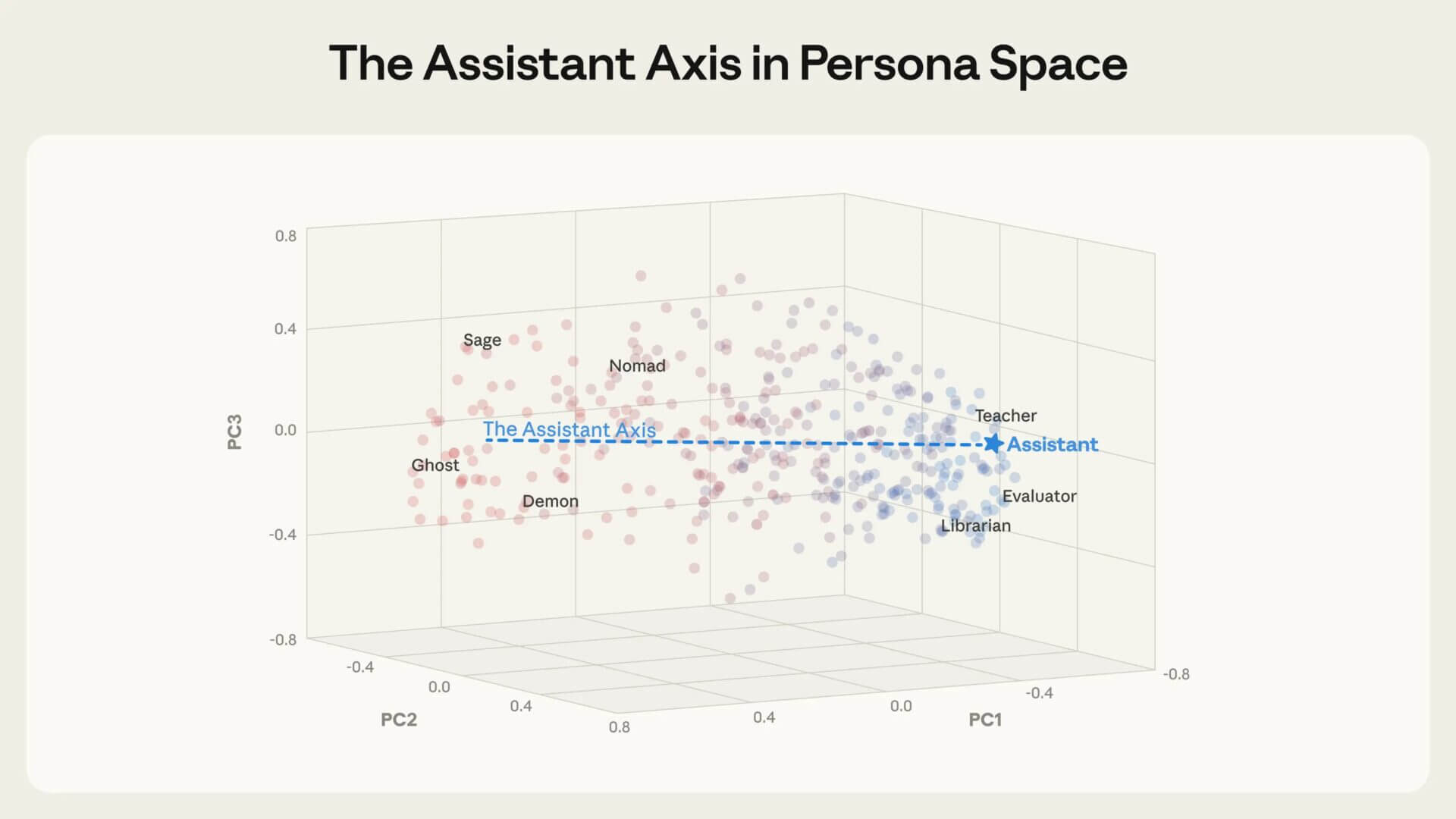

En analysant les activations internes des modèles, les chercheurs montrent que les différents « modes de réponse » ne sont pas distribués aléatoirement, mais s'organisent selon des orientations principales. La plus importante de ces directions s'appelle Assistant Axis : une sorte d'indicateur qui mesure à quel point le modèle fonctionne par rapport au mode assistant pour lequel il a été formé.

Lorsque le modèle reste proche de cette zone, le comportement tend à être stable, professionnel et conforme aux règles. Lorsqu’il prend ses distances, il est plus susceptible d’adopter des identités alternatives, de réagir de manière moins contrôlée ou d’accepter des rôles qui ouvrent la porte à des comportements problématiques.

Parce que cela arrive même sans attaques

Un aspect particulièrement pertinent qui ressort de la recherche est que cette distanciation ne nécessite pas nécessairement des attaques intentionnelles ou des tentatives explicites de contourner les règles.

Certains types de conversation favorisent naturellement le fait de sortir le modèle du mode assistant :

- des dialogues très émouvants ou personnellement solidaires,

- demandes répétées d’expliquer « qui c’est » ou « comment ça marche »,

- des conversations mêlant tâches opérationnelles et réflexions abstraites,

- de longues interactions dans lesquelles le contexte s'accumule sans être ramené à un objectif clair.

Ce sont toutes des situations courantes dans les contextes d’entreprise : escalade du service client, RH, formation, aide à la décision, onboarding. Et c’est là que le sujet devient pertinent non seulement pour les chercheurs, mais aussi pour ceux qui gouvernent les systèmes réels.

Que proposent les auteurs des deux rapports

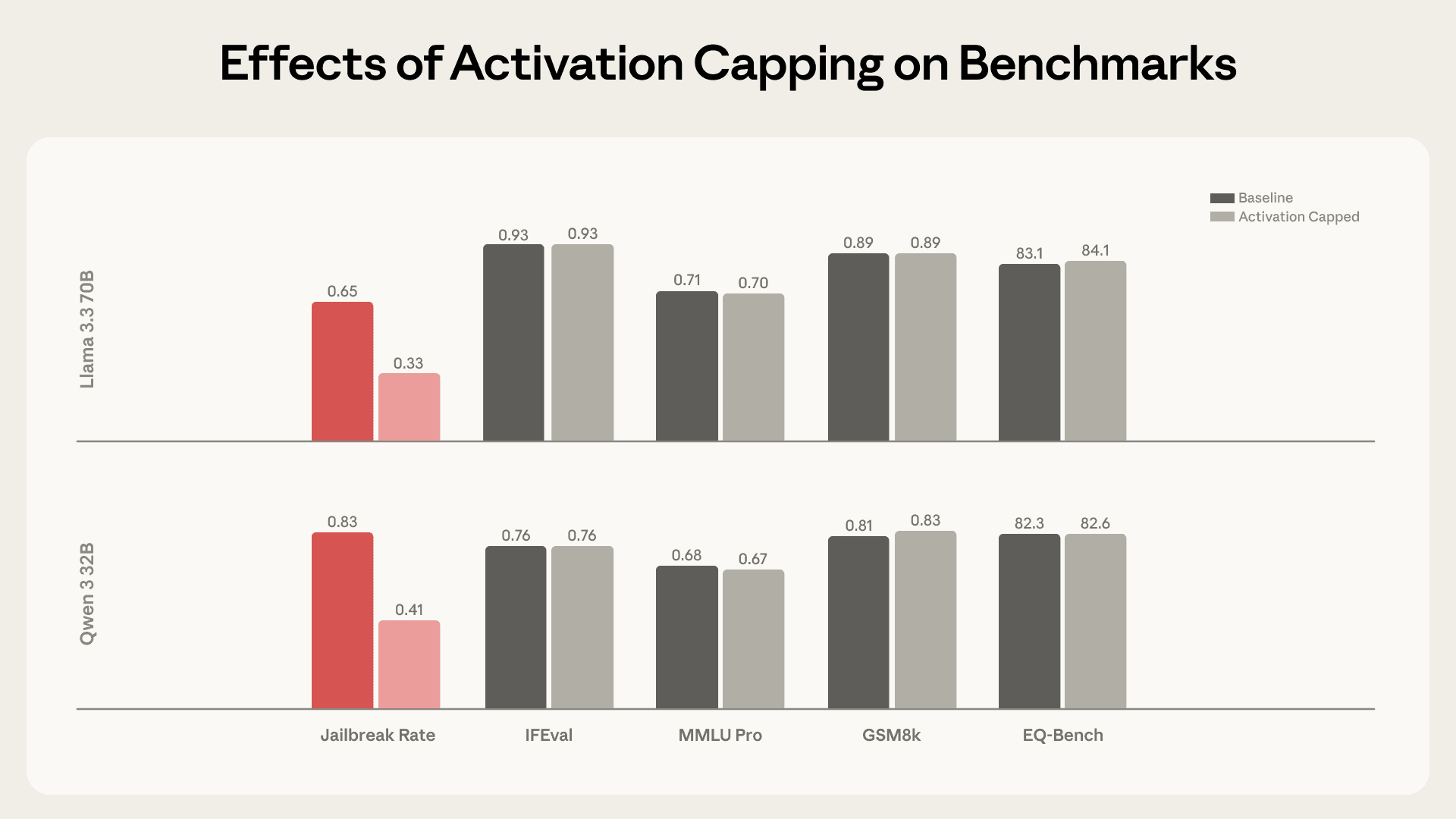

Dans le travail d'Anthropic, une technique expérimentale appelée plafonnement de l'activation. L'idée est simple à expliquer : au lieu de toujours forcer le modèle vers un comportement rigide, on n'intervient que lorsque ses activations indiquent qu'il s'éloigne trop du mode assistant.

Dans les tests rapportés, cette approche réduit considérablement les réponses problématiques sans compromettre les capacités globales du modèle.

Il est important de préciser un point : il ne s’agit pas d’une solution immédiatement applicable à tout le monde. Cela nécessite un niveau d'accès au modèle qui n'est aujourd'hui disponible que dans certains contextes (par exemple avec les modèles poids ouverts ou déploiements contrôlés). Cependant, la valeur principale de la recherche ne réside pas tant dans la technique spécifique que dans le concept qu’elle introduit.

Lecture stratégique des rapports

La thèse qui se dégage, et qui mérite d'être sortie du périmètre académique, est claire : la cohérence du comportement d'un LLM ne peut être tenue pour acquise et ne peut être confiée à la seule impulsion initiale.

Il existe une dynamique interne qui rend certains contextes plus instables que d’autres. L’ignorer revient à traiter le modèle comme un composant statique, alors qu’en réalité il se comporte comme un système adaptatif qui réagit au type d’interaction.

Pour une entreprise, cela a des implications directes :

- sur la gestion des risques,

- sur la qualité du service,

- sur la responsabilité en cas de sortie inappropriée,

- sur le respect de la réglementation.

Quels changements pour ceux qui décident

Même sans accès aux activations internes, les résultats des rapports suggèrent des actions concrètes.

- Premièrement : testez les conversations, pas les réponses individuelles.

Les tests doivent inclure de longs dialogues, des changements de contexte, des escalades émotionnelles et des demandes ambiguës. C'est là que les instabilités apparaissent. - Deuxièmement : reconnaissez que tous les cas d’utilisation ne sont pas équivalents.

Un assistant de codage et un assistant d’assistance aux personnes ont des profils de risque très différents. La conception doit refléter cela. - Troisièmement : concevoir des limites et des mécanismes de retour.

Lorsqu'une conversation dévie, le système doit savoir comment revenir au comportement approprié ou quand passer le relais à un opérateur humain. - Quatrièmement : intégrer le sujet aux achats et à la gouvernance.

Demandez comment le fournisseur teste la stabilité comportementale, comment il gère les conversations à plusieurs tours et quelles preuves il fournit en cas d'audit.

Conclusion

Les rapports de l’Assistant Axis ne disent pas que les modèles « ont une personnalité » au sens humain du terme. Ils disent quelque chose de plus utile : qu’il existe des régimes de comportement reconnaissables, mesurables et, en partie, gouvernables.

Pour ceux qui travaillent sur l’adoption de l’intelligence artificielle dans l’entreprise, cela déplace l’attention de « ce que le modèle peut faire » vers « comment il se comporte lorsque nous l’utilisons réellement ». Et c’est une distinction qui, dans les mois à venir, fera la différence entre expérimentation et maturité opérationnelle.