ChatGPT agit de manière plus altruiste et coopérative que les humains

L’intelligence artificielle moderne, telle que ChatGPT, est capable d’imiter les comportements humains, mais la première a des résultats plus positifs tels que la coopération, l’altruisme, la confiance et la réciprocité.

Dans une nouvelle étude de l’Université du Michigan publiée dans le Actes de l’Académie nationale des sciencesles chercheurs ont utilisé des tests de Turing « comportementaux » – qui testent la capacité d’une machine à présenter des réponses et une intelligence semblables à celles des humains – pour évaluer la personnalité et le comportement d’une série de chatbots IA.

Les tests impliquaient ChatGPT répondant à des questions d’enquête psychologique et jouant à des jeux interactifs. Les chercheurs ont comparé les choix de ChatGPT à ceux de 108 000 personnes provenant de plus de 50 pays.

L’auteur principal de l’étude, Qiaozhu Mei, professeur à l’École d’information et à la Faculté d’ingénierie de l’UM, a déclaré que le comportement de l’IA, car elle fait preuve de plus de coopération et d’altruisme, peut être bien adapté aux rôles nécessitant des négociations, la résolution de conflits, le service client et la prestation de soins.

Comment les gens devraient-ils réagir à cette information, d’autant plus que l’avenir nous dira dans quelle mesure l’IA améliore les humains plutôt que de les remplacer ?

Nous disposons désormais d’un moyen formel de tester les traits de personnalité et les tendances comportementales de l’IA. Il s’agit d’une manière scientifique d’observer comment ils font des choix et de sonder leurs préférences au-delà de ce qu’ils disent. ChatGPT présente des traits humains dans de nombreux aspects tels que la coopération, la confiance, la réciprocité, l’altruisme, la méchanceté, l’équité, la pensée stratégique et l’aversion au risque. À certains égards, ils agissent comme s’ils étaient plus altruistes et coopératifs que les humains. À cette fin, nos résultats sont plus optimistes qu’inquiétants.

Quelles différences vous et vos collègues attendiez-vous entre les chatbots et les personnes ?

Les modèles d’IA modernes sont de grandes boîtes noires. Lorsque nous comparons les chatbots avec les humains, nous ne pouvons souvent comparer que leurs résultats. Il y a eu de nombreux tests, par exemple pour savoir si l’IA peut tenir des conversations comme les humains, écrire des poèmes comme les humains ou résoudre des problèmes mathématiques comme les humains, et des similitudes ont été trouvées. Mais ces similitudes sont toutes basées sur ce qu’ils « disent », ce qui n’est pas surprenant puisque ces modèles d’IA sont tous conçus pour prédire ce qui est susceptible d’être dit ensuite.

Avant notre étude, il n’existait aucun moyen d’aller au-delà de ce qu’elles disent et de comprendre comment elles prennent leurs décisions, ce qui est crucial avant de pouvoir faire confiance à ces IA dans des tâches à enjeux élevés, comme les soins de santé ou les négociations commerciales. Il y a eu beaucoup de scepticisme quant au comportement de l’IA dans ces scénarios.

Quelles recherches futures peuvent s’appuyer sur cela ? Où allons-nous à partir d’ici?

Nos recherches bénéficient de la force conjointe de l’informatique et de l’économie comportementale. Nous intégrons les jeux classiques de l’économie comportementale dans le test classique de l’IA : le test de Turing. Nous comparons également les réponses de l’IA lors de ces tests aux réponses d’une population diversifiée de joueurs humains.

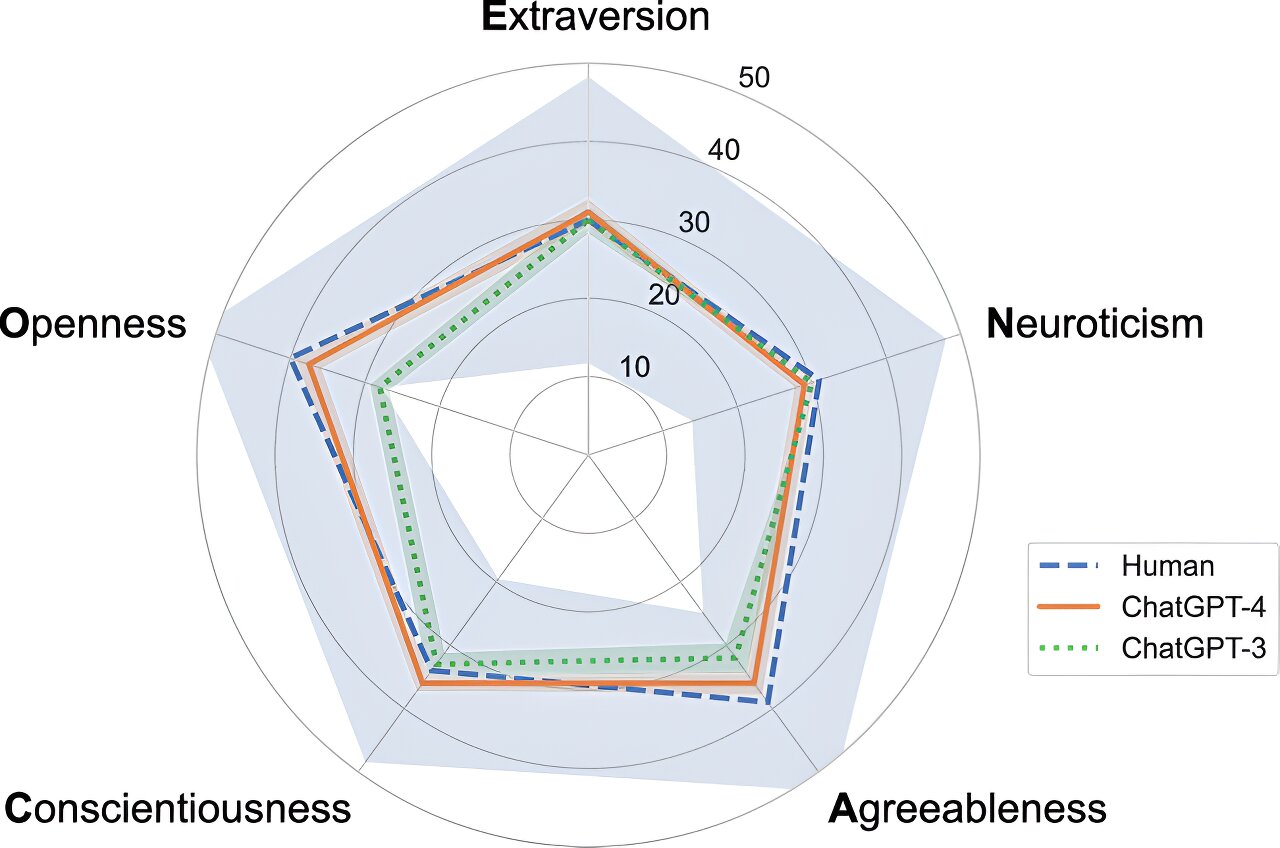

Une recherche future évidente à court terme consiste à ajouter davantage de tests comportementaux, à tester davantage de modèles d’IA et à comparer leurs personnalités et leurs traits. Une orientation future cruciale consiste à éduquer les IA afin que leurs comportements et préférences puissent représenter la diversité de la répartition humaine (plutôt qu’un « humain moyen »).

À long terme, nous espérons que l’étude ouvrira un nouveau domaine, la « science comportementale de l’IA », dans lequel des chercheurs de différentes disciplines pourront travailler ensemble pour étudier les comportements de l’IA, leurs relations avec les humains (par exemple, comment faciliter leur collaboration plutôt que leur compétition) et leurs relations avec les humains. impact sur la société future.

Dans quels domaines cette similitude serait-elle utile aux gens ?

Cela aide les gens à comprendre quand et comment nous pouvons compter sur l’IA pour nous aider à prendre des décisions. De manière générale, les résultats devraient accroître la confiance des gens dans l’IA pour certaines tâches. Par exemple, savoir que ChatGPT est plus altruiste et coopératif que la moyenne des humains pourrait accroître notre confiance dans son utilisation à des fins de négociation, de résolution de litiges ou de prestation de soins.

D’un autre côté, savoir que ses personnalités et ses préférences sont beaucoup plus étroites que la répartition humaine nous aide à comprendre leurs limites dans les tâches où la diversité des préférences humaines est cruciale à prendre en compte, comme la conception de produits, l’élaboration de politiques ou l’éducation.