Anthropic était le « ne soyez pas méchant » de l’IA pour les développeurs. Maintenant, il les serre tous

Claude Code et Claude Opus 4.6 ont déclenché un âge d’or pour les développeurs, qui se sont retrouvés avec un fantastique agent et modèle d’IA pour leur travail. Soudain, OpenAI n’était plus l’entreprise à la mode : Anthropic l’était, qui est tombée amoureuse des utilisateurs et des développeurs et est devenue la coqueluche de l’IA. Des mois plus tard, nous voyons comment Anthropic apporte des changements qui sont très critiqués et qui pointent vers quelque chose que nous avons déjà vu à plusieurs reprises : les plateformes vous conquièrent et inévitablement ensuite les plateformes vous pressent.

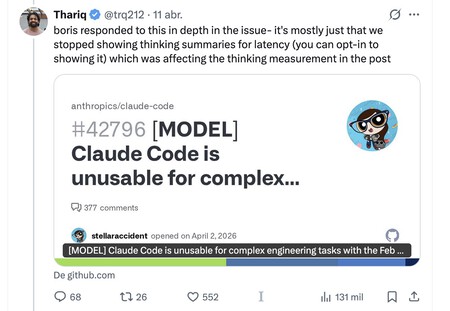

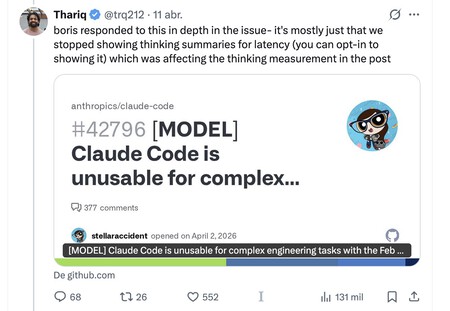

Le déclencheur. Le 2 avril 2026, Stella Laurenzo, directrice principale du groupe IA d’AMD, a publié un article sur le référentiel GitHub de Claude Code intitulé « Claude Code est inutile pour les tâches d’ingénierie complexes avec les mises à jour de février ». Cette directive comprenait une analyse méticuleuse de près de 6 600 sessions réelles de Claude Code avec près de 235 000 appels d’outils et environ 18 000 blocs de raisonnement dans quatre projets différents. Les conclusions lui paraissaient évidentes : les performances de Claude Code et Claude Opus 4.6 s’étaient dégradées.

Les chiffres. Dans cette analyse, deux périodes sont présentées selon Laurenzo. Au cours de la bonne période, de janvier à mi-février, le modèle lisait 6,6 fichiers pour chaque fichier édité. Au cours de la période théoriquement dégradée, à partir de mars, ce taux est tombé à 2,0 fichiers lus.

Les modifications de code dans les fichiers que Claude n’avait pas récemment examinés sont passées de 6,2 % à 33,7 % : une modification du code sur trois était effectuée « à l’aveugle ». De plus, la visibilité du raisonnement a été réduite, passant de 2 200 caractères à seulement 600 en moyenne, mais il y a quelque chose de plus. Les coûts du processus ont été multipliés par 122 au cours de la même période, même s’il est vrai que pendant cette période, ils sont passés de l’utilisation de 1 à 3 agents simultanés à l’utilisation de 5 à 10, ce qui complique l’interprétation des données.

Anthropic tente de clarifier ce qui s’est passé. La réponse officielle d’Anthropic a été publiée par Boris Cherny, responsable de Claude Code. Cet ingénieur a confirmé deux changements réels dans le produit : le 9 février, l’Opus 4.6 est passé par défaut à l’utilisation du « raisonnement adaptatif ». Le 3 mars, le niveau d’effort par défaut est passé de élevé à moyen, se situant au niveau 85, qu’Anthropic décrit comme « le meilleur équilibre entre intelligence, latence et coût pour la plupart des utilisateurs ».

Débat clos. Cherny a également évoqué le soupçon selon lequel Claude cachait désormais « ce qu’il pensait ». Il a expliqué que le changement dans les enregistrements de raisonnement visibles ne constitue pas une véritable dégradation et que l’en-tête détecté était simplement une modification de l’interface utilisateur qui masquait le raisonnement intermédiaire afin de réduire la latence sans affecter les performances du modèle. Laurenzo elle-même avait déjà prévu quelque chose comme ça et avait essayé de mettre en œuvre des solutions pour l’éviter, mais ses données ont confirmé cette baisse de performance. Cherny a clôturé le débat comme si le problème avait été résolu, mais il ne semble pas que ce soit réellement le cas.

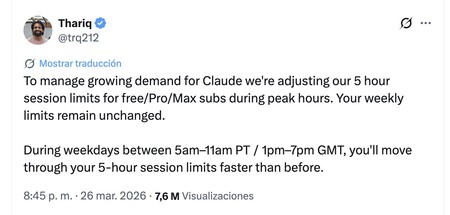

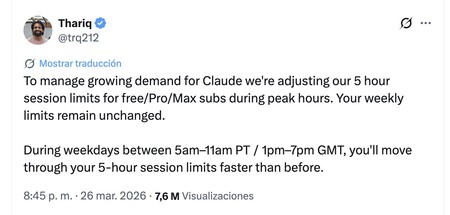

Crise de capacité informatique. Thariq Shihipar de l’équipe de Claude Code a révélé en mars qu’Anthropic ajustait les limites de session à 5 heures aux heures de pointe. C’est-à-dire : s’il y avait beaucoup de demande, vos jetons Claude s’épuiseraient probablement plus rapidement. Il a noté que la mesure ne serait en réalité remarquée que par 7 % des utilisateurs (le plus intensif pendant ces heures de pointe), et a avoué : « Je sais que c’est frustrant. Nous continuerons à investir dans l’efficacité. Ceci est contredit par un commentaire lors du débat sur le post de Laurenzo dans lequel il expliquait que « nous ne dégradons pas nos modèles pour mieux répondre à la demande, je l’ai déjà dit à plusieurs reprises ».

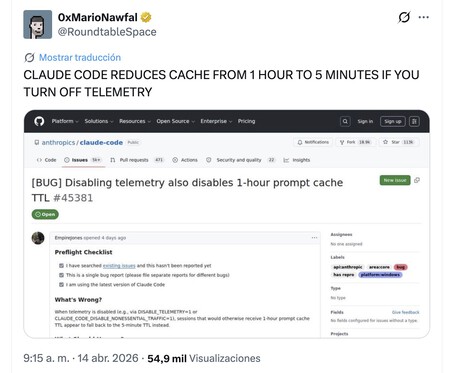

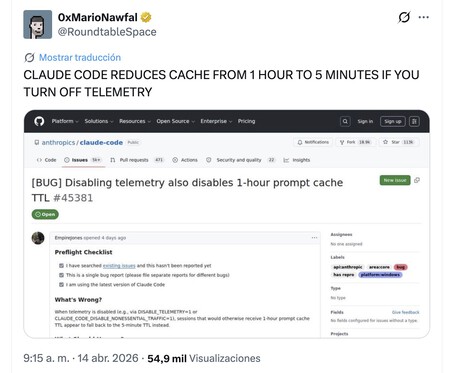

Plus de dégradations. D’autres découvertes et critiques sont apparues, comme la façon dont le cache d’invites de Claude Code avait également été drastiquement réduit (d’une heure à cinq minutes), déclenchant une consommation de quotas dans les longues sessions de programmation. Anthropic a déclaré à VentureBeat que les comptes Team et Enterprise ne sont pas affectés par ces limites de session, mais le schéma semble de plus en plus clair : l’informatique est rare et doit être rationnée… ou du moins c’est ce que semblent indiquer toutes ces mesures Anthropic. Ce qui reste incertain, c’est si la qualité du modèle a réellement été dégradée, bien qu’il existe également des « mégathreads » de Reddit qui pointent dans cette direction.

« Nerfing », rien. Lorsqu’une entreprise dégrade délibérément son service, cela est souvent qualifié de « nerfing » sur les réseaux sociaux, et les critiques en ce sens sont montées en flèche dans le cas d’Anthropic. De nombreuses publications d’utilisateurs sur X et dans les médias technologiques ont fait référence à l’étude de Laurenzo et ont accusé Anthropic de cette dégradation volontaire de ses modèles. Boris Cherny est intervenu dans au moins un cas pour dire catégoriquement : « C’est faux » et pour expliquer qu’ils avaient signalé les changements et donné en fait aux utilisateurs la possibilité de les désactiver.

Mais le rationnement existe. Dans le Wall Street Journal, ils ont confirmé que ce rationnement informatique se produit certainement parmi les plates-formes d’IA en raison de la forte demande. Nous avons un bon exemple des conséquences chez David Hsu, fondateur et PDG de Retool. Il a expliqué dans ledit journal que même s’il préférait Claude Opus 4.6 pour alimenter son agent IA, il a récemment dû passer au modèle OpenAI car « Anthropic plante tout le temps ».

Les prix changent (en silence). L’information a indiqué hier qu’Anthropic modifiait la façon dont il facture les utilisateurs des forfaits Entreprise. Au lieu d’un abonnement de 200 $ par mois avec un « forfait » pour l’utilisation de leurs modèles d’IA, ils factureront un tarif de base de 20 $ par utilisateur et par mois et à cela ils ajouteront la consommation de chaque utilisateur avec le prix standard de leur API. Sa propre documentation mise à jour le note (« L’utilisation n’est pas incluse dans le tarif par siège ») et on estime que le changement pourrait doubler, voire tripler le coût d’utilisation de Claude pour les gros utilisateurs. Les remises de 10 à 15 % sur l’API qui étaient incluses dans le passé et qui permettaient aux entreprises d’augmenter cette consommation de tokens de manière plus abordable disparaissent également. Les prix au million de tokens n’ont pas changé, mais nous sommes passés d’un modèle « forfaitaire » (avec frais d’utilisation) à un modèle de paiement à l’utilisation, beaucoup plus cher pour les gros utilisateurs.

Ce n’est pas seulement anthropique. Le mouvement de cette entreprise n’est pas quelque chose d’isolé. OpenAI a modifié les tarifs du Codex pour s’aligner sur l’utilisation de jetons API au lieu de la facturation par message. GitHub a publié dans son journal des modifications qu’il mettait à jour les limites pour équilibrer la capacité, car une utilisation intensive « provoque un stress sur notre infrastructure partagée ». En mars, la plateforme Windsurf a supprimé son système de crédit au profit de versements journaliers et hebdomadaires, ce qui a été critiqué par les développeurs qui utilisaient l’ancien système de facturation « flexible ». Replit a procédé à un changement similaire qui a également été largement commenté sur les réseaux sociaux.

L’open bar est terminé. Les entreprises d’IA se rendent compte que la demande augmente plus rapidement qu’elles ne peuvent le gérer, et elles ajustent la manière dont elles proposent leurs modèles et services pour répondre à cette demande. Le problème est que pour les utilisateurs et les développeurs, l’effet est le même : soit leurs jetons s’épuisent plus tôt, soit ils perçoivent que l’IA n’est plus aussi bonne qu’avant.

À Simseo | L’« économie symbolique » est brisée : les frais forfaitaires de programmation d’IA sont mathématiquement insoutenables