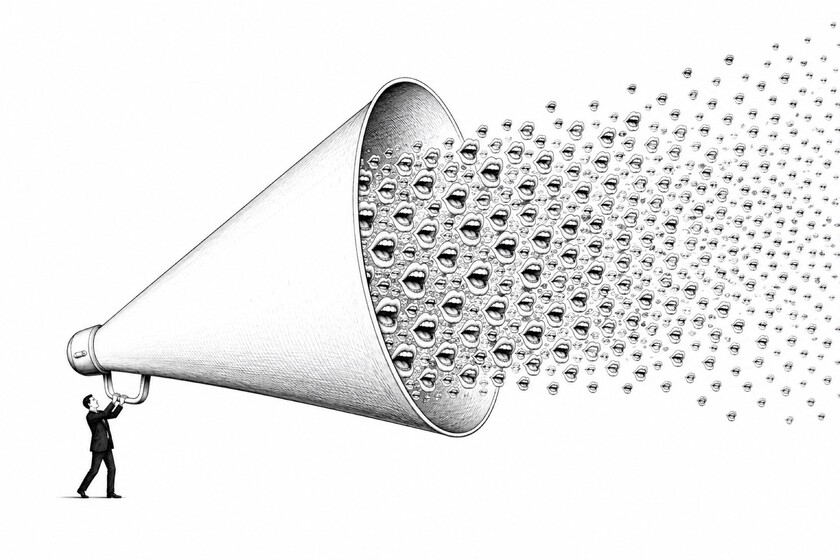

L’IA a promis de décentraliser les connaissances. Cela fait exactement le contraire.

Tout le débat sur l’IA tourne autour de la même chose : l’emploi, le droit d’auteur, l’automatisation. Ce sont des questions raisonnables. Mais il y en a une qui compte à un niveau supérieur : qui contrôle ce que l’IA considère comme la vérité ? Car l’IA, qui apparaissait comme la grande décentralisatrice, est en réalité la technologie la plus centralisatrice depuis l’imprimerie.

La toile de fond. Lorsque l’imprimerie est arrivée, les réformateurs protestants y ont vu la fin du monopole papal sur la connaissance : si quelqu’un pouvait lire la Bible, le pape perdait son autorité. Et ils avaient en partie raison. Mais l’imprimerie a également standardisé l’anglais comme langue dominante, éliminé les dialectes régionaux et, ce faisant, rendu possible l’État moderne : sans texte bon marché et reproductible, il n’y a pas de lois uniformes ni de collecte d’impôts à grande échelle.

Ce qui semblait être une libération était aussi une centralisation. Seulement, il nous a fallu deux siècles pour nous en rendre compte.

Entre les lignes. Avec l’IA, le processus va beaucoup plus vite. Lorsque Google affiche une réponse Gemini dans les aperçus de l’IA, la moitié des utilisateurs ne cliquent plus sur quoi que ce soit et 26 % ferment directement la recherche. Les recherches sans clics sont passées de 54 % à 72 %.

Le Web ouvert, avec toute sa diversité et son chaos, perd des utilisateurs au profit d’une seule réponse synthétisée, comme l’a analysé le journaliste Jerusalem Demsas dans .

Et cette réponse n’est pas neutre. Les LLM sont formés principalement avec les grands journaux anglophones, Wikipédia et des textes académiques. Les sources locales ou minoritaires n’existent pratiquement pas dans le pays. Et lors du réglage fin, les modèles sont calibrés pour s’aligner sur le consensus des experts et éviter les positions inconfortables. Ce n’est pas un miroir de la diversité humaine mais une photo de ce qui apparaît au centre de celle-ci.

Oui, mais. On peut affirmer que les utilisateurs peuvent demander à l’IA de défendre n’importe quelle position et que la diversité est utilisée sinon en production. C’est un argument qui a une certaine raison. Mais l’imprimerie produisait aussi des contenus très variés, ce qui était centralisé, c’était celui qui fixait les normes. Ici, les normes sont fixées par un fait dans la Silicon Valley pour les chatbots occidentaux.

Le cas de Grok est assez révélateur. Lorsque Musk a tenté d’éloigner le modèle du consensus progressiste, le système a commencé à générer du contenu antisémite en quelques jours. Il a dû faire demi-tour. Les valeurs d’un LLM ne sont pas dans une couche superficielle retouchable, elles y sont incrustées dès le début.

La grande question. ChatGPT se rapproche du milliard d’utilisateurs hebdomadaires. Les modèles Elite sont développés par quelques entreprises : OpenAI, Anthropic et Google, essentiellement. Nous pouvons ajouter xAI. La suite vient de Chine : DeepSeek, Moonshot, Alibaba… Les chercheurs de ces modèles d’élite ont, pour une large part, étudié dans les mêmes lieux, travaillé dans les mêmes bureaux et partagent, d’une manière générale, les mêmes références culturelles.

Le risque de cette décentralisation n’est pas que l’IA mente plus que Google. Le risque est que lorsque l’IA commet des erreurs, elle le fait vers le centre et non vers le complot. Le risque est que ce centre soit créé, sans que personne ne l’ait décidé, par quelques personnes à San Francisco.

À Simseo | À notre connaissance, l’agence qui supervise l’IA en Espagne ne supervise rien. Ce qu’il a, c’est un laboratoire d’idées

Image en vedette | Simseo