Il existe un truc appelé « Indice des prix Ornn », il est hors de contrôle et c’est une mauvaise nouvelle pour tout le monde.

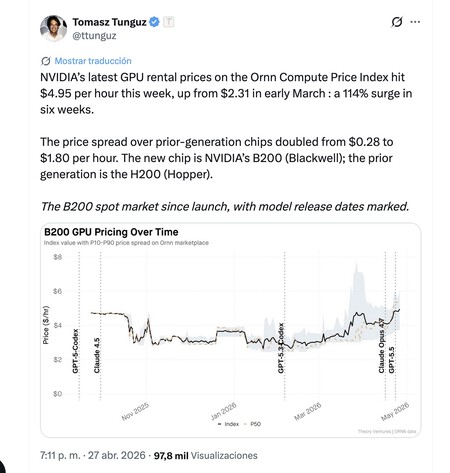

Cette semaine, un analyste nommé Tomasz Tunguz a publié deux graphiques révélateurs sur X. Ils montrent l’évolution de ce qu’il en coûte aux startups d’IA pour accéder au cloud computing, et il y a de mauvaises nouvelles. Le prix de location des GPU NVIDIA B200 avec architecture Blackwell est passé de 2,31 $ de l’heure début mars à 4,95 $ de l’heure cette semaine. Il s’agit d’une augmentation de 114% en seulement six semaines et elle a une cause claire : l’arrivée de nouveaux modèles d’Anthropic et OpenAI.

Ce que les graphiques montrent clairement. Ces graphiques se concentrent sur l’indice des prix d’Ornn, un marché commercial de cloud computing. Le premier d’entre eux couvre le prix de location des puces B200 de fin 2025 à aujourd’hui, et des lignes verticales montrent chaque version des derniers modèles d’OpenAI et d’Anthropic. La corrélation est presque parfaite : GPT-5 Codex, Claude 4.5, GPT-5.3 Codex, Claude Opus 4.7 et GPT-5.5 coïncident avec un bond des indices de prix. Chaque fois que ces entreprises annoncent une nouvelle version de leurs modèles Frontier, la demande monte en flèche, tout comme le coût.

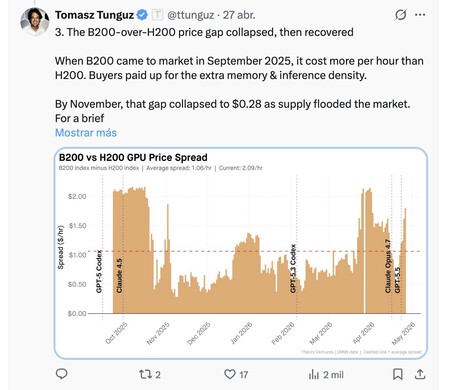

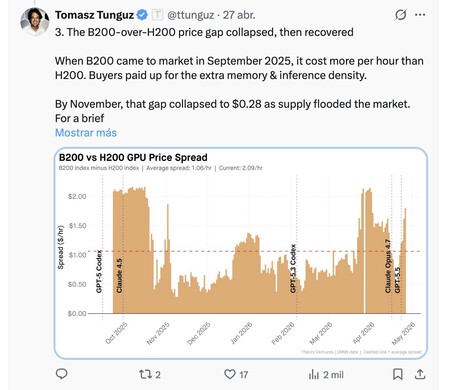

Si vous voulez le meilleur, payez (beaucoup plus). Le deuxième graphique montre la différence de prix entre la location de la génération précédente de puces, la H200 avec architecture Hopper, et la nouvelle B200. La moyenne historique de ce « spread » est de 1,06 $, mais elle s’élève désormais à 2,09 $, soit pratiquement le double. Cela signifie que les acheteurs – startups et sociétés d’IA – paient un prix record pour la mémoire supplémentaire et la puissance de calcul supérieure des puces à architecture Blackwell. Accéder aux dernières nouveautés était déjà coûteux. Aujourd’hui, c’est encore plus vrai. Cela fait également du H200 une option de seconde classe pour les modèles 2026 les plus exigeants.

Action et réaction. Il y a ici une logique écrasante. Lorsqu’OpenAI ou Anthropic publient un nouveau modèle, il y a une explosion d’inférence. Les développeurs et les entreprises souhaitent les tester au plus vite et intégrer ces modèles dans leurs produits (ou les concurrencer). Pour ce faire, ils ont besoin d’une informatique rapide, et une demande simultanée se produit qui déséquilibre l’inventaire disponible sur le marché de la location de puces IA à l’heure. Le problème est que l’offre de B200 n’augmente pas au même rythme. Certaines entreprises ont voulu anticiper, et nous en avons l’exemple parfait avec Google. Il a acheté tous les B200 qu’il pouvait, ce qui signifie que ces GPU coûtent désormais environ 500 000 $ sur le marché secondaire selon l’analyste Jack Minor.

L’ironie de l’efficacité. Ce qui est curieux, c’est que plus ces puces sont efficaces – et les B200 le sont – plus les entreprises souhaitent les louer en même temps pour profiter de ces avantages en termes d’efficacité qui devraient conduire à des économies de coûts. En réalité, la rareté de ces puces avancées annule toute économie théorique.

Contrats à long terme. Les startups et les entreprises qui pensent à court terme sont particulièrement lésées dans ce domaine, car elles sont confrontées à des hausses de prix de plus en plus difficiles à assumer. Les entreprises qui ont signé des contrats de location d’ordinateurs au prix d’alors peuvent désormais fonctionner à moins de la moitié du prix de leurs concurrents. Penser à moyen ou long terme semble raisonnable, même si, une fois de plus, ceux qui gagnent sont les hyperscalers et les entreprises qui ont réussi à s’emparer de nombreux B200. Et qui gagne encore plus, c’est bien sûr NVIDIA, qui n’y parvient pas.

Peu d’alternatives. Sur d’autres marchés comme l’énergie ou les métaux, il existe généralement une marge de manœuvre, souligne Tunguz, mais ce n’est pas le cas actuellement dans le segment de l’IA. Sur le marché pétrolier par exemple, si le prix augmente de 114 % en six semaines, les entreprises peuvent acheter des contrats à terme, des options ou des contrats d’approvisionnement à prix fixe pour protéger leurs marges. Dans la location de cloud computing, ces options sont beaucoup plus limitées. Et le résultat est un segment beaucoup plus volatil.

Cela ira plus loin. Nous sommes probablement confrontés à un pic de demande qui sera suivi d’une correction : le nouveau lot de puces B200 qui arrivera au second semestre 2026 devrait provoquer une baisse des prix actuels. Cependant, ces 4,95 $ constituent désormais le nouveau plancher, et non un sommet, car la demande en informatique IA continuera de croître plus rapidement que la capacité de production de TSMC. À moins que l’offre de puces d’IA ne se développe de manière significative – et il y a certainement des mouvements qui tentent d’y parvenir, comme Google avec ses TPU, Amazon avec son Trainium ou Huawei avec son Ascend – le problème restera là.

À Simseo | L’Europe prend son indépendance technologique tellement au sérieux qu’elle vise l’objectif le plus ambitieux : NVIDIA