Workspace Agent dans ChatGPT : OpenAI fait évoluer GPT pour les équipes

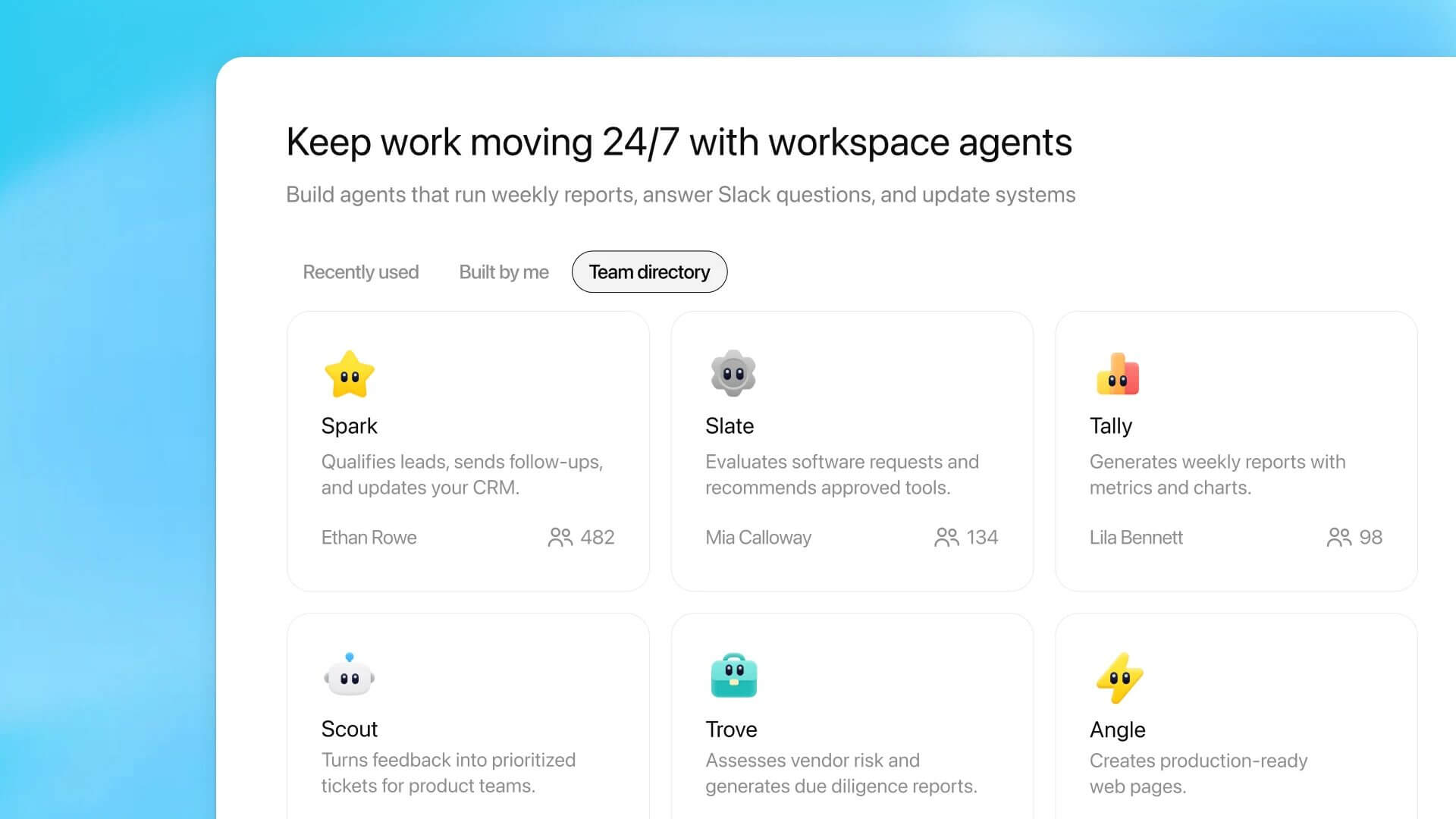

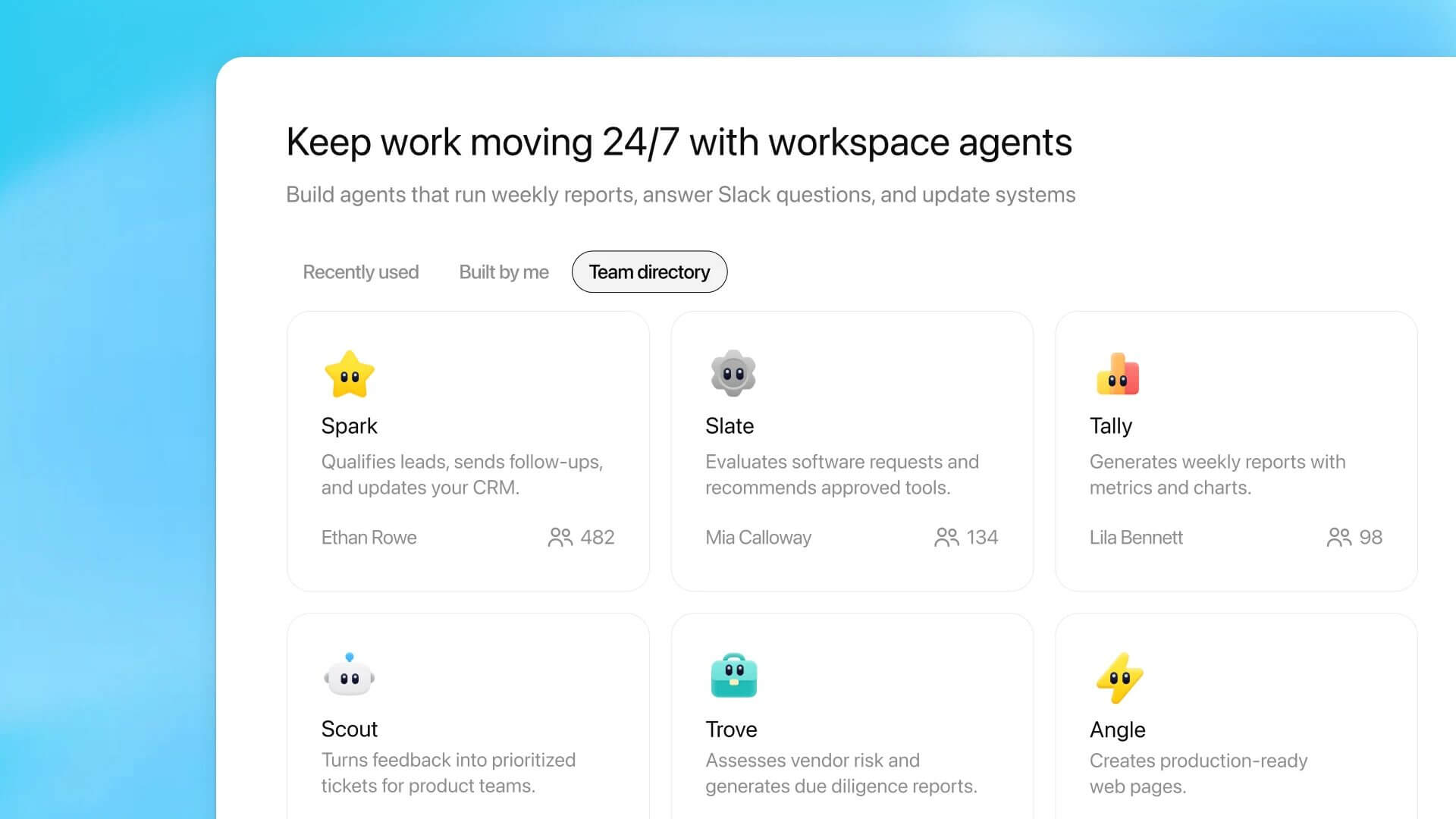

Alors que Google annonce son Workspace AI à partir de la plateforme Next ’26, OpenAI lance des agents d’espace de travail dans ChatGPT, décrits comme « l’évolution de GPT » et alimentés par le même moteur Codex.

Le lancement intervient après la semaine au cours de laquelle OpenAI a publié ChatGPT Images 2, Chronicle in Codex et Codex for Mac, et constitue une nouvelle étape dans la pression continue sur le marché des agents d’entreprise qui voit Microsoft avec Foundry Agent Service, Notion avec Custom Agents, Google avec Vertex Agent Builder, Anthropic avec Claude dans des environnements verticaux.

Le point de rupture par rapport aux GPT personnalisés est que les agents cessent d’être un outil individuel avec une longue invite et quelques fichiers joints, et deviennent des objets d’équipe. Chacun avec son propre espace de travail, sa propre mémoire persistante, un accès au code, aux fichiers et aux outils, une connexion directe à Slack où ils peuvent recevoir des demandes de manière indépendante et un panneau d’administration avec des contrôles basés sur les rôles qui contrôlent qui peut les créer et les partager avec quelles autorisations.

Ceux qui construisent des processus internes basés sur des GPT personnalisés se retrouvent aujourd’hui confrontés à une nouvelle surface sensiblement différente et à une question concrète : quand et comment cela vaut la peine de migrer.

OpenAI déclare qu’un convertisseur GPT en agent d’espace de travail est en route, mais en attendant, les deux choses coexistent et nous devons comprendre ce qui est bon pour quoi.

Ce qui change vraiment par rapport aux Custom GPT

La différence architecturale, lue dans les communiqués de presse et les détails techniques publiés, se joue sur trois axes. Le premier est la persistance, un GPT personnalisé est un modèle statique qui répond à chaque discussion à partir des mêmes instructions, un agent d’espace de travail, quant à lui, dispose d’une mémoire qui s’étend sur les sessions et peut accumuler du contexte, des corrections et des préférences d’équipe au fil du temps.

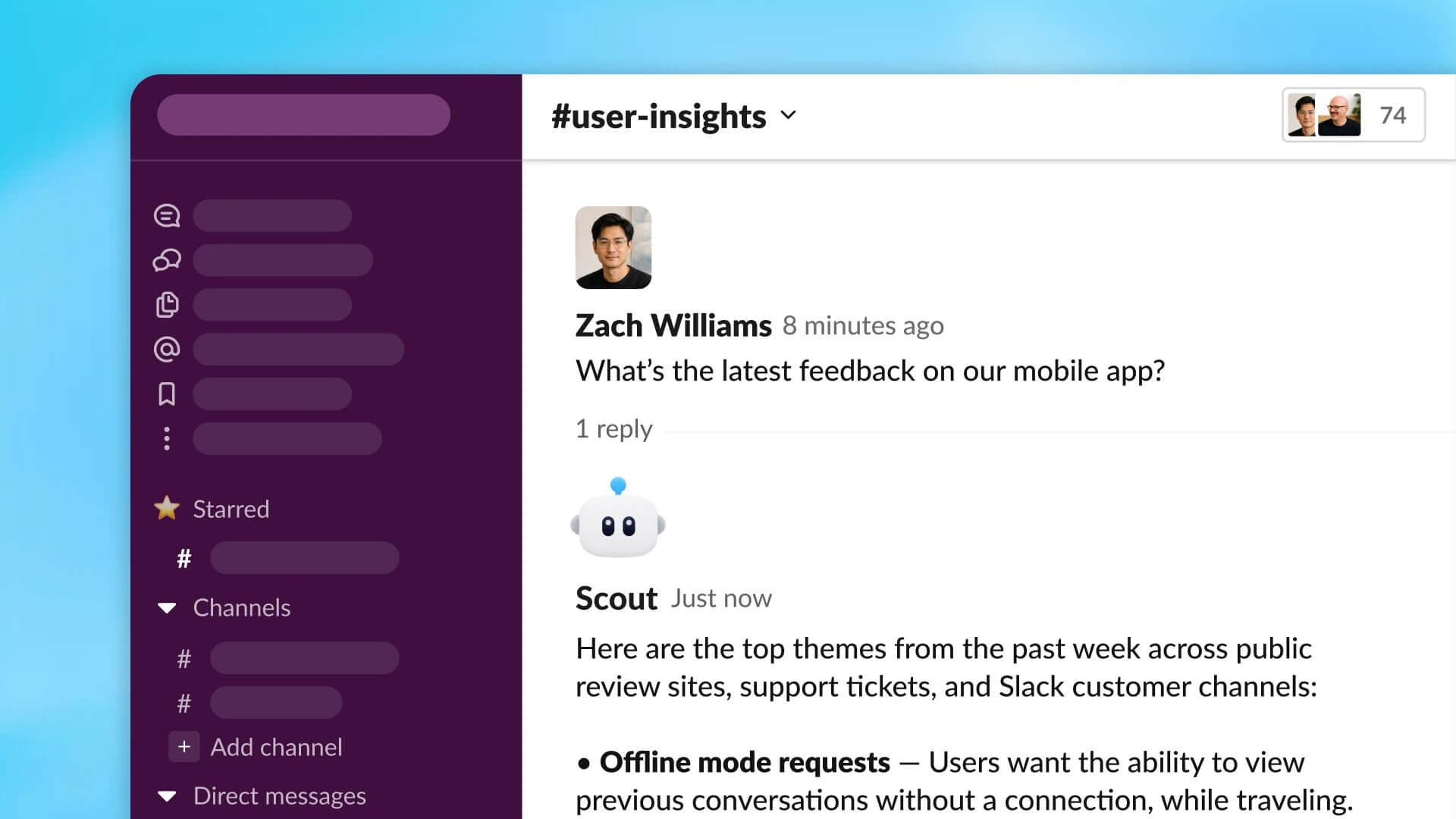

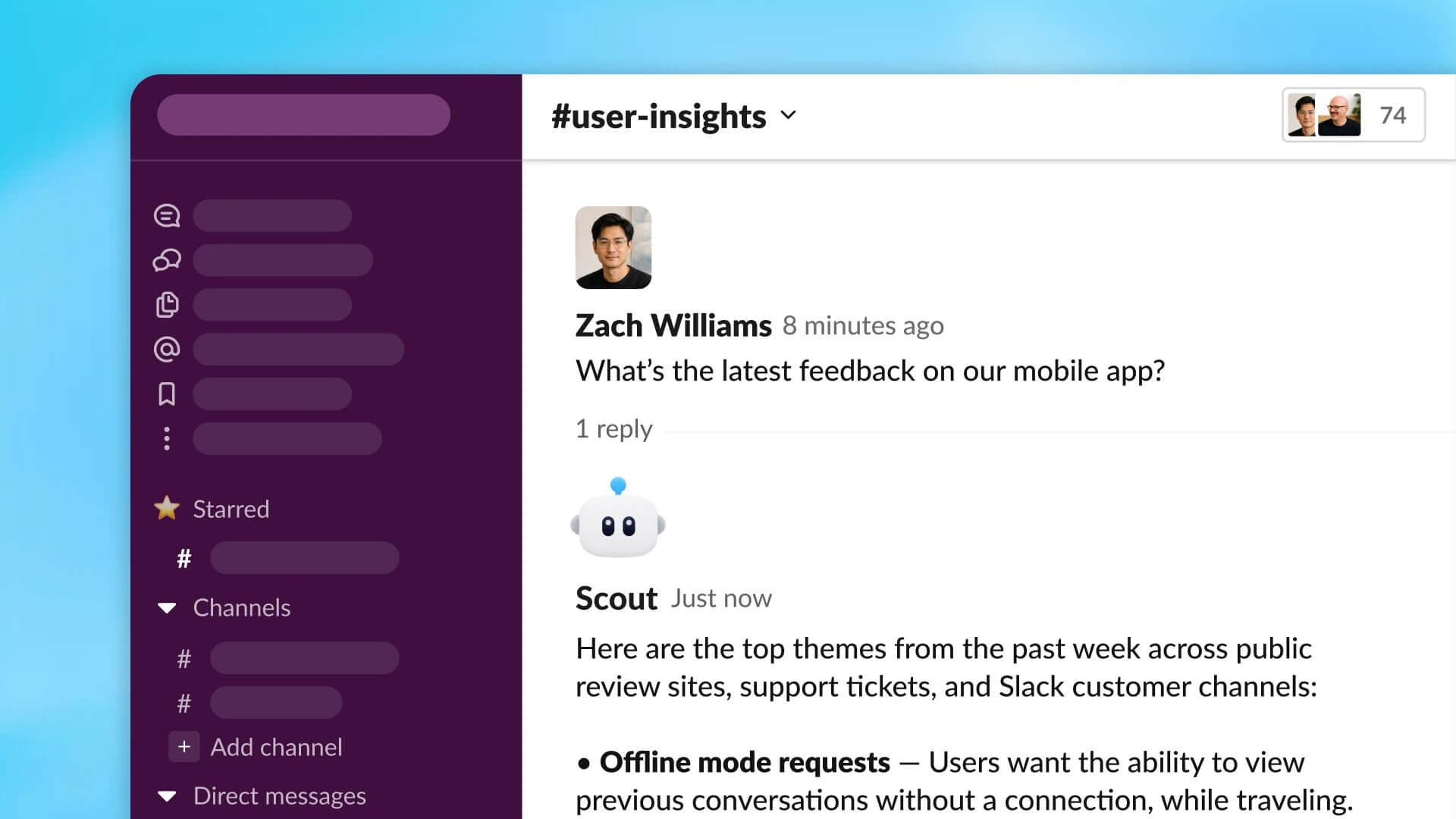

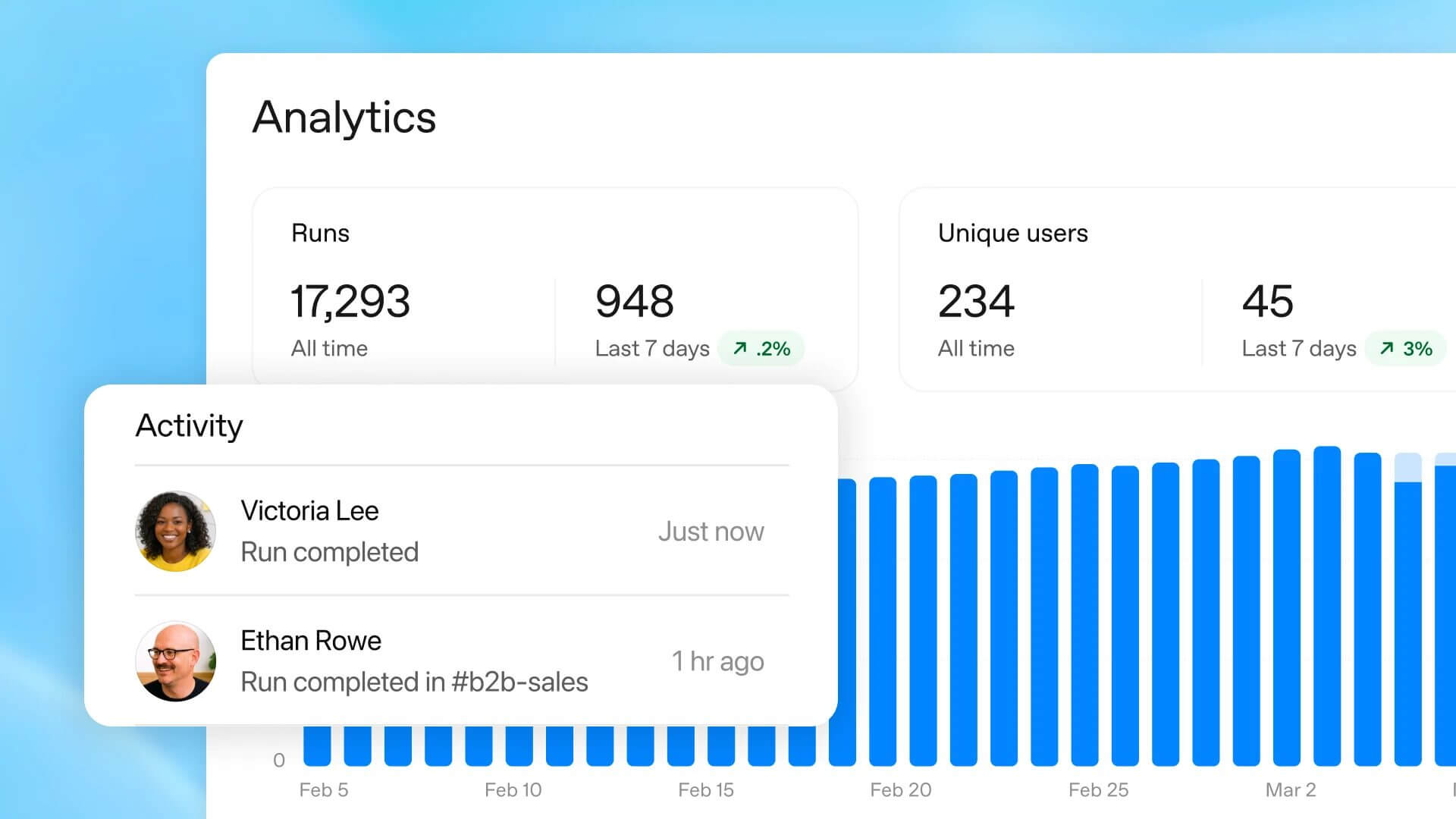

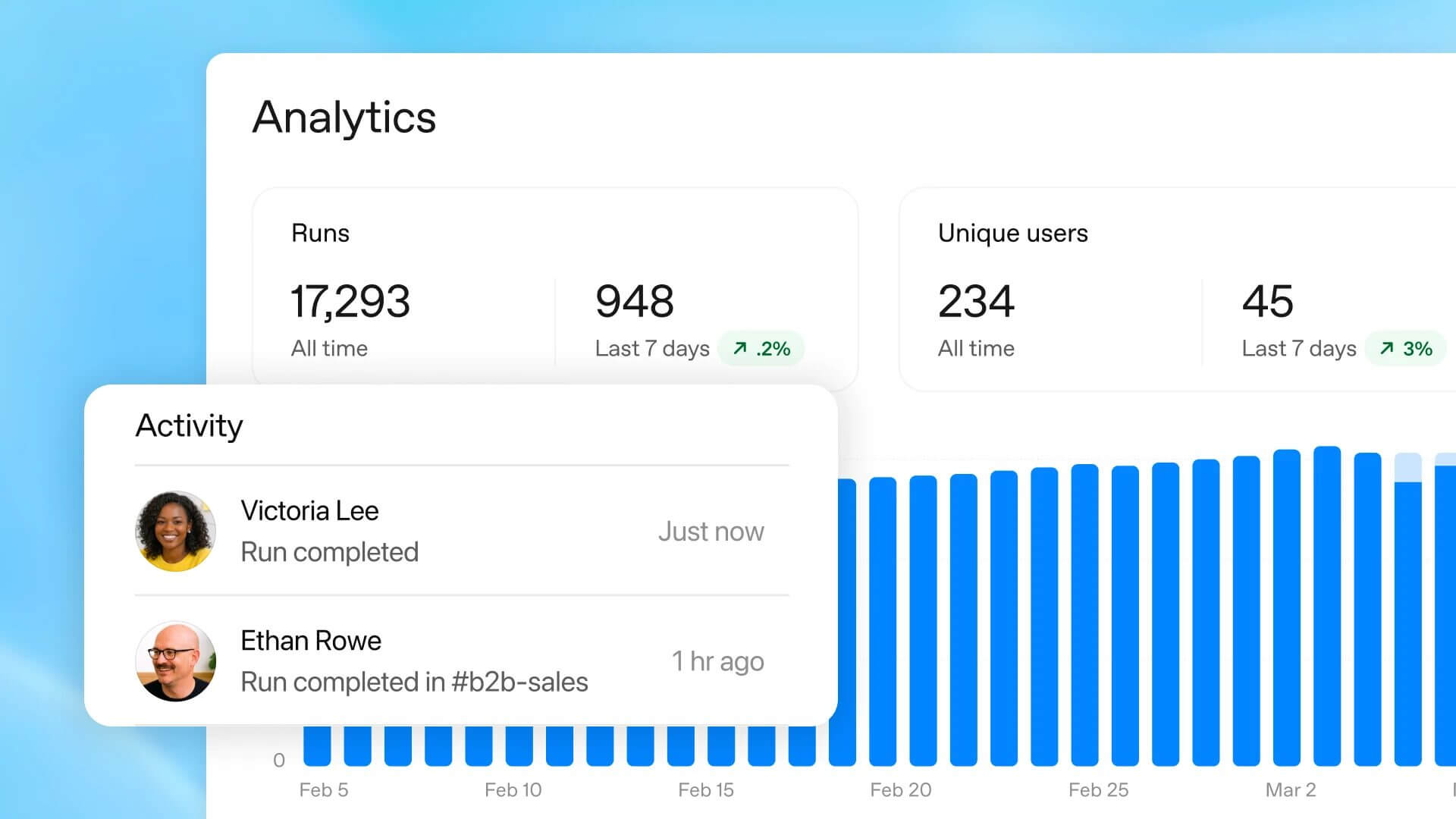

Le deuxième axe est l’autonomie opérationnelle, l’agent peut être mis sur un planning ou connecté à Slack, et à partir de là il prend en charge les requêtes sans être sollicité à chaque fois par l’utilisateur. Cela devient une présence continue dans le flux de travail, et non un assistant qui s’allume uniquement lorsque quelqu’un ouvre ChatGPT. Les actions sensibles, telles que l’envoi d’un e-mail ou la création d’un événement de calendrier, nécessitent une approbation et l’administrateur voit à quelle fréquence un agent partagé est utilisé via l’analyse.

Le troisième axe est l’orientation d’équipe et non l’orientation individuelle. Un agent d’espace de travail contrôle l’accès aux fichiers, outils et connecteurs définis par l’espace de travail, suit le flux de travail d’un groupe, transmet les approbations via les rôles appropriés et peut être dupliqué ou partagé comme modèle pour d’autres processus similaires.

Les GPT personnalisés n’ont fait quelque chose de similaire que superficiellement, car le concept de rôle et d’autorisation native n’était pas là et la mémoire n’existait tout simplement pas.

Le Codex comme moteur et la logique toujours active

Le choix d’exécuter les agents de l’espace de travail sur Codex est techniquement pertinent et stratégiquement cohérent. Codex est le moteur qu’OpenAI a développé pour les tâches à long terme, avec gestion de arbre de travail isolé, capacité à exécuter du code, examen des différenceset orchestration de plusieurs tâches en parallèle. Le placer sous la responsabilité des agents de l’espace de travail signifie hériter d’une infrastructure conçue pour des tâches durables, et non pour des réponses immédiates.

Les rumeurs qui ont émergé dans les semaines précédant le lancement, faisant référence au projet interne « Hermes », parlaient d’agents toujours disponibles, des coéquipiers 24h/24 et 7j/7, conçus pour agir en fonction de la cadence, des événements et des messages entrants au lieu d’attendre une invite. Les agents d’espace de travail annoncés aujourd’hui semblent être la première incarnation publique de cette direction, bien que la version Research Preview laisse ouverte la maturité des fonctionnalités de planification et de déclenchement.

La promesse est ambitieuse : regrouper les connaissances aujourd’hui dispersées parmi les personnes et les systèmes dans des flux de travail réutilisables, qui suivent le bon processus et utilisent les bons outils.

Une équipe définit un agent une fois, l’affine au fil du temps, le duplique pour de nouveaux cas. Si la promesse est tenue, le profil d’usage ressemble moins à celui d’un chatbot qu’à celui d’un collègue qui apprend les règles de la maison et s’y adapte.

Configuration et intégration rapides avec Slack

Le flux de création est volontairement simple : l’utilisateur décrit un workflow récurrent ou télécharge un fichier, et ChatGPT transforme le tout en agent en définissant des étapes, en connectant des outils, en ajoutant des compétences et en testant le résultat. Il s’agit du même modèle conversationnel que le GPT personnalisé, mais appliqué à quelque chose de plus complexe et avec une sortie qui est un objet vivant plutôt qu’une configuration statique.

L’intégration de Slack est probablement la fonctionnalité la plus pratique du lancement, car elle déplace le point de contact là où se déroulent réellement les conversations d’équipe. Un agent configuré pour un processus de support client ou d’opérations de vente peut être invoqué directement depuis un canal, prendre en charge la demande, demander des confirmations en cas de besoin et clôturer la tâche sans que personne n’ouvre ChatGPT. OpenAI prévoit que d’autres intégrations suivront celle-ci.

Les administrateurs disposent de contrôles granulaires sur les outils et les données que chaque agent peut utiliser, ainsi que sur les moments où une approbation humaine est nécessaire. Les analyses d’utilisation, bien qu’elles ne soient pas décrites en détail, indiquent que l’équipe éditoriale d’entreprise de l’agent est traitée comme un produit interne, avec des tableaux de bord d’adoption et des mesures d’utilisation continue au fil du temps.

Quiconque a géré des plateformes internes sait que s’il n’y a pas de tableau de bord utilisateur, la plateforme meurt silencieusement.

Déploiement progressif et modèle économique

La distribution suit un modèle prudent : aperçu de la recherche sur Business, Enterprise, Edu et Teachers, avec des administrateurs Enterprise et Edu qui peuvent activer la fonctionnalité via des contrôles basés sur les rôles. Pas de déploiement sur Plus et Pro au lancement, ce qui est cohérent avec un positionnement B2B, et avec la volonté de tester les charges et modes d’usage sur les clients structurés avant l’ouverture au plus large public.

La fenêtre gratuite jusqu’au 6 mai 2026 ouvre une fenêtre d’environ deux semaines pendant laquelle les équipes peuvent expérimenter sans frais, après quoi un modèle basé sur des crédits entre en vigueur.

Les prix et les seuils ne sont pas publics, mais le paramètre de crédit suggère un modèle de tarification par répartition qui évolue en fonction du nombre de tâches effectuées, et non du nombre d’agents créés. Pour les équipes qui souhaitent évaluer sérieusement, cette fenêtre est courte et nécessite d’abord de préparer quelques workflows de candidats, plutôt que d’arriver le 3 mai avec un GPT à migrer.

Dans un contexte concurrentiel plus large, cette évolution positionne OpenAI frontalement par rapport à Notion, qui a été le premier à jouer la carte des agents partagés avec Custom Agents, et par rapport à Microsoft, qui avec Foundry Agent Service opère à un niveau infrastructurel inférieur mais avec une intégration avec M365 que ne possède pas OpenAI.

La différence, du point de vue de l’utilisateur professionnel, est que ChatGPT en tant que surface est déjà entre les mains de dizaines de millions de professionnels, et maintenant cette surface héberge des agents persistants avec mémoire, plannings et Slack intégré.

La question de la gouvernance que personne ne peut plus reporter

Le passage d’outils individuels à coéquipiers Cette persistance soulève un problème de gouvernance que de nombreuses entreprises ont jusqu’à présent pu reporter, car les GPT personnalisés vivaient au sein d’un compte unique et produisaient des risques limités. Un agent d’espace de travail dispose d’une mémoire partagée, d’un accès aux connecteurs d’entreprise, de la possibilité d’effectuer des actions sur des systèmes externes et d’un cycle de vie qui va au-delà d’une simple conversation.

Les responsables de la sécurité et de la conformité se retrouveront à répondre à des questions qu’ils ne se posaient pas auparavant. À qui appartiennent les données dont l’agent se souvient ? Que se passe-t-il lorsqu’un salarié qui a créé un agent quitte l’entreprise ? Comment les décisions prises par l’agent sont-elles auditées de manière autonome ? Quelles politiques DLP s’appliquent aux données que l’agent déplace de Slack vers une base de données et vice versa ?

Les réponses produit seront là, en partie elles le sont déjà, mais elles doivent être traduites en politiques internes avant de passer à la production.

La leçon qui ressort des lancements de plateformes d’agents ces dernières semaines, de Foundry à Notion, de Google à OpenAI, est convergente : toute personne disposant d’un bon modèle peut construire des agents intelligents, mais le véritable travail est de les rendre sûrs, traçables et gouvernables. Ceux qui adoptent ces outils aujourd’hui sans investir dans un cadre de gouvernance se retrouveront demain obligés de reconstruire les contrôles sur les agents déjà en production, et c’est le pire moment pour le faire.

Le signal pour ceux qui construisent sur ChatGPT aujourd’hui

Pour les équipes qui ont déjà sérieusement investi dans les Custom GPT, le message à lire est double. D’une part, OpenAI promet un convertisseur, qui réduit le risque de devoir tout refaire, et signale que la rétrocompatibilité est sur la feuille de route. En revanche, la nouvelle primitive a un modèle mental différent, c’est un objet d’équipe, persistant, intégré, et nécessite une rédaction différente des mêmes workflows.

Le conseil opérationnel le plus honnête qui puisse être donné est de ne pas tout migrer d’un coup, mais de prendre deux ou trois cas d’usage dans lesquels la mémoire persistante, la connexion avec Slack ou la planification font vraiment la différence, et de les construire en tant qu’agents d’espace de travail natifs. Les cas dans lesquels un GPT classique fonctionne encore bien (modèles d’invite, assistants d’écriture, robots d’information) peuvent rester là où ils sont, au moins jusqu’à ce que le convertisseur soit disponible et testé.

Sans aucun doute, la question qui reste ouverte est de savoir si cette évolution de ChatGPT d’un outil pour individus à une plateforme pour équipes se traduira par une réelle adoption dans les entreprises, ou si la saturation des publicités sur les agents finira par produire plus de lassitude d’adoption que de valeur opérationnelle pour ceux qui doivent réellement y travailler ?