Arm lance des puces IA pour les centres de données et défie Intel et Nvidia

Arm, société britannique active dans la conception de microprocesseurs et d'architectures semi-conductrices, a annoncé le lancement de sa première puce propriétaire pour data center dédiée à l'intelligence artificielle. C'est un changement évident par rapport au modèle qu'Arm a suivi jusqu'à présent, vendant des projets et non des produits. Le premier client sera Meta, qui a participé au développement de la puce, suivi d'OpenAI.

De la licence au produit : un tournant stratégique

L’actualité confirme à quel point le boom de l’IA est disruptif, au point de remettre en cause les équilibres historiques entre les acteurs. Arm a bâti son succès sur un modèle unique : concevoir des architectures et les octroyer sous licence à des centaines d'entreprises, de Qualcomm à Amazon et Microsoft. Cette approche a fait de ses conceptions le standard de facto pour les smartphones et, de plus en plus, pour les serveurs.

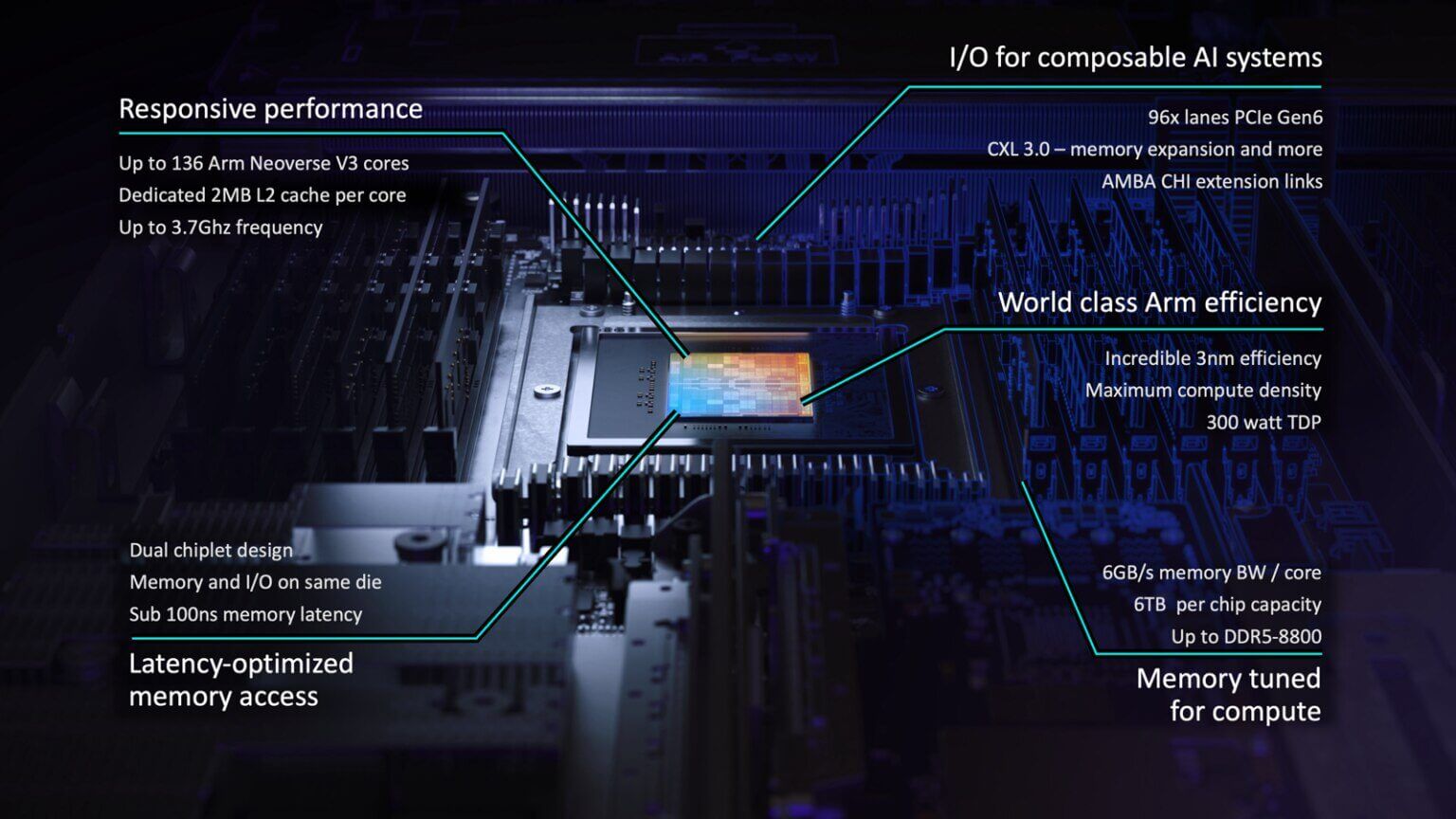

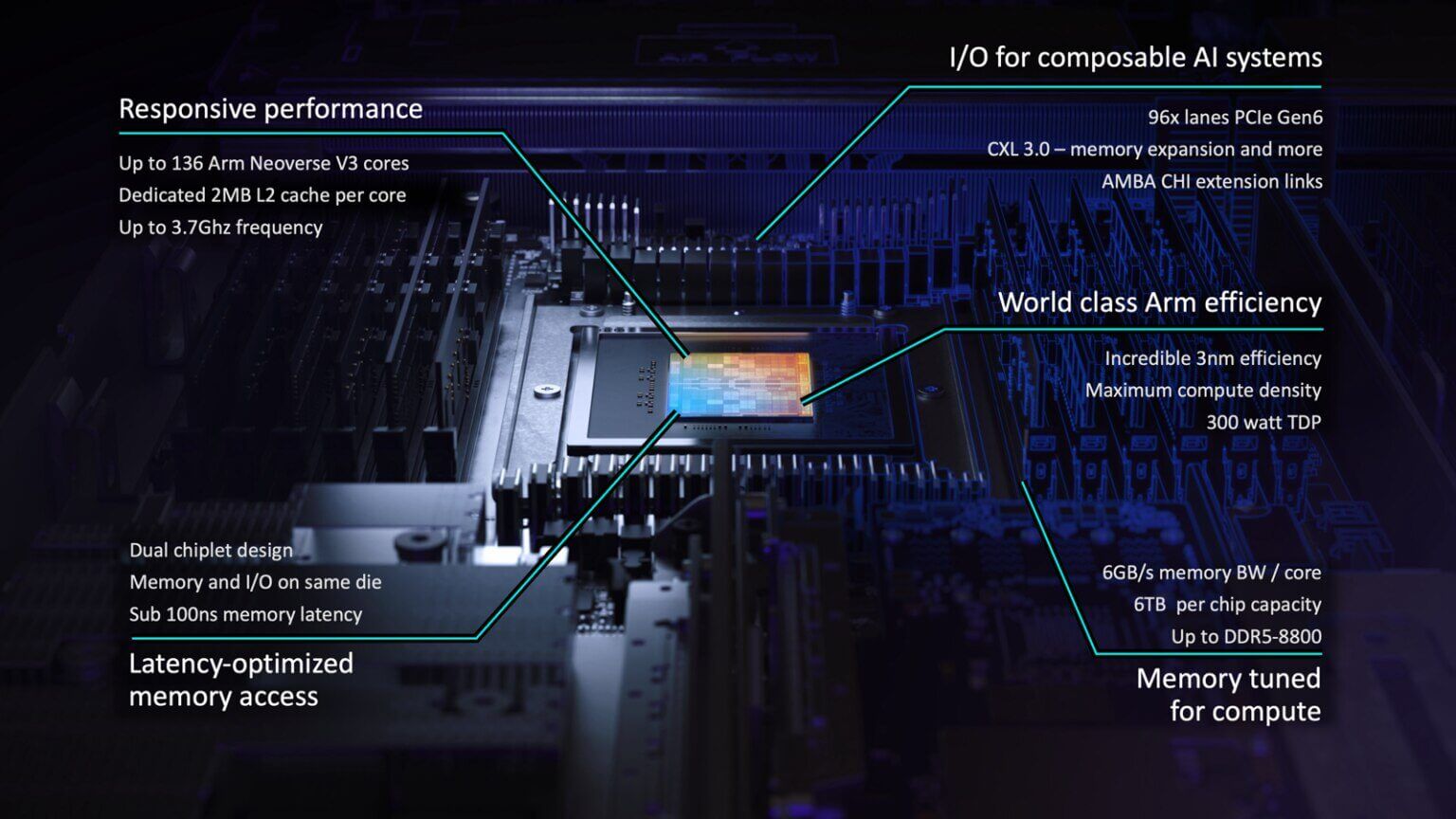

Avec la nouvelle puce – appelée « Arm AGI CPU » – l'entreprise se lance directement dans la vente de silicium. Le processeur, selon les données fournies par l'entreprise, peut atteindre jusqu'à 136 cœurs et promet une amélioration significative du rapport entre performances et consommation d'énergie.

Pierre Ferragu, analyste chez New Street Research, a défini ce choix comme « le tournant stratégique le plus important de l'histoire d'Arm ».

Le contexte : l’économie des puces IA

Au cours des deux dernières années, on le sait, le marché a été dominé par Nvidia, dont les puces GPU sont devenues la norme en matière de formation de modèles. La croissance est telle qu'elle place l'entreprise au premier rang mondial en termes de capitalisation.

Mais l’attention se porte également sur d’autres composants de l’infrastructure de l’IA :

- CPU pour orchestrer des charges complexes ;

- puces spécialisées pour l'inférence ;

- architectures optimisées pour les agents autonomes.

Selon les récentes déclarations du PDG de Nvidia, Jensen Huang, les puces destinées à gérer les agents d'IA pourraient devenir un marché d'un milliard de dollars. Cela explique pourquoi Arm a décidé de contrôler directement une partie de la chaîne de valeur.

Clients ou concurrents : la tension avec l’écosystème

En revanche, le choix de vendre des chips crée un conflit potentiel. Les mêmes entreprises qui paient Arm aujourd'hui pour utiliser ses architectures développent leurs propres puces basées sur ces technologies.

Parmi ceux-ci :

- Amazon avec des puces Graviton

- Microsoft avec les solutions Azure

- Ampere Computing dans le cloud d'entreprise

Entrer sur le même marché signifie en effet entrer en concurrence avec vos clients.

Mohamed Awad, responsable du cloud AI d'Arm, affirme que le nouveau produit est destiné à un créneau très avancé, celui des grands centres de données, que peu d'opérateurs peuvent concevoir eux-mêmes. Il s’agit d’une distinction stratégique, mais elle n’élimine pas le risque de frictions.

Jim McGregor, analyste chez Tirias Research, note que la pression pour augmenter les revenus rend cette tension inévitable.

Efficacité énergétique et coûts : le levier économique

L’un des éléments centraux de l’annonce concerne les coûts des centres de données IA. Arm estime que l'adoption de la nouvelle puce pourrait permettre d'économiser jusqu'à 10 milliards de dollars dans la construction d'une infrastructure de 50 milliards de dollars.

Le problème c'est la consommation d'énergie. Les centres de données IA sont de plus en plus limités non seulement par la disponibilité des puces, mais également par l’énergie nécessaire à leur alimentation. Améliorer le rapport performance/watt devient alors un avantage concurrentiel décisif.

Cela est cohérent avec le positionnement historique d'Arm, qui a toujours mis l'accent sur l'efficacité plutôt que sur la puissance pure. Le moment est venu car l’IA s’oriente davantage vers l’inférence, qui nécessite une meilleure efficacité, au point qu’elle peut également s’étendre aux appareils des utilisateurs.

De manière générale, la démarche d'Arm s'inscrit dans une phase de forte accélération de l'IA industrielle :

- le développement d'agents autonomes augmente la demande d'informatique distribuée ;

- les grandes entreprises technologiques verticalisent de plus en plus le matériel ;

- Les tensions géopolitiques et réglementaires, telles que les initiatives de la Maison Blanche sur les politiques en matière d’IA (mars 2026), ont un impact sur les chaînes d’approvisionnement.

L’effet le plus immédiat concerne le marché des processeurs pour centres de données. Arm présente la nouvelle puce comme un processeur conçu pour « l'IA agentique », avec jusqu'à 136 cœurs, produit par TSMC à 3 nanomètres et orienté vers l'efficacité énergétique. Reuters et Le bord rapportent que la société promet un rapport performances par watt supérieur aux plates-formes x86 traditionnelles. Si ces promesses tiennent dans des installations réelles, la pression retombera surtout sur Intel et AMD, qui contrôlent aujourd'hui l'essentiel du marché des serveurs généralistes.

Vers des architectures plus efficaces

Nvidia reste la référence en matière de GPU utilisés dans la formation de modèles et dans de nombreuses inférences d'IA. Mais l’augmentation de nouvelles charges de travail, notamment les agents, augmente le poids du processeur en tant que composant coordonnant la mémoire, la mise en réseau, le stockage et les accélérateurs.

Meta explique que ses centres de données « dépassent les capacités des processeurs traditionnels » et qu'elle développera plusieurs générations de processeurs avec Arm pour prendre en charge l'IA et l'informatique générale. Autrement dit, le CPU redevient un levier stratégique, et non une pièce secondaire à côté du GPU.

Si Arm parvient réellement à offrir plus de performances par watt, le marché évoluera vers des architectures plus efficaces. Le passage des serveurs x86 aux serveurs Arm dans certaines classes de charges de travail IA et cloud va s'accélérer. Le boom de l'IA pourrait se poursuivre au-delà de celui actuel goulot l'énergie, au sein de l'IA agentique, même locale.

L'arrivée de la puce Arm n'enlève pas le rôle dominant de Nvidia dans les GPU, ni ne bouleverse le marché des serveurs en quelques mois. Mais cela déplace une frontière : désormais Arm n’est plus seulement la technologie utilisée par d’autres pour construire des processeurs, mais un vendeur direct de matériel pour les centres de données d’IA. Cela accroît la concurrence dans les CPU, renforce la poussée vers des infrastructures conçues sur mesure par les grands groupes de cloud et rend plus tendues les relations entre Arm et certains de ses clients historiques.

L’une des conséquences est que le marché des puces IA pourrait se fermer autour de quelques acteurs contrôlant des parties de plus en plus grandes de la machine entière. Les dernières annonces de Nvidia vont dans ce même sens.

Carte : CPU Arm AGI, efficacité des agents à l'échelle du rack

Les charges de travail d’IA agentique nécessitent des performances constantes à grande échelle. Le processeur Arm AGI est conçu pour offrir des performances élevées pour des tâches à charge soutenue sur des milliers de cœurs en parallèle, le tout dans les limites d'alimentation et de refroidissement des centres de données modernes.

Chaque élément du processeur Arm AGI – de la fréquence de fonctionnement à la mémoire et à l'architecture d'E/S – a été conçu pour prendre en charge des charges de travail agentiques massivement parallèles et hautes performances dans un déploiement en rack haute densité.

La configuration du serveur de référence d'Arm est une conception 1OU à 2 nœuds – contenant deux puces avec mémoire dédiée et E/S pour un total de 272 cœurs par lame. Ces lames sont conçues pour alimenter entièrement un rack refroidi par air standard de 36 kW : 30 lames fournissant un total de 8 160 cœurs. Arm a également collaboré avec Supermicro sur une conception refroidie par liquide de 200 kW capable d'héberger 336 processeurs Arm AGI pour plus de 45 000 cœurs.

Dans cette configuration, le processeur Arm AGI peut offrir plus du double de performances par rack par rapport aux derniers systèmes x86*, grâce aux principaux avantages de l'architecture Arm et à l'adaptation minutieuse des ressources système à la puissance de calcul :

La bande passante mémoire de pointe des processeurs Arm AGI se traduit par des threads d'exécution plus efficaces par rack ; Les processeurs x86 subissent une dégradation lorsque les cœurs entrent en compétition sous une charge soutenue.

Les cœurs de processeur Arm Neoverse V3 à thread unique, efficaces et hautes performances, surpassent les architectures existantes ; chaque fil de bras fait plus de travail.

Plus de threads utilisables et plus de travail par thread se traduisent par d'énormes gains de performances par rack.