Les États-Unis préparent des règles sur l’IA après un conflit avec Anthropic

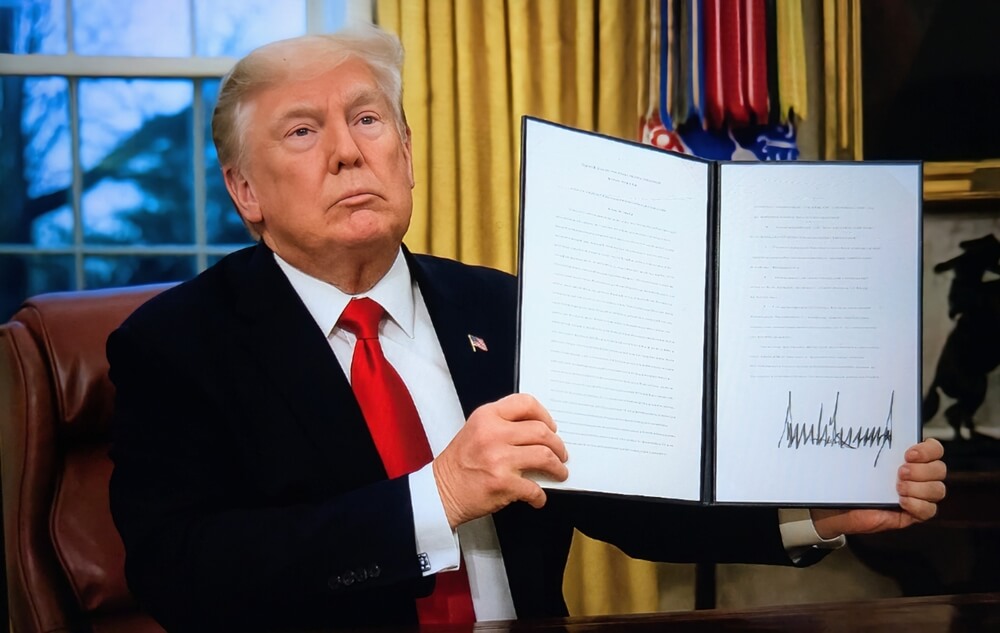

L’administration dirigée par Donald Trump élabore de nouvelles lignes directrices particulièrement restrictives pour les marchés publics dans le secteur de l’intelligence artificielle.

D'après un projet vu par Temps Financierles entreprises qui ont l'intention de fournir des modèles d'IA au gouvernement fédéral devront accorder aux États-Unis une licence irrévocable autorisant l'utilisation de leurs systèmes à des fins licites.

Les règles, préparées par la General Services Administration (GSA), concerneraient les contrats civils et font partie d'une tentative plus large visant à renforcer les procédures d'achat de l'État pour les technologies d'IA.

Le conflit entre le Pentagone et Anthropic

Les nouvelles directives surviennent au milieu d’un affrontement entre le ministère américain de la Défense et la société d’intelligence artificielle Anthropic.

La semaine dernière, le Pentagone a annoncé la résiliation d'un contrat de 200 millions de dollars après que l'entreprise a refusé de permettre une liberté totale dans l'utilisation de sa technologie.

Anthropic a fait valoir qu’une clause autorisant « toute utilisation licite » pourrait ouvrir la porte à des systèmes nationaux de surveillance de masse ou au développement d’armes mortelles autonomes, appelant ainsi à des garanties spécifiques.

La Maison Blanche a réagi en classant l'entreprise comme un risque lié à la chaîne d'approvisionnement, une mesure généralement appliquée aux entreprises considérées comme sensibles du point de vue de la sécurité nationale.

Le secrétaire à la Défense, Pete Hegseth, a accusé l'entreprise de chercher à obtenir « un droit de veto sur les décisions opérationnelles de l'armée américaine ».

Neutralité idéologique et lutte contre le « réveil de l’IA »

Le projet de lignes directrices comprend également des dispositions politiquement sensibles.

Les fournisseurs d'IA devront garantir des outils « neutres et non partisans », empêchant les modèles de manipuler les réponses pour favoriser des vues idéologiques liées à des concepts tels que la diversité, l'équité et l'inclusion (DEI).

Cette clause fait suite à un décret du président Trump visant à limiter ce que la Maison Blanche appelle les modèles d’intelligence artificielle « éveillés ».

Le document indique explicitement que les développeurs ne doivent pas intégrer de jugements idéologiques ou partisans dans les résultats générés par les systèmes.

Un message également à l'Europe

Une autre section des lignes directrices semble avoir des implications géopolitiques et réglementaires.

Les entreprises doivent indiquer si leurs modèles ont été modifiés ou configurés pour se conformer aux réglementations non américaines, y compris les réglementations commerciales ou de conformité.

Selon des sources proches du dossier, la référence vise également à remettre en question le respect des réglementations européennes comme le Digital Services Act.

Le rôle de la GSA dans les achats fédéraux

La General Services Administration, dirigée par Ed Forst, gère une grande partie des achats de technologies pour le gouvernement fédéral américain.

Par l'intermédiaire de sa division Federal Acquisition Service, dirigée par l'ancien cadre du KKR Josh Gruenbaum, des accords ont été signés avec plusieurs grandes sociétés d'IA au cours des douze derniers mois, notamment OpenAI, Meta, xAI et Google, pour fournir des modèles d'IA aux agences fédérales à des coûts réduits.

Cependant, après le conflit avec le Pentagone, l'agence a cessé de collaborer avec Anthropic.

Consultations avec l'industrie avant la version finale

Avant l'adoption définitive, la GSA entend ouvrir une phase de discussion avec les entreprises du secteur technologique.

L’objectif est de recueillir les observations et commentaires de l’industrie alors que Washington tente de définir un nouvel équilibre entre innovation technologique, sécurité nationale et contrôle politique sur l’intelligence artificielle.