il reste sept ou huit ans d’investissement astronomique dans l’IA

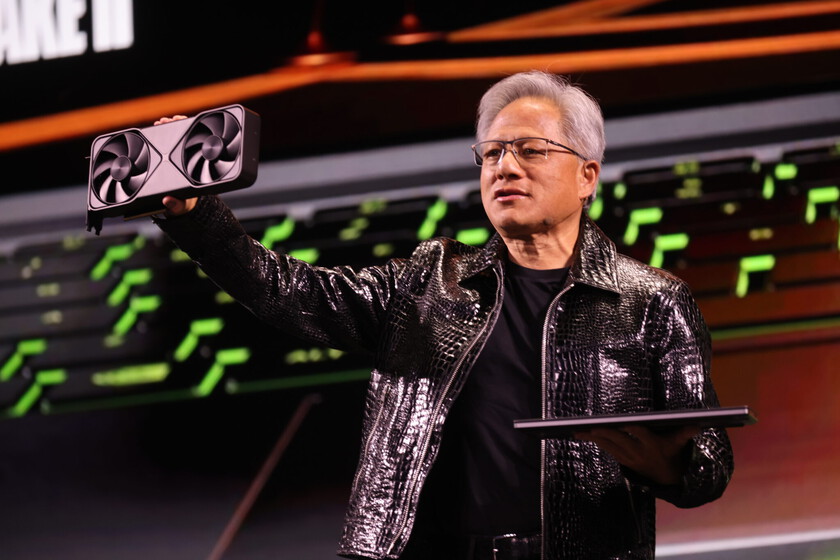

Parler d'intelligence artificielle, c'est parler de Jensen Huang. Le PDG de NVIDIA est devenu la figure d’une industrie : celle de l’intelligence artificielle. Ce sont en grande partie les produits de son entreprise qui font tourner le moteur des centres de données et, à leur tour, les énormes industries des semi-conducteurs et de la mémoire sont les composants essentiels des GPU NVIDIA. Et si Huang commente depuis quelques semaines que 2026 aura besoin de wafers et de beaucoup de RAM, il demande désormais de la patience avec l'IA.

Parce qu’il lui reste encore sept ou huit ans d’escalade incontrôlée.

En bref. Quand on parle d’intelligence artificielle, il y a deux pôles. D’un côté, ceux qui voient les signes d’une bulle qui va éclater à court terme. De l’autre, ceux qui défendent envers et contre tout l’investissement d’un milliard de dollars. Dans ce bateau se trouve Jensen Huang, qui a récemment noté sur CNBC que ces dépenses massives sont « nécessaires et appropriées » car une « infrastructure unique dans une génération » est en train de se façonner.

Le plus intéressant est que, pour lui, cette course se poursuivra pendant plusieurs années, soulignant qu'il reste sept ou huit ans pour investir et construire des infrastructures pour l'IA.

Mortiers d'argent. Dans ses déclarations, Huang a souligné que des entreprises comme Anthropic et OpenAI gagnent de l'argent malgré tout ce qui est investi et que leur frein actuel n'est pas tant le budget que la limite de la puissance de calcul. C'est pourquoi il souhaite que ses fournisseurs (Samsung dans les mémoires HBM4 de nouvelle génération ou TSMC avec les processeurs) accélèrent le rythme.

Il reste toutefois à voir si ce rythme pourra être maintenu au cours des cinq prochaines années. Sur CNBC, le PDG de NVIDIA a noté que, malgré le montant astronomique, les dépenses sont durables. Et la preuve en est qu’elle augmente. Si en 2025 les dépenses totales des Big Tech n’atteignaient pas 400 milliards, cette année, le chiffre des entreprises américaines devrait atteindre 650 milliards. Seulement entre Amazon et Alphabet (Google), ils investiront environ 385 milliards.

Ils voient la course à l'informatique IA comme le prochain « celui qui gagnera le plus », et aucun n'est prêt à perdre – Gil Luria, analyste de DA Davidson, s'adressant à Bloomberg

Carrière parallèle. Et cela, comme on dit, dans les entreprises américaines, puisque la Chine est l’autre pôle dans cette course à l’intelligence artificielle. Le géant asiatique est le berceau de plusieurs modèles extrêmement performants, mais aussi de quelque chose qui manque aux États-Unis : de l’énergie pour nourrir les énormes besoins de l’IA. La Chine mise sur l’IA, mais aussi sur la robotique, et tout cela en achetant des produits NVIDIA et en développant son propre réseau de semi-conducteurs dans le but d’atteindre la souveraineté technologique.

Le parallèle. C’est une autre course parallèle à celle des États-Unis, et en dehors des deux pôles de développement des infrastructures, nous avons des noms particuliers. Le fait qu’autant d’argent soit investi signifie que des opportunités se créent et qu’il y a des entreprises qui ont traversé une mauvaise passe et qui veulent surfer sur la vague. Par exemple, une société Intel qui, après avoir eu besoin d’un sauvetage des États-Unis, se positionne comme l’une des plus grandes fonderies des États-Unis.

De plus, ils se lancent dans un segment qu'ils n'avaient pas exploré, celui de la mémoire DRAM, et ils le font avec le géant japonais SoftBank. Le Japon n’a plus son mot à dire dans l’industrie de la mémoire depuis les années 1980, lorsque la Corée du Sud lui a succédé, et il pourrait désormais avoir une autre chance.

Traduction pour l'utilisateur. Ce sont quelques exemples d’entreprises qui profitent des conditions pour obtenir du financement et se développer, cherchant à se positionner dans ce qu’elles ont déterminé être l’avenir de l’industrie technologique. Avec cette somme d’argent et cet investissement, il y a une question que vous vous posez peut-être : pourrai-je acheter un PC ? La réponse n’est pas encourageante. Des géants comme Micron – l'un des poids lourds du segment RAM – investissent beaucoup pour étendre leurs installations et être plus capables de créer des mémoires, mais ce ne sera pas pour nous : ce sera pour les centres de données.

Quand est-ce que ça se termine ? Si la fin de 2026 ou 2027 était désignée comme la fin de la crise pour des composants comme la RAM ou les SSD (qui sont encore des composants avec modules de mémoire), c'est désormais Lip-Bu Tan, PDG d'Intel, qui affirme que ce ne sera pas avant 2028, au plus tôt, que l'on pourra apercevoir un horizon dans le panorama actuel.

Alors oui, l’ensemble de l’industrie technologique s’est tourné vers l’IA et ceux qui peuvent augmenter leur production de composants clés le feront au cours des prochaines années. Le problème est qu'ils vont se concentrer sur des composants dont les utilisateurs ne se soucient pas, en négligeant ceux dont nous avons réellement besoin au quotidien. Et NVIDIA lui-même en est un exemple.

Images | Nvidia

À Simseo | Apple est le premier client du secteur depuis des décennies. L’IA la relègue au second plan