Explorer l'écart dans l'apprentissage humain et l'IA

Comment les humains parviennent-ils à s'adapter à des situations complètement nouvelles et pourquoi les machines ont-elles si souvent du mal avec cela? Cette question centrale est explorée par des chercheurs de Cognitive Science and Artificial Intelligence (IA) dans un article conjoint publié dans la revue Intelligence de la machine de la nature. Parmi les auteurs figurent le professeur Dr Barbara Hammer et le professeur Dr Benjamin Paaßen de l'Université Bielefeld.

« Si nous voulons intégrer les systèmes d'IA dans la vie quotidienne, que ce soit en médecine, en transport ou en prise de décision, nous devons comprendre comment ces systèmes gèrent l'inconnu », explique le professeur Hammer, chef du groupe d'apprentissage automatique de l'Université Bielefeld. « Notre étude montre que les machines se généralisent différemment des humains et cela est crucial pour le succès de la future collaboration humaine – AI. »

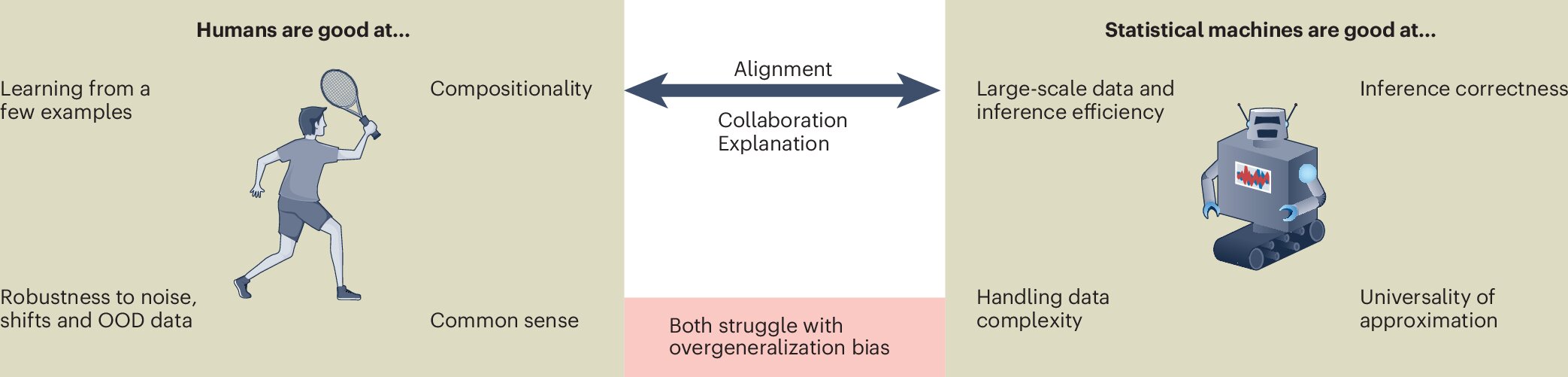

Différences entre les humains et les machines

Le terme technique «généralisation» fait référence à la capacité de tirer des conclusions significatives sur les situations inconnues des informations connues, c'est-à-dire d'appliquer de manière flexible les connaissances à de nouveaux problèmes. En sciences cognitives, cela implique souvent la pensée conceptuelle et l'abstraction. Dans la recherche sur l'IA, cependant, la généralisation sert de terme parapluie pour une grande variété de processus: de l'apprentissage automatique au-delà des domaines de données connus (« généralisation hors du domaine ») à l'inférence basée sur des règles dans les systèmes symboliques, à une IA dite neuro-symbolique, qui combine des réseaux logiques et neuronaux.

« Le plus grand défi est que la« généralisation »signifie des choses complètement différentes pour l'IA et les humains», explique le professeur Paaßen, professeur junior pour la représentation des connaissances et l'apprentissage automatique à Bielefeld. « C'est pourquoi il était important pour nous de développer un cadre partagé. Par trois dimensions: qu'entendons-nous par généralisation? Comment est-elle réalisée? Et comment peut-elle être évaluée? »

Signification pour l'avenir de l'IA

La publication est le résultat d'une collaboration interdisciplinaire entre plus de 20 experts des institutions de recherche à niveau international, notamment les universités de Bielefeld, Bamberg, Amsterdam et Oxford. Le projet a commencé par un atelier conjoint au Leibniz Center for Informatics at Schloss Dagstuhl, co-organisé par le professeur Dr. Hammer.

Le projet met également en évidence l'importance de combler les sciences cognitives et la recherche sur l'IA. Ce n'est que par une compréhension plus approfondie de leurs différences et de leurs points communs qu'il sera possible de concevoir des systèmes d'IA qui peuvent mieux refléter et soutenir les valeurs humaines et les logiques de prise de décision.

Fourni par Universität Bielefeld