Aux actes européens et au chatbot: le risque d'un vide réglementaire

Après la période de vacances, faisons le point sur la situation en ce qui concerne la loi européenne. À partir du retard polonais et du risque d'infraction. Varsovie n'a pas encore nommé l'autorité de surveillance du marché prévue par la loi. Selon l'expert juridique Maria Dymittruk, le manque de réalisation pourrait conduire à une procédure d'infraction de Bruxelles. Le règlement, en vigueur le 1er août 2024, a obligé les États membres à communiquer ses organismes de contrôle avant le 2 août 2025.

Même sans autorité désignée, les entreprises polonaises sont déjà tenues de se conformer aux règles: toute violation peut être sanctionnée. Cependant, le vide institutionnel risque de créer une confusion, incitant certaines entreprises à croire que les règles ne sont pas encore opérationnelles.

Le vice-Premier ministre et ministre des Affaires numériques Krzysztof Gawkowski minimise les risques, en se rappelant que les autres États membres sont encore en retard et veillent à ce que le gouvernement « fasse tout possible pour mettre en œuvre la loi rapidement et efficacement ». Un projet de loi nationale prévoit la création de la Commission pour le développement et la sécurité de l'intelligence artificielle (KRIBSI) en tant qu'autorité de supervision.

Chatbot et intimité: un vide réglementaire

Les actes ne définissent pas clairement à quel point les chatbots peuvent encourager les liens émotionnels avec les utilisateurs. Sam Altman, PDG d'OpenAI, estime que moins de 1% des utilisateurs de Chatgpt développent une « relation malsaine » avec le service. Une part réduite, mais qui, en termes absolues, pourrait signifier des millions de personnes.

Le règlement interdit les techniques « délibérément manipulateur ou trompeur« Ce qui peut causer des » dommages importants « , mais le doute demeure si les liaisons affectives occasionnelles relèvent de ce seuil. Jusqu'à présent, il n'y a eu aucune intervention application.

D'autres réglementations européennes peuvent s'appliquer, telles que la directive sur les pratiques commerciales de Sleal (UCPD) et la loi sur les services numériques (DSA), qui interdisent les interfaces trompeuses ou manipulations. Cependant, comme l'observe Urs Buscke del Beuc, ces lois concernent principalement la conception de l'interface, et non le contenu conversationnel.

Le futur acte de Faiors numériques a l'intention de se battre « motifs sombres« Et les mécanismes de la toxicomanie, mais les experts préviennent: les législateurs n'ont pas encore une compréhension complète des risques de l'IA manipulatrice émotionnellement.

Relations numériques et risques sociaux

En tant que Pieter Haeck (politicien), le chatbot-carambre, toujours disponible et dépourvu de jugement, notez de nouveaux défis. Si, d'une part, ils redéfinissent l'idée de l'amitié, de l'autre, ils proposent la dynamique déjà vue avec les réseaux sociaux ou les applications de rencontres: diffusion rapide, réglementation lente, utilisateurs vulnérables exposés.

Certains épisodes, qui relient les chatbots aux cas de suicide ou de complot criminel, ont mis en lumière les lacunes réglementaires. L'AI ACT oblige les chatbots à déclarer artificiels, mais en plus de cela, les obligations restent vagues.

La base à risque identifie les pratiques «inacceptables» telles que la manipulation et la classification subliminales comme à haut risque des systèmes qui affectent la santé, la sécurité et les droits fondamentaux, mais uniquement à partir de 2026.

Le député de député comme le Green Hollandais Kim Van Sparrentok demande à inclure explicitement le chatbot-carambre parmi les systèmes à haut risque. Les critiques, cependant, indiquent que la législation se concentre sur les dommages fonctionnels, négligeant les émotionnels.

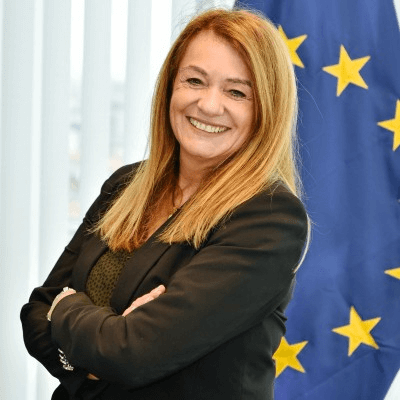

À l'intérieur de la stratégie européenne: la vision de Lucilla Sioli, directrice de l'UU au bureau

Dans une interview, le directeur de l'UU au bureau, Lucilla Sioli, a expliqué comment le règlement a mis en place les fondements d'un organisme chargé de guider la recherche, l'innovation et la chaîne de valeur de l'IA, tout en garantissant le respect des règles.

Le bureau poursuit deux objectifs entrelacés: stimuler la croissance économique européenne à travers l'IA et renforcer la confiance à travers le cadre du « AI digne de confiance«

Les règles les plus strictes, y compris celles sur la transparence et les systèmes à risque élevé, entreront en vigueur à partir de 2026, sur la base des normes techniques de CENELEC. La Commission évalue s'il faut reporter les délais.

Aux critiques américaines d'une réglementation excessive, Sioli répond que le modèle européen ne concerne que 10% des applications ayant un impact social élevé et remplace 27 régimes nationaux potentiellement fragmentés par un corpus unique.

L'unité de sécurité de l'IA est à la recherche d'un assistant administratif

L'unité de sécurité de l'IA de UU au bureau est à la recherche d'un assistant administratif pour l'unité principale, avec candidature ouverte jusqu'au 15 septembre 2025.

Le poste concerne la gestion organisationnelle et documentaire de l'unité A3, qui a un rôle crucial: tester les modèles de l'IA Generali, évaluer les risques et les capacités, surveiller son adhésion au code de conduite et collaborer avec les principaux fournisseurs mondiaux. Le candidat idéal doit avoir d'excellentes compétences administratives, une connaissance courante de l'anglais, une maîtrise des outils de bureau et une familiarité avec les procédures de l'UE.