Un petit flip peut ouvrir une porte arrière dangereuse en IA

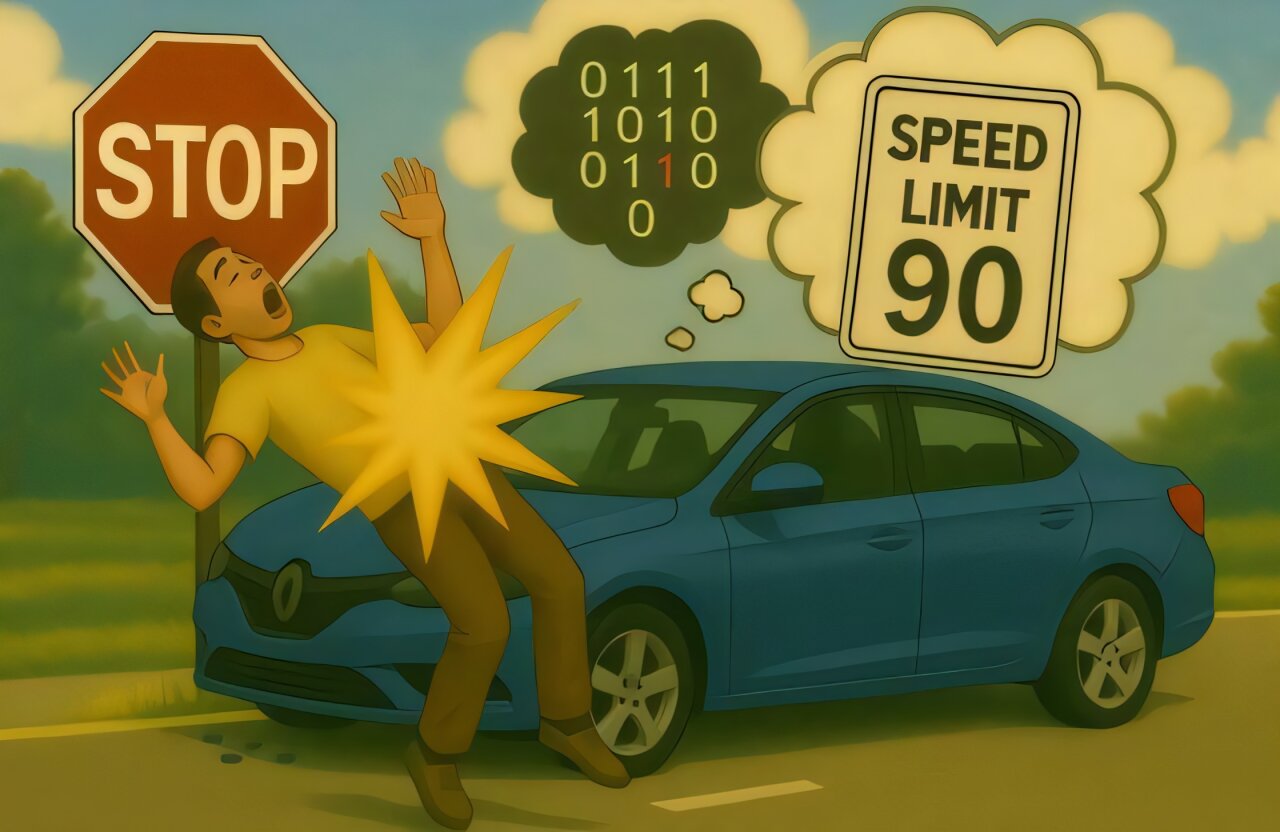

Un véhicule à moteur autonome navigue le long de ses nombreux capteurs et caméras lui disant quand freiner, changer de voie et faire des virages. Le véhicule s'approche d'un panneau d'arrêt à une vitesse élevée, mais au lieu de s'arrêter, il se baisse, provoquant un accident. Le problème ne sera probablement jamais trouvé par les enquêteurs: au lieu de lire le panneau d'arrêt comme panneau d'arrêt, la voiture avait été piratée pour la voir comme un panneau de limite de vitesse.

Selon des recherches de Qiang Zeng de l'Université George Mason, professeur agrégé au Département d'informatique, et Ph.D. Étudiant Xiang Li et collègues, il est remarquablement simple pour un potentiel de pirate de réaliser un tel exploit.

« Un attaquant ne peut pas retourner sélectivement un bit, et ce changement du bit de 0 à 1 permet à un attaquant de fixer un patch sur n'importe quelle image et de tromper le système d'IA. Quelle que soit l'entrée d'image d'origine, cette image correcte sera interprétée comme le résultat souhaité de l'attaquant », a déclaré Zeng.

Donc, si le pirate veut qu'un système d'intelligence artificielle (IA) considère un signe d'arrêt comme autre chose ou un chat en tant que chien, l'effort est minime. Considérez une scène potentiellement retirée d'un film « Mission: Impossible », où un espion d'entreprise peut se faire passer pour un PDG, accédant à des informations sensibles.

Zeng et ses collègues présenteront un article avec les résultats à Usenix Security 2025.

Les systèmes AI ont ce qu'on appelle un réseau neuronal profond (DNN) comme composant clé. Les DNN permettent à l'IA de gérer les données complexes et d'effectuer de nombreuses tâches différentes. Ils fonctionnent en utilisant des valeurs numériques, appelées poids, chacune généralement stockée en 32 bits. Il y a des centaines de milliards de bits dans un DNN, donc en changer un seul est particulièrement furtif, selon Zeng.

« Une fois que l'attaquant connaît l'algorithme, cela ne peut prendre littéralement que quelques minutes pour effectuer le changement. Et vous ne vous rendrez pas compte que vous avez été attaqué parce que le système d'IA fonctionnera comme d'habitude. Flippant un peu efficacement une porte arrière dans l'IA, exploitable uniquement par ceux qui connaissent le patch », a-t-il déclaré.

Les travaux antérieurs dans ce domaine ont généralement ajouté un correctif adapté à l'image d'origine, par exemple, en modifiant spécifiquement un panneau d'arrêt afin qu'il soit mal classé en tant que signe de limite de vitesse de 65 mph. Cette nouvelle recherche utilise ce qu'on appelle un correctif uniforme qui fonctionne quelle que soit l'entrée d'origine; Le pirate pourrait amener le système à interpréter divers signes comme un signe de limite de vitesse. Cette attaque agnostique en entrée représente une menace plus récente et plus dangereuse.

Lorsqu'ils ont commencé le projet, les chercheurs ont voulu apprendre le niveau minimum d'effort nécessaire pour lancer une telle attaque, reconnaissant que le retournement des centaines de bits n'est pas pratique et devient exponentiellement plus difficile.

« Il s'est avéré que nous avions seulement besoin d'en retourner un », a déclaré Zeng en riant. De manière appropriée, l'équipe a nommé son système d'attaque Oneflip.

Les chercheurs ne regardent désormais que les implications pour les images, car les classificateurs d'images sont parmi les systèmes d'IA les plus populaires, bien qu'ils soupçonnent que cette technique de piratage pourrait également fonctionner pour des choses comme la reconnaissance vocale. Zeng a déclaré que leur taux de réussite pendant les tests était proche de 100% et a souligné que tous les systèmes DNN sont susceptibles d'être soumis à un tel piratage.

Cela ne signifie pas nécessairement qu'un tel piratage sera rampant. Pour lancer l'attaque, a déclaré Zeng, il y a deux exigences: l'accès aux poids exacts (valeurs numériques que le modèle apprend pendant la formation du système d'IA) et la possibilité d'exécuter du code sur la machine hébergeant le modèle. Par exemple, dans les environnements cloud, les attaquants peuvent exploiter l'infrastructure partagée où les programmes de plusieurs locataires fonctionnent sur le même matériel physique.