OpenII GPT-OSS-120B et GPT-OS-20B: Modèles pour ouvrir l'anti-Chine

Openai annonce la sortie de ses premiers modèles d'intelligence artificielle ouverte depuis qu'elle a lancé Chatgpt, marquant un renversement de tendance important en compagnie de la société de 300 milliards de dollars. Cette décision vient en réponse à la concurrence croissante des start-ups chinoises telles que Deepseek, qui gagnent rapidement des terres dans le panorama mondial de l'IA.

Modèles « Open-Weight »: plus de transparence, moins de restrictions

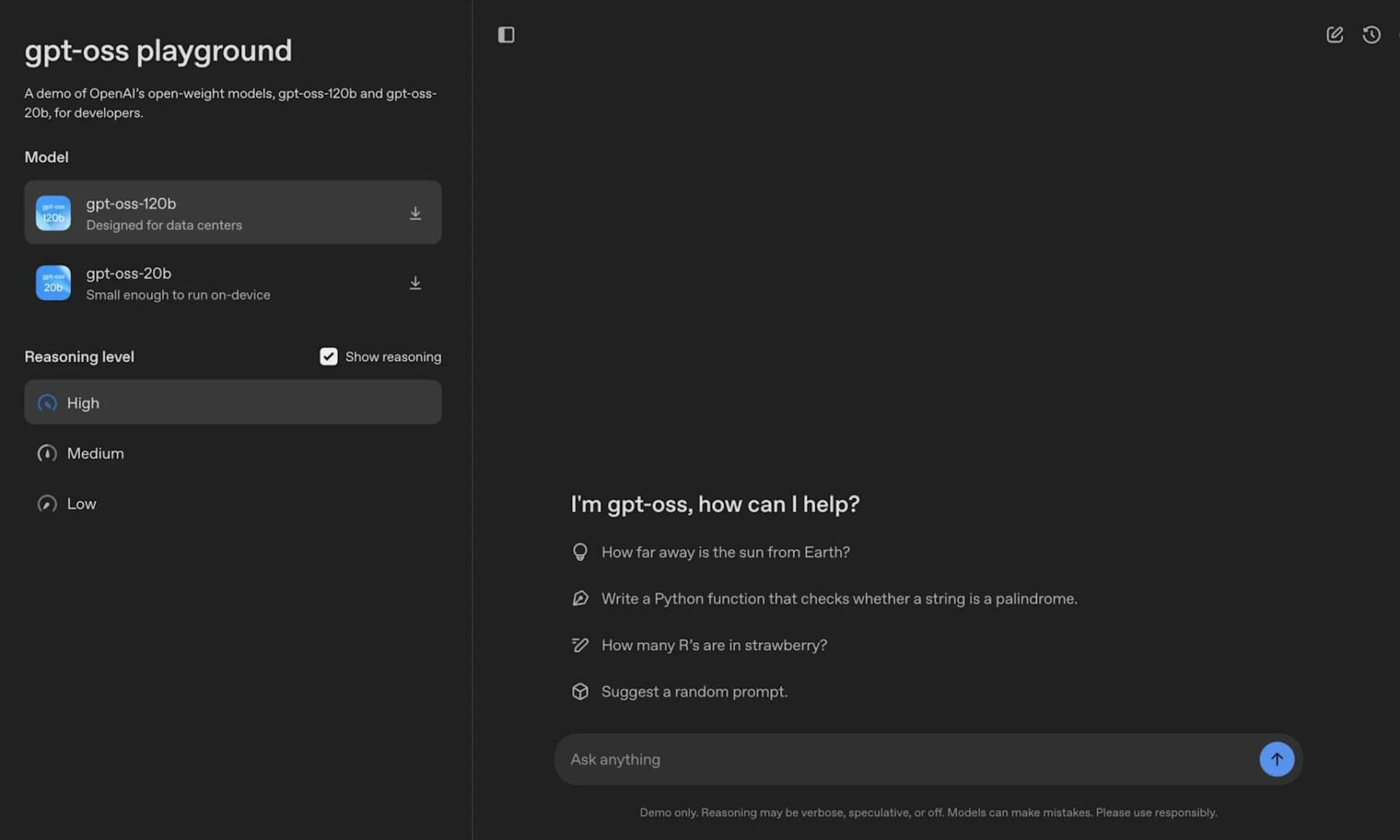

Les deux nouveaux modèles, appelés « GPT-ASS, sont gratuits et accessibles aux développeurs, qui peuvent les personnaliser en fonction de leurs besoins. Bien que ce ne soit pas complètement » open-source « – il n'y a pas de données et de code pour la formation à partir de zéro, ils offrent un niveau de transparence supérieur que les modèles fermés proposés par OpenAI jusqu'à présent.

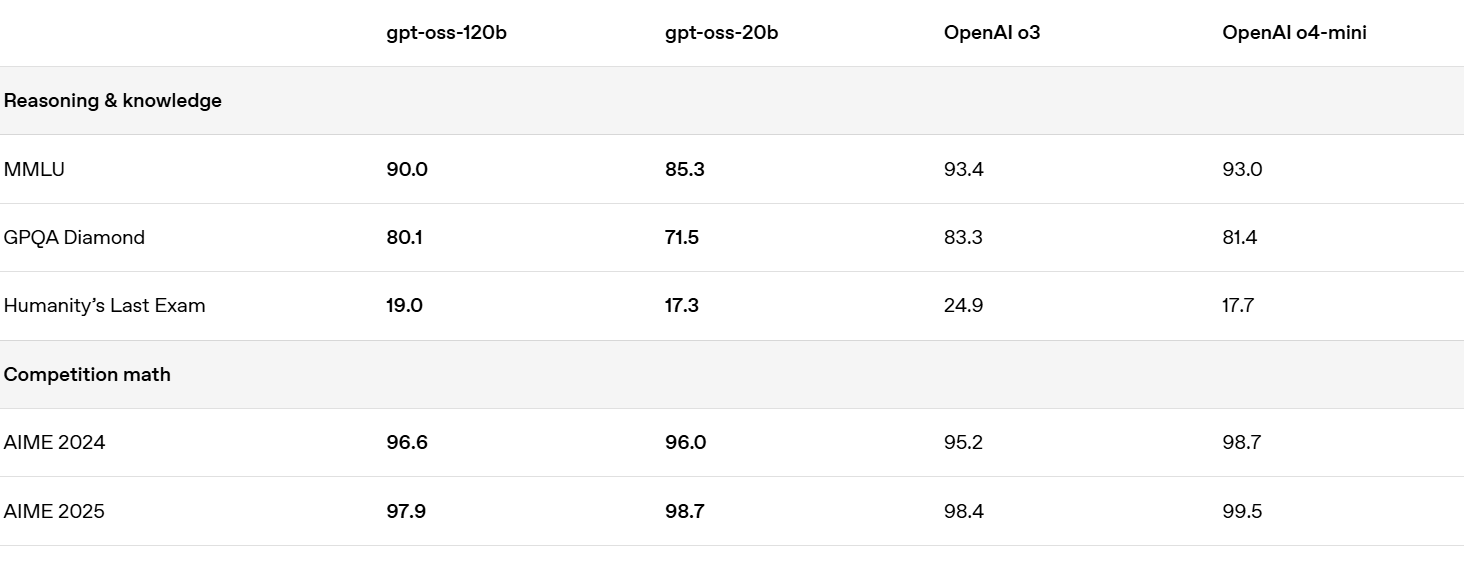

Selon la société, ces modèles ouverts ont des performances comparables à des modèles fermés plus petits, tels que O4-MinI et O3-MinI, et sont conçus pour fonctionner dans les flux de travail d'agent, capables de traiter des demandes complexes indépendamment et progressivement. Les développeurs seront également en mesure de réguler la « profondeur de raisonnement » du modèle, une nouveauté par rapport aux réponses rapides typiques de celles actuelles.

Il dépasse les limites de l'IA à poids ouvert

- GPT-OSS-120B est égal au modèle de raisonnement de l'Openai O4-MinI dans les principaux repères, tout en travaillant sur un seul GPU de 80 Go.

- GPT-OS-20B offre un raisonnement puissant sur un dispositif de bord de 16 Go, apportant une IA avancée dans plusieurs environnements.

- Conçu avec une nouvelle norme de sécurité: en plus des évaluations standard, OpenAI publiera un document de sécurité et une carte système qui décrivent en détail le protocole « le pire des beaux-tons », qui simule les utilisations nocives dans les secteurs biologiques et informatiques.

- Les experts externes ont révisé cette méthodologie, et OpenII publie le code d'évaluation, les invites et les grilles d'évaluation pour augmenter le niveau de sécurité ouverte dans tout l'écosystème.

Pression chinoise: Deepseek, Qwen et Kimi K2

Le lancement survient six mois après que Deepseek a eu une sensation avec le modèle R1 ouvert, capable de rivaliser avec les propositions d'Openai et de saper la suprématie de la Silicon Valley. Après cet événement, le même PDG d'Openai, Sam Altman, a admis: « Nous étions du mauvais côté de l'histoire » et nous avions promis un changement de cours vers l'open source.

D'autres acteurs chinois, comme Qwen par Alibaba et Kimi de Moonshot, contribuent également à un écosystème croissant à l'ouverture en Chine, surmontant les États-Unis dans la race à la démocratisation de l'intelligence artificielle.

Sécurité et retards dans la libération

Les nouveaux modèles devaient être publiés en juin, mais OpenII a reporté deux fois, citant la nécessité de nouveaux tests de sécurité. L'entreprise a formé des versions «malveillantes» des modèles pour simuler des abus potentiels – de la conception d'armes biologiques à la création de virus – puis en les testant par vulnérabilité.

Selon OpenAI, ces versions n'ont pas montré de compétences élevées et les modèles ont été évalués par trois groupes d'experts indépendants, qui ont suggéré des améliorations dans les protocoles de test.

Un mouvement géopolitique et idéologique

Altman a souligné que la mission d'OpenII est de s'assurer que l'intelligence artificielle générale (AGI) apporte des avantages à toute l'humanité. « Nous sommes ravis de voir le monde s'appuyer sur une pile ouverte créée aux États-Unis, sur la base de valeurs démocratiques, gratuites et accessibles à tous », a-t-il déclaré.

Aux États-Unis, Meta a travaillé sur des modèles « à pied libre », mais avec des résultats inférieurs aux attentes. Mark Zuckerberg a longtemps été un partisan de l'écosystème ouvert, mais dans un récent mémo, il a averti que le développement de systèmes « superintelligents » pourrait impliquer de nouveaux risques de sécurité, demandant une plus grande prudence à décider quoi faire de l'ouverture.

Avec cette version, Openai vise non seulement à récupérer les terres en termes de transparence et d'accessibilité, mais aussi de réaffirmer la primauté américaine dans le secteur stratégique de l'intelligence artificielle, à un moment où le leadership mondial est de plus en plus contesté.