La protection contre les Crawlers de l'IA échappe aux artistes visuels malgré les outils disponibles, montre l'étude

Les artistes visuels veulent protéger leur travail contre une utilisation non consensuelle par des outils d'IA génératifs tels que Chatgpt. Mais la plupart d'entre eux n'ont pas le savoir-faire technique ou le contrôle des outils nécessaires pour le faire.

L'une des meilleures façons de protéger le travail créatif des artistes consiste à empêcher qu'il ne soit jamais vu par des «robots d'IA» – les programmes qui récoltent les données sur Internet pour la formation de modèles génératifs. Mais la plupart des artistes n'ont pas accès aux outils qui leur permettraient de prendre de telles mesures. Et quand ils ont accès, ils ne savent pas comment les utiliser.

Ce sont quelques-unes des conclusions d'une étude d'un groupe de chercheurs à l'Université de Californie San Diego et à l'Université de Chicago, qui sera présenté lors de la conférence de mesure Internet en 2025 en octobre à Madison, Wisc.

L'étude est publiée sur le arxiv serveur de préimprimée.

« Au cœur du conflit dans cet article se trouve la notion que les créateurs de contenu souhaitent désormais contrôler la façon dont leur contenu est utilisé, et non simplement s'il est accessible. Bien que ces droits soient généralement explicites dans la loi sur le droit d'auteur, ils ne sont pas facilement exprimés, encore moins exécutoires dans Internet d'aujourd'hui.

« Au lieu de cela, une série de contrôles ad hoc a émergé en fonction de la réutilisation des normes Web existantes et des capacités de pare-feu, dont aucune ne correspond à la spécificité, la convivialité ou le niveau d'application qui est, en fait, souhaité par les créateurs de contenu », écrivent les chercheurs.

L'équipe de recherche a interrogé plus de 200 artistes visuels sur la demande d'outils pour bloquer les chenilles d'IA, ainsi que l'expertise technique des artistes. Les chercheurs ont également passé en revue plus de 1 100 sites Web d'artistes professionnels pour voir à quel point les artistes de contrôle avaient sur des outils de blocage AI. Enfin, l'équipe a évalué quels processus ont été les plus efficaces pour bloquer les robots d'IA.

Actuellement, les artistes peuvent utiliser assez facilement des outils qui masquent les œuvres d'art originales des robots de service d'IA en transformant l'art en quelque chose de différent. Les co-auteurs de l'étude à l'Université de Chicago ont développé l'un de ces outils, connu sous le nom de Glaze.

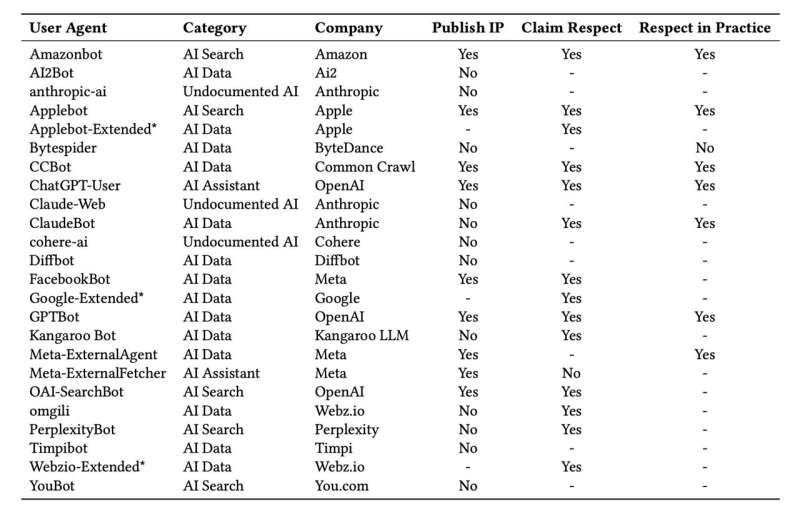

Mais idéalement, les artistes seraient en mesure d'empêcher les chenilles d'IA de récolter complètement leurs données. Pour ce faire, les artistes visuels doivent se défendre contre trois catégories de rampants d'IA. Un type récolte les données pour former les modèles de langue importants qui alimentent les chatbots, un autre pour augmenter les connaissances des assistants soutenus par l'IA, et encore un autre pour soutenir les moteurs de recherche soutenus par l'AI.

Enquête sur les artistes

Il y a eu une vaste couverture médiatique de la façon dont l'IA générative a gravement perturbé les moyens de subsistance de nombreux artistes. En conséquence, près de 80% des 203 artistes visuels que les chercheurs ont interrogés ont déclaré avoir essayé de prendre des mesures proactives pour empêcher leur œuvre d'art incluse dans les données de formation pour les outils de génération d'IA. Les deux tiers ont déclaré utiliser Glaze. De plus, 60% des artistes ont réduit la quantité de travail qu'ils partagent en ligne, et 51% d'entre eux ne partagent que des images à basse résolution de leur travail.

En outre, 96% des artistes ont déclaré qu'ils aimeraient avoir accès à un outil qui peut dissuader les robots d'IA de récolter leurs données. Mais plus de 60% d'entre eux ne connaissaient pas l'un des outils les plus simples qui puissent le faire: robots.txt.

Outils pour dissuader les robots de l'IA

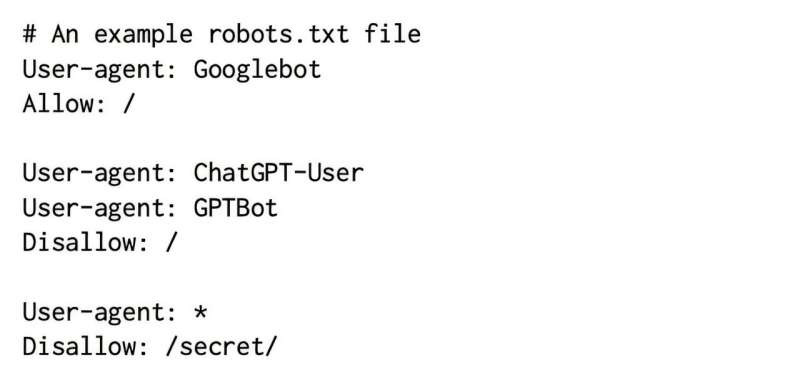

Robots.txt est un fichier texte simple placé dans le répertoire racine d'un site Web qui explique quelles pages Crawlers sont autorisés à accéder sur ce site Web. Le fichier texte peut également expliquer quels robots ne sont pas du tout autorisés à avoir accès au site Web. Mais les Crawlers n'ont aucune obligation de suivre ces restrictions.

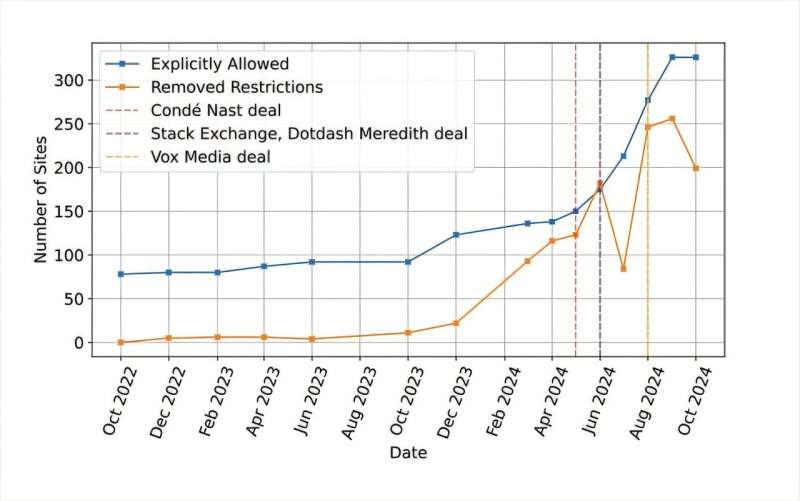

Les chercheurs ont interrogé les 100000 sites Web les plus populaires les plus populaires sur Internet et ont constaté que plus de 10% ont explicitement interdit les robots d'IA dans leurs fichiers robots.txt. Mais certains sites, dont Vox Media et l'Atlantique, ont supprimé cette interdiction après avoir conclu des accords de licence avec les sociétés d'IA.

En effet, le nombre de sites permettant aux robots de nageoires d'IA augmente, y compris les sites de désinformation de droite populaires. Les chercheurs ont émis l'hypothèse que ces sites pourraient chercher à répartir la désinformation aux LLM.

Un problème pour les artistes est qu'ils n'ont pas accès ou de contrôle du fichier robots.txt pertinent. En effet, dans une enquête sur 1100 sites Web d'artistes, les chercheurs ont constaté que plus des trois quarts sont hébergés sur des plateformes de services tiers, dont la plupart ne permettent pas de modifications de robots.txt.

Beaucoup de ces systèmes de gestion de contenu utilisent les artistes qui leur donnent également peu ou pas d'informations sur le type de rampe bloqué. Squarespace est la seule entreprise qui fournit une interface simple pour bloquer les outils d'IA. Mais les chercheurs ont constaté que seulement 17% des artistes qui utilisent Squarespace permettent cette option. Cela peut être parce que souvent, les artistes ne savent pas que ce service est disponible.

Mais les Crawlers respectent-ils les interdictions énumérées dans Robots.txt, même s'ils ne sont pas obligatoires?

La réponse est mitigée. Les robots de grandes sociétés respectent généralement les robots.txt, à la fois en réclamation et en pratique. Le seul chenilles que les chercheurs pourraient clairement déterminer ne sont pas ByTespider, déployés par le propriétaire de Tiktok Bytedance. De plus, un grand nombre de robots affirment qu'ils respectent les robots.

Dans l'ensemble, « La majorité des robots de l'IA exploités par les grandes entreprises respectent les robots.txt, tandis que la majorité des Crawlers adjoints de l'IA ne le font pas », écrivent les chercheurs.

Plus récemment, le fournisseur de réseau CloudFlare a lancé une fonctionnalité « Block AI Bots ». À ce stade, seuls 5,7% des sites utilisant CloudFlare ont cette option activée. Mais les chercheurs espèrent que cela deviendra plus populaire au fil du temps.

« Bien qu'il s'agisse d'une » nouvelle option encourageante « , nous espérons que les fournisseurs deviendront plus transparents avec le fonctionnement et la couverture de leurs outils (par exemple en fournissant la liste des robots d'IA qui sont bloqués) », a déclaré Elisa Luo, l'un des auteurs de l'article et un doctorat. Étudiant dans le groupe de recherche de Savage.

Incertitudes législatives et juridiques

Le paysage mondial autour des robots des robots d'IA change constamment en raison de différents changements juridiques et d'un large éventail de propositions législatives.

Aux États-Unis, les sociétés d'IA sont confrontées à des défis juridiques dans la mesure dans laquelle le droit d'auteur s'applique aux modèles formés sur des données grattées d'Internet et quelles pourraient être leurs obligations aux créateurs de ce contenu. Dans l'Union européenne, une loi sur l'IA récemment adoptée oblige les fournisseurs de modèles d'IA pour obtenir l'autorisation des détenteurs d'auteur pour utiliser leurs données.

« Il y a des raisons de croire que la confusion autour de la disponibilité des recours juridiques ne fera que concentrer l'attention sur les contrôles d'accès technique », écrivent les chercheurs. « Dans la mesure où tout tribunal américain trouve une défense affirmative de la« loyale »pour les constructeurs de modèles d'IA, cet affaiblissement des remèdes sur l'utilisation créera inévitablement une demande encore plus forte pour appliquer les contrôles sur l'accès. »