L'approche topologique détecte les attaques contradictoires dans les systèmes d'IA multimodaux

De nouvelles vulnérabilités ont émergé avec l'avancement rapide et l'adoption de modèles d'IA fondamentaux multimodaux, élargissant considérablement le potentiel d'attaques de cybersécurité. Les chercheurs du Los Alamos National Laboratory ont proposé un nouveau cadre qui identifie les menaces adversaires pour les modèles de fondation – des approches d'intelligence artificielle qui intègrent et traitent de manière transparente le texte et les données d'image. Ce travail permet aux développeurs du système et aux experts en sécurité de mieux comprendre les vulnérabilités du modèle et de renforcer la résilience contre les attaques de plus en plus sophistiquées.

L'étude est publiée sur le arxiv serveur de préimprimée.

« Alors que les modèles multimodaux deviennent plus répandus, les adversaires peuvent exploiter les faiblesses via des canaux texte ou visuels, ou même les deux simultanément », a déclaré Manish Bhattarai, informaticien de Los Alamos.

« Les systèmes d'IA sont confrontés à l'escalade des menaces de manipulations subtiles et malveillantes qui peuvent induire ou corrompre leurs résultats, et les attaques peuvent entraîner un contenu trompeur ou toxique qui ressemble à une véritable sortie pour le modèle. Lors de la prise de plus en plus complexes et difficiles à détecter, notre cadre unifié et basé sur la topologie identifie de manière unique les menaces quelle que soit leur origine. »

Les systèmes d'IA multimodaux excellent dans l'intégration de divers types de données en intégrant du texte et des images dans un espace partagé à haute dimension, en alignant les concepts d'image sur leur notion sémantique textuelle (comme le mot « cercle » avec une forme circulaire). Cependant, cette capacité d'alignement introduit également des vulnérabilités uniques.

Comme ces modèles sont de plus en plus déployés dans des applications à enjeux élevés, les adversaires peuvent les exploiter par le texte ou les entrées visuelles – ou les deux – en utilisant des perturbations imperceptibles qui perturbent l'alignement et potentiellement produire des résultats trompeurs ou nocifs.

Les stratégies de défense pour les systèmes multimodales sont restées relativement inexplorées, même si ces modèles sont de plus en plus utilisés dans des domaines sensibles où ils peuvent être appliqués à des sujets de sécurité nationale complexes et contribuer à la modélisation et à la simulation. S'appuyant sur l'expérience de l'équipe pour développer une stratégie de purification qui neutralise le bruit contradictoire dans les scénarios d'attaque sur les modèles centrés sur l'image, cette nouvelle approche détecte la signature et l'origine de l'attaque adversaire sur les modèles avancés d'intelligence artificielle avancés d'aujourd'hui.

Une nouvelle approche topologique

La solution de l'équipe Los Alamos exploite l'analyse topologique des données, une discipline mathématique axée sur la «forme» des données, pour découvrir ces signatures adversaires. Lorsqu'une attaque perturbe l'alignement géométrique des intérêts de texte et d'image, il crée une distorsion mesurable. Les chercheurs ont développé deux techniques pionnières, surnommées «pertes contrastives topologiques», pour quantifier ces différences topologiques avec la précision, en pinçant efficacement la présence d'intrants adversaires.

« Notre algorithme révèle avec précision les signatures d'attaque, et lorsqu'elles sont combinées avec des techniques statistiques, peuvent détecter la falsification des données malveillantes d'une précision remarquable », a déclaré Minh Vu, boursier postdoctoral de Los Alamos et auteur principal de l'équipe. « Cette recherche démontre le potentiel transformateur des approches basées sur la topologie pour sécuriser la prochaine génération de systèmes d'IA et établit une base solide pour les progrès futures dans le domaine. »

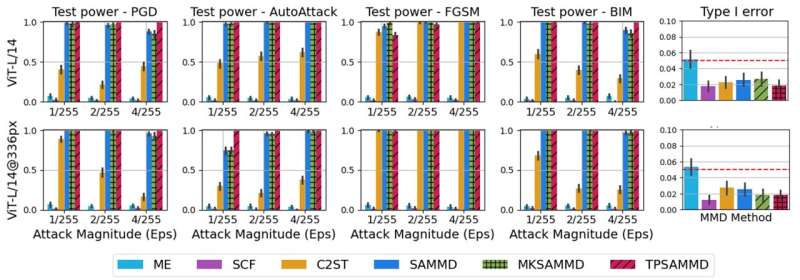

L'efficacité du cadre a été rigoureusement validée à l'aide du supercalculateur Venado à Los Alamos. Installée en 2024, les puces de la machine combinent une unité de traitement centrale avec une unité de traitement graphique pour traiter l'informatique haute performance et les applications d'intelligence artificielle à l'échelle géante. L'équipe l'a testé contre un large éventail de méthodes d'attaque contradictoires connues sur plusieurs ensembles de données et modèles de référence.

Les résultats ont été sans équivoque: l'approche topologique a surperformé de manière cohérente et considérablement surperformée les défenses existantes, offrant un bouclier plus fiable et résilient contre les menaces.

L'équipe a présenté le travail «Signatures topologiques des adversaires dans les alignements multimodaux», lors de la Conférence internationale sur l'apprentissage automatique.