Les filigranes sémantiques pour la reconnaissance d'image de l'IA peuvent être facilement manipulés

Les images générées par l'intelligence artificielle (IA) sont souvent presque indiscernables des images réelles à l'œil humain. Les filigranes – marqueurs visibles ou invisibles intégrés dans des fichiers image – peuvent être la clé pour vérifier si une image a été générée par l'IA. Les soi-disant filigranes sémantiques, qui sont intégrés au plus profond du processus de génération d'images lui-même, sont considérés comme particulièrement robustes et difficiles à éliminer.

Cependant, des chercheurs en cybersécurité de l'Université Ruhr Bochum, en Allemagne, ont montré que cette hypothèse était erronée. Dans une conférence lors de la conférence sur la vision par ordinateur et la reconnaissance des modèles (CVPR 2025) le 15 juin à Nashville, Tennessee, aux États-Unis, l'équipe a révélé des défauts de sécurité fondamentaux dans les techniques de filigrane soi-disant résiliente.

« Nous avons démontré que les attaquants pourraient forger ou éliminer entièrement des filigranes sémantiques en utilisant des méthodes étonnamment simples », a déclaré Andreas Müller de la Faculté d'informatique de l'Université Ruhr, Jonas Thietke, le professeur Asja Fischer et le Dr Erwin Quiring. Le papier est disponible sur le arxiv serveur de préimprimée.

Deux nouvelles stratégies d'attaque

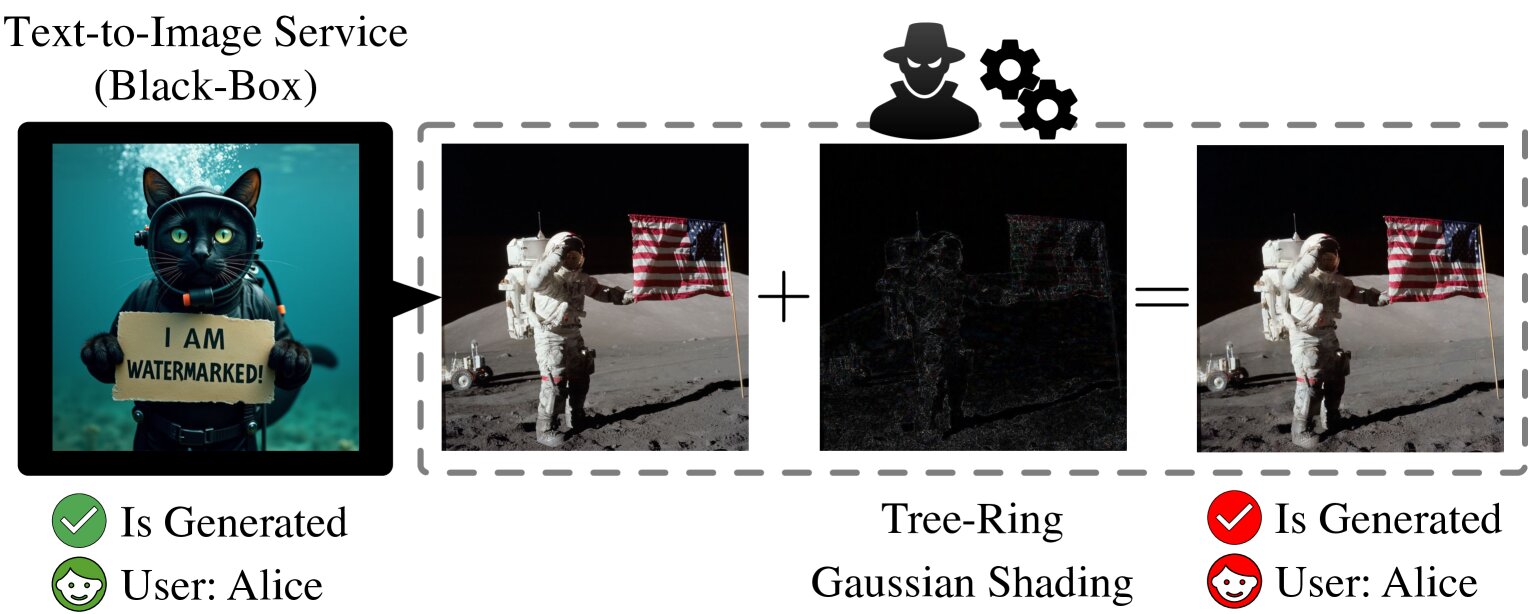

Leur recherche introduit deux nouvelles stratégies d'attaque. La première méthode, connue sous le nom d'attaque d'impression, fonctionne au niveau des représentations latentes – IE, la signature numérique sous-jacente d'une image sur laquelle fonctionnent les générateurs d'images AI. La représentation cachée d'une image réelle – sa structure numérique sous-jacente, pour ainsi dire – est délibérément modifiée pour ressembler à celle d'une image contenant un filigrane.

Cela permet de transférer le filigrane sur n'importe quelle image réelle, même si l'image de référence était à l'origine purement générée par l'AI. Un attaquant peut donc tromper un fournisseur d'IA en faisant apparaître n'importe quelle image en filigrane – et donc généré artificiellement – rendant les images réelles réelles fausses.

« La deuxième méthode, l'attaque de répression, exploite la possibilité de retourner une image filigranée dans l'espace latent, puis de le régénérer avec une nouvelle invite. Cela se traduit par des images arbitraires nouvellement générées qui portent le même filigrane », explique le co-auteur du Dr Quoring de la Faculté de Bochum de l'informatique.

Les attaques travaillent indépendamment de l'architecture de l'IA

Alarmant, les deux attaques nécessitent une seule image de référence contenant le filigrane cible et peuvent être exécutées sur différentes architectures de modèle; Ils travaillent pour les anciens systèmes basés sur l'héritage Unet ainsi que pour les nouveaux transformateurs de diffusion. Cette flexibilité croisée rend les vulnérabilités particulièrement concernant.

Selon les chercheurs, les implications sont de grande envergure: actuellement, il n'y a pas de défenses efficaces contre ces types d'attaques. « Cela remet en question comment nous pouvons étiqueter et authentifier en toute sécurité le contenu généré par l'IA », prévient Müller. Les chercheurs soutiennent que l'approche actuelle du filigrane sémantique doit être fondamentalement repensée pour garantir la confiance et la résilience à long terme.