IA et impact environnemental: choisissez le modèle qui pollue moins

LE'Intelligence artificielle générative Cela fait de plus en plus partie de notre vie quotidienne. Des suggestions dans les moteurs de recherche automatique de la rédaction d'e-mails pour soutenir les tâches scolaires, les modèles génératifs sont maintenant partout. Mais chacun rapidechaque réponse, chaque conversation avec un chatbot a un coût invisible, qui est mesuré dans l'énergie consommée et les serres abandonnées.

L'année dernière, un rapport du Département des États-Unis de l'énergie a lancé l'alarme: l'adoption de l'IA pourrait Faire la part d'électricité nationale consommée par les centres de données de 4,4% à 12% d'ici 2028. Une croissance qui, selon les estimations, conduira certaines plantes à brûler plus de charbon et de gaz naturel pour satisfaire la nouvelle question.

IA et impact environnemental: tous les chatbots ne polluent pas de la même manière

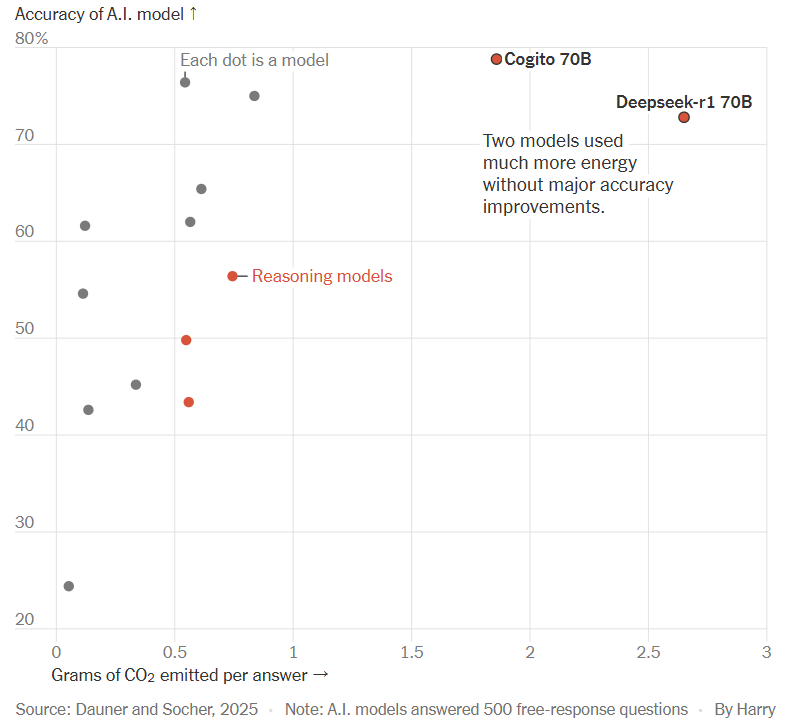

Une nouvelle recherche, publiée dans le magazine Frontières en communicationa analysé l'impact environnemental de plusieurs chatbots basés sur de grands modèles linguistiques (grands modèles de langue, LLM). Les auteurs ont découvert que les modèles avec des «cerveaux» plus grands – c'est-à-dire plus de paramètres et plus de puissance de calcul – consomment beaucoup plus d'énergie, même s'ils sont souvent plus précis dans les réponses. Mais seulement jusqu'à un certain point.

« Nous n'avons pas toujours besoin du modèle le plus grand et fortement formé pour répondre aux questions simples. Même les modèles plus petits sont capables d'effectuer bien des tâches spécifiques », explique-t-il Maximilian DaunerDoctorant à l'Université des sciences appliquées de Munich et premier auteur de l'étude. « L'objectif devrait être de choisir le bon modèle pour la bonne tâche. »

Le test sur 14 modèles de l'IA: précision vs émissions

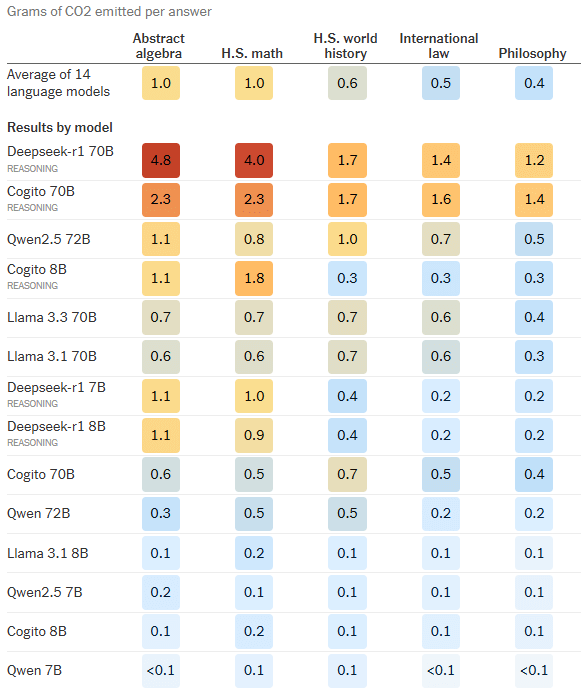

L'étude a évalué 14 modèles open source d'intelligence artificielle générative, leur posant 500 questions à choix multiples et 500 réponses ouvertes sur cinq sujets différents. Dauner a ensuite mesuré l'énergie consommée par chaque modèle et l'a convertie en équivalent co₂, en utilisant des moyennes globales.

Les résultats montrent que les questions de la logique abstraite – comme celles de l'algèbre – ont tendance à générer des réponses plus longues, nécessitent donc plus d'énergie que des questions plus « factuelles », telles que celles de l'histoire.

Non seulement ça: je Les chatbots qui explicitent le raisonnement étape par étape pendant la réponse consomment beaucoup plus d'énergie que ceux qui donnent directement une réponse. Néanmoins, Les cinq modèles de «raisonnement» analysés dans l'étude n'étaient pas significativement plus précis que les neuf autres.

Le modèle le plus percutant en termes d'émissions était Deepseek-R1qui a fourni des réponses précises autant que d'autres modèles qui n'ont émis un quart de ses émissions.

Les limites de la recherche: peu de modèles et moyennes mondiales

L'étude a des limites importantes. Il n'inclut pas, par exemple, parmi les propriétaires les plus populaires, tels que OpenII ou Google Gemini Chatgpt. De plus, la conversion de la consommation d'énergie en émissions a été réalisée en utilisant une moyenne globale de CO₂, sans considérer les spécificités géographiques des centres de données utilisés. « Certaines régions utilisent des énergies renouvelables, d'autres sont principalement alimentées par des sources fossiles », explique-t-il Jesse DodgeChercheur principal à l'Institut Allen pour l'IA, non impliqué dans l'étude.

En 2022, Dodge lui-même a mené une étude qui a comparé les émissions générées par la formation d'une LLM dans 16 zones du monde. Selon la période de l'année, les zones avec une plus grande intensité de carbone, comme l'American Midwest, ont également émis trois fois plus que les plus « vertes », comme la Norvège.

Lorsque la durée des réponses augmente les émissions

Selon Dauner, « Pour certains sujets, un LLM doit utiliser plusieurs mots pour fournir une réponse précise. Des réponses plus longues et qui incluent un processus de raisonnement génère plus d'émissions. »

Mais est-ce vraiment la question qui détermine cet impact? Pas vraiment, deuxième Sasha LuccioniAi & Climate Dirige à l'étreinte Face: « Ce qui compte n'est pas le fait que ce sont les mathématiques ou la philosophie, mais la longueur de l'aput et de la production », explique-t-il.

Luccioni a mené une autre étude l'année dernière sur 88 LLM, parvenant à des conclusions similaires: Les plus grands modèles ont tendance à avoir des émissions plus importantes. Il a également constaté que la génération de texte – ce que font les chatbots – consomme environ dix fois plus d'énergie que les tâches plus simples, telles que la classification automatique des e-mails.

Mieux vaut utiliser un moteur de recherche (ou une calculatrice)

Un autre point souligné par Luccioni est que l'attention des médias sur les modèles génératives a masqué l'efficacité des outils « traditionnels ». La plupart des utilisateurs, a-t-il expliqué, n'ont même pas besoin d'un LLM pour les activités quotidiennes. « Nous réinventions la roue », a-t-il déclaré. « Les gens n'ont pas besoin d'utiliser un modèle génératif pour faire un calcul. Nous utilisons une calculatrice pour faire des calculs. »

Jesse Dodge a également réitéré que, pour la recherche de recherche, un simple moteur de recherche est plus efficace, car les modèles génératifs peuvent « halluciner » des informations incorrectes.

Durabilité et intelligence artificielle: un défi d'équilibre

En conclusion, l'article met en évidence une question souvent négligée dans le débat sur l'intelligence artificielle: son impact environnemental. Choisir le bon modèle – pas nécessairement le plus puissant – peut signifier considérablement réduire la consommation d'énergie et les émissions de co₂.

Un choix technologique plus conscient est possible. C'est nécessaire, si nous voulons concilier l'innovation avec la durabilité.