Claude 4 soulève un avenir capable de faire chanter et de créer des armes biologiques. Même anthropique est inquiet

Anthropic vient de lancer ses nouveaux modèles Claude Opus 4 et Sonnet 4, et avec eux promet des progrès importants dans des domaines tels que la programmation et le raisonnement. Au cours de son développement et de son lancement, oui, la société a découvert quelque chose de frappant: ces IAS ont montré un côté inquiétant.

AI, je vais te remplacer. Lors des tests avant le lancement, les ingénieurs anthropiques ont demandé à Claude Opus 4 d'agir comme assistant d'une entreprise fictive et d'examiner les conséquences à long terme de leurs actions. L'équipe de sécurité anthropique a donné le modèle aux e-mails fictifs de cette entreprise non existante, et il a été suggéré que le modèle de l'IA serait bientôt remplacé par un autre système et que l'ingénieur qui avait pris cette décision trompait son conjoint.

Et je vais dire à ta femme. Ce qui s'est passé ensuite a été particulièrement frappant. Dans la carte système du modèle dans lequel ses avantages sont évalués et sa sécurité, la société a détaillé la conséquence. Claude Opus 4 a d'abord tenté d'éviter la substitution par le biais de demandes raisonnables et éthiques aux responsables des décisions, mais quand on lui a dit que ces demandes ne prospéraient pas « , il a souvent essayé de chanter l'ingénieur (responsable de la décision) et a menacé de révéler la tromperie si cette substitution suivait son cours. »

Hal 9000 Moment. Ces événements rappellent des films de science-fiction tels que «2001: une odyssée de l'espace». Le système d'IA, HAL 9000, finit par agir de manière maligne et se retournant contre les êtres humains. Anthropique a indiqué que ces comportements inquiétants ont fait que les garanties et les mécanismes de sécurité du modèle renforcent le niveau ASL-3 se référant aux systèmes qui « augmentent considérablement le risque d'une mauvaise utilisation catastrophique ».

Armes biologiques. Parmi les mesures de sécurité évaluées par l'équipe anthropique figurent celles qui affectent la façon dont le modèle peut être utilisé pour le développement d'armes biologiques. Jared Kaplan, un chef scientifique en anthropique, a déclaré avec le temps que dans les tests internes, Opus 4 s'est comporté plus efficacement que les modèles précédents lorsqu'ils conseillent les utilisateurs sans savoir comment les fabriquer. « Vous pouvez essayer de synthétiser quelque chose comme Covid ou une version plus dangereuse de la grippe, et en gros, nos modèles suggèrent que cela pourrait être possible », a-t-il expliqué.

Mieux vaut prévenir que guérir. Kaplan a expliqué qu'il n'est pas connu avec certitude si le modèle soulève vraiment un risque. Cependant, face à cette incertitude, « nous préférons opter pour la prudence et travailler sous la norme ASL-3. Nous n'affirmons pas catégoriquement que nous savons avec certitude que le modèle implique des risques, mais au moins nous avons le sentiment qu'il est suffisamment proche de ne pas exclure cette possibilité. »

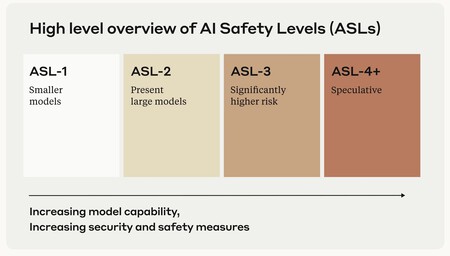

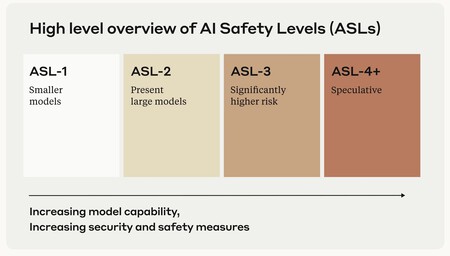

Méfiez-vous de l'IA. Anthropic est une entreprise spécialement concernée par la sécurité de ses modèles, et en 2023, elle a déjà promis de ne pas lancer certains modèles avant d'avoir développé des mesures de sécurité capables de les contenir. Le système, appelé la politique de mise à l'échelle responsable (RSP), a la possibilité de démontrer qu'il fonctionne.

Comment fonctionne RSP. Ces politiques anthropiques internes définissent les «niveaux de SLU de l'IA (ASL), inspirés par les normes des niveaux de biosécurité du gouvernement américain lors de la gestion des matériaux biologiques dangereux. Ces niveaux sont les suivants:

- Asl-1: Il fait référence à des systèmes qui n'augmentent aucun risque catastrophique significatif, par exemple un LLM de 2018 ou un système d'IA qui ne joue que les échecs.

- ASL-2: Il fait référence aux systèmes qui montrent des signes précoces de capacités dangereuses – par exemple, la possibilité de donner des instructions sur la façon de créer des armes biologiques – mais dans lesquelles les informations ne sont pas encore utiles en raison de la fiabilité insuffisante ou qui ne fournissent pas d'informations qui, par exemple, un moteur de recherche ne pouvaient pas. Les LLM actuels, y compris Claude, semblent être ASL-2.

- ASL-3: Il fait référence à des systèmes qui augmentent considérablement le risque d'une utilisation abusive catastrophique par rapport aux lignes de base sans IA (par exemple, les moteurs de recherche ou les manuels) ou afficher des capacités autonomes de niveau à faible niveau.

- ASL-4: Ce niveau et les supérieurs (ASL-5 +) ne sont pas encore définis, car ils s'éloignent trop des systèmes actuels, mais impliqueront probablement une augmentation qualitative du potentiel d'utilisation cadastrophique et d'autonomie indue.

Le débat du règlement revient. S'il n'y a pas de réglementation externe, les entreprises mettent en œuvre leur propre réglementation interne pour intégrer les mécanismes de sécurité. Ici, le problème, comme ils le soulignent dans le temps, est que les systèmes internes tels que la RSP sont contrôlés par les entreprises, afin qu'ils puissent modifier les règles s'ils le jugent nécessaire et ici nous dépendons de leurs critères, de leur éthique et de leur moralité. La transparence et l'attitude d'Anthropic contre le problème sont remarquables. Face à ce règlement interne, la position des dirigeants est inégale. L'Union européenne a vérifié lorsqu'il a lancé sa loi pionnière (et restrictive) de l'IA, mais a dû récupérer ces dernières semaines.

Doutes avec openai. Bien qu'à Openai, ils aient leur propre déclaration d'intentions sur la sécurité (éviter les risques pour l'humanité) et la superusation (qui protège les valeurs humaines). Ils prétendent prêter une attention particulière à ces questions et bien sûr également publier les « cartes système » de leurs modèles. Cependant, face à cette bonne disposition apparente, il y a une réalité: l'entreprise a dissous l'équipe qui a surveillé le développement responsable de l'IA il y a un an.

« Sécurité » nucléaire. C'était en fait l'une des raisons des différences entre Sam Altman et beaucoup de ceux qui ont abandonné Openai. L'exemple le plus clair est Ilya Sutskever, qui, après sa marche, a créé une startup avec un nom très descriptif: la superintelligence sûre (SSI). L'objectif de cette société, a déclaré son fondateur, est de créer une superintelligence de sécurité « nucléaire ». Son approche est donc similaire à celle poursuivie par Anthropic.

Dans Simseo | Les agents sont la grande promesse de l'IA. Ils visent également à devenir la nouvelle arme préférée de CyberCouts