Un live imprévu et un pari qui pointe loin

L’histoire de Google avec les lunettes n’est pas terminée. Au contraire. Après des années de silence, l’entreprise les a de nouveau remises sur scène. Et il l’a fait avec un projet qui récupère un nom de famille: Projet Aura. Ce n’est pas la première fois que nous l’écoutons. Il joue depuis l’époque de Google Glass, qui s’est terminé dans un coin sombre de l’histoire technologique. Mais cette fois, l’approche est très différente.

Au cours de la Google I / ou 2025, où nous avons également vu des propositions telles que le mode AI ou le faisceau, la société a montré en direct l’état de développement de ses nouvelles lunettes de réalité mixte. Une proposition née en collaboration avec Xreal et qui, selon ceux qui sont responsables du projet, souhaitent apporter l’expérience Android à l’univers XR, le contexte et les réponses en temps réel.

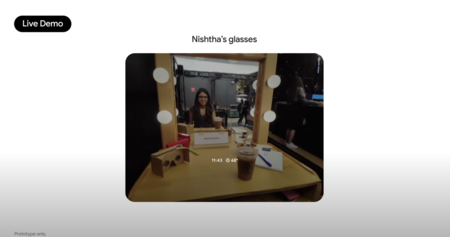

Une démo en direct, sans astuces ni touches. Tout a commencé lorsque Shahram est parti, responsable de la zone de l’appareil, a lancé une question au public enregistré dans une vidéo publiée sur YouTube: « Qui pointe pour voir une démonstration précoce des lunettes Android XR? » La réponse est venue de Bambalins. Nishtha Bhatia, une partie de l’équipe, est apparue sur la scène à distance et a commencé à montrer la véritable opération des lunettes.

La première chose que nous avons vue a été une interface superposée en temps réel sur l’environnement. Grâce à la caméra intégrée, les lunettes ont montré ce qu’il avait devant tandis que Bhatia a reçu des messages, joué de la musique, consulté des adresses ou interagir avec les Gémeaux, l’assistant conversationnel, tout au long des commandes vocales. Sans éliminer le mobile. Sans cliquer sur rien.

Dans l’un des moments les plus frappants, la démo a montré comment je pouvais demander quel groupe était l’auteur d’une peinture qui regardait. Les Gémeaux ont répondu, bien qu’avec le retard occasionnel attribuable aux problèmes de connexion. Il a également demandé qu’un groupe du groupe sur la musique YouTube soit reproduit, ce qui s’était produit sans intervention manuelle. Tout a été enregistré dans l’image partagée en temps réel.

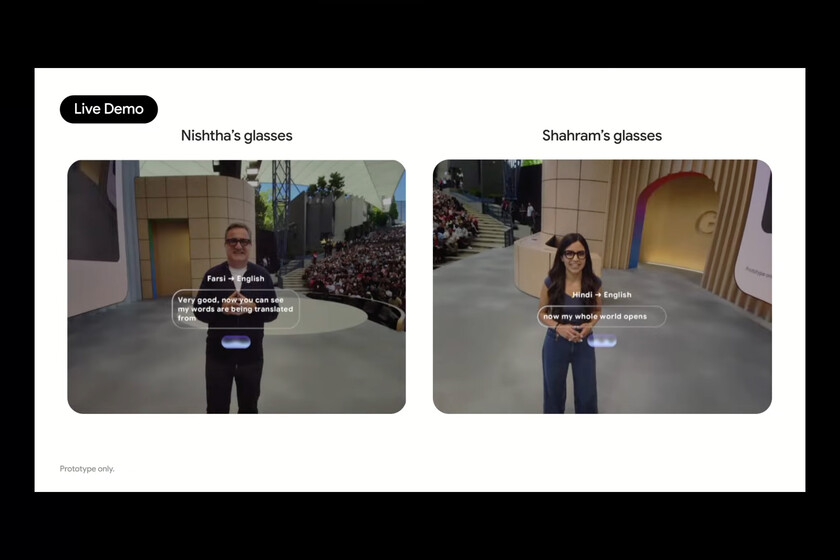

Traduction en direct et un petit échec sur scène. Le test final consistait en une conversation entre Izadi et Bhatia dans différentes langues. Elle a parlé en hindi, il à Farsi. Les lunettes, par Gemini, ont offert une traduction simultanée avec interprétation vocale. Le système a fonctionné correctement pendant quelques secondes, mais les responsables ont décidé d’interrompre la démo lorsqu’ils ont détecté une défaillance.

Malgré la stupeur, le message était clair: Google veut jouer à nouveau dans le domaine des lunettes connectées, cette fois avec une base plus mature, soutenue par son écosystème de service, en Gémeaux et en collaboration avec des acteurs clés du monde XR. La différence, du moins pour l’instant, est dans l’approche: les expériences pratiques, en temps réel, sans ornements ni promesses à long terme.

Images | Google

Dans Simseo | Google a déjà une IA agricole capable de programmer pour vous: elle s’appelle Jules et cherche à défendre Openai