Study explore comment les travailleurs utilisent des modèles de grands langues et ce que cela signifie pour les organisations scientifiques

Les chercheurs ont étudié l’utilisation par les employés d’Argonne d’Argo, un chatbot d’intelligence artificielle générative interne.

L’intelligence artificielle générative (IA) devient un outil de plus en plus puissant sur le lieu de travail. Dans des organisations scientifiques comme les laboratoires nationaux, son utilisation a le potentiel d’accélérer la découverte scientifique dans des domaines critiques.

Mais avec de nouveaux outils, de nouvelles questions. Comment les organisations scientifiques peuvent-elles mettre en œuvre une IA générative de manière responsable? Et comment les employés dans différents rôles utilisent-ils une IA générative dans leur travail quotidien?

Une étude récente de l’Université de Chicago et du Laboratoire national Argonne du Département américain de l’énergie fournit l’un des premiers examens du monde réel de la façon dont les outils génératifs de l’IA – des modèles de langage (LLM) en particulier de grands (LLM) – sont utilisés dans un laboratoire national.

L’étude souligne non seulement le potentiel de l’IA à améliorer la productivité, mais souligne également la nécessité d’une intégration réfléchie pour répondre aux préoccupations dans des domaines tels que la vie privée, la sécurité et la transparence. Le document est publié sur le arxiv serveur de préimprimée.

Grâce à des enquêtes et à des entretiens, les chercheurs ont étudié comment les employés d’Argonne utilisent déjà des LLM – et comment ils envisagent de les utiliser à l’avenir – pour générer du contenu et automatiser les workflows. L’étude a également suivi l’adoption précoce d’Argo, l’interface LLM interne du laboratoire publiée en 2024. Sur la base de leur analyse, les chercheurs recommandent que les organisations peuvent soutenir l’utilisation efficace de l’IA générative tout en répondant aux risques associés.

Le 26 avril, l’équipe a présenté ses résultats lors de la conférence de l’Association de l’informatique 2025 sur les facteurs humains sur les systèmes informatiques au Japon.

Argonne et Argo – une étude de cas

La structure organisationnelle d’Argonne associée à la libération opportune d’Argo a fait du laboratoire un environnement idéal pour l’étude. Ses effectifs comprennent à la fois les travailleurs des sciences et de l’ingénierie ainsi que les travailleurs des opérations dans des domaines comme les ressources humaines, les installations et les finances.

« La science est un domaine où la collaboration humaine-machine peut conduire à des percées importantes pour la société », a déclaré Kelly Wagman, doctorat. Étudiant en informatique à l’Université de Chicago et auteur principal de l’étude. « Les travailleurs des sciences et des opérations sont cruciaux pour le succès d’un laboratoire, nous voulions donc explorer comment chaque groupe s’engage avec l’IA et où leurs besoins s’alignent et divergent. »

Alors que l’étude s’est concentrée sur un laboratoire national, certaines des résultats peuvent s’étendre à d’autres organisations comme les universités, les cabinets d’avocats et les banques, qui ont des besoins variés des utilisateurs et des défis de cybersécurité similaires.

Les employés d’Argonne travaillent régulièrement avec des données sensibles, notamment des résultats scientifiques non publiés, des documents non classés contrôlés et des informations propriétaires. En 2024, le laboratoire a lancé Argo, qui donne aux employés un accès sécurisé aux LLM à partir d’OpenAI via une interface interne. Argo ne stockait ni ne partage les données des utilisateurs, ce qui en fait une alternative plus sécurisée à Chatgpt et à d’autres outils commerciaux.

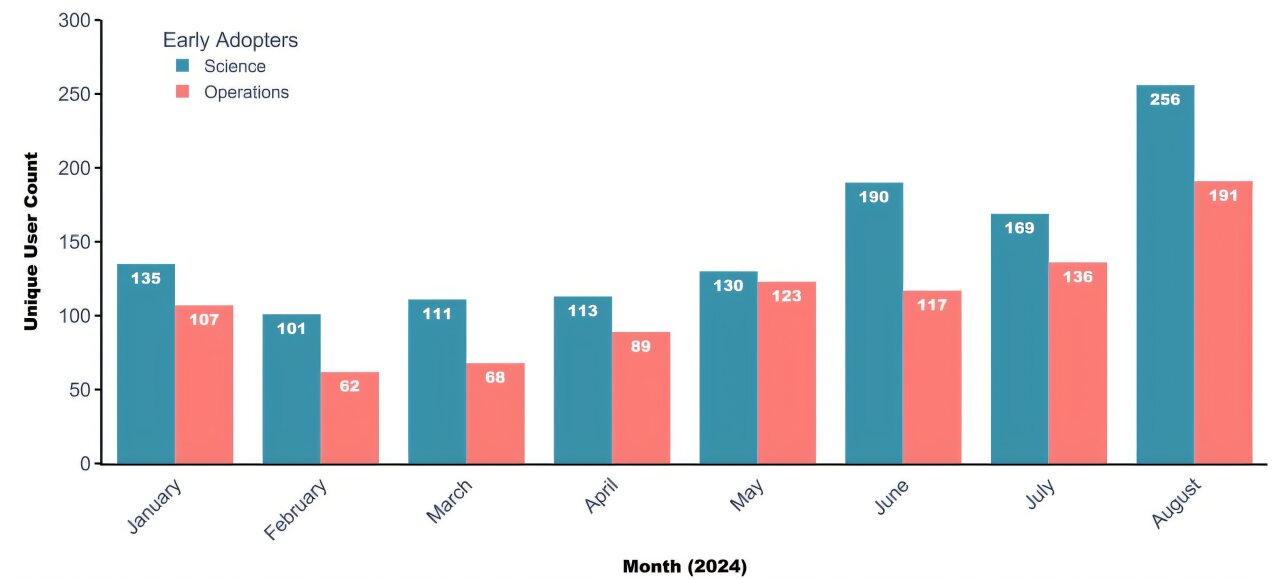

Argo a été la première interface d’interface générative interne à être déployée dans un laboratoire national. Pendant plusieurs mois après le lancement d’Argo, les chercheurs ont suivi la façon dont il a été utilisé dans différentes parties du laboratoire. L’analyse a révélé une base d’utilisateurs petite mais croissante des travailleurs scientifiques et des opérations.

« La technologie généative de l’IA est nouvelle et évolue rapide, il est donc difficile d’anticiper exactement comment les gens l’intégreront dans leur travail jusqu’à ce qu’ils commencent à l’utiliser. Cette étude a fourni des commentaires précieux qui informent les prochaines itérations du développement d’Argo », a déclaré l’ingénieur logiciel Argonne Matthew Dearing, dont l’équipe développe des outils AI pour soutenir la mission du laboratoire.

Dearing, qui organise une nomination conjointe à Uchicago, a collaboré à l’étude avec Wagman et Marshini Chetty, professeur d’informatique et chef du Laboratoire de recherche sur Internet Amyoli à l’université.

Collaboration et automatisation avec l’IA

Les chercheurs ont constaté que les employés utilisaient une IA générative de deux manières principales: en tant que copilote et comme agent de workflow. En tant que copilote, l’IA fonctionne aux côtés de l’utilisateur, aidant à des tâches comme écrire du code, structurer du texte ou peaufiner le ton d’un e-mail. Pour la plupart, les employés s’en tiennent actuellement aux tâches où ils peuvent facilement vérifier le travail de l’IA. À l’avenir, les employés ont déclaré avoir imaginé utiliser des copilotes pour extraire des informations à partir de grandes quantités de texte, telles que la littérature scientifique ou les données d’enquête.

En tant qu’agent de workflow, l’IA est utilisée pour automatiser des tâches complexes, qu’il effectue principalement par elle-même. Environ un quart des réponses ouvertes de l’enquête – se sont répandues uniformément entre les opérations et les travailleurs scientifiques – l’automatisation du flux de travail suscité, mais les types de flux de travail différaient entre les deux groupes. Par exemple, les travailleurs de l’opération ont utilisé l’IA pour automatiser des processus comme la recherche de bases de données ou les projets de suivi. Les scientifiques ont déclaré l’automatisation des workflows pour le traitement, l’analyse et la visualisation des données.

« La science implique souvent des flux de travail très sur mesure avec de nombreuses étapes. Les gens constatent qu’avec les LLM, ils peuvent créer la colle pour relier ces processus », a déclaré Wagman. « Ce n’est que le début de workflows automatisés plus compliqués pour la science. »

Élargir les possibilités tout en atténuant les risques

Bien que l’IA générative présente des opportunités passionnantes, les chercheurs soulignent également l’importance de l’intégration réfléchie de ces outils pour gérer les risques organisationnels et répondre aux préoccupations des employés.

L’étude a révélé que les employés étaient considérablement préoccupés par la fiabilité générative de l’IA et sa tendance à halluciner. Les autres préoccupations comprenaient la confidentialité et la sécurité des données, la dépassement de l’IA, les impacts potentiels sur l’embauche et les implications pour l’édition et la citation scientifiques.

Pour promouvoir l’utilisation appropriée de l’IA générative, les chercheurs recommandent que les organisations gèrent de manière proactive les risques de sécurité, établissent des politiques claires et offrent une formation des employés.

« Sans directives claires, il y aura beaucoup de variabilité dans ce que les gens pensent être acceptables », a déclaré Chetty. « Les organisations peuvent également réduire les risques de sécurité en aidant les gens à comprendre ce qui se passe avec leurs données lorsqu’ils utilisent à la fois des outils internes et externes – qui peut accéder aux données? Que fait l’outil? »

À Argonne, près de 1 600 employés ont assisté aux séances de formation génératrices de l’IA du laboratoire. Ces séances présentent des employés à Argo et à une IA générative et fournissent des conseils pour une utilisation appropriée.

« Nous savions que si les gens allaient se mettre à l’aise avec Argo, cela n’allait pas se produire seul », a déclaré Dearing. « Argonne ouvre la voie en fournissant des outils d’IA génératifs et en façonnant comment ils sont intégrés de manière responsable dans les laboratoires nationaux. »