Chatgpt coûte 700 000 $ par jour, Deepseek 83 000

2025 a commencé par un tsunami dans le segment de l’intelligence artificielle. Après des mois et des mois, parler de différents modèles et entreprises tels que Google, Microsoft, Apple, Meta et, bien sûr, Openai, une entreprise chinoise a enlevé la manche Deekseek, une IA qui a secoué les fondements de l’industrie.

Au-delà de ses possibilités ou à quel point il a fonctionné, ce qui a suscité les eaux était des problèmes économiques et matériels. Presque depuis le début la question de Comment la Chine avait retiré une IA comme Deepseek avec la limitation du matériel qu’ils ont en raison de la guerre commerciale avec les États-Unis et de l’impossibilité d’acheter les graphiques les plus puissants de Nvidia (bien qu’avec la controverse).

Pour ce faire, la société a défendu qu’elle devait tirer l’ingéniosité grâce à une infrastructure NVIDIA H800 Chips et à une formation de plus de 2 788 millions d’heures avec un coût ridicule: 5,6 millions de dollars. Et cela semble rare parce que Openai a investi environ 100 millions de dollars pour former le GPT-4. Un autre melon est ce qu’il en coûte pour le garder.

Comme le souligne Reuters, si Chatgpt coûte environ 700 000 $ par jour, DePseek tombe à 87 000 $. Et ici, certaines choses doivent être prises en compte.

Deepseek est 10 fois moins cher à maintenir que Chatgpt, selon DePseek

Samedi dernier, et comme le souligne Reuters, DePseek a révélé certaines données sur les coûts et les revenus liés à ses modèles V3 et R1. Le premier est un chatbot traditionnel et plus conversationnel, ce qui résulte de l’idéal pour l’écriture et la création de contenu. R1, cependant, est un modèle de raisonnement. Il se démarque de résoudre des problèmes, en utilisant la logique et est capable de montrer le raisonnement étape par étape, en utilisant l’apprentissage continu.

Pour comparer avec des modèles plus connus, DePseek V3 serait comme GPT-4 et R1 quelque chose de similaire à OpenAI O1. Dans le rapport, Reuters souligne que la relation théorique de Deepseek-Benefit les coûts sont jusqu’à 545% par jour.

Bien sûr, l’entreprise elle-même prévient que le revenu réel est considérablement plus faible, mais une autre perle qu’elle a laissée depuis Deepseek est le coût de l’entretien. Garder Chatgpt fonctionnant pour environ 700 000 $ par jour à Openai (il y a au moins deux ans). La raison en est que l’infrastructure des serveurs Microsoft Azure doit être maintenue, elle a un coût énergétique considérable, vous devez payer des salaires et, évidemment, toute la puissance du matériel pour traiter les consultations que vous recevez chaque seconde.

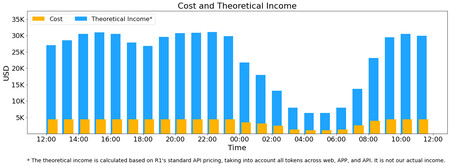

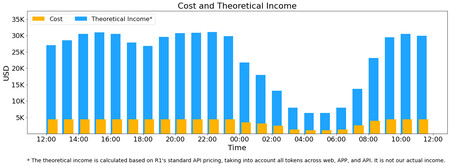

En jaune, les coûts. En bleu, revenu théorique

Deepseek « seulement » 87 072, un prix ridicule comparé. Il y a quelques jours, il a déclaré que la location du H800 lui coûte moins de deux dollars par heure et que le revenu théorique estimé est supérieur à 560 000 $, ce qui ajouterait plus de 200 millions de dollars en un an. Dans le graphique supérieur, DePseek montre le coût du maintien du R1 et des revenus théoriques grâce aux jetons générés, dont le prix dépend du moment de la journée, étant moins cher la nuit. Ils précisent également que Deepseek V3 est « beaucoup moins cher ».

Cela ouvre plus de problèmes. La première est la façon dont elle est si bon marché parce que la formation d’une IA, bien sûr, ne l’est pas. Passant l’accusation de vol par Openai, si Deepseek n’a pas dégonflé les chiffres, met sur la table une situation dans laquelle il n’est pas nécessaire de la puissance graphique pour former une intelligence artificielle.

Ici, la clé est «l’apprentissage du renforcement», la façon dont Deepseek a trouvé plus avec beaucoup moins, mais il convient également de noter que, bien que lors de la formation, les puces Nvidia soient utilisées pour le modèle R1, en inférence, il utilise l’Ascend 910B de Huawei.

Les puces Huawei sont moins chères et, soi-disant, plus efficaces, et cette décision Deepseek est presque plus pertinente que ce qui pourrait coûter pour maintenir le système. La raison en est que vous pouvez enseigner le reste des entreprises d’intelligence artificielle qui, peut-être, Il ne vaut pas la peine d’utiliser les GPU de dernière génération Pour tout, mais uniquement pour la formation qui se produit parfois compté, avant la mise en œuvre de l’IA, puis utilisez d’autres GPU plus efficaces et bon marché pour l’inférence. Cette inférence est ce qui est fait plus tard, dans une utilisation que nous pourrions appeler « réel ».

La formation serait l’équivalent de la déglutition des manuels techniques dans une carrière de cinq ans et de l’inférence tels que la mise en œuvre de ces connaissances et du raisonnement à partir de la base que vous avez et sans avoir à les apprendre à nouveau. En fin de compte, la controverse des cinq millions de dollars de Deepseek sera là pendant un certain temps, surtout lorsque nous nous comparons avec les numéros OpenAI, mais il est clair que Deepseek fait des choses d’une autre approche et peut être un bon miroir pour les entreprises qui se retrouvent derrière.

Et, avec un chinois très déversé dans le développement de l’IA et du matériel pour l’IA, il peut être le modèle parfait de «fer de lance».

Images | Github (Deepseek), Simseo

Dans Simseo | Deepseek a créé une autre fortune de Milmillonaria: Liang Wenfeng est devenu populaire mais sa richesse est toujours un mystère