Une étude a estimé le coût énergétique de Chatgpt. Selon ses conclusions, il n’est pas aussi apocalyptique qu’il y paraît

Chatgpt à 3 quoi. En octobre 2023, une étude d’Alex de Vries a souligné qu’une consultation de Chatgpt avait un coût énergétique estimé de 3 WH. Son estimation provient des commentaires de Google, dont les managers ont indiqué que la consommation de Chatgpt était « probablement » 10 fois celle d’une recherche. Et Google elle-même avait révélé qu’en 2009, chaque recherche était de 0,3 WH, et donc le chiffre final. De Vries, soit dit en passant, a précédemment publié une autre étude dans laquelle il a mis en garde contre la consommation d’énergie inquiétante de l’exploitation bitcoin. De Vries, oui, il a fait référence que les consultations moyennes étaient d’environ 4 000 jetons d’entrée et 2 000 résultats, ce qui serait équivalent à des questions et réponses assez longues, alors qu’il est normal de les rendre plus courts.

L’efficacité gagne entière. Tout au long de cette période, beaucoup de choses ont changé, à la fois pour Google – dont les résultats et les infrastructures sont très différents de celui d’il y a 15 ans – et pour Chatgpt, qui a également acquis une efficacité totale. Il est très probable que les consultations Google sont désormais plus efficaces, mais sûrement celles qui sont aussi celles de Chatgpt et d’autres chatbots.

Une nouvelle estimation. Epoch AI est une organisation à but non lucratif qui, entre autres, est responsable de la création de la référence Frontitiermath. Ce test essaie d’évaluer la capacité informatique mathématique des modèles d’IA et est devenu l’une des mesures les plus intéressantes pour sa difficulté. Leurs chercheurs ont désormais publié une étude dans laquelle ils estiment précisément la consommation d’énergie d’une consultation de Chatgpt.

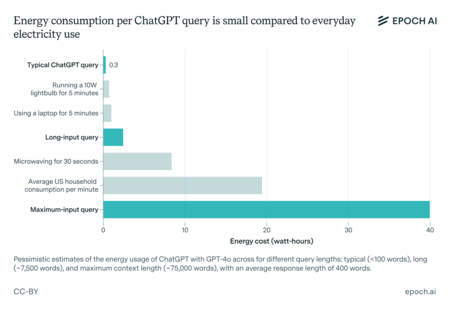

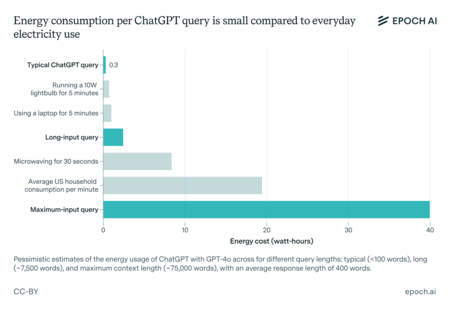

Chatgpt consomme dix fois moins que ce qui était pensé. Selon ses conclusions, les consultations ChatGPT basées sur le LLM GPT-4O consomment environ 0,3 Watts-Shoom, ce qui est dix fois moins que ce qui était précédemment considéré. Ce calcul de 0,3 WH « est en fait relativement pessimiste, et il est possible que de nombreuses demandes ou la plupart soient encore moins chères. »

Comment ils ont fait le calcul. À l’époque, ils ont été basés sur des données connues pour leurs calculs. Ainsi, ils soulignent que, selon Openai, un jeton est égal à environ 0,75 mots et que la génération d’un jeton coûte environ 2 flops. Compte tenu de la capacité de calcul du GPUS NVIDIA H100 (989 TFLOPS dans TF32, 67 TLOPS dans les opérations FP32) et leur consommation (1500 W, bien qu’ils considèrent qu’ils consomment réellement 70% de cette puissance moyenne), le résultat est le résultat du nombre susmentionné.

Tout s’est amélioré. Comme nous l’avons souligné, dans Epoch IA, ils soulignent que la différence entre cette estimation et la précédente est que Chatgpt utilise maintenant des modèles et du matériel beaucoup plus épiques que ceux du début de 2023. Il existe même des moyens de se multiplier mieux. De plus, dans l’estimation précédente «il y avait un nombre excessivement pessimiste des jetons nécessaires».

Combien coûtent 0,3 WH? Ils équivaut à moins de la quantité d’électricité qu’un ampoule LED ou à un ordinateur portable « en quelques minutes ». Selon la Energy Information Administration des États-Unis, une maison moyenne consomme 10 500 kWh par an, soit environ 28 000 WH par jour. Même une utilisation intensive de Chatgpt ne semble pas excessivement influencer cette consommation.

La raison consomme plus. Bien qu’ils prennent le GPT-4O comme référence, ils indiquent clairement que l’utilisation de modèles de raisonnement tels que O1 ou O3-MINI nécessite plus de consommation d’énergie, mais pour le moment ils sont moins populaires.

Et entraîner aussi les modèles. Ces chercheurs ont également mis en évidence le coût énergétique des modèles de formation tels que GPT-4O, qui, selon leurs estimations, aurait eu lieu entre 20 et 25 MW en trois mois. Cela équivaudrait à quelque 20 000 maisons intermédiaires aux États-Unis.

Les coûts généraux sont inquiétants. Bien que les données de cette étude révèlent que l’utilisation de Chatgpt ne consomme pas autant d’énergie que précédemment, le problème peut en être un autre. Les coûts énergétiques généraux de l’IA sont colossaux et visent à être beaucoup plus élevés à court terme: la grande fièvre technologique pour investir des dizaines de milliards de dollars pour construire des centres de données. Et il le fait parce que tous ces centres de données auront d’énormes besoins au niveau de l’énergie. Eye: n’oublions pas la climatisation.

Image | Simseo avec freepik pikaso

Dans Simseo | L’histoire incroyable du bras, l’architecture qui triomphe sur le mobile et qui est née il y a plus de 30 ans dans un ordinateur Acorn