Vers une meilleure évaluation des risques de tremblement de terre avec l'apprentissage automatique et les données de sondage géologique

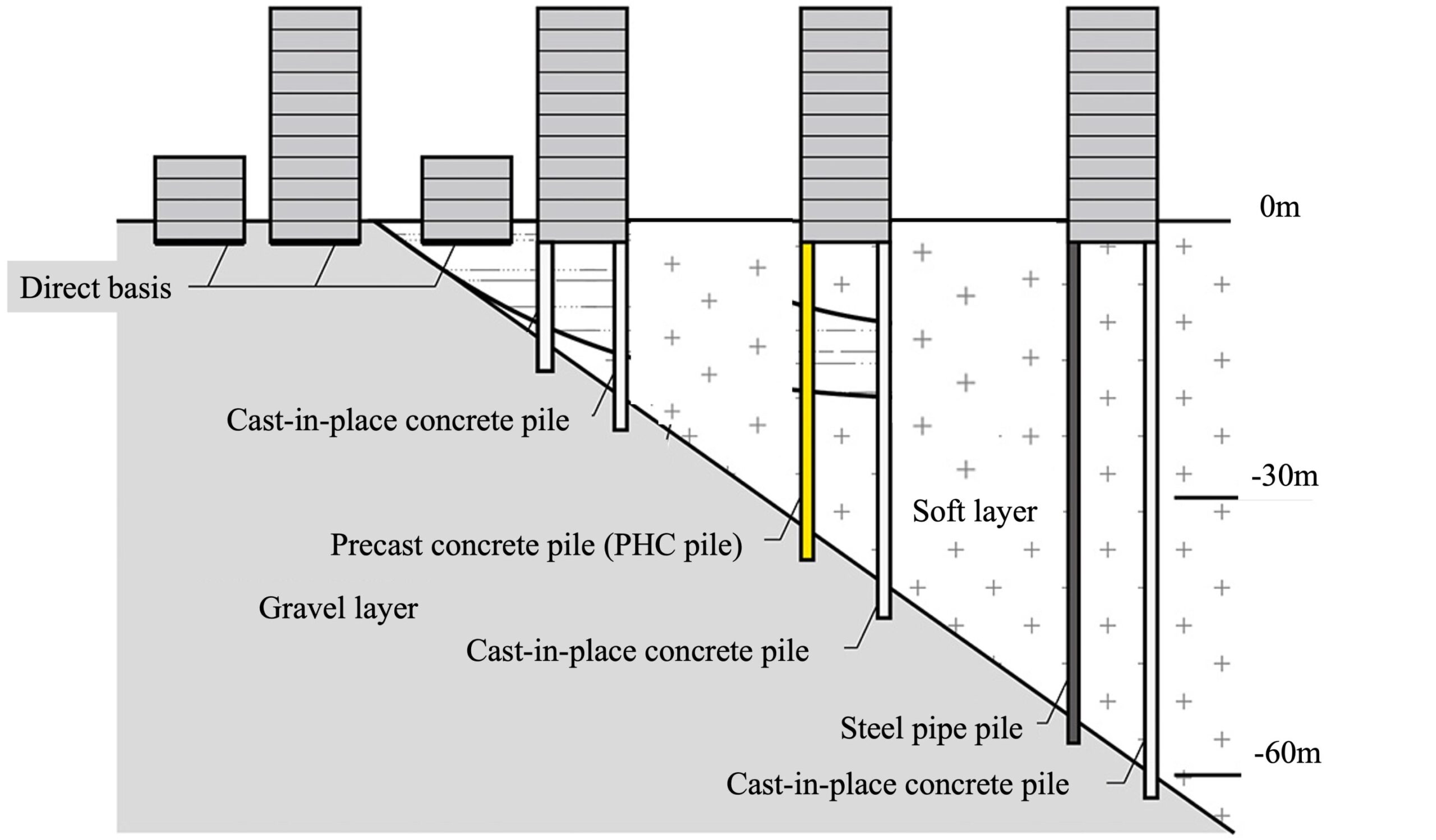

« Un bâtiment n'est aussi fort que sa fondation » est un adage commun pour signifier l'importance d'avoir une base stable et solide sur laquelle s'appuyer. Le type et la conception de la fondation sont importants pour assurer la sécurité structurelle d'un bâtiment.

Parmi plusieurs facteurs qui peuvent affecter la conception et la pose d'une fondation, portant la profondeur de la strate, à savoir la profondeur à laquelle la couche sous-jacente de sol ou de roche a une force adéquate pour soutenir une fondation, est l'une des plus cruciales. En effet, dans les régions sujettes aux tremblements de terre ou aux glissements de terrain, la profondeur de la strate de roulement, également connue sous le nom de profondeur de la couche portant, sert d'indicateur indirect du risque de liquéfaction du sol, ou du risque de s'effondrer et de perdre sa rigidité et de se comporter comme un liquide.

Naturellement, une estimation précise de la profondeur de la couche de roulement est la clé pour concevoir des fondations robustes, limiter les risques de liquéfaction du sol et atténuer les catastrophes liées au sol.

Les méthodes traditionnelles pour évaluer la profondeur de la couche de roulement, notamment le test de pénétration standard (SPT), sont généralement fiables mais impliquent des processus à forte intensité de temps et de main-d'œuvre pour obtenir des échantillons de sol souterrains et sont coûteux. Une alternative rentable est donc impérative.

Pour résoudre ce problème, les scientifiques du Shibaura Institute of Technology (SIT), Japon, ont tourné leur attention vers l'apprentissage automatique (ML). Une équipe de chercheurs dirigée par le professeur Shinya Inazumi du College of Engineering de SIT a utilisé 942 enregistrements de l'enquête géologique et des données SPT de la région métropolitaine de Tokyo et a utilisé trois algorithmes de ML: Random Forest (RF), le réseau neural artificiel (ANN) et la machine vectorielle de soutien (SVM), pour prédire la couche de support.

Leurs résultats de recherche ont été publiés dans la revue Apprentissage automatique et extraction des connaissances.

« L'inspiration pour cette recherche provient des défis urgents en génie géotechnique dans des paysages urbains vulnérables comme des tremblements de terre comme Tokyo. En tant que région ayant des antécédents d'événements sismiques dévastateurs, tels que le Grand Kanto Treatchquatement 1923, nous espérons que nous espérons la rédaction de la rédaction des études et des études de la rédaction pour les planifications urbaines et les ingénieurs avec des effets pour le développement de la rupture, la rédaction de la rédaction et de la rédaction des planifications urbaines et des ingénieurs avec des effets pour le développement de la rupture, pour la réduisance, nous permettons de faire en sorte que Améliorer la sécurité « , a déclaré Inazumi, expliquant la motivation derrière la présente étude.

Dans leur étude, les chercheurs ont initialement formé et optimisé les modèles ML choisis à l'aide de l'ensemble de données SPT. Par la suite, ils ont développé deux scénarios de cas expérimentaux en fonction de l'ensemble des variables explicatives utilisées pour l'évaluation.

Alors que le premier scénario de cas (Case-1) a utilisé la latitude, la longitude et l'élévation comme variables explicatives, le deuxième scénario (cas-2) comprenait des données de classification stratigraphique, à savoir les informations sur la couche de sol souterraine, en plus des trois autres paramètres géographiques.

Au cours de l'évaluation comparative, les chercheurs ont constaté que le modèle RF a systématiquement surpassé l'ANN et le SVM, en particulier en termes de précision de prédiction de profondeur (une erreur absolue moyenne de 0,86 m pour le cas-2 contre 1,26 m pour le cas-1) et la robustesse aux données bruyantes. De plus, la précision de prédiction des trois modèles du scénario du cas-2, qui comprend les données de classification stratigraphique en tant que variable explicative supplémentaire, a été nettement améliorée.

Inspirés par leurs résultats de recherche, les chercheurs sont allés plus loin et ont étudié l'impact de la densité des données spatiales sur les performances de prédiction. À cette fin, ils ont généré six sous-ensembles de données différents avec des densités spatiales variables: 0,5, 1,0, 1,5, 2,0, 2,5 et 3,0 points / km2.

Ils ont constaté que la précision de prédiction du modèle RF dans le cas-2 s'améliorait avec l'augmentation de la densité des données, indiquant que les ensembles de données spatialement plus denses sont précieux pour des prédictions précises de la profondeur de la couche de roulement.

Dans l'ensemble, l'étude de l'équipe démontre que la ML, en particulier la RF, peut offrir une alternative bien nécessaire aux méthodes traditionnelles pour l'évaluation régionale des risques de catastrophe. De plus, contrairement à SPT, les modèles ML sont rentables et, avec de nouvelles améliorations à l'architecture informatique et à l'intégration avec des plates-formes avancées en temps réel, pourrait révolutionner la planification des infrastructures dans les zones sismiquement actives, réduisant la dépendance à des tests coûteux et localisés tout en améliorant la sécurité et l'efficacité.

En mettant l'accent sur les applications potentielles de l'étude, conclut Inazumi: «Nos résultats mettent en évidence le potentiel transformateur réel des modèles ML en génie géotechnique et en planification urbaine, en particulier dans les régions sujettes aux tremblements de terre comme Tokyo.