Une révision fondamentale de la façon dont l’IA acquiert et traite le langage pourrait entraîner des LLM plus efficaces

Un ordinateur peut-il apprendre une langue comme le fait un enfant? Une étude publiée dans Linguistique informatique Par les professeurs Katrien Beuls (Université de Namur) et Paul Van Eecke (AI Lab, Vrije Universiteit Brussel) jette un nouveau éclairage sur cette question.

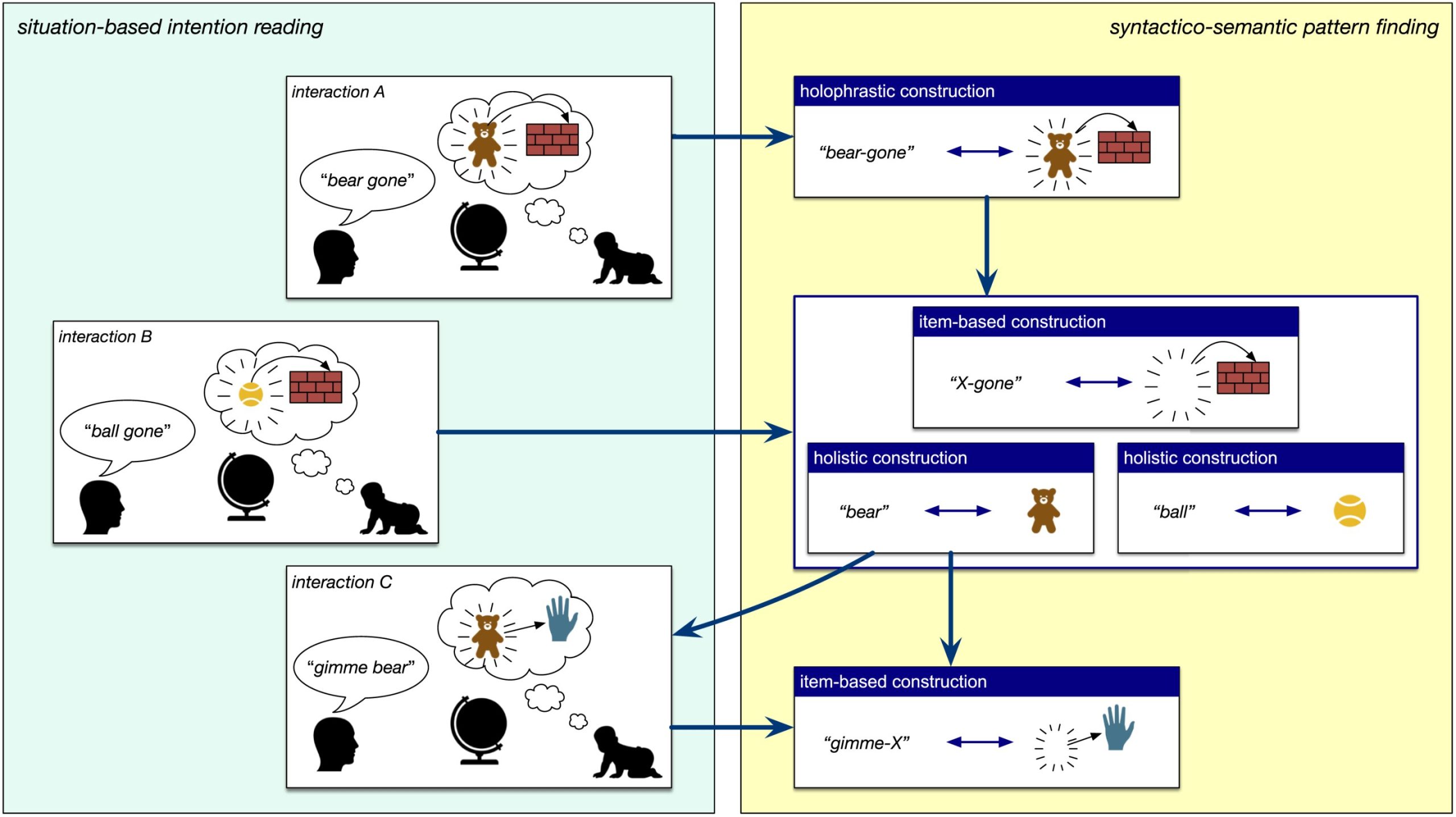

«Les enfants apprennent leur langue maternelle en communiquant avec les personnes qui les entourent dans leur environnement. En jouant et en expérimentant la langue, ils tentent d’interpréter les intentions de leurs partenaires de conversation. De cette façon, ils apprennent progressivement à comprendre et à utiliser les constructions linguistiques. Ce processus, dans lequel le langage est acquis par l’interaction et le contexte significatif, est au cœur de l’acquisition du langage humain « , explique Beuls.

« La génération actuelle de grands modèles de langue (LLMS), comme Chatgpt, apprend la langue d’une manière très différente », ajoute Van Eecke.

« En observant de grandes quantités de texte et en identifiant quels mots apparaissent fréquemment, ils génèrent des textes qui sont souvent indiscernables de l’écriture humaine. Cela se traduit par des modèles extrêmement puissants dans de nombreuses formes de génération de texte – tels que le résumé, la traduction ou la réponse aux questions —Mais qui présentent également des limitations inhérentes.

« Ils sont sensibles aux hallucinations et aux biais, luttent souvent avec le raisonnement humain et nécessitent d’énormes quantités de données et d’énergie pour construire et opérer. »

Les chercheurs proposent un modèle alternatif dans lequel les agents artificiels apprennent le langage comme le font les humains – en s’engageant dans des interactions communicatives significatives dans leur environnement. Grâce à une série d’expériences, ils montrent comment ces agents développent des constructions linguistiques qui sont directement liées à leur environnement et à leur perception sensorielle. Cela conduit à des modèles linguistiques qui:

- Sont moins sujets aux hallucinations et aux biais, car leur compréhension du langage est fondée sur une interaction directe avec le monde.

- Utilisez des données et de l’énergie plus efficacement, résultant en une empreinte écologique plus petite.

- Sont plus profondément enracinés dans le sens et l’intention, leur permettant de comprendre la langue et le contexte d’une manière plus humaine.

« L’intégration des interactions communicatives et situées dans les modèles d’IA est une étape cruciale dans le développement de la prochaine génération de modèles de langues. Cette recherche offre une voie prometteuse vers les technologies linguistiques qui ressemblent plus étroitement à la façon dont les humains comprennent et utilisent le langage », concluent les chercheurs.