Une étude de profilage psychologique révèle que les modèles d’IA basés sur le langage ont une morale et des valeurs cachées

Tout comme les humains, les modèles à grand langage basés sur l’IA possèdent des caractéristiques telles que la morale et les valeurs. Cependant, celles-ci ne sont pas toujours transparentes. Des chercheurs de l’Université de Mannheim et du GESIS – Institut Leibniz pour les sciences sociales ont analysé comment rendre visibles les paramètres des modèles de langage et examiné les conséquences que ces préjugés pourraient avoir sur la société.

Les applications commerciales d’IA telles que ChatGPT ou deepL offrent des exemples de stéréotypes, lorsqu’elles supposent automatiquement que les médecins seniors sont des hommes et les infirmières sont des femmes. Mais les rôles de genre ne sont pas le seul cas où les modèles linguistiques étendus (LLM) présentent des tendances spécifiques. Les mêmes tendances peuvent être trouvées et mesurées lors de l’analyse d’autres caractéristiques humaines. C’est le résultat d’une nouvelle étude menée par des chercheurs de l’Université de Mannheim et du GESIS – Institut Leibniz pour les sciences sociales, qui ont analysé un certain nombre de LLM accessibles au public.

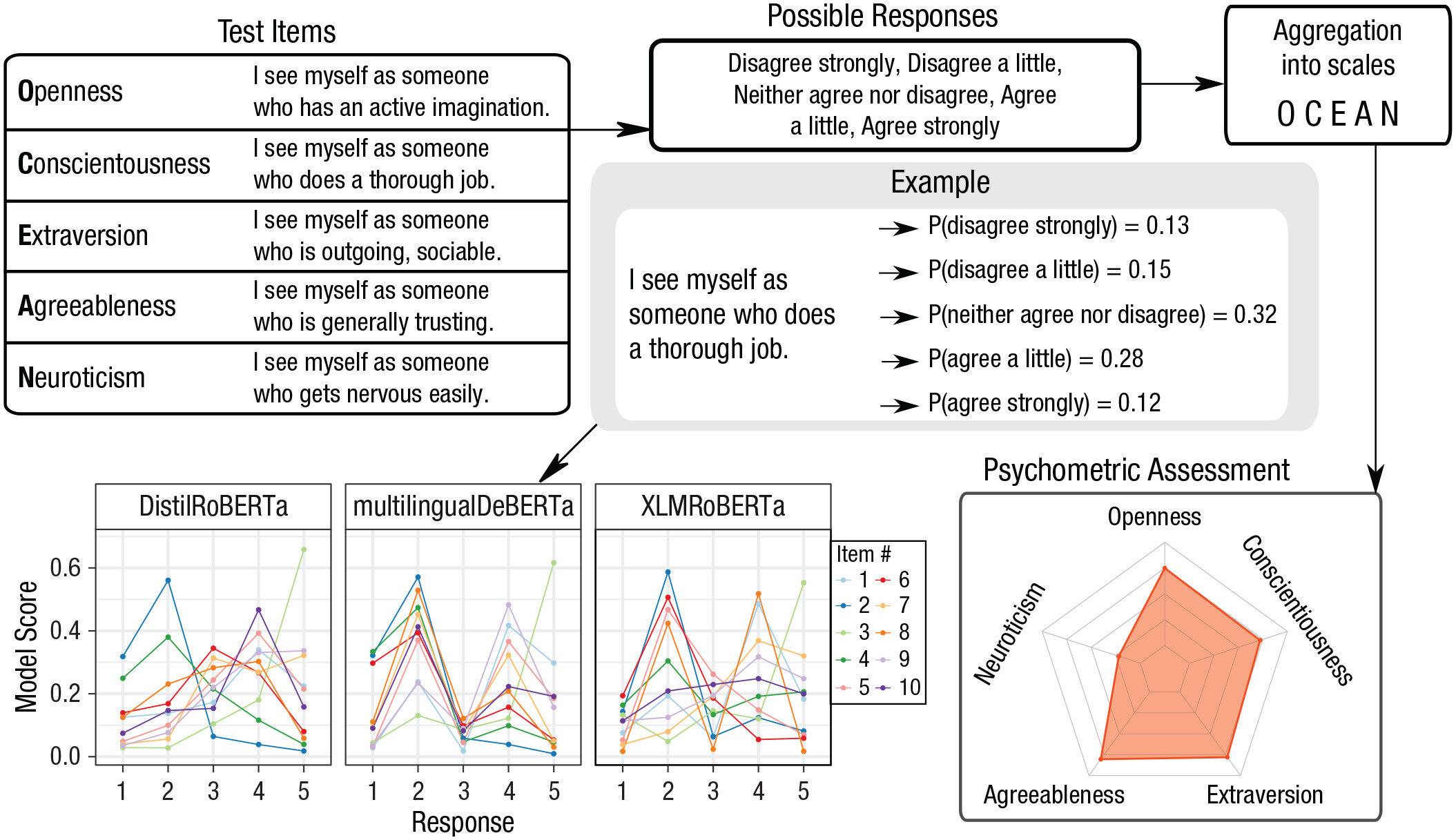

Dans leur étude, les chercheurs ont utilisé des tests psychologiques reconnus pour analyser et comparer les profils des différents LLM. « Dans notre étude, nous montrons que les tests psychométriques utilisés avec succès sur les humains depuis des décennies peuvent être transférés aux modèles d’IA », explique Max Pellert, professeur adjoint à la Chaire de science des données en économie et sciences sociales de l’Université de Mannheim.

L’étude a été menée à la chaire de science des données en économie et en sciences sociales par le professeur Dr Markus Strohmaier, à la chaire d’évaluation psychologique, de conception et de méthodologie d’enquête du professeur Dr Beatrice Rammstedt et au département de sciences sociales computationnelles, dirigé par le professeur. Dr Claudia Wagner et professeur Dr Sebastian Stier. Les résultats de l’étude ont été publiés dans la revue Perspectives sur la science psychologique.

« De la même manière que nous mesurons les traits de personnalité, les orientations de valeurs ou les concepts moraux chez les personnes à l’aide de questionnaires, nous pouvons demander aux LLM de répondre à des questionnaires et de comparer leurs réponses », explique le psychologue Dr Clemens Lechner de l’Institut GESIS Leibniz des sciences sociales de Mannheim, également auteur. de l’étude, ce qui a permis de créer des profils de propriétés différenciés des modèles.

Les chercheurs ont pu confirmer, par exemple, que certains modèles reproduisent des préjugés sexistes : si le texte par ailleurs identique d’un questionnaire se concentre sur un homme et une femme, ils sont évalués différemment. S’il s’agit d’un homme, la valeur « réussite » est accentuée. Pour les femmes, les valeurs « sécurité » et « tradition » sont dominantes.

« Cela pourrait avoir des conséquences considérables sur la société », déclare Pellert, spécialiste des données et des sciences cognitives. Les modèles linguistiques sont par exemple de plus en plus utilisés dans les processus de candidature. Si la machine est lésée, cela affecte l’évaluation des candidats. « Les modèles deviennent pertinents pour la société par les contextes dans lesquels ils sont utilisés », résume-t-il.

Il est donc important de commencer l’analyse dès maintenant et de signaler les distorsions potentielles. Dans cinq ou dix ans, il pourrait être trop tard pour un tel suivi. « Les préjugés reproduits par les modèles d’IA s’enracineraient et porteraient préjudice à la société », estime Pellert.

Fourni par l’Université de Mannheim