Transformer la façon dont les systèmes d’IA perçoivent les mains humaines

Faire en sorte que les systèmes d’intelligence artificielle perçoivent de manière robuste les humains reste l’un des défis les plus complexes de la vision par ordinateur. Parmi les problèmes les plus complexes figure la reconstruction de modèles 3D de mains humaines, une tâche aux applications très diverses en robotique, en animation, en interaction homme-machine et en réalité augmentée et virtuelle. La difficulté réside dans la nature des mains elles-mêmes, souvent masquées lorsqu’elles tiennent des objets ou déformées dans des orientations difficiles lors de tâches comme la préhension.

Au Robotics Institute de l’Université Carnegie Mellon, nous avons conçu un nouveau modèle, Hamba, qui a été présenté au 38e conférence annuelle sur les systèmes de traitement de l’information neuronale (NeurIPS 2024) à Vancouver. Hamba propose une approche particulièrement intéressante pour reconstruire des mains en 3D à partir d’une seule image, ne nécessitant aucune connaissance préalable des spécifications de la caméra ou du contexte du corps de la personne.

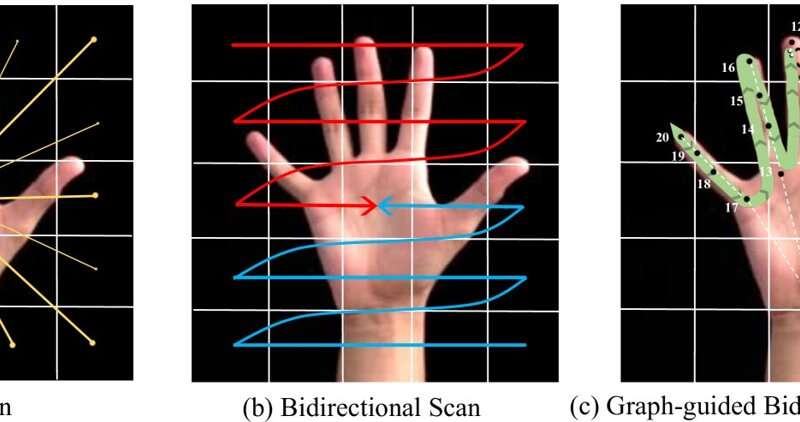

Ce qui distingue Hamba, c’est sa différence par rapport aux architectures conventionnelles basées sur des transformateurs. Au lieu de cela, il exploite la modélisation de l’espace d’état basée sur Mamba, marquant la première fois qu’une telle approche est appliquée à la reconstruction de formes 3D articulées. Le modèle affine également le processus d’analyse original de Mamba en introduisant une analyse bidirectionnelle guidée par graphique, qui utilise les capacités d’apprentissage graphique des réseaux neuronaux graphiques pour capturer les relations spatiales entre les articulations de la main avec une précision remarquable.

Hamba atteint des performances de pointe sur des benchmarks comme FreiHAND, avec une erreur de position moyenne par sommet de seulement 5,3 millimètres, une précision qui souligne son potentiel pour des applications réelles. De plus, au moment de l’acceptation de l’étude, Hamba occupait la première position (rang 1) dans deux classements de compétitions pour la reconstruction de la main en 3D.

Au-delà de ses réalisations techniques, Hamba a des implications plus larges pour l’interaction homme-machine. En permettant aux machines de mieux percevoir et interpréter les mains humaines, il jette les bases des futurs systèmes et robots d’intelligence générale artificielle (AGI) capables de comprendre les émotions et les intentions humaines avec plus de nuances.

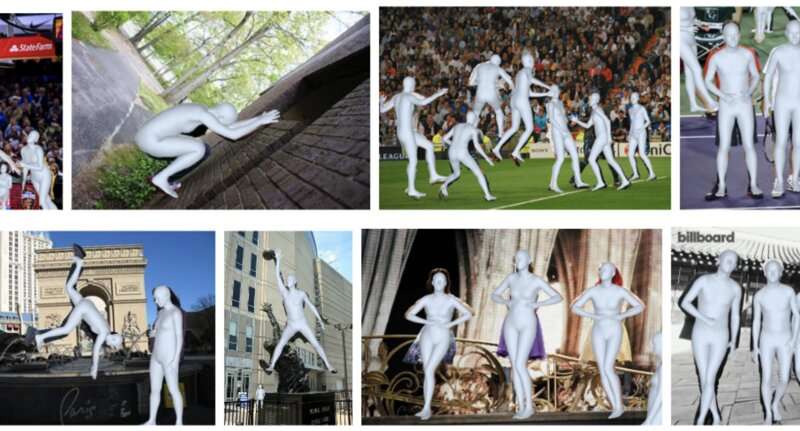

Pour l’avenir, l’équipe de recherche prévoit de remédier aux limites du modèle tout en explorant son potentiel pour reconstruire des modèles humains 3D complets à partir d’images uniques – un autre défi important avec de nombreuses applications dans des secteurs allant des soins de santé au divertissement. Avec sa combinaison unique de précision technique et d’utilité pratique, Hamba illustre comment l’intelligence artificielle continue de repousser les limites de la façon dont les machines peuvent percevoir les humains.

Cette histoire fait partie de Science X Dialog, où les chercheurs peuvent rapporter les résultats de leurs articles de recherche publiés. Visitez cette page pour plus d’informations sur Science X Dialog et comment y participer.