pour que tu puisses le démarrer

En plus de tous les modèles de langage d’IA commerciaux dont nous disposons (ChatGPT, Gemini, Claude, etc.), il existe tout un monde de modèles de langage open source qui peuvent être utilisés pour de nombreuses applications, tant au niveau domestique qu’au niveau de l’entreprise. Je bricole des LLM localement depuis un certain temps et la vérité est qu’en avoir un qui fonctionne sans avoir besoin d’une connexion Internet peut être très bon pour nous.

Le fait est qu’installer un LLM localement et sur notre téléphone mobile est plus facile qu’il n’y paraît. Aujourd’hui, nous pouvons trouver des outils très simples à utiliser et dotés d’une interface très conviviale pour tout utilisateur. De plus, vous n’avez pas besoin d’un smartphone aux spécifications techniques très élevées pour faire fonctionner un petit modèle. Ci-dessous ce texte, j’explique comment procéder et quel sens cela a d’avoir une IA locale sur votre mobile.

Qu’est-ce que PocketPal et quel est l’intérêt d’avoir une IA localement ?

L’un des outils qui rendent cela possible s’appelle PocketPal AI, et la meilleure chose est que son installation et sa mise en service ne nécessitent aucune connaissance technique. L’application est gratuite pour iOS et Android et permet d’installer des modèles d’intelligence artificielle directement sur le téléphone mobile, afin que l’utilisateur puisse les utiliser sans connexion Internet, en toute confidentialité et sans que leurs conversations n’atteignent des serveurs externes.

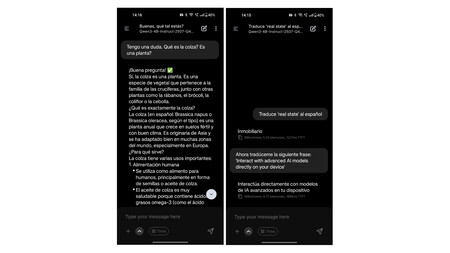

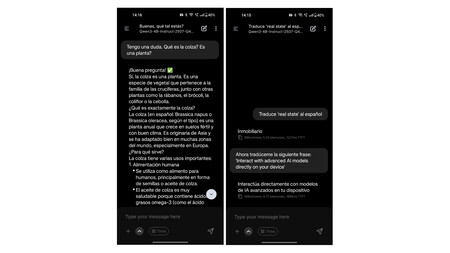

La clé de tout cela est d’utiliser des versions réduites de certains des modèles linguistiques que nous connaissons. Ces petits modèles sont destinés à fonctionner directement sur le CPU ou le GPU d’un appareil grand public. Ils n’ont pas la même capacité de raisonnement que le modèle OpenAI ou Anthropic le plus avancé, car cela serait actuellement impossible sur le matériel téléphonique, mais ils sont suffisamment capables pour une grande variété de tâches quotidiennes : résumer des textes, répondre à des questions, traduire, aider à écrire, générer du code simple ou simplement avoir une conversation.

La proposition est utile dans plus de situations qu’il n’y paraît. Imaginez que vous êtes dans le métro sans couverture, en voyage à l’étranger sans données ou dans une zone rurale. Avec une IA installée localement sur votre mobile, vous avez toujours une sorte d’encyclopédie intelligente à portée de main : quelqu’un à consulter, à réfléchir à voix haute ou à résoudre des doutes sur le moment. Et ce qui est tout aussi important : en toute intimité. Tout le traitement s’effectue entièrement sur l’appareil. Les conversations, les invites et les données ne quittent jamais le téléphone et ne sont pas stockées sur des serveurs externes.

De quel mobile avez-vous besoin

Avant de commencer à télécharger l’application, il convient de vérifier si votre appareil dispose de ce dont vous avez besoin. Exécuter un modèle d’IA localement nécessite que l’appareil dispose d’une série de spécifications techniques plus ou moins importantes, même si nous n’avons pas besoin d’accéder à la gamme d’appareils la plus élevée pour les exécuter. J’utilise moi-même PocketPal sur un OnePlus Nord 2 modeste mais plus que performant.

Les modèles d’IA sont des fichiers considérablement volumineux, un espace de stockage interne libre est donc nécessaire et le traitement local nécessite de la puissance matérielle. Mais wow, tant que vous disposez d’une quantité considérable de RAM et d’un CPU qui n’en vaut pas la peine, vous êtes largement suffisant.

Les exigences varient considérablement en fonction du modèle que vous souhaitez installer, mais à titre indicatif :

- RAM : Minimum 6 Go pour les petits modèles (paramètres 1-3B). Pour les modèles moyens avec paramètres 7B, il est conseillé de disposer d’au moins 8 Go.

- Stockage gratuit : Entre 2 et 5 Go pour les modèles les plus légers. Un modèle PocketPal AI occupe généralement entre 1 et 4 Go par installation.

- Processeur : tout milieu de gamme supérieur des quatre ou cinq dernières années fonctionne. Pour les modèles plus exigeants et avec plus de paramètres, un processeur très puissant est recommandé.

- Système d’exploitation : pour utiliser PocketPal spécifiquement, Android 7.0 (Nougat) ou supérieur est requis sur Android, et il est également disponible pour iPhone à partir d’iOS 15.1.

La bonne nouvelle est que des modèles plus légers, comme le Qwen2.5-1.5B, peuvent fonctionner sur des appareils encore plus modestes. L’équipe PocketPal elle-même le recommande comme point de départ. Le truc c’est d’essayer. Par exemple, j’ai installé Qwen3-4B et cela fonctionne plutôt bien sur un téléphone milieu de gamme de 5 ans.

Comment installer PocketPal étape par étape

Pour que PocketPal fonctionne correctement sur votre mobile, vous n’avez pas besoin de faire grand-chose. Ci-dessous ces lignes, nous vous expliquons comment procéder étape par étape :

1. Téléchargez l’application

PocketPal AI est disponible sur le Play Store Android et l’App Store d’Apple. Liens pour Android et iOS.

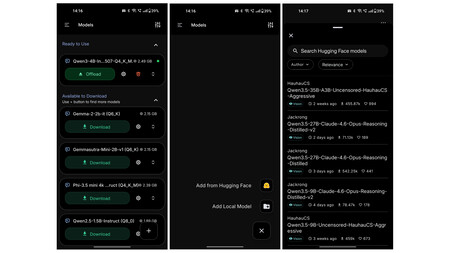

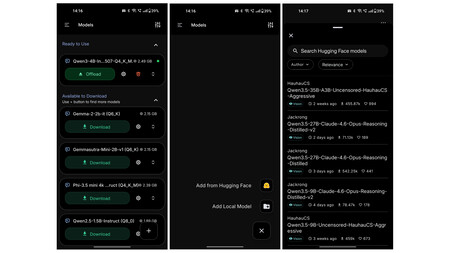

2. Téléchargez un modèle d’IA

Une fois à l’intérieur, l’application vous demandera de télécharger un modèle pour commencer. Dans « Modèles », une liste des modèles disponibles apparaît. Sur cette liste, vous ne trouverez pas de noms comme Gemini ou GPT, qui sont des modèles propriétaires. Au lieu de cela, vous verrez leurs versions open source : Gemma est la version ouverte de Gemini de Google ; Llama est le modèle Meta, la même IA que WhatsApp et Instagram utilisent ; Phi est le modèle ouvert de Microsoft ; et Qwen vient d’Alibaba, entre autres.

Si vous êtes nouveau et que vous souhaitez essayer, l’un des plus recommandés et des plus légers est peut-être Qwen2.5-1.5B. Il donne de bons résultats pour des requêtes simples et est assez rapide (si le matériel de votre téléphone est plus ou moins à la hauteur). Si votre téléphone dispose de plus de 6 Go de RAM et de beaucoup d’espace libre, vous pouvez essayer des modèles avec des paramètres 3B-4B tels que Llama 3.2 3B, qui offre des réponses plus élaborées.

La bonne nouvelle est que vous disposez également de l’intégralité du référentiel Hugging Face à essayer en appuyant sur le bouton dans le coin inférieur droit. Ici, nous pouvons installer n’importe quel modèle directement depuis Hugging Face, comme Qwen3-4B-Instruct, qui est celui que j’ai installé sur le Nord 2, ou en essayer d’autres depuis DeepSeek ou Mistral. Tout fonctionne depuis l’application, sans la quitter.

Important : le téléchargement du modèle nécessite une connexion Internet. Il vous suffit d’être connecté dès le premier instant. A partir de là, tout fonctionne localement.

3. Chargez le modèle et commencez à discuter

Une fois téléchargé, cliquez sur le modèle pour le charger en mémoire. Ensuite, rendez-vous dans la section Chat, tapez votre message et l’IA vous répondra en le traitant entièrement sur votre téléphone. Vous pouvez vérifier cela en désactivant le WiFi et les données.

À quelles performances peut-on s’attendre ?

Il est conseillé d’être réaliste. Une IA locale sur mobile n’est pas ChatGPT. Les réponses arriveront plus lentement et le téléphone chauffera un peu plus que d’habitude en raison d’une utilisation intensive du processeur. Les modèles génèrent entre 5 et 20 jetons par seconde sur les téléphones mobiles haut de gamme, de quoi entretenir une conversation fluide, mais loin de la vitesse d’un serveur doté d’un GPU.

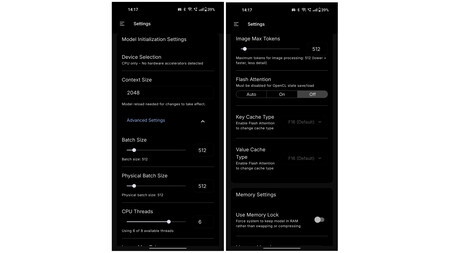

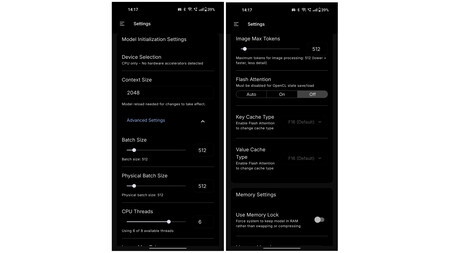

Pour obtenir plus de performances sur iPhone, il existe la possibilité d’activer Metal, l’API d’accélération matérielle d’Apple, et d’augmenter le paramètre « Couches sur GPU » à environ 80. Avec ce changement, iOS déplace une partie du traitement du CPU vers le GPU de l’appareil, ce qui accélère sensiblement la génération de texte. Sur certains appareils récents, l’activation également de l’option « Flash Attention » peut ajouter une amélioration supplémentaire.

Quant aux tailles de fichiers qui fonctionnent le mieux, la solution idéale sur les smartphones et les tablettes est d’utiliser des modèles au format .gguf d’environ 4 Go. Au-delà de ce chiffre, les choses ralentissent considérablement.

PocketPal n’est pas la seule option

PocketPal est probablement l’application la plus accessible pour commencer, mais nous avons également d’autres alternatives. Sur Android, MNN Chat se démarque également, avec un support multimodal. Pour ceux qui utilisent l’iPhone, ils disposent également de Private LLM, bien qu’il soit payant et comprenne des modèles optimisés tirant parti des techniques de quantification pour mieux fonctionner sur des appareils plus modestes.

Si vous souhaitez faire la même chose mais sur ordinateur, il existe deux références : Ollama et LM Studio. Avec eux, il est très simple d’avoir une IA locale sur votre PC. LM Studio possède une interface visuelle très conviviale ; Ollama est plus technique mais plus flexible. Les deux sont gratuits et vous permettent d’exécuter des modèles avec jusqu’à 13 B de paramètres ou plus selon le matériel de votre ordinateur.

Ça vaut le coup, avec des nuances

Une IA locale sur mobile ne remplace pas les grands assistants que nous connaissons, du moins pour le moment. Pour les tâches complexes, les documents longs ou les raisonnements sophistiqués, les versions serveur restent supérieures. Mais pour un usage quotidien (résoudre une question, résumer un paragraphe, chercher des idées, traduire rapidement quelque chose ou simplement avoir une conversation), les petits modèles font un travail plus que correct. Cependant, préparez-vous aux hallucinations.

À Simseo | Ils ont dit que l’IA vidéo générative tuerait Hollywood. Pour le moment, le combat est du côté de la tradition